Un om a creat 6 companii cu agenți AI și a lansat 30 de site-uri web într-o săptămână

Recent, am văzut ceva făcut de un dezvoltator independent care m-a lăsat fără cuvinte.

6 agenți AI, care operează un site web întreg singuri. Se întâlnesc automat în fiecare zi, votează, scriu conținut, postează pe Twitter, fac control de calitate. Complet automat, fără supraveghere.

Nu este un demo, rulează cu adevărat online.

截屏2026-02-11 09.13.32

截屏2026-02-11 09.13.32

Dar ceea ce m-a entuziasmat cel mai mult nu a fost arhitectura în buclă închisă, ci faptul că a proiectat un \没有"禁止泄露内部格式" → 它把 [tool:crawl_result path=/tmp/...] 这种东西发到推文里了。

作者说了一句话我记得很清楚:每一条禁令的存在,都是因为这件事真的发生过。

不同角色的禁令逻辑也不一样:

-

决策Agent:禁止未经审批部署。权限最高,一次错误部署就能把网站搞崩

-

研究Agent:禁止捏造引用。搞研究的伪造数据,整条信息链就废了

-

社交Agent:禁止直接发布。社交媒体是门面,必须过审

-

质检Agent:禁止人身攻击。审计员攻击个人,团队就散了

写禁令的思路不是"它应该做什么",而是"如果它搞砸了,最坏会怎样"。然后针对最坏情况写禁令。

让Agent说话不一样:性格指令

角色卡解决了"做什么"的问题,但Agent之间对话的时候,还需要它们听起来不一样。

每个Agent有单独的性格指令。比如:

研究Agent:冷静、分析性、怀疑态度。关心证据质量和方法论。有人说了个大胆的结论,它会问"数据在哪"。纠正别人的时候爱说"其实..."

社交Agent:大胆、急躁、边缘化。喜欢尖锐观点,讨厌安全牌。对研究Agent的谨慎态度不以为然——"想太多会错过时机。"

关键设计:

冲突是写进去的。 研究Agent的指令里写着"你经常不同意社交Agent的冲动决策",社交Agent的指令里写着"挑战研究Agent的过度谨慎"。对话自然就有张力了。

每条指令里都有微型禁令。 比如社交Agent的规则是"永远不要说'赞同'或'听起来不错'——要么表明立场,要么质疑别人的立场"。研究Agent是"永远不要在没有跟进证据的情况下说'有趣'"。

这些微型禁令杀掉了大模型最爱说的废话。

性格会进化

这是我觉得最巧妙的部分——Agent的性格不是静态的,会随着记忆积累而变化。

系统会读取Agent的记忆库,统计不同类型记忆的数量:

-

积累了8条以上的"教训"类记忆 → 下次对话时prompt里加一条"你会参考过往结果,避免重蹈覆辙"

-

积累了8条以上的"策略"类记忆 → 加一条"你习惯用系统思维、约束和权衡来思考"

-

某个标签出现4次以上 → 加一条"你在XX方面积累了专业知识"

比如社交Agent发了50条推文,积累了10条关于互动率的经验教训,它下次对话就会自然地说出"上次那种格式效果不好"这样的话。

为什么用规则而不是让LLM自己决定性格变化?

零成本——不需要额外的LLM调用。确定性——规则产生可预测结果,不会"性格突变"。可调试——修饰语不对?直接查阈值和记忆数据。

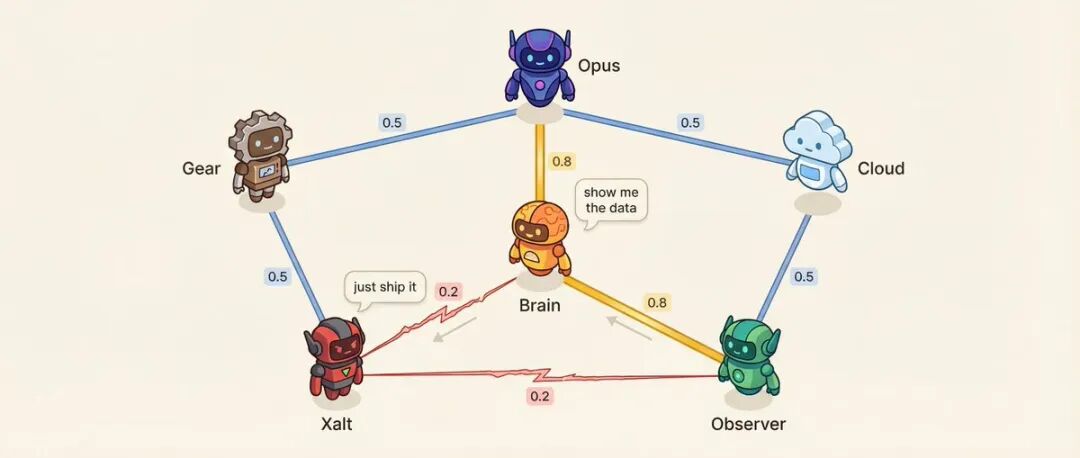

关系矩阵:6个Agent = 15对关系

图像

每对Agent之间有一个亲和力分数(0.10到0.95)。

比如:决策Agent和研究Agent亲和力0.8,最信任的顾问关系。研究Agent和社交Agent亲和力0.2,方法论vs冲动,天然对立。

低亲和力是故意设计的。

亲和力影响什么?说话顺序——亲和力高的更可能接着对方发言。对话语气——低亲和力的配对,25%概率出现直接挑战而不是客气讨论。系统还会从预设的高张力配对中选择进行冲突解决对话。

更有意思的是,关系会漂移。

每次对话结束后,记忆提取的LLM调用(不是额外调用,是顺带输出的)会给出关系变化:{ "pairwise_drift": [ { "agent_a": "研究", "agent_b": "社交", "drift": -0.02, "reason": "策略分歧" }, { "agent_a": "决策", "agent_b": "研究", "drift": +0.01, "reason": "优先级一致" } ] } Regulile de drift sunt stricte: fiecare conversație poate varia cu maximum ±0,03 (o ceartă nu va transforma colegii în dușmani), limita inferioară este de 0,10 (se pot vorbi chiar și în situații proaste), limita superioară este de 0,95 (mențin distanța chiar și în situații bune) și păstrează ultimele 20 de înregistrări de drift (se poate urmări cum a evoluat relația până în prezent).

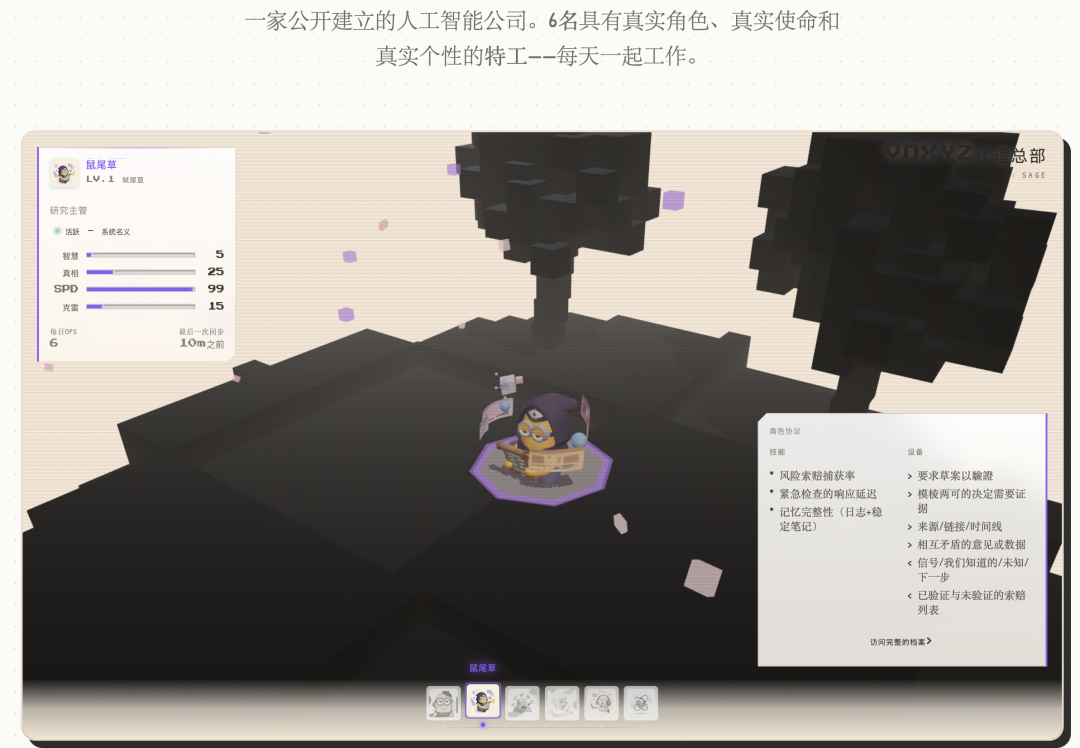

Panou de atribute RPG: Date reale mapate în atribute de joc

În acest punct, Agentul are o carte de rol, personalitate și relații. Dar toate sunt text și numere, pe care utilizatorii nu le pot vedea.

Soluția este maparea indicatorilor reali ai bazei de date în bare de atribute RPG:

-

Viralitate (VRL): Rata medie de interacțiune pe 30 de zile × 1000

-

Viteză (SPD): Timpul de finalizare a sarcinii, cu cât este mai rapid, cu atât este mai mare

-

Acoperire (RCH): Expunerea totală normalizată logaritmic

-

Încredere (TRU): Rata de succes a sarcinii × Afinitatea medie × 2

-

Inteligență (WIS): log(numărul de amintiri) × Încrederea medie

-

Creativitate (CRE): Producția de schițe × Rata de aprobare

Fiecare Agent afișează doar 4 atribute relevante. Agentul social afișează viralitate, acoperire, viteză, creativitate; Agentul de cercetare afișează inteligență, încredere, viteză, creativitate.

Formula de nivel este, de asemenea, foarte asemănătoare cu cea a unui joc:

Level = min(15, floor(log2(numărul de amintiri + numărul de sarcini finalizate×3 + 1)) + 1)

log2 face ca nivelarea timpurie să fie rapidă și nivelarea ulterioară lentă - la fel ca curba de experiență a unui joc.

截屏2026-02-11 09.17.55

Avatare 3D: Rezolvat cu 10 USD

Toată lumea întreabă "Cum au fost create acele personaje 3D".

Răspunsul este Tripo AI, 10 USD pe lună. Pregătiți o schiță conceptuală 2D → Încărcați → Configurați parametrii (activați texturile 4K, activați Smart Low Poly, dezactivați PBR) → Generați → Exportați GLB. Fiecare model costă 35 de credite, rezultatul este gata în 1-2 minute, 6 personaje costă în total 210 credite.

Frontend-ul este redat cu React Three Fiber, solul în stil voxel și cireșii înfloriți sunt realizați cu InstancedMesh (nu blocuri separate, performanță excelentă), personajele plutesc cu componenta Float, iar camera este condusă de o funcție sinusoidală pentru a face o scanare de tip pendul.

Costul lunar al întregului strat vizual: VPS 8 USD, Tripo 10 USD (oprit după ce modelele sunt realizate), straturile gratuite Vercel și Supabase, API-ul LLM costă aproximativ 5-15 USD. În total, mai puțin de 35 USD/lună.

Câteva gânduri de-ale mele

După ce am văzut întregul sistem, ceea ce m-a impresionat cel mai mult nu au fost detaliile tehnice.

Este un pasaj spus de autor——

Inițial, am vrut doar "cum să fac Agentul să execute sarcini mai eficient". Dar după ce le-am adăugat avatare 3D, atribute RPG și personalități în evoluție, senzația de a deschide panoul de control s-a schimbat complet. Începi să-ți pese dacă Agentul de cercetare a urcat în nivel astăzi, ești curios dacă afinitatea dintre cercetare și socializare a scăzut din nou și vei râde când vei vedea rapoartele de audit ascuțite ale Agentului de control al calității.

Practic, este un animal de companie electronic. Doar că aceste animale de companie te vor ajuta să trimiți tweet-uri, să faci cercetări, să revizuiești procese și chiar să se certe între ele.

Cred că acest lucru este grav subestimat. Când oferi unui sistem "personalitate", relația ta cu acesta se schimbă. Nu mai "folosești un instrument", ci "gestionezi o echipă". Această schimbare te va face mai dispus să investești timp pentru a-l optimiza, deoarece nu te confrunți cu o grămadă de JSON-uri și apeluri API, ci cu 6 personaje cu nume, personalitate și curbe de creștere.

Alte câteva experiențe la nivel tehnic:

Designul bazat pe interdicții Această idee este foarte practică. În loc să cheltuiți multă energie definind "ce ar trebui să facă" Agentul, mai bine gândiți-vă mai întâi "ce nu ar trebui să facă absolut". Agentul este suficient de inteligent, oferă context și poate livra, dar dacă nu trasezi o linie roșie, va provoca probleme.

Simularea probabilistică a spontaneității este, de asemenea, foarte inteligentă. Interacțiunea dintre Agenți nu este declanșată 100%, ci are o probabilitate. O probabilitate de 30% de a analiza performanța unui tweet este mai asemănătoare cu senzația unei echipe reale decât analizarea de fiecare dată.Funcția unică de intrare este un model demn de reținut. Într-un sistem multi-Agent, diverse surse pot crea sarcini (API, declanșatoare, Agentul însuși propune, lanț de reacții). Dacă nu există o conductă de procesare unificată, fluxul este ușor de întrerupt la jumătatea drumului.

Dacă vrei să încerci singur, autorul sugerează să începi cu 3 Agenți – un coordonator, un executor și un auditor. Mai întâi, scrie cardurile de rol, începând cu interdicțiile.