إصدار Qwen 3.5: نموذج مفتوح الوزن بـ 397 مليار معلمة وتكلفة أقل بنسبة 60٪

أصدرت Alibaba للتو Qwen 3.5-397B-A17B. هذا هو أول نموذج مفتوح الوزن من سلسلة Qwen 3.5.

البيانات الأساسية

- إجمالي المعلمات: 397B

- المعلمات النشطة: 17B per pass (MoE متفرقة)

- الإنتاجية: تحسين 8.6x-19x مقارنة بـ Qwen 3-Max

- التكلفة: أقل بنسبة 60٪ مقارنة بـ Qwen 3

- دعم اللغة: 201 لغة (موسعة من 119 لغة)

هذا ليس مجرد تكديس للمعلمات. هذا إعادة تعريف للكفاءة.

ابتكار معماري

يستخدم Qwen 3.5 بنية هجينة:

- Gated Delta Networks + MoE متفرقة

- انتباه خطي مختلط: تستخدم معظم الطبقات انتباهًا خطيًا، وتستخدم كل 4 طبقات انتباهًا كاملاً

- متعدد الوسائط أصلي: ليس إضافة لاحقة، ولكن تم تدريبه من البداية

يوجد تحليل فني على X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

أهمية هذه البنية هي: تحقيق أداء يقارب نموذج 400B باستخدام 17B من المعلمات النشطة. انخفضت تكاليف الاستدلال بشكل كبير.

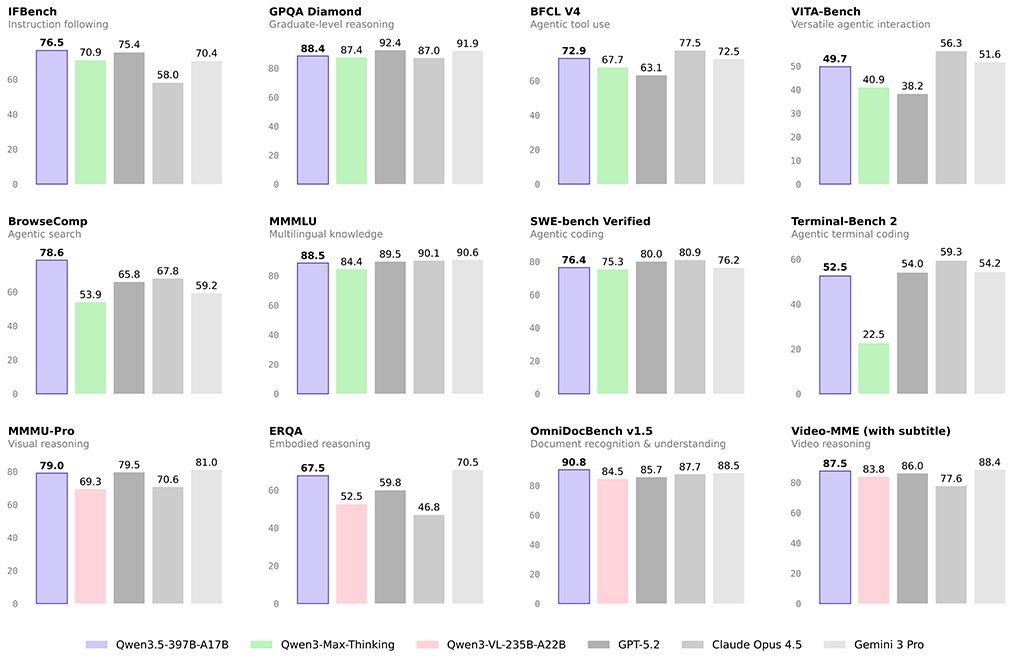

ادعاءات الأداء

تدعي Alibaba أن Qwen 3.5 تفوقت على:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

بدأ المختبرون المستقلون على X في التحقق:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

لكن الأهم ليس الاختبارات المعيارية، بل قدرات الوكيل:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

عصر الوكلاء

موقع Qwen 3.5 واضح: مصمم لعصر الوكلاء.

- يمكنه تحليل مقاطع فيديو مدتها ساعتان

- يمكنه تنفيذ مهام عبر التطبيقات بشكل مستقل

- يمكنه فهم واجهات المستخدم الرسومية والتفاعل معها

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

هذا يعني أنه ليس "روبوت محادثة"، بل "منفذ مهام".

المشهد التنافسي

لخص شخص ما على X إصدارات الذكاء الاصطناعي لهذا الأسبوع:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

إيقاع الشركات المصنعة للنماذج الصينية واضح:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

هناك نموذج جديد كل أسبوع، ويدعي كل نموذج أنه يتفوق على GPT. هذا ليس تسويقًا، بل تصعيد في حرب التكلفة.

هيكل التكلفة

سعر الرمز المميز لـ Qwen 3.5 هو 1/18 فقط من سعر Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

عندما يكون الأداء قريبًا، وتكون التكلفة 5٪ فقط، أين يقع الخندق الدفاعي للنماذج المغلقة المصدر؟

الخلاصة

Qwen 3.5 ليس "GPT الصيني". إنه معطل لهيكل التكلفة:

- 397 مليار معلمة، ولكن يتم تنشيط 17 مليار فقط

- وزن مفتوح، يمكن نشره محليًا

- قدرات الوكيل، ليست مجرد محادثة

- التكلفة 5٪ فقط من المنافسين

هناك توقع مثير للاهتمام على X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

ذاكرة وصول عشوائي للفيديو بسعة 225 جيجابايت، يمكن تشغيلها على جهاز واحد. هذا يعني أن المطورين الصغار والمتوسطين يمكنهم لأول مرة الوصول إلى نموذج يقارب مستوى GPT-5.

السؤال الحقيقي ليس ما إذا كان Qwen 3.5 يمكنه التغلب على GPT-5.3، ولكن: كيف تربح شركات الذكاء الاصطناعي عندما تنخفض تكلفة النماذج عالية المستوى إلى ما يقرب من الصفر؟