Qwen 3.5 Lançado: Modelo de Peso Aberto de 397B Parâmetros, Custo Reduzido em 60%

A Alibaba acaba de lançar o Qwen 3.5-397B-A17B. Este é o primeiro modelo de peso aberto da série Qwen 3.5.

Dados Principais

- Parâmetros Totais: 397B

- Parâmetros Ativos: 17B per pass (MoE esparso)

- Throughput (Vazão): 8.6x-19x maior que o Qwen 3-Max

- Custo: 60% menor que o Qwen 3

- Suporte a Idiomas: 201 (expandido de 119)

Isto não é simplesmente empilhar parâmetros. É uma redefinição de eficiência.

Inovação na Arquitetura

Qwen 3.5 usa uma arquitetura híbrida:

- Gated Delta Networks + MoE esparso

- Atenção Linear Híbrida: A maioria das camadas usa atenção linear, atenção total a cada 4 camadas

- Multimodal Nativo: Não é adicionado posteriormente, mas treinado desde o início

Há análises técnicas no X:

"Qwen3.5-397B-A17B: Hybrid linear attention + sparse MoE with large-scale RL environment scaling." — @Alibaba_Qwen

O significado desta arquitetura é: alcançar o desempenho de um modelo de quase 400B com 17B de parâmetros ativos. O custo de inferência é drasticamente reduzido.

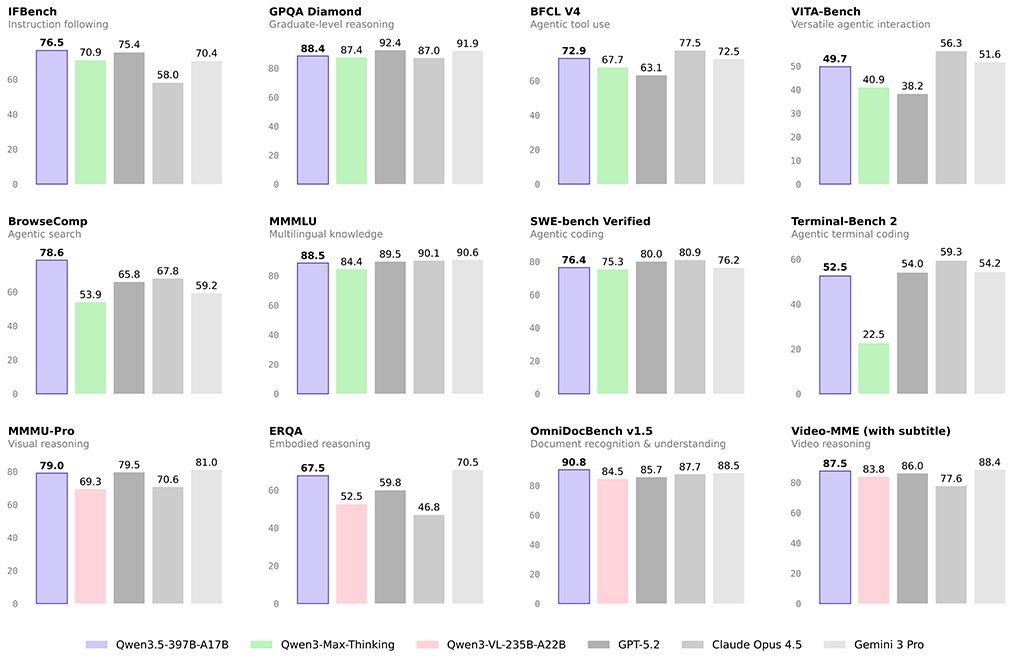

Alegações de Desempenho

A Alibaba afirma que o Qwen 3.5 derrotou:

- GPT-5.2

- Claude Opus 4.5

- Gemini 3 Pro

Testadores independentes no X começaram a verificar:

"Qwen 3.5-397B dropped today... and the benchmarks are insane. Trading blows with Claude Opus 4.5 and GPT-5.2 across the board." — @antonpme

Mas o mais importante não são os benchmarks, mas a capacidade de agente:

"The agentic capabilities are the real story here. Qwen 3.5 can interact with GUIs, not just understand them. That's the unlock for workflows that touch existing software." — @thebuildrweekly

Era do Agente

A posição do Qwen 3.5 é clara: projetado para a era do agente.

- Pode analisar 2 horas de vídeo

- Pode executar tarefas entre aplicativos de forma independente

- Pode entender e interagir com GUIs

"Qwen 3.5 can independently take actions across apps." — @thebuildrweekly

Isso significa que não é um "chatbot", mas um "executor de tarefas".

Cenário Competitivo

Alguém no X resumiu os lançamentos de IA desta semana:

"This might be the single biggest week in AI history: DeepSeek V4, Gemini 3.1 Pro, GPT-5.3, Qwen 3.5, Claude Sonnet 5." — @HeyAbhishek

O ritmo dos fabricantes de modelos chineses é claro:

- DeepSeek V4

- Qwen 3.5

- GLM 5

- MiniMax 2.5

Há um novo modelo a cada semana, e cada um afirma derrotar o GPT. Isso não é marketing, é uma escalada na guerra de custos.

Estrutura de Custos

O preço do token do Qwen 3.5 é apenas 1/18 do Gemini 3 Pro.

"Qwen 3.5 with performance comparable to Gemini 3, and a token price of only 1/18 of the latter." — @dyz_ob

Quando o desempenho é próximo e o custo é de apenas 5%, onde está o fosso dos modelos de código fechado?

Conclusão

Qwen 3.5 não é um "GPT chinês". É um disruptor da estrutura de custos:

- 397B parâmetros, mas apenas 17B são ativados

- Peso aberto, pode ser implantado localmente

- Capacidade de agente, não apenas diálogo

- Custo é apenas 5% do concorrente

Há uma previsão interessante no X:

"Qwen 3.5 Q4 版本只需要 225G,很有实用价值" — @janxin

225GB de VRAM, pode ser executado em uma única máquina. Isso significa que pequenos e médios desenvolvedores podem acessar um modelo próximo ao GPT-5 pela primeira vez.

A verdadeira questão não é se o Qwen 3.5 pode derrotar o GPT-5.3, mas: quando o custo dos modelos de ponta cai para perto de zero, como as empresas de IA ganham dinheiro?