Eine 107-seitige Übersicht über RAG und Agent&LLM-Gedächtnis

Heute teile ich eine 107-seitige technische Übersicht von Renmin University, Fudan University, Peking University usw. mit dem Titel "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics".

Projektadresse: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Papieradresse: https://arxiv.org/pdf/2512.13564

In den letzten zwei Jahren haben wir die erstaunliche Entwicklung von Large Language Models (LLMs) zu AI Agents erlebt. Von Deep Research bis Software Engineering, von wissenschaftlichen Entdeckungen bis hin zur Multi-Agenten-Kollaboration treiben diese auf Basismodellen basierenden Agenten die Grenzen der Artificial General Intelligence (AGI) voran.

Aber eine zentrale Frage taucht auf: Wie können Agenten kontinuierliches Lernen und Anpassungsfähigkeit erlangen, wenn die statischen LLM-Parameter nicht schnell aktualisiert werden können?

Die Antwort lautet: Gedächtnis (Memory).

"Gedächtnis ist die Schlüsselkompetenz, um statische LLMs in intelligente Agenten zu verwandeln, die sich durch Interaktion mit der Umgebung kontinuierlich anpassen können."

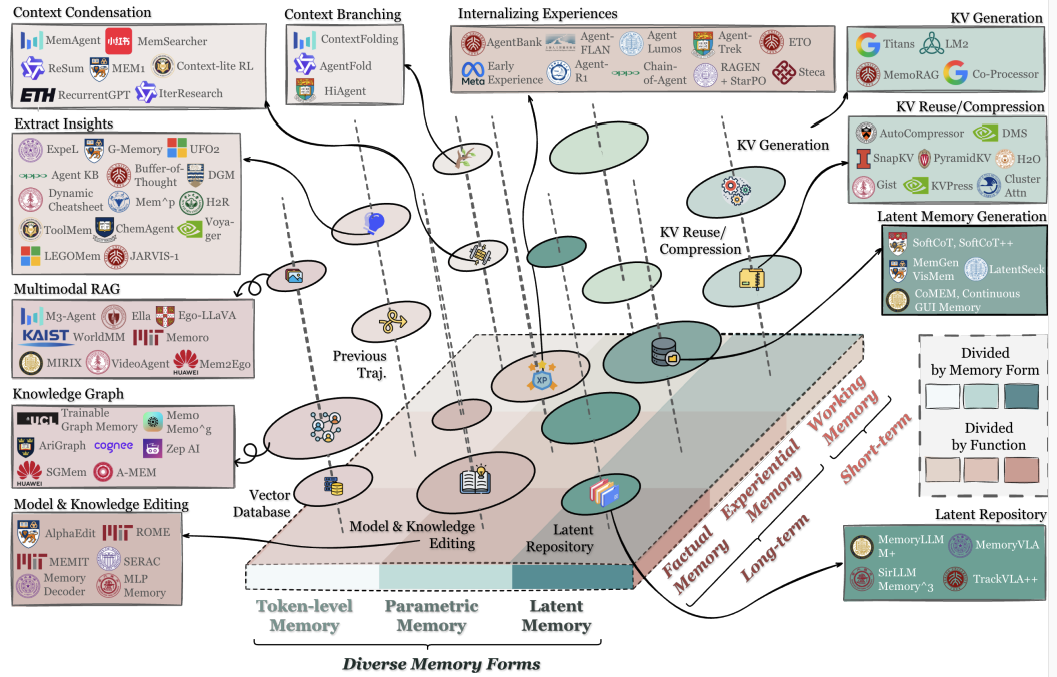

Figure 1 zeigt den von der Arbeit vorgeschlagenen einheitlichen Klassifizierungsrahmen, der das Agentengedächtnis nach den drei Dimensionen Formen (Forms), Funktionen (Functions) und Dynamik (Dynamics) organisiert und repräsentative Systeme diesem Klassifizierungssystem zuordnet.

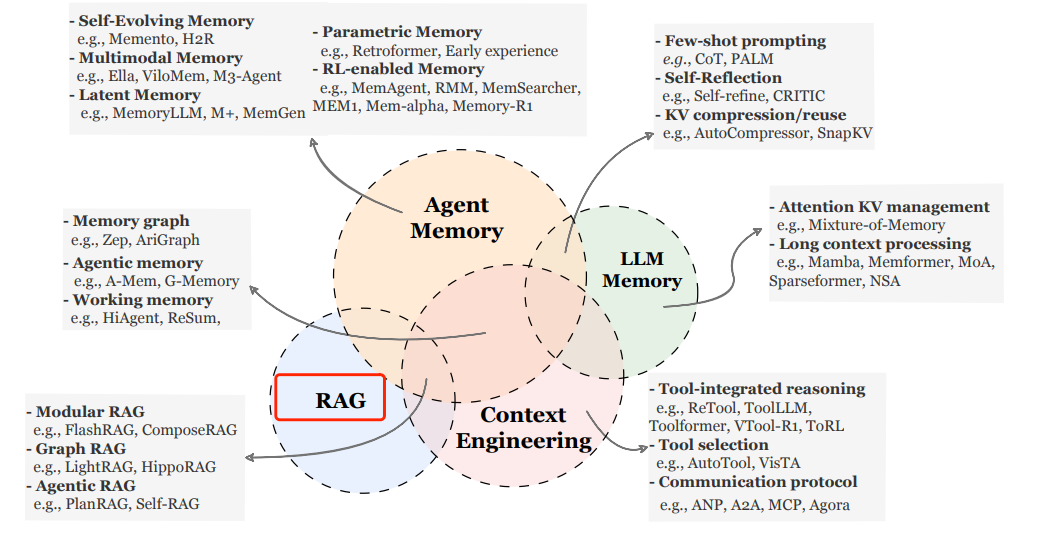

Die Arbeit unterscheidet auch klar zwischen Agent Memory und einigen eng verwandten, aber grundlegend unterschiedlichen Konzepten: LLM-Gedächtnis, Retrieval-Augmented Generation (RAG) und Context Engineering. Obwohl sie alle mit der Speicherung und Nutzung von Informationen zusammenhängen, gibt es wesentliche Unterschiede in Bezug auf Ziele, Mechanismen und Anwendungsszenarien.

Agenten-Gedächtnis-Technologien

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Agenten-Gedächtnis vs. RAG

RAG-bezogene Technologien:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG und Agentengedächtnis beinhalten beide das Abrufen von Informationen aus externen Speichern, um die Modellfähigkeiten zu verbessern, aber es gibt einen wesentlichen Unterschied in der Designphilosophie zwischen den beiden:

FeatureRAGAgentengedächtnis KernzielBereitstellung relevanter Hintergrundinformationen zur Unterstützung der aktuellen AbfrageKontinuierliches Lernen und adaptives Verhalten über die Zeit InformationsquelleIn der Regel statische, vorgefertigte WissensbasisDynamisch generierte, personalisierte Informationen aus der eigenen Interaktionserfahrung des Agenten AbrufauslöserPassiv ausgelöst durch BenutzerabfragenAktiv vom Agenten entschieden, wann und was abgerufen werden soll InformationsaktualisierungWissensbasis wird in der Regel offline aktualisiertOnline, kontinuierlich und selektiv aktualisiert Feedback-SchleifeKein direkter Feedback-MechanismusBildet eine geschlossene Schleife mit der Umgebung

Hauptunterschied: RAG ist ein Werkzeug zur Wissenserweiterung, während das Agentengedächtnis ein Lernmechanismus ist. RAG beantwortet "Was ich weiß", das Agentengedächtnis beantwortet "Was ich gelernt habe".

Agenten-Gedächtnis vs. LLM-Gedächtnis

LLM-Gedächtnis-bezogene Technologien:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensionLLM-GedächtnisAgenten-Gedächtnis DefinitionVerinnerlichtes Wissen in Modellparametern oder temporäre Informationen im KontextfensterExternes System zur Unterstützung der kontinuierlichen Interaktion des Agenten mit der Umgebung, des aufgabenübergreifenden Lernens und der langfristigen Anpassung ZeitskalaBeschränkt auf vortrainierte Daten oder den aktuellen DialogkontextErstreckt sich über mehrere Aufgaben und Sitzungen und unterstützt lebenslanges Lernen AktualisierbarkeitParameteraktualisierungen sind kostspielig, Kontextinformationen sind flüchtigUnterstützt effiziente, selektive dynamische Aktualisierungen und Evolution ProaktivitätReagiert passiv auf AbfragenEntscheidet aktiv, welche Informationen gespeichert, aktualisiert und abgerufen werden sollen Kopplung mit der UmgebungKeine direkte Interaktion mit der UmgebungTiefe Integration von Umgebungsfeedback, unterstützt interaktives Lernen

Hauptunterschied: LLM-Gedächtnis ist im Wesentlichen statisch (Parameter fest) oder kurzlebig (Kontext beschränkt), während das Agentengedächtnis dynamisch, persistent und umweltgekoppelt ist.

Agenten-Gedächtnis vs. Context Engineering

Context Engineering-bezogene Technologien:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspektContext EngineeringAgenten-Gedächtnis FokusEingabeoptimierung für einzelne Runden oder aktuelle AufgabenPersistenz und Nutzung von Informationen über mehrere Runden und Aufgaben hinweg Zeitliche DimensionAktuelle SitzungLangfristige Historie InformationsauswahlManuell entworfene oder heuristische RegelnAutomatisierte Mechanismen zur Bildung, Evolution und zum Abrufen ZustandsverwaltungKein persistenter ZustandExplizite Wartung eines entwicklungsfähigen Gedächtniszustands

Hauptunterschied: Context Engineering ist eine Technik zur Prompt-Optimierung, das Agentengedächtnis ist ein Zustandsverwaltungssystem. Ersteres konzentriert sich auf "Was jetzt eingegeben wird", letzteres konzentriert sich auf "Was in der Vergangenheit erinnert wurde und wie es die Gegenwart und Zukunft beeinflusst".