Una revisión de 107 páginas sobre RAG y la memoria de Agent & LLM

Hoy comparto una revisión técnica de 107 páginas de la Universidad Renmin de China, la Universidad de Fudan, la Universidad de Pekín, etc., titulada "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics" (Memoria en la era de los agentes de IA: una encuesta sobre formas, funciones y dinámicas).

Dirección del proyecto: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Dirección del artículo: https://arxiv.org/pdf/2512.13564

En los últimos dos años, hemos sido testigos de la asombrosa evolución de los modelos de lenguaje grandes (LLM) a los agentes de IA (AI Agents). Desde la investigación profunda hasta la ingeniería de software, desde el descubrimiento científico hasta la colaboración multiagente, estos agentes basados en modelos fundamentales están impulsando los límites de la inteligencia artificial general (AGI).

Pero surge una pregunta central: Los parámetros estáticos de LLM no se pueden actualizar rápidamente, ¿cómo hacer que los agentes tengan la capacidad de aprender y adaptarse continuamente?

La respuesta es: Memoria (Memory).

"La memoria es la capacidad clave para transformar los LLM estáticos en agentes inteligentes capaces de adaptarse continuamente a través de la interacción con el entorno."

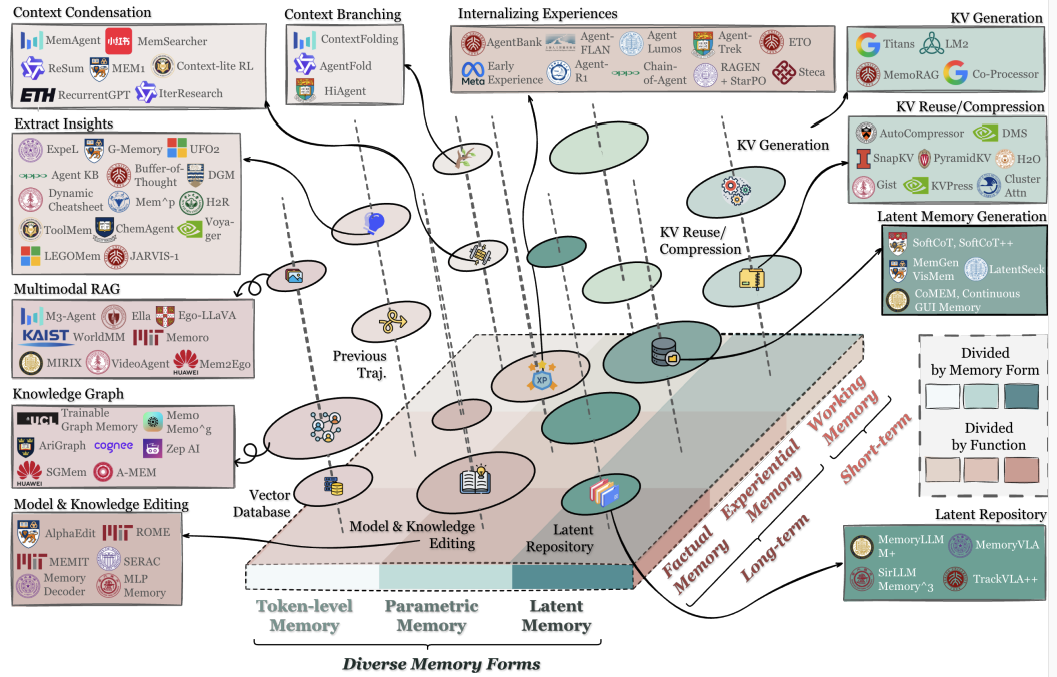

Figure 1 muestra el marco de clasificación unificado propuesto en el artículo, que organiza la memoria del agente según tres dimensiones: Formas (Forms), Funciones (Functions) y Dinámicas (Dynamics), y asigna sistemas representativos a este sistema de clasificación.

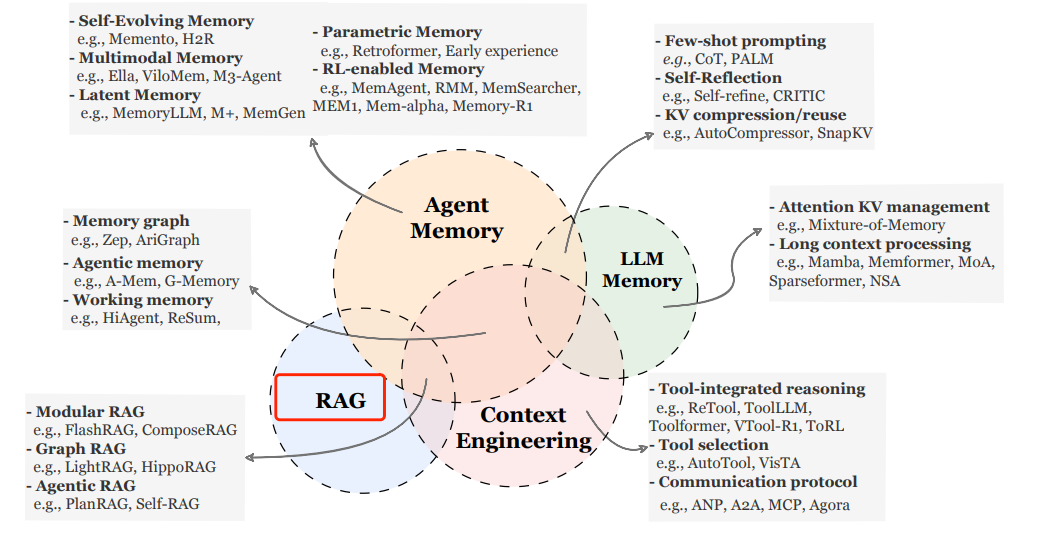

El artículo también distingue claramente entre Agent Memory y varios conceptos estrechamente relacionados pero esencialmente diferentes: LLM memory, Retrieval-Augmented Generation (RAG) y Context Engineering. Aunque todos están relacionados con el almacenamiento y la utilización de información, existen diferencias clave en los objetivos, los mecanismos y los escenarios de aplicación.

Tecnologías de memoria de agentes

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Memoria de agente vs. RAG

Tecnologías relacionadas con RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG y la memoria del agente implican la recuperación de información del almacenamiento externo para mejorar las capacidades del modelo, pero existen diferencias esenciales en la filosofía de diseño entre los dos:

CaracterísticaRAGMemoria del agente Objetivo principalProporcionar soporte de conocimiento de fondo relevante para la consulta actualAprendizaje continuo y comportamiento adaptativo a lo largo del tiempo Fuente de informaciónGeneralmente bases de conocimiento estáticas y preconstruidasInformación personalizada generada dinámicamente a partir de las propias experiencias de interacción del agente Disparador de recuperaciónActivado pasivamente por la consulta del usuarioEl agente decide activamente cuándo y qué recuperar Actualización de informaciónLa base de conocimiento generalmente se actualiza fuera de líneaActualización en línea, continua y selectiva Bucle de retroalimentaciónSin mecanismo de retroalimentación directaForma un bucle cerrado con la interacción ambiental

Diferencia clave: RAG es una herramienta de expansión de conocimiento, mientras que la memoria del agente es un mecanismo de aprendizaje. RAG responde "Lo que sé", la memoria del agente responde "Lo que he aprendido".

Memoria de agente vs. Memoria LLM

Tecnologías relacionadas con la memoria LLM:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensiónMemoria LLMMemoria del agente DefiniciónConocimiento internalizado en los parámetros del modelo o información temporal en la ventana de contextoSistema externo que admite la interacción continua del agente con el entorno, el aprendizaje entre tareas y la adaptación a largo plazo Escala de tiempoLimitado a datos de preentrenamiento o contexto de conversación actualAbarca múltiples tareas, sesiones y admite el aprendizaje permanente ActualizabilidadLa actualización de parámetros es costosa, la información de contexto es volátilAdmite actualizaciones y evolución dinámicas, eficientes y selectivas ProactividadResponde pasivamente a las consultasDecide activamente qué información almacenar, actualizar y recuperar Acoplamiento con el entornoSin interacción directa con el entornoProfundamente integrado con la retroalimentación del entorno, admite el aprendizaje interactivo

Diferencia clave: La memoria LLM es esencialmente estática (parámetros fijos) o transitoria (contexto limitado), mientras que la memoria del agente es dinámica, persistente y acoplada al entorno.

Memoria de agente vs. Ingeniería de contexto

Tecnologías relacionadas con la ingeniería de contexto:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspectoIngeniería de contextoMemoria del agente FocoOptimización de la entrada para una sola ronda o tarea actualPersistencia y utilización de información en múltiples rondas y tareas Dimensión temporalSesión actualHistorial a largo plazo Selección de informaciónDiseño manual o reglas heurísticasMecanismos automatizados de formación, evolución y recuperación Gestión del estadoSin estado persistenteMantenimiento explícito del estado de memoria evolutivo

Diferencia clave: La ingeniería de contexto es una técnica de optimización de prompts, la memoria del agente es un sistema de gestión de estado. El primero se centra en "Qué ingresar ahora", el segundo se centra en "Qué se recordó en el pasado, cómo afecta el presente y el futuro".