Une revue de 107 pages sur RAG et la mémoire des Agents & LLM

Aujourd'hui, je partage une revue technique de 107 pages de l'Université du Peuple, de l'Université Fudan, de l'Université de Pékin, etc., intitulée « Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics » (La mémoire à l'ère des agents d'IA : une étude sur les formes, les fonctions et la dynamique).

Adresse du projet : https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Adresse de l'article : https://arxiv.org/pdf/2512.13564

Au cours des deux dernières années, nous avons assisté à l'évolution étonnante des grands modèles de langage (LLM) vers les agents d'IA (AI Agents). De la recherche approfondie à l'ingénierie logicielle, de la découverte scientifique à la collaboration multi-agents, ces agents basés sur des modèles fondamentaux repoussent les limites de l'intelligence artificielle générale (AGI).

Mais une question centrale se pose : Comment permettre aux agents d'acquérir des capacités d'apprentissage et d'adaptation continues, étant donné que les paramètres statiques des LLM ne peuvent pas être mis à jour rapidement ?

La réponse est : la mémoire (Memory).

"La mémoire est la capacité clé qui transforme les LLM statiques en agents capables de s'adapter continuellement grâce à l'interaction avec l'environnement."

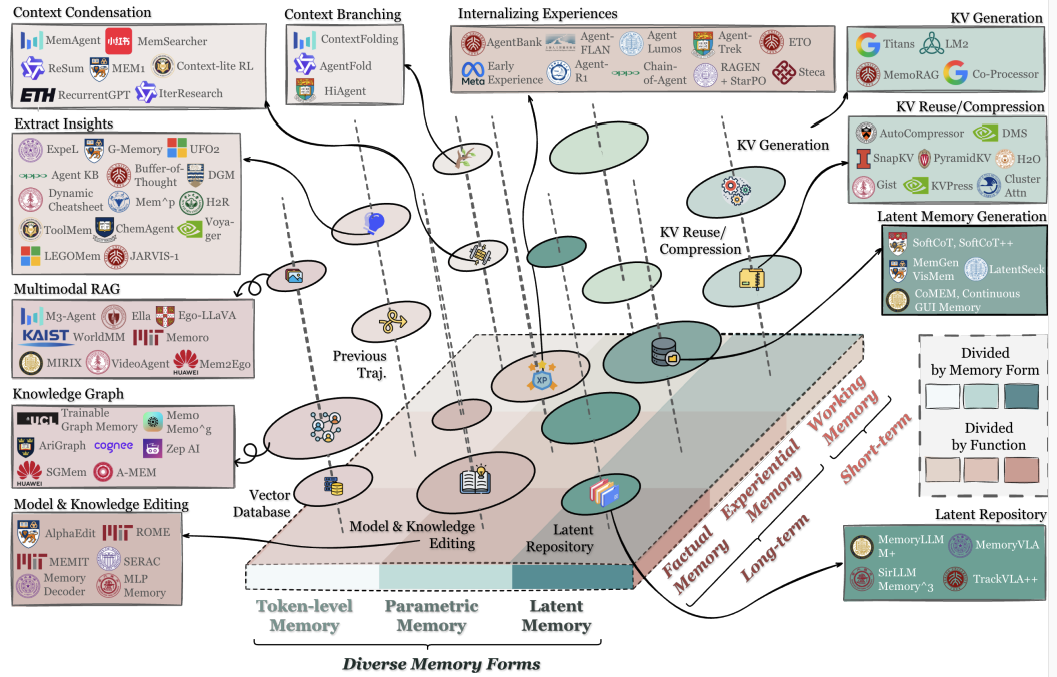

La Figure 1 présente le cadre de classification unifié proposé dans l'article, qui organise la mémoire des agents selon trois dimensions : Formes (Forms), Fonctions (Functions) et Dynamique (Dynamics), et mappe les systèmes représentatifs dans ce système de classification.

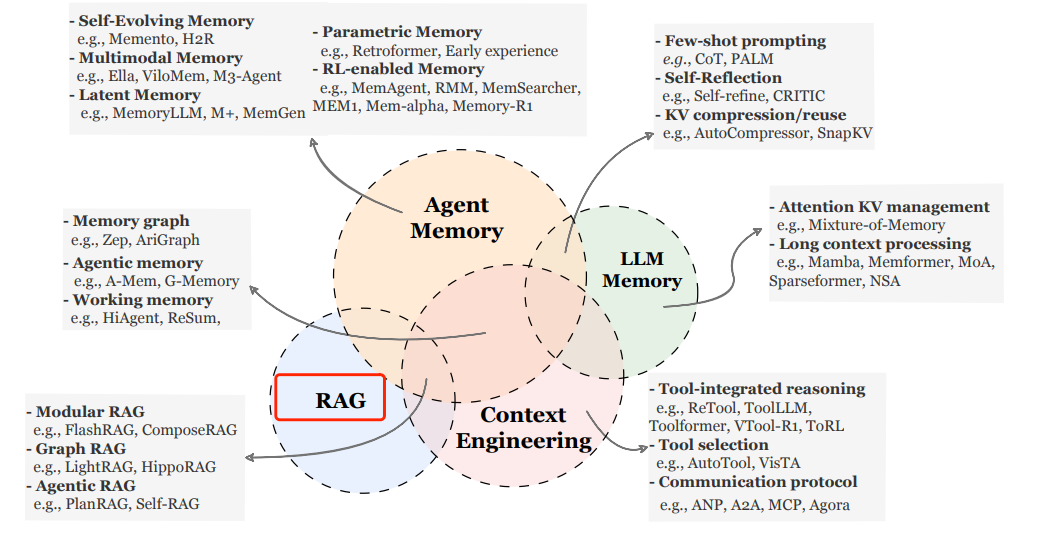

L'article distingue également clairement la mémoire des agents de plusieurs concepts étroitement liés mais fondamentalement différents : la mémoire des LLM, la génération augmentée par la récupération (RAG) et l'ingénierie du contexte. Bien qu'ils soient tous liés au stockage et à l'utilisation de l'information, il existe des différences essentielles en termes d'objectifs, de mécanismes et de scénarios d'application.

Technologies de mémoire des agents

-

Self-Evolving Memory : Memento, H2R

-

Multimodal Memory : Ella, ViloMem, M3-Agent

-

Latent Memory : MemoryLLM, M+, MemGen

-

Parametric Memory : Retroformer, Early experience

-

RL-enabled Memory : MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Mémoire des agents vs. RAG

Technologies liées à RAG :

-

Modular RAG : FlashRAG, ComposeRAG

-

Graph RAG : LightRAG, HippoRAG

-

Agentic RAG : PlanRAG, Self-RAG

RAG et la mémoire des agents impliquent tous deux la récupération d'informations à partir d'un stockage externe pour améliorer les capacités du modèle, mais il existe une différence essentielle dans la philosophie de conception :

CaractéristiqueRAGMémoire des agents Objectif principalFournir un support de connaissances de fond pertinent pour la requête actuelleApprentissage continu et comportement adaptatif au fil du temps Source d'informationGénéralement des bases de connaissances statiques et préconstruitesInformations personnalisées générées dynamiquement à partir de l'expérience d'interaction de l'agent lui-même Déclenchement de la récupérationDéclenchée passivement par la requête de l'utilisateurL'agent décide activement quand et quoi récupérer Mise à jour de l'informationLa base de connaissances est généralement mise à jour hors ligneMise à jour en ligne, continue et sélective Boucle de rétroactionAucun mécanisme de rétroaction directForme une boucle fermée avec l'interaction avec l'environnement

Différence clé : RAG est un outil d'extension des connaissances, tandis que la mémoire des agents est un mécanisme d'apprentissage. RAG répond à la question "Que sais-je ?", tandis que la mémoire des agents répond à la question "Qu'ai-je appris ?".

Mémoire des agents vs. Mémoire des LLM

Technologies liées à la mémoire des LLM :

-

Attention KV management : Mixture-of-Memory

-

Long context processing : Mamba, Memformer, MoA, Sparseformer, NSA

DimensionMémoire des LLMMémoire des agents DéfinitionConnaissances internalisées dans les paramètres du modèle, ou informations temporaires dans la fenêtre de contexteSystème externe qui prend en charge l'interaction continue de l'agent avec l'environnement, l'apprentissage inter-tâches et l'adaptation à long terme Échelle de tempsLimitée aux données de pré-entraînement ou au contexte de la conversation actuelleS'étend sur plusieurs tâches, sessions, prend en charge l'apprentissage tout au long de la vie Mise à jourLe coût de la mise à jour des paramètres est élevé, les informations contextuelles sont volatilesPrend en charge une mise à jour et une évolution dynamiques, efficaces et sélectives ProactivitéRépond passivement aux requêtesDécide activement quelles informations stocker, mettre à jour et récupérer Couplage avec l'environnementAucune interaction directe avec l'environnementIntègre profondément la rétroaction de l'environnement, prend en charge l'apprentissage interactif

Différence clé : La mémoire des LLM est essentiellement statique (paramètres fixes) ou éphémère (contexte limité), tandis que la mémoire des agents est dynamique, persistante et couplée à l'environnement.

Mémoire des agents vs. Ingénierie du contexte

Technologies liées à l'ingénierie du contexte :

-

Tool-integrated reasoning : ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection : AutoTool, VisTA

-

Communication protocol : ANP, A2A, MCP, Agora

AspectIngénierie du contexteMémoire des agents FocusOptimisation de l'entrée pour un seul tour ou la tâche actuellePersistance et utilisation de l'information sur plusieurs tours et tâches Dimension temporelleSession actuelleHistorique à long terme Sélection de l'informationConception manuelle ou règles heuristiquesMécanismes automatisés de formation, d'évolution et de récupération Gestion de l'étatAucun état persistantMaintien explicite d'un état de mémoire évolutif

Différence clé : L'ingénierie du contexte est une technique d'optimisation des invites, tandis que la mémoire des agents est un système de gestion de l'état. La première se concentre sur "Que saisir maintenant", tandis que la seconde se concentre sur "Qu'est-ce qui a été mémorisé dans le passé, et comment cela affecte-t-il le présent et l'avenir ?".