Una recensione di 107 pagine su RAG e memoria di Agent&LLM

Oggi condivido una recensione tecnica di 107 pagine di Renmin University, Fudan University, Peking University, ecc. intitolata "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics".

Indirizzo del progetto: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Indirizzo dell'articolo: https://arxiv.org/pdf/2512.13564

Negli ultimi due anni, abbiamo assistito alla straordinaria evoluzione dei modelli linguistici di grandi dimensioni (LLM) in agenti AI (AI Agents). Dalla Deep Research all'ingegneria del software, dalla scoperta scientifica alla collaborazione multi-agente, questi agenti basati su modelli fondamentali stanno spingendo i confini dell'intelligenza artificiale generale (AGI).

Ma emerge una domanda fondamentale: come possono gli agenti avere capacità di apprendimento e adattamento continuo se i parametri statici degli LLM non possono essere aggiornati rapidamente?

La risposta è: Memoria (Memory).

"La memoria è la capacità chiave per trasformare gli LLM statici in agenti intelligenti in grado di adattarsi continuamente attraverso l'interazione con l'ambiente."

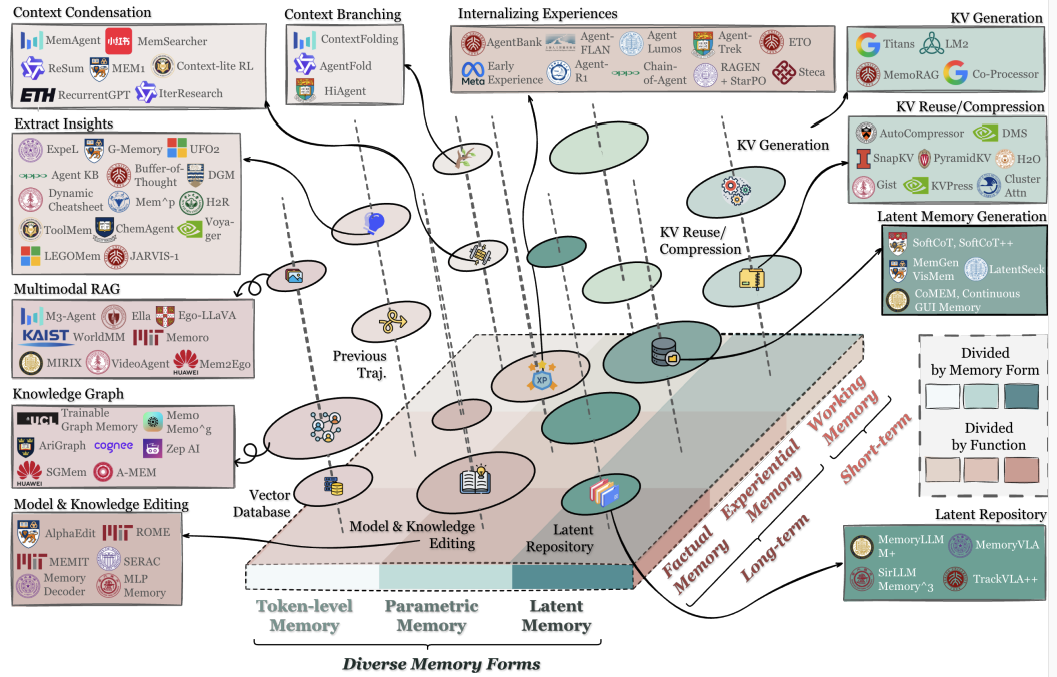

La Figura 1 mostra il framework di classificazione unificato proposto nell'articolo, che organizza la memoria dell'agente in base a tre dimensioni: Forme (Forms), Funzioni (Functions), Dinamiche (Dynamics), e mappa i sistemi rappresentativi in questo sistema di classificazione.

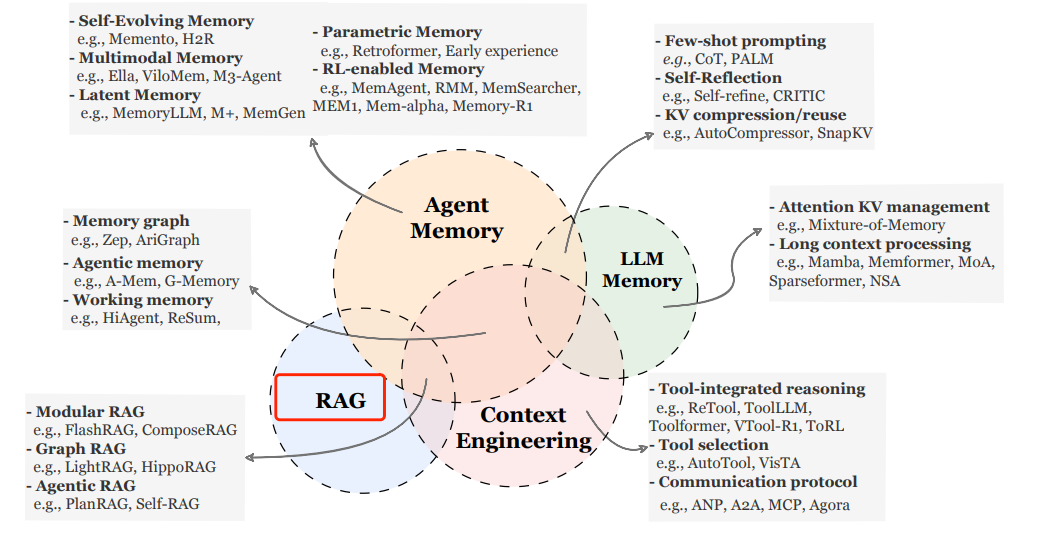

L'articolo distingue anche chiaramente tra Agent Memory e diversi concetti strettamente correlati ma essenzialmente diversi: LLM Memory, Retrieval Augmented Generation (RAG) e Context Engineering. Sebbene siano tutti correlati all'archiviazione e all'utilizzo delle informazioni, ci sono differenze fondamentali in termini di obiettivi, meccanismi e scenari applicativi.

Tecnologie di memoria dell'agente

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Memoria dell'agente vs. RAG

Tecnologie correlate a RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

Sia RAG che la memoria dell'agente implicano il recupero di informazioni da archivi esterni per migliorare le capacità del modello, ma i due differiscono essenzialmente nella filosofia di progettazione:

CaratteristicaRAGMemoria dell'agente Obiettivo principaleFornire supporto di conoscenza di base rilevante per la query correnteApprendimento continuo e comportamento adattivo nel tempo Fonte di informazioniSolitamente database di conoscenza statici e pre-costruitiInformazioni personalizzate generate dinamicamente dall'esperienza di interazione dell'agente stesso Attivazione del recuperoAttivato passivamente dalla query dell'utenteL'agente decide attivamente quando e cosa recuperare Aggiornamento delle informazioniIl database di conoscenza viene solitamente aggiornato offlineAggiornamento online, continuo e selettivo Ciclo di feedbackNessun meccanismo di feedback direttoForma un ciclo chiuso con l'interazione ambientale

Differenza chiave: RAG è uno strumento di espansione della conoscenza, mentre la memoria dell'agente è un meccanismo di apprendimento. RAG risponde a "Cosa so", la memoria dell'agente risponde a "Cosa ho imparato".

Memoria dell'agente vs. Memoria LLM

Tecnologie correlate alla memoria LLM:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensioneMemoria LLMMemoria dell'agente DefinizioneConoscenza interiorizzata nei parametri del modello o informazioni temporanee nella finestra di contestoSistema esterno che supporta l'interazione continua dell'agente con l'ambiente, l'apprendimento tra attività e l'adattamento a lungo termine Scala temporaleLimitata ai dati di pre-addestramento o al contesto della conversazione correnteSi estende su più attività, sessioni, supporta l'apprendimento permanente AggiornabilitàL'aggiornamento dei parametri è costoso, le informazioni di contesto sono volatiliSupporta aggiornamenti ed evoluzioni dinamici, efficienti e selettivi ProattivitàRisponde passivamente alle queryDecide attivamente quali informazioni archiviare, aggiornare e recuperare Accoppiamento con l'ambienteNessuna interazione diretta con l'ambienteIntegra profondamente il feedback ambientale, supporta l'apprendimento interattivo

Differenza chiave: la memoria LLM è essenzialmente statica (parametri fissi) o transitoria (contesto limitato), mentre la memoria dell'agente è dinamica, persistente e accoppiata all'ambiente.

Memoria dell'agente vs. Context Engineering

Tecnologie correlate al Context Engineering:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspettoContext EngineeringMemoria dell'agente FocusOttimizzazione dell'input per un singolo round o attività correntePersistenza e utilizzo delle informazioni su più round e attività Dimensione temporaleSessione correnteStoria a lungo termine Selezione delle informazioniRegole progettate manualmente o euristicheMeccanismi automatizzati di formazione, evoluzione e recupero Gestione dello statoNessuno stato persistenteMantiene esplicitamente uno stato di memoria evolvibile

Differenza chiave: il Context Engineering è una tecnica di ottimizzazione del prompt, la memoria dell'agente è un sistema di gestione dello stato. Il primo si concentra su "Cosa inserire ora", il secondo si concentra su "Cosa è stato ricordato in passato, come influenza il presente e il futuro".