107-გვერდიანი მიმოხილვა RAG-ზე, Agent-ზე და LLM-ის მეხსიერებაზე

დღეს გაგიზიარებთ ჩინეთის სახალხო რესპუბლიკის, ფუდანის, პეკინის უნივერსიტეტების და სხვა უნივერსიტეტების 107-გვერდიან ტექნიკურ მიმოხილვას სახელწოდებით „მეხსიერება AI აგენტების ეპოქაში: ფორმები, ფუნქციები და დინამიკა“.

პროექტის მისამართი: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

ნაშრომის მისამართი: https://arxiv.org/pdf/2512.13564

ბოლო ორი წლის განმავლობაში ჩვენ ვნახეთ დიდი ენობრივი მოდელების (LLM) საოცარი ევოლუცია AI ინტელექტუალურ აგენტებად (AI Agents). Deep Research-დან პროგრამული უზრუნველყოფის ინჟინერიამდე, სამეცნიერო აღმოჩენებიდან მრავალ აგენტურ თანამშრომლობამდე, ეს ინტელექტუალური აგენტები, რომლებიც დაფუძნებულია ფუნდამენტურ მოდელებზე, ხელს უწყობენ ხელოვნური ზოგადი ინტელექტის (AGI) საზღვრების გაფართოებას.

მაგრამ ჩნდება მთავარი კითხვა: როგორ შეუძლიათ აგენტებს ჰქონდეთ უწყვეტი სწავლისა და ადაპტაციის უნარი, როდესაც LLM-ის სტატიკური პარამეტრების სწრაფად განახლება შეუძლებელია?

პასუხი არის - მეხსიერება (Memory).

"მეხსიერება არის მთავარი უნარი, რომელიც სტატიკურ LLM-ს გარდაქმნის ინტელექტუალურ აგენტად, რომელსაც შეუძლია მუდმივად მოერგოს გარემოსთან ურთიერთქმედებით."

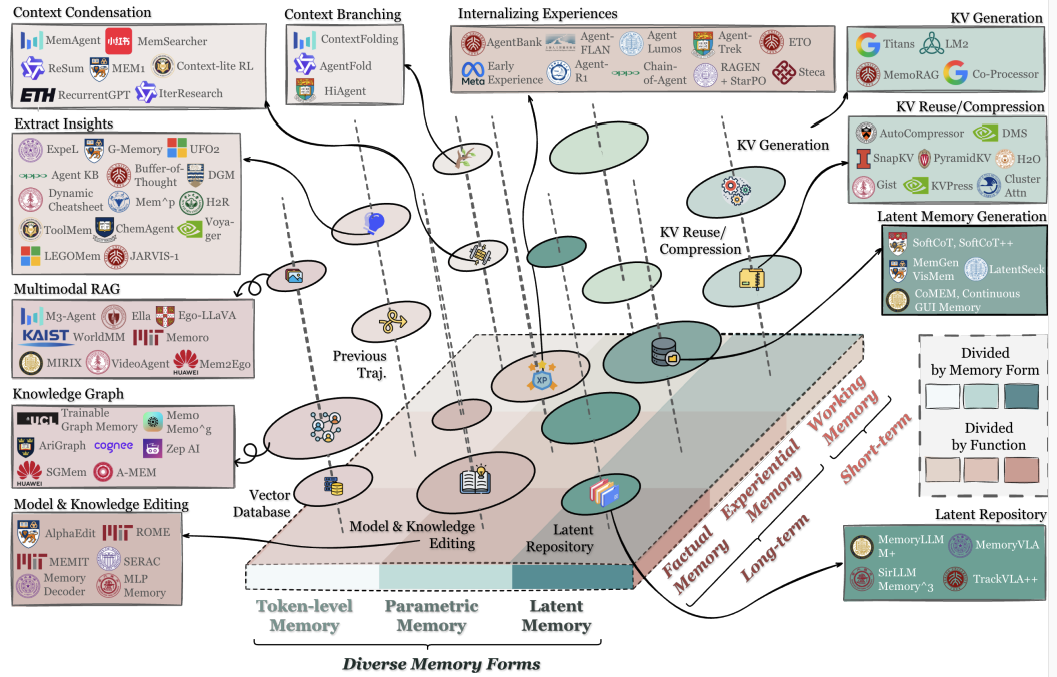

სურათი 1 გვიჩვენებს ნაშრომში შემოთავაზებულ ერთიან კლასიფიკაციის ჩარჩოს, რომელიც აწყობს აგენტის მეხსიერებას ფორმების (Forms), ფუნქციების (Functions), დინამიკის (Dynamics) სამ განზომილებაში და ასახავს წარმომადგენლობით სისტემებს ამ კლასიფიკაციის სისტემაში.

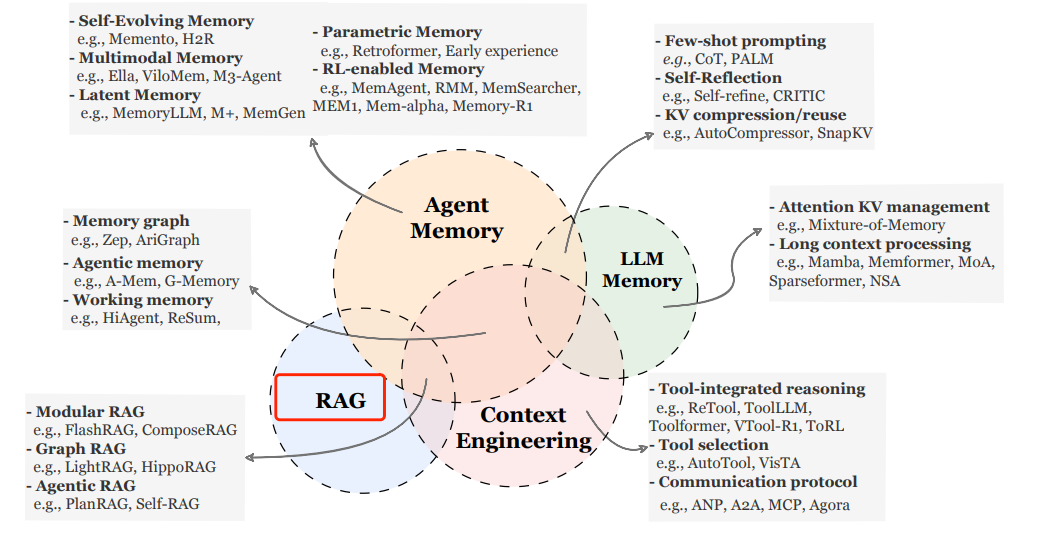

ნაშრომი ასევე ახდენს აგენტის მეხსიერების მკაფიო დიფერენცირებას რამდენიმე მჭიდროდ დაკავშირებულ, მაგრამ არსებითად განსხვავებულ კონცეფციასთან: LLM მეხსიერება, მოძიებით გაძლიერებული გენერაცია (RAG) და კონტექსტური ინჟინერია. მიუხედავად იმისა, რომ ისინი ყველა დაკავშირებულია ინფორმაციის შენახვასა და გამოყენებასთან, არსებობს მნიშვნელოვანი განსხვავებები მიზნებში, მექანიზმებსა და გამოყენების სცენარებში.

აგენტის მეხსიერების ტექნოლოგია

-

თვითგანვითარებადი მეხსიერება: Memento, H2R

-

მულტიმოდალური მეხსიერება: Ella, ViloMem, M3-Agent

-

ლატენტური მეხსიერება: MemoryLLM, M+, MemGen

-

პარამეტრული მეხსიერება: Retroformer, Early experience

-

RL-ჩართული მეხსიერება: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

აგენტის მეხსიერება vs. RAG

RAG-თან დაკავშირებული ტექნოლოგიები:

-

მოდულური RAG: FlashRAG, ComposeRAG

-

გრაფიკული RAG: LightRAG, HippoRAG

-

აგენტური RAG: PlanRAG, Self-RAG

RAG და აგენტის მეხსიერება ორივე მოიცავს ინფორმაციის მოძიებას გარე საცავიდან მოდელის შესაძლებლობების გასაძლიერებლად, მაგრამ არსებობს არსებითი განსხვავება დიზაინის ფილოსოფიაში:

მახასიათებელიRAGაგენტის მეხსიერება ძირითადი მიზანიუზრუნველყოს შესაბამისი ფონის ცოდნის მხარდაჭერა მიმდინარე მოთხოვნისთვისუწყვეტი სწავლა და ადაპტაციური ქცევა დროთა განმავლობაში ინფორმაციის წყაროსიხშირად სტატიკური, წინასწარ აგებული ცოდნის ბაზადინამიურად გენერირებული, პერსონალიზებული ინფორმაცია აგენტის საკუთარი ინტერაქციის გამოცდილებიდან მოძიების გამომწვევიმომხმარებლის მოთხოვნით პასიურად გამოწვეულიაგენტის მიერ აქტიურად გადაწყვეტილი როდის და რა მოიძიოს ინფორმაციის განახლებაცოდნის ბაზა ჩვეულებრივ განახლდება ოფლაინშიონლაინ, უწყვეტი, შერჩევითად განახლებული უკუკავშირის ციკლიუკუკავშირის პირდაპირი მექანიზმიარემოქმედებს გარემოსთან და ქმნის დახურულ მარყუჟს

მთავარი განსხვავება: RAG არის ცოდნის გაფართოების ინსტრუმენტი, ხოლო აგენტის მეხსიერება არის სწავლის მექანიზმი. RAG პასუხობს „რა ვიცი“, აგენტის მეხსიერება პასუხობს „რა ვისწავლე“.

აგენტის მეხსიერება vs. LLM მეხსიერება

LLM-ის მეხსიერებასთან დაკავშირებული ტექნოლოგიები:

-

ყურადღების KV მენეჯმენტი: Mixture-of-Memory

-

გრძელი კონტექსტის დამუშავება: Mamba, Memformer, MoA, Sparseformer, NSA

განზომილებაLLM მეხსიერებააგენტის მეხსიერება განმარტებამოდელის პარამეტრებში შინაგანი ცოდნა, ან დროებითი ინფორმაცია კონტექსტის ფანჯარაშიგარე სისტემა, რომელიც მხარს უჭერს აგენტის უწყვეტ ურთიერთქმედებას გარემოსთან, ამოცანებს შორის სწავლას და გრძელვადიან ადაპტაციას დროის მასშტაბიშეზღუდულია წინასწარი ვარჯიშის მონაცემებით ან მიმდინარე დიალოგის კონტექსტითმოიცავს მრავალ ამოცანას, სესიას და მხარს უჭერს უწყვეტ სწავლას განახლებადობაპარამეტრების განახლება ძვირია, კონტექსტური ინფორმაცია არასტაბილურიაუზრუნველყოფს ეფექტურ, შერჩევით დინამიურ განახლებას და ევოლუციას აქტიურობაპასიურად პასუხობს მოთხოვნებსაქტიურად წყვეტს რა ინფორმაციის შენახვა, განახლება და მოძიება კავშირი გარემოსთანგარემოსთან პირდაპირი ურთიერთქმედების გარეშეღრმად ინტეგრირებული გარემოს უკუკავშირი, მხარს უჭერს ინტერაქტიულ სწავლას

მთავარი განსხვავება: LLM მეხსიერება არსებითად სტატიკურია (პარამეტრები ფიქსირებულია) ან ხანმოკლეა (კონტექსტი შეზღუდულია), ხოლო აგენტის მეხსიერება არის დინამიური, მუდმივი, გარემოსთან დაკავშირებული.

აგენტის მეხსიერება vs. კონტექსტური ინჟინერია

კონტექსტური ინჟინერიასთან დაკავშირებული ტექნოლოგიები:

-

ინსტრუმენტებთან ინტეგრირებული მსჯელობა: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

ინსტრუმენტის შერჩევა: AutoTool, VisTA

-

კომუნიკაციის პროტოკოლი: ANP, A2A, MCP, Agora

ასპექტიკონტექსტური ინჟინერიააგენტის მეხსიერება ფოკუსირებაშეყვანის ოპტიმიზაცია ერთჯერადი ან მიმდინარე ამოცანისთვისინფორმაციის მუდმივი შენახვა და გამოყენება მრავალჯერადი, მრავალ ამოცანისთვის დროის განზომილებამიმდინარე სესიაგრძელვადიანი ისტორია ინფორმაციის შერჩევახელით შექმნილი ან ევრისტიკული წესებიავტომატური ფორმირების, ევოლუციის, მოძიების მექანიზმი მდგომარეობის მართვამდგრადი მდგომარეობის გარეშეაშკარად შენარჩუნებულია ევოლუციური მეხსიერების მდგომარეობა

მთავარი განსხვავება: კონტექსტური ინჟინერია არის მოთხოვნის ოპტიმიზაციის ტექნოლოგია, ხოლო აგენტის მეხსიერება არის მდგომარეობის მართვის სისტემა. პირველი ყურადღებას ამახვილებს „რა შევიყვანო ახლა“, მეორე ყურადღებას ამახვილებს „რა მახსოვს წარსულში და როგორ მოქმედებს ეს აწმყოსა და მომავალზე“.