107페이지 분량의 RAG 및 Agent&LLM 기억 종합 분석

오늘 공유할 내용은 인민대학교, 푸단대학교, 베이징대학교 등에서 작성한 107페이지 분량의 기술 종합 분석 보고서인 《AI 에이전트 시대의 기억: 형태, 기능 및 역학에 대한 조사》(Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics)입니다.

프로젝트 주소: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

논문 주소: https://arxiv.org/pdf/2512.13564

지난 2년 동안 우리는 대규모 언어 모델(LLM)이 AI 에이전트(AI Agents)로 놀랍게 진화하는 것을 목격했습니다. 딥 리서치에서 소프트웨어 엔지니어링, 과학적 발견에서 다중 에이전트 협업에 이르기까지, 이러한 기초 모델 기반 에이전트는 인공 일반 지능(AGI)의 경계를 넓히고 있습니다.

하지만 핵심적인 문제가 떠오릅니다. 정적인 LLM 매개변수는 빠르게 업데이트할 수 없는데, 어떻게 에이전트가 지속적인 학습 및 적응 능력을 갖추도록 할 수 있을까요?

그 해답은 바로 **기억(Memory)**입니다.

"기억은 정적인 LLM을 환경과의 상호 작용을 통해 지속적으로 적응할 수 있는 지능형 에이전트로 전환하는 핵심 능력입니다."

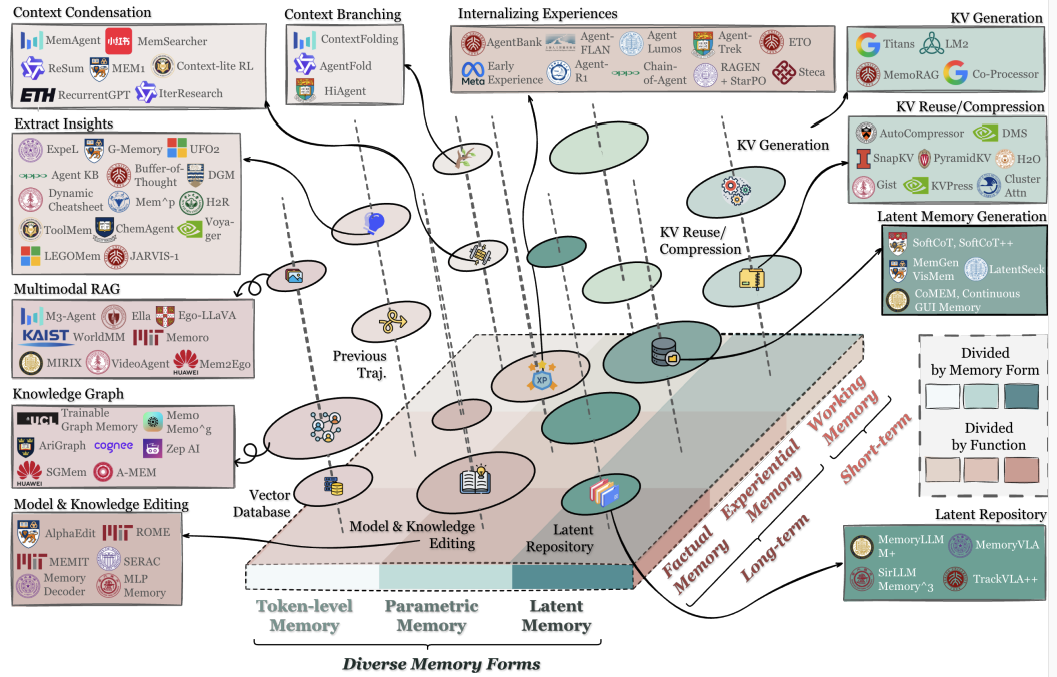

Figure 1은 논문에서 제시하는 통일된 분류 프레임워크를 보여줍니다. 에이전트 기억을 형태(Forms), 기능(Functions), **역학(Dynamics)**의 세 가지 차원으로 구성하고, 대표적인 시스템을 이 분류 체계에 매핑합니다.

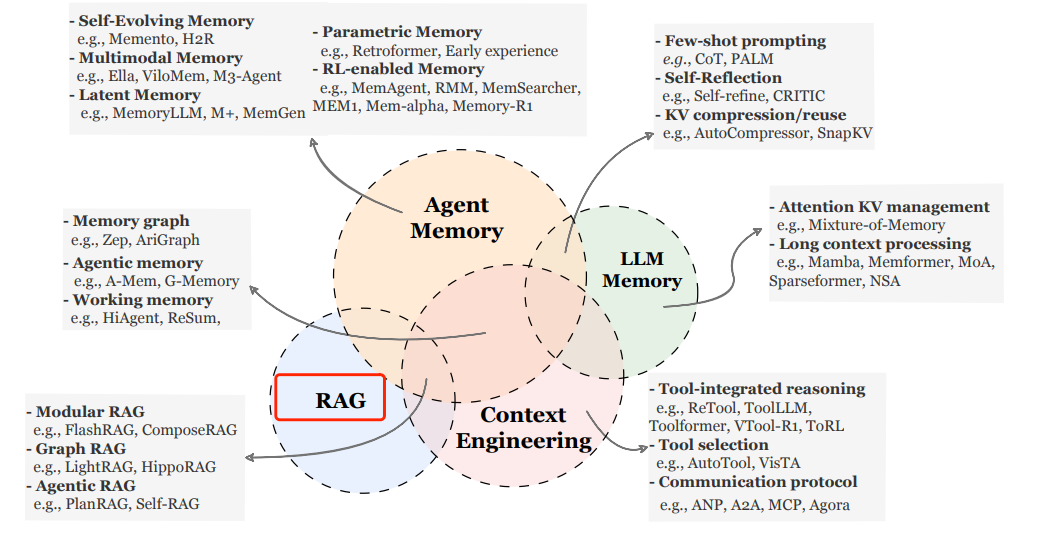

논문은 또한 Agent Memory와 밀접하게 관련되어 있지만 본질적으로 다른 개념인 LLM 기억, 검색 증강 생성(RAG) 및 컨텍스트 엔지니어링을 명확하게 구분합니다. 이들은 모두 정보의 저장 및 활용과 관련되어 있지만, 목표, 메커니즘 및 응용 시나리오에서 중요한 차이가 있습니다.

에이전트 기억 기술

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

에이전트 기억 vs. RAG

RAG 관련 기술:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG와 에이전트 기억은 모두 외부 저장소에서 정보를 검색하여 모델의 능력을 향상시키는 것과 관련되지만, 설계 철학에서 본질적인 차이가 있습니다.

특징RAG에이전트 기억 핵심 목표현재 쿼리에 관련된 배경 지식 지원시간 경과에 따른 지속적인 학습 및 적응 행동 정보 출처일반적으로 정적이고 미리 구축된 지식 베이스에이전트 자체의 상호 작용 경험에서 동적으로 생성된 개인화된 정보 검색 트리거사용자 쿼리에 의해 수동적으로 트리거됨에이전트가 언제, 무엇을 검색할지 능동적으로 결정 정보 업데이트지식 베이스는 일반적으로 오프라인으로 업데이트됨온라인, 지속적, 선택적으로 업데이트됨 피드백 루프직접적인 피드백 메커니즘 없음환경과의 상호 작용을 통해 폐쇄 루프 형성

핵심 차이점: RAG는 지식 확장 도구이고, 에이전트 기억은 학습 메커니즘입니다. RAG는 "나는 무엇을 알고 있는가"에 답하고, 에이전트 기억은 "나는 무엇을 배웠는가"에 답합니다.

에이전트 기억 vs. LLM 기억

LLM 기억 관련 기술:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

차원LLM 기억에이전트 기억 정의모델 매개변수 내에 내재화된 지식 또는 컨텍스트 창 내의 임시 정보에이전트가 환경과 지속적으로 상호 작용하고, 작업 간 학습하고, 장기적으로 적응할 수 있도록 지원하는 외부 시스템 시간 척도사전 훈련 데이터 또는 현재 대화 컨텍스트에 국한됨여러 작업, 세션을 거쳐 평생 학습 지원 업데이트 가능성매개변수 업데이트 비용이 많이 들고, 컨텍스트 정보가 손실되기 쉬움효율적이고 선택적인 동적 업데이트 및 진화 지원 능동성쿼리에 수동적으로 응답무엇을 저장, 업데이트, 검색할지 능동적으로 결정 환경과의 결합환경과 직접적인 상호 작용 없음환경 피드백과 깊이 통합되어 상호 작용 학습 지원

핵심 차이점: LLM 기억은 본질적으로 정적이거나(매개변수 고정) 일시적입니다(컨텍스트 제한). 반면 에이전트 기억은 동적이고, 지속적이며, 환경과 결합되어 있습니다.

에이전트 기억 vs. 컨텍스트 엔지니어링

컨텍스트 엔지니어링 관련 기술:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

측면컨텍스트 엔지니어링에이전트 기억 관심사단일 라운드 또는 현재 작업의 입력 최적화여러 라운드, 여러 작업에 걸쳐 정보의 지속적인 유지 및 활용 시간 차원현재 세션장기적인 기록 정보 선택인공 설계 또는 휴리스틱 규칙자동화된 형성, 진화, 검색 메커니즘 상태 관리지속적인 상태 없음진화 가능한 기억 상태를 명시적으로 유지 관리

핵심 차이점: 컨텍스트 엔지니어링은 프롬프트 최적화 기술이고, 에이전트 기억은 상태 관리 시스템입니다. 전자는 "현재 무엇을 입력할 것인가"에 초점을 맞추고, 후자는 "과거에 무엇을 기억했고, 그것이 현재와 미래에 어떻게 영향을 미치는가"에 초점을 맞춥니다.