Een 107 pagina's tellend overzicht van RAG en Agent & LLM-geheugen

Vandaag delen we een 107 pagina's tellend technisch overzicht van Renmin University, Fudan University, Peking University, enz., getiteld "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics".

Projectadres: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Papieradres: https://arxiv.org/pdf/2512.13564

De afgelopen twee jaar hebben we de verbazingwekkende evolutie van Large Language Models (LLM's) naar AI-agenten (AI Agents) gezien. Van Deep Research tot software engineering, van wetenschappelijke ontdekkingen tot multi-agent samenwerking, deze agenten op basis van fundamentele modellen verleggen de grenzen van Artificial General Intelligence (AGI).

Maar een kernvraag doemt op: Hoe kunnen we agenten continu laten leren en zich laten aanpassen als de statische LLM-parameters niet snel kunnen worden bijgewerkt?

Het antwoord is - Geheugen (Memory).

"Geheugen is de sleutel tot het transformeren van statische LLM's in intelligente agenten die zich continu kunnen aanpassen door interactie met de omgeving."

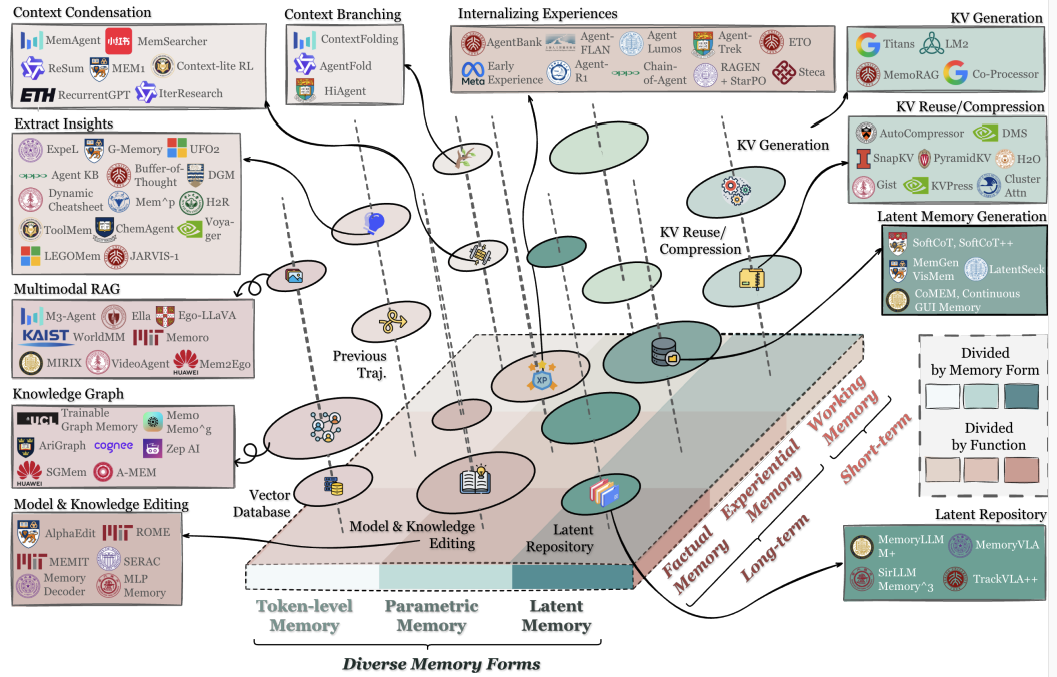

Figuur 1 toont het uniforme classificatiekader dat in het artikel wordt voorgesteld, waarbij het geheugen van de agent wordt georganiseerd volgens drie dimensies: Vormen (Forms), Functies (Functions) en Dynamiek (Dynamics), en representatieve systemen worden toegewezen aan dit classificatiesysteem.

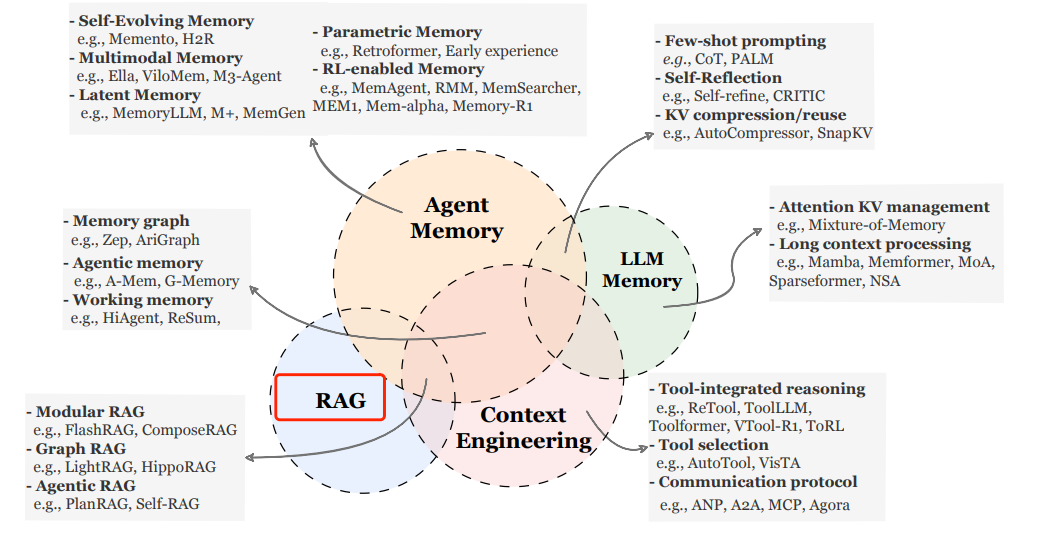

Het artikel maakt ook een duidelijk onderscheid tussen Agent Memory en verschillende nauw verwante maar fundamenteel verschillende concepten: LLM-geheugen, Retrieval-Augmented Generation (RAG) en Context Engineering. Hoewel ze allemaal verband houden met de opslag en het gebruik van informatie, zijn er belangrijke verschillen in doelen, mechanismen en toepassingsscenario's.

Agent Memory-technologie

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Agent Memory vs. RAG

RAG gerelateerde technologieën:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG en Agent Memory omvatten beide het ophalen van informatie uit externe opslag om de modelmogelijkheden te verbeteren, maar er is een fundamenteel verschil in ontwerpfilosofie:

KenmerkRAGAgent Memory KerndoelHet verstrekken van relevante achtergrondinformatie ter ondersteuning van de huidige queryContinu leren en adaptief gedrag in de loop van de tijd InformatiebronMeestal statische, vooraf gebouwde kennisbankDynamisch gegenereerde, gepersonaliseerde informatie uit de eigen interactieve ervaring van de agent OphaaltriggerPassief geactiveerd door een gebruikersqueryActief besloten door de agent wanneer en wat op te halen Informatie-updateKennisbank wordt meestal offline bijgewerktOnline, continu en selectief bijgewerkt FeedbacklusGeen direct feedbackmechanismeGesloten lus gevormd door interactie met de omgeving

Belangrijkste verschil: RAG is een tool voor kennisuitbreiding, terwijl Agent Memory een leermechanisme is. RAG beantwoordt "Wat weet ik", Agent Memory beantwoordt "Wat heb ik geleerd".

Agent Memory vs. LLM-geheugen

LLM-geheugen gerelateerde technologieën:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensieLLM-geheugenAgent Memory DefinitieKennis die is geïnternaliseerd in modelparameters, of tijdelijke informatie in het contextvensterExtern systeem dat continue interactie van de agent met de omgeving, leren tussen taken en aanpassing op lange termijn ondersteunt TijdschaalBeperkt tot pre-trainingsgegevens of de huidige dialoogcontextOmvat meerdere taken, sessies en ondersteunt levenslang leren UpdatebaarheidParameterupdates zijn duur, contextinformatie is vluchtigOndersteunt efficiënte, selectieve dynamische updates en evolutie ProactiviteitReageert passief op vragenBeslist actief welke informatie op te slaan, bij te werken en op te halen Koppeling met de omgevingGeen directe interactie met de omgevingDiep geïntegreerde omgevingsfeedback, ondersteunt interactief leren

Belangrijkste verschil: LLM-geheugen is in wezen statisch (parameters vast) of kortstondig (context beperkt), terwijl Agent Memory dynamisch, persistent en omgevingsgekoppeld is.

Agent Memory vs. Context Engineering

Context Engineering gerelateerde technologieën:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspectContext EngineeringAgent Memory FocusInputoptimalisatie voor een enkele ronde of de huidige taakPersistentie en gebruik van informatie over meerdere rondes en taken TijdsdimensieHuidige sessieLange termijn geschiedenis Informatie selectieHandmatig ontworpen of heuristische regelsGeautomatiseerde mechanismen voor vorming, evolutie en ophalen StatusbeheerGeen persistente statusExpliciet onderhoud van een evolueerbare geheugenstatus

Belangrijkste verschil: Context Engineering is een promptoptimalisatietechniek, Agent Memory is een statusbeheersysteem. De eerste richt zich op "Wat nu invoeren", de laatste richt zich op "Wat is er in het verleden onthouden, hoe beïnvloedt dit het heden en de toekomst".