Obszerny przegląd RAG i pamięci Agent&LLM na 107 stronach

Dziś dzielę się 107-stronicowym przeglądem technicznym autorstwa Renmin University of China, Fudan University, Peking University i innych, zatytułowanym „Pamięć w erze agentów AI: przegląd form, funkcji i dynamiki”.

Adres projektu: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Adres artykułu: https://arxiv.org/pdf/2512.13564

W ciągu ostatnich dwóch lat byliśmy świadkami niesamowitej ewolucji dużych modeli językowych (LLM) w kierunku agentów AI (AI Agents). Od Deep Research po inżynierię oprogramowania, od odkryć naukowych po współpracę wielu agentów, ci agenci oparci na modelach podstawowych przesuwają granice sztucznej inteligencji ogólnej (AGI).

Ale pojawia się kluczowe pytanie: Jak umożliwić agentom ciągłe uczenie się i adaptację, skoro statyczne parametry LLM nie mogą być szybko aktualizowane?

Odpowiedź brzmi – pamięć (Memory).

„Pamięć jest kluczową zdolnością, która przekształca statyczne LLM w inteligentnych agentów zdolnych do ciągłej adaptacji poprzez interakcję ze środowiskiem.”

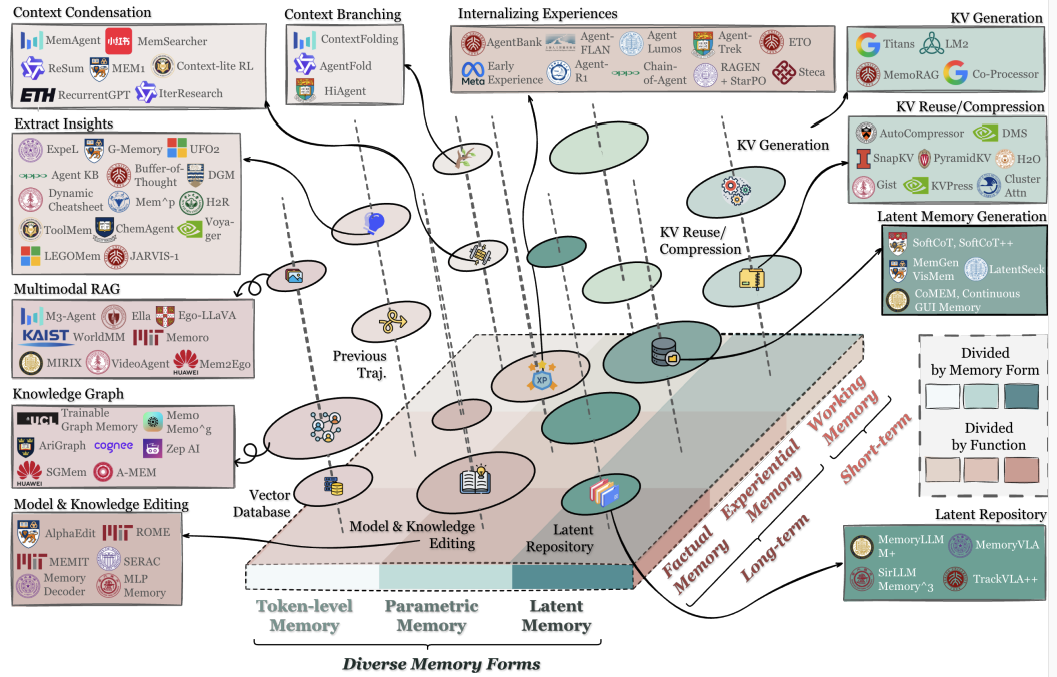

Rysunek 1 przedstawia jednolity framework klasyfikacji zaproponowany w artykule, który organizuje pamięć agenta według trzech wymiarów: formy (Forms), funkcje (Functions) i dynamika (Dynamics), i mapuje reprezentatywne systemy do tego systemu klasyfikacji.

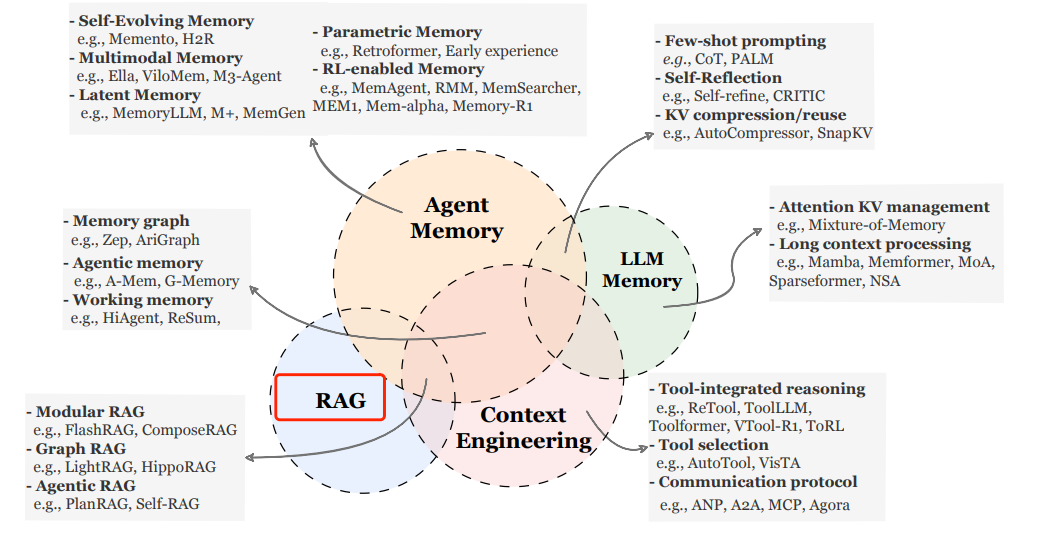

Artykuł wyraźnie rozróżnia również pamięć agenta od kilku ściśle powiązanych, ale zasadniczo różnych koncepcji: pamięć LLM, generowanie rozszerzone o wyszukiwanie (RAG) i inżynieria kontekstu. Chociaż wszystkie są związane z przechowywaniem i wykorzystywaniem informacji, istnieją kluczowe różnice w celach, mechanizmach i scenariuszach zastosowań.

Technologie pamięci agenta

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Pamięć agenta vs. RAG

Technologie związane z RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

Zarówno RAG, jak i pamięć agenta obejmują pobieranie informacji z zewnętrznej pamięci w celu zwiększenia możliwości modelu, ale istnieją zasadnicze różnice w filozofii projektowania:

CechyRAGPamięć agenta Cel głównyZapewnienie odpowiedniej wiedzy kontekstowej dla bieżącego zapytaniaCiągłe uczenie się i adaptacyjne zachowanie w czasie Źródło informacjiZazwyczaj statyczna, wstępnie zbudowana baza wiedzyDynamicznie generowane, spersonalizowane informacje z własnych doświadczeń interakcji agenta Wyzwalanie wyszukiwaniaPasywnie wyzwalane przez zapytanie użytkownikaAktywnie decydowane przez agenta, kiedy i co wyszukiwać Aktualizacja informacjiBaza wiedzy jest zwykle aktualizowana w trybie offlineAktualizowane online, w sposób ciągły i selektywny Pętla sprzężenia zwrotnegoBrak bezpośredniego mechanizmu sprzężenia zwrotnegoTworzy zamkniętą pętlę z interakcją ze środowiskiem

Kluczowa różnica: RAG to narzędzie do rozszerzania wiedzy, a pamięć agenta to mechanizm uczenia się. RAG odpowiada na pytanie „Co wiem”, a pamięć agenta odpowiada na pytanie „Czego się nauczyłem”.

Pamięć agenta vs. Pamięć LLM

Technologie związane z pamięcią LLM:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

WymiarPamięć LLMPamięć agenta DefinicjaWiedza zinternalizowana w parametrach modelu lub tymczasowe informacje w oknie kontekstowymZewnętrzny system wspierający ciągłą interakcję agenta ze środowiskiem, uczenie się między zadaniami i długoterminową adaptację Skala czasowaOgraniczona do danych treningowych lub bieżącego kontekstu konwersacjiObejmuje wiele zadań, sesji i wspiera uczenie się przez całe życie AktualizowalnośćAktualizacja parametrów jest kosztowna, informacje kontekstowe są ulotneWspiera wydajną, selektywną dynamiczną aktualizację i ewolucję AktywnośćPasywnie odpowiada na zapytaniaAktywnie decyduje, jakie informacje przechowywać, aktualizować i wyszukiwać Powiązanie ze środowiskiemBrak bezpośredniej interakcji ze środowiskiemGłęboko zintegrowane sprzężenie zwrotne ze środowiska, wspiera interaktywne uczenie się

Kluczowa różnica: Pamięć LLM jest zasadniczo statyczna (parametry są stałe) lub krótkotrwała (kontekst jest ograniczony), podczas gdy pamięć agenta jest dynamiczna, trwała i powiązana ze środowiskiem.

Pamięć agenta vs. Inżynieria kontekstu

Technologie związane z inżynierią kontekstu:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspektInżynieria kontekstuPamięć agenta KoncentracjaOptymalizacja wejścia dla pojedynczej rundy lub bieżącego zadaniaUtrwalanie i wykorzystywanie informacji w wielu rundach i zadaniach Wymiar czasuBieżąca sesjaDługa historia Wybór informacjiRęcznie zaprojektowane lub heurystyczne regułyAutomatyczne mechanizmy formowania, ewolucji i wyszukiwania Zarządzanie stanemBrak trwałego stanuJawne utrzymywanie ewoluującego stanu pamięci

Kluczowa różnica: Inżynieria kontekstu to technika optymalizacji podpowiedzi, a pamięć agenta to system zarządzania stanem. Pierwsza koncentruje się na „Co wprowadzić teraz”, a druga na „Co zapamiętałem w przeszłości i jak to wpływa na teraźniejszość i przyszłość”.