Uma Visão Geral de 107 Páginas sobre RAG e Memória de Agentes & LLM

Hoje, compartilhamos uma visão geral técnica de 107 páginas da Universidade do Povo, Fudan, Universidade de Pequim, etc., intitulada "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics" (Memória na Era dos Agentes de IA: Uma Pesquisa sobre Formas, Funções e Dinâmicas).

Endereço do projeto: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Endereço do artigo: https://arxiv.org/pdf/2512.13564

Nos últimos dois anos, testemunhamos a incrível evolução dos modelos de linguagem grandes (LLM) para agentes de IA (AI Agents). Da Deep Research à engenharia de software, da descoberta científica à colaboração multiagente, esses agentes baseados em modelos fundamentais estão impulsionando as fronteiras da inteligência geral artificial (AGI).

Mas uma questão central surge: Como permitir que os agentes tenham capacidade de aprendizado e adaptação contínuos quando os parâmetros estáticos do LLM não podem ser atualizados rapidamente?

A resposta é - Memória.

"A memória é a capacidade chave para transformar LLMs estáticos em agentes inteligentes capazes de se adaptar continuamente através da interação com o ambiente."

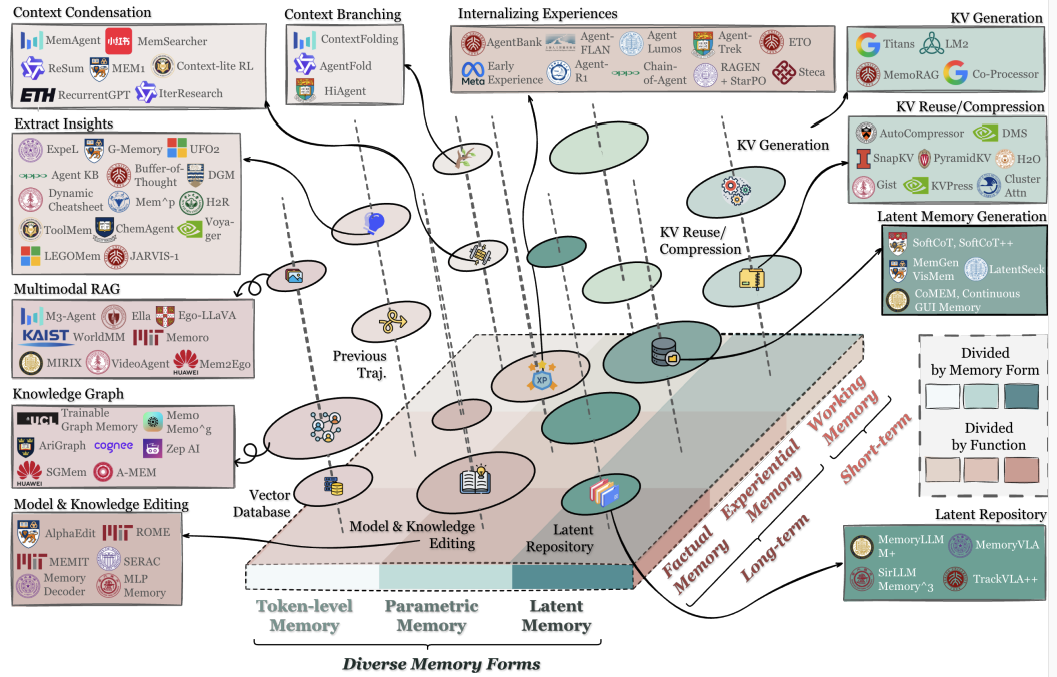

A Figura 1 mostra a estrutura de classificação unificada proposta no artigo, que organiza a memória do agente em três dimensões: Formas, Funções e Dinâmicas, e mapeia sistemas representativos para este sistema de classificação.

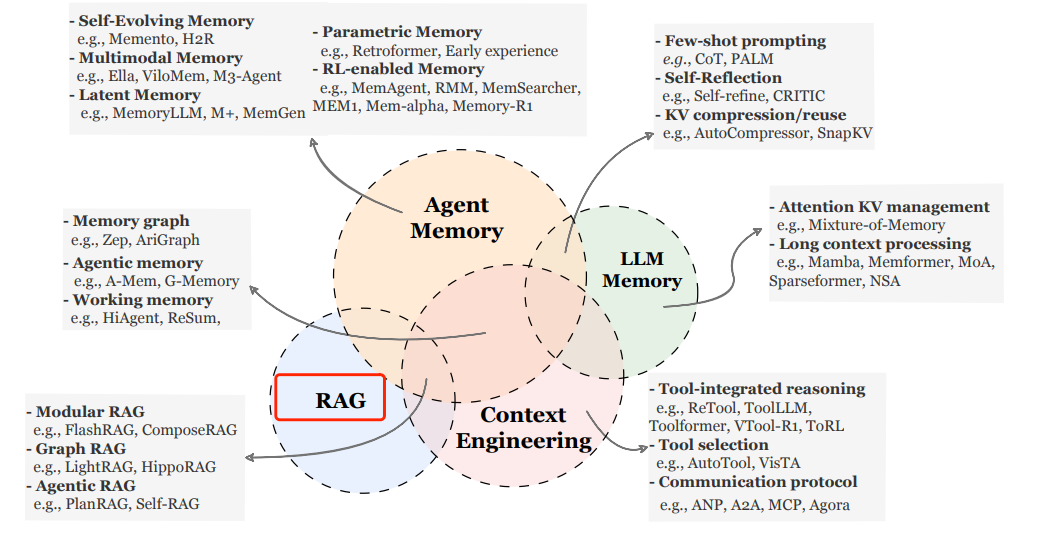

O artigo também distingue claramente a Memória do Agente de vários conceitos intimamente relacionados, mas essencialmente diferentes: Memória LLM, Geração Aumentada por Recuperação (RAG) e Engenharia de Contexto. Embora todos estejam relacionados ao armazenamento e utilização de informações, existem diferenças importantes em termos de objetivos, mecanismos e cenários de aplicação.

Tecnologias de Memória de Agentes

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Memória de Agentes vs. RAG

Tecnologias relacionadas a RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG e memória de agente envolvem a recuperação de informações de armazenamento externo para aprimorar os recursos do modelo, mas existem diferenças essenciais na filosofia de design:

CaracterísticaRAGMemória do Agente Objetivo PrincipalFornecer suporte de conhecimento de fundo relevante para a consulta atualAprendizado contínuo e comportamento adaptativo ao longo do tempo Fonte de InformaçãoGeralmente bases de conhecimento estáticas e pré-construídasInformações personalizadas geradas dinamicamente a partir da própria experiência de interação do agente Acionamento de RecuperaçãoAcionado passivamente por consultas do usuárioO agente decide ativamente quando e o que recuperar Atualização de InformaçõesA base de conhecimento é geralmente atualizada offlineAtualização online, contínua e seletiva Loop de FeedbackSem mecanismo de feedback diretoForma um loop fechado com a interação ambiental

Diferença chave: RAG é uma ferramenta de expansão de conhecimento, enquanto a memória do agente é um mecanismo de aprendizado. RAG responde "O que eu sei", a memória do agente responde "O que eu aprendi".

Memória de Agentes vs. Memória LLM

Tecnologias relacionadas à memória LLM:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensãoMemória LLMMemória do Agente DefiniçãoConhecimento internalizado nos parâmetros do modelo ou informações temporárias na janela de contextoSistema externo que suporta a interação contínua do agente com o ambiente, aprendizado entre tarefas e adaptação de longo prazo Escala de TempoLimitado a dados de pré-treinamento ou contexto de diálogo atualAbrange múltiplas tarefas, sessões e suporta aprendizado ao longo da vida AtualizabilidadeA atualização de parâmetros é cara e as informações de contexto são voláteisSuporta atualização e evolução dinâmica, eficiente e seletiva AtividadeResponde passivamente às consultasDecide ativamente quais informações armazenar, atualizar e recuperar Acoplamento com o AmbienteSem interação direta com o ambienteProfundamente integrado ao feedback do ambiente, suportando o aprendizado interativo

Diferença chave: A memória LLM é essencialmente estática (parâmetros fixos) ou transitória (contexto limitado), enquanto a memória do agente é dinâmica, persistente e acoplada ao ambiente.

Memória de Agentes vs. Engenharia de Contexto

Tecnologias relacionadas à engenharia de contexto:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspectoEngenharia de ContextoMemória do Agente FocoOtimização de entrada para uma única rodada ou tarefa atualPersistência e utilização de informações em múltiplas rodadas e tarefas Dimensão TemporalSessão atualHistórico de longo prazo Seleção de InformaçõesRegras projetadas manualmente ou heurísticasMecanismo automatizado de formação, evolução e recuperação Gerenciamento de EstadoSem estado persistenteMantém explicitamente um estado de memória evoluível

Diferença chave: A engenharia de contexto é uma técnica de otimização de prompt, enquanto a memória do agente é um sistema de gerenciamento de estado. O primeiro se concentra em "O que inserir agora", o último se concentra em "O que foi lembrado no passado e como isso afeta o presente e o futuro".