O analiză de 107 pagini despre RAG și Agent&LLM Memory

Astăzi împărtășesc o analiză tehnică de 107 pagini de la Renmin University, Fudan University, Peking University etc., intitulată "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics" (Memoria în era agenților AI: O analiză a formelor, funcțiilor și dinamicii).

Adresa proiectului: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Adresa lucrării: https://arxiv.org/pdf/2512.13564

În ultimii doi ani, am asistat la evoluția uimitoare a modelelor lingvistice mari (LLM) în agenți inteligenți AI (AI Agents). De la Deep Research la ingineria software, de la descoperiri științifice la colaborarea multi-agent, acești agenți bazați pe modele fundamentale împing limitele inteligenței artificiale generale (AGI).

Dar o întrebare centrală apare: Parametrii statici ai LLM nu pot fi actualizați rapid, cum pot fi echipați agenții cu capacități de învățare continuă și adaptare?

Răspunsul este – Memoria (Memory).

"Memoria este capacitatea cheie de a transforma LLM-urile statice în agenți inteligenți capabili să se adapteze continuu prin interacțiunea cu mediul."

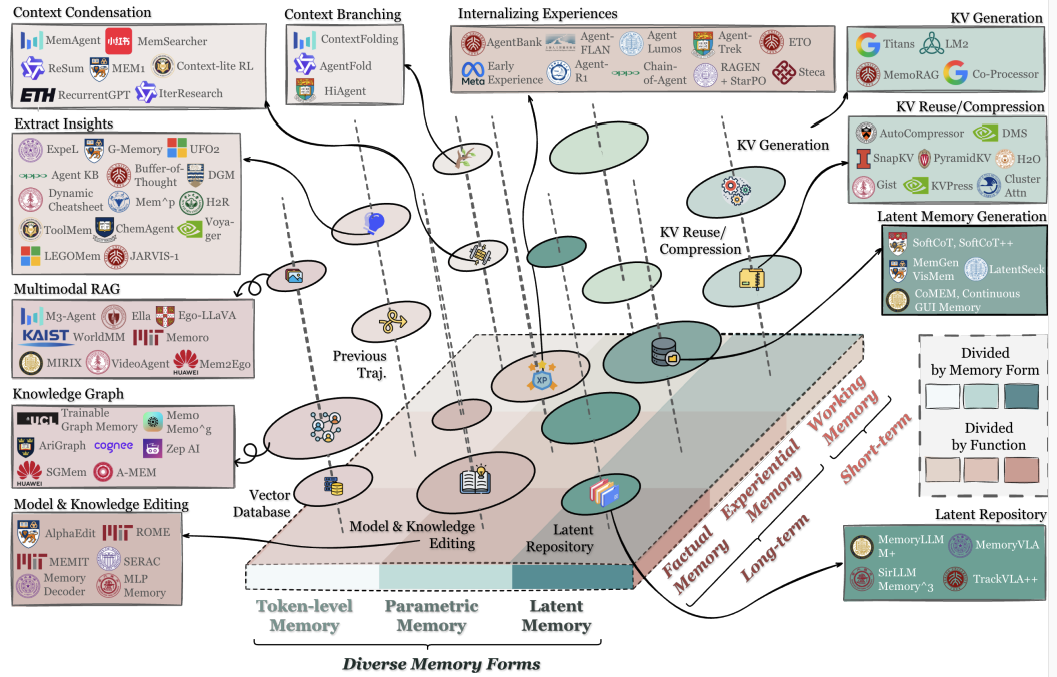

Figura 1 prezintă cadrul de clasificare unificat propus de lucrare, care organizează memoria agentului în funcție de trei dimensiuni: Forme (Forms), Funcții (Functions), Dinamica (Dynamics) și mapează sistemele reprezentative în acest sistem de clasificare.

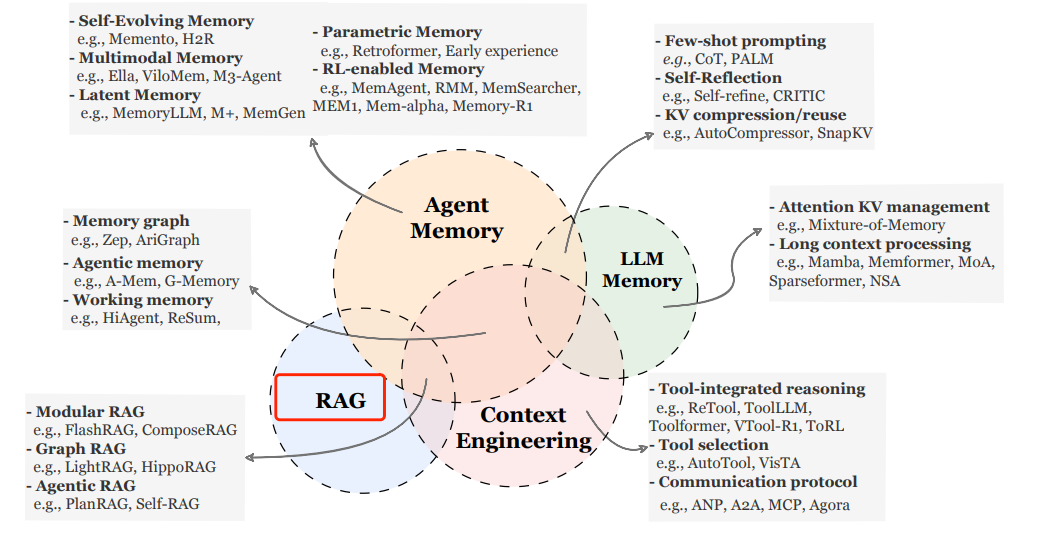

Lucrarea distinge, de asemenea, în mod clar Agent Memory de mai multe concepte strâns legate, dar fundamental diferite: LLM Memory, Retrieval Augmented Generation (RAG) și Context Engineering. Deși toate sunt legate de stocarea și utilizarea informațiilor, există diferențe cheie în ceea ce privește obiectivele, mecanismele și scenariile de aplicare.

Tehnologii de memorie ale agentului inteligent

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Memoria agentului inteligent vs. RAG

Tehnologii conexe RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG și memoria agentului inteligent implică ambele recuperarea informațiilor din stocarea externă pentru a spori capacitățile modelului, dar există o diferență fundamentală în filosofia de proiectare dintre cele două:

CaracteristiciRAGMemoria agentului inteligent Obiectivul principalOferă suport de cunoștințe de fundal relevant pentru interogarea curentăÎnvățare continuă și comportament adaptiv în timp Sursa informațiilorDe obicei, baze de cunoștințe statice, pre-construiteInformații personalizate generate dinamic, din experiența de interacțiune a agentului însuși Declanșarea recuperăriiDeclanșată pasiv de interogarea utilizatoruluiAgentul decide în mod activ când și ce să recupereze Actualizarea informațiilorBaza de cunoștințe este de obicei actualizată offlineActualizare online, continuă, selectivă Buclă de feedbackNu există un mecanism direct de feedbackFormează o buclă închisă cu interacțiunea cu mediul

Diferența cheie: RAG este un instrument de extindere a cunoștințelor, în timp ce memoria agentului inteligent este un mecanism de învățare. RAG răspunde la "Ce știu", iar memoria agentului inteligent răspunde la "Ce am învățat".

Memoria agentului inteligent vs. Memoria LLM

Tehnologii conexe LLM Memory:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensiuneLLM MemoryMemoria agentului inteligent DefinițieCunoștințe internalizate în parametrii modelului sau informații temporare în fereastra de contextSistem extern care sprijină interacțiunea continuă a agentului cu mediul, învățarea între sarcini și adaptarea pe termen lung Scară de timpLimitată la datele de pre-antrenament sau la contextul conversației curenteAcoperă mai multe sarcini, sesiuni, sprijină învățarea pe tot parcursul vieții ActualizabilitateCosturi ridicate de actualizare a parametrilor, informațiile de context sunt volatileSprijină actualizarea și evoluția dinamică, selectivă și eficientă ProactivitateRăspunde pasiv la interogăriDecide în mod activ ce informații să stocheze, să actualizeze și să recupereze Cuplare cu mediulNu există interacțiune directă cu mediulIntegrare profundă a feedback-ului mediului, sprijină învățarea interactivă

Diferența cheie: LLM Memory este în esență statică (parametri fixați) sau tranzitorie (context limitat), în timp ce memoria agentului inteligent este dinamică, persistentă, cuplată cu mediul.

Memoria agentului inteligent vs. Ingineria contextului

Tehnologii conexe ingineriei contextului:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspectIngineria contextuluiMemoria agentului inteligent FocalizareOptimizarea intrării pentru o singură rundă sau sarcina curentăPersistența și utilizarea informațiilor pe mai multe runde, sarcini Dimensiune temporalăSesiunea curentăIstoric pe termen lung Selecția informațiilorReguli proiectate manual sau euristiceMecanisme automate de formare, evoluție, recuperare Managementul stăriiNu există o stare persistentăMenține în mod explicit o stare de memorie evolutivă

Diferența cheie: Ingineria contextului este o tehnologie de optimizare a prompturilor, iar memoria agentului inteligent este un sistem de gestionare a stărilor. Prima se concentrează pe "Ce introducem acum", iar cea din urmă se concentrează pe "Ce ne-am amintit în trecut și cum afectează prezentul și viitorul".