Обзор RAG и Agent&LLM памяти на 107 страницах

Сегодня я поделюсь 107-страничным техническим обзором «Память в эпоху AI агентов: Обзор форм, функций и динамики» от Жэньминьского университета Китая, Фуданьского университета, Пекинского университета и других.

Адрес проекта: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Адрес статьи: https://arxiv.org/pdf/2512.13564

За последние два года мы стали свидетелями поразительной эволюции больших языковых моделей (LLM) в AI агентов (AI Agents). От Deep Research до разработки программного обеспечения, от научных открытий до многоагентного сотрудничества, эти агенты, основанные на базовых моделях, расширяют границы искусственного общего интеллекта (AGI).

Но возникает ключевой вопрос: как сделать так, чтобы агенты могли непрерывно учиться и адаптироваться, если статические параметры LLM не могут быть быстро обновлены?

Ответ — память (Memory).

"Память — это ключевая способность, которая превращает статические LLM в агентов, способных непрерывно адаптироваться посредством взаимодействия с окружающей средой."

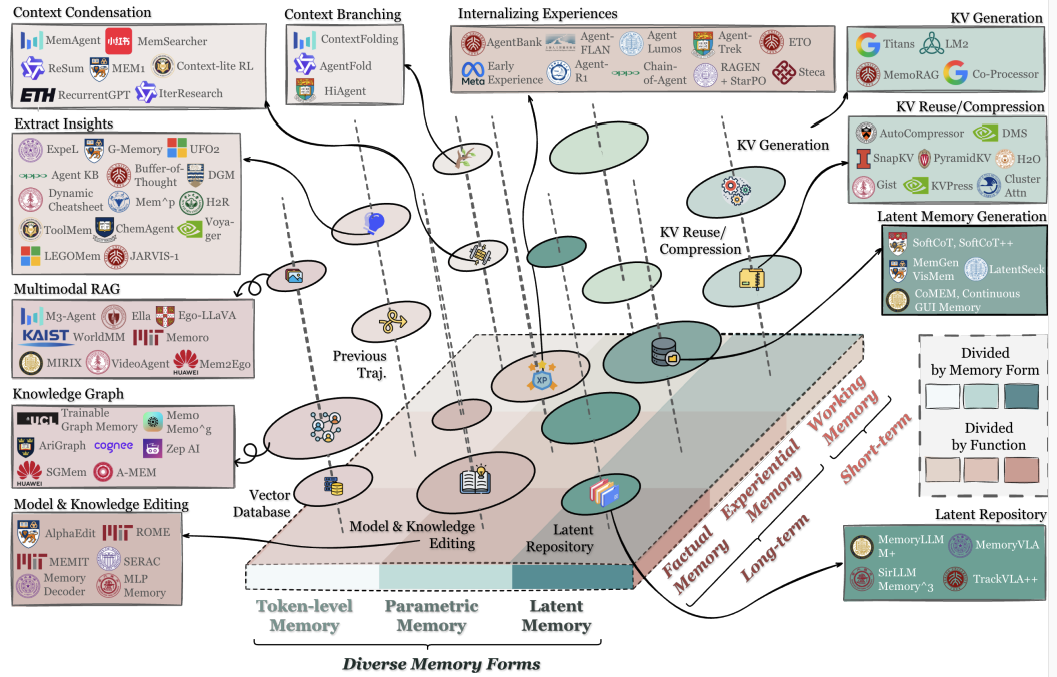

Рисунок 1 демонстрирует единую структуру классификации, предложенную в статье, которая организует память агентов по трем измерениям: формы (Forms), функции (Functions), динамика (Dynamics), и сопоставляет репрезентативные системы с этой системой классификации.

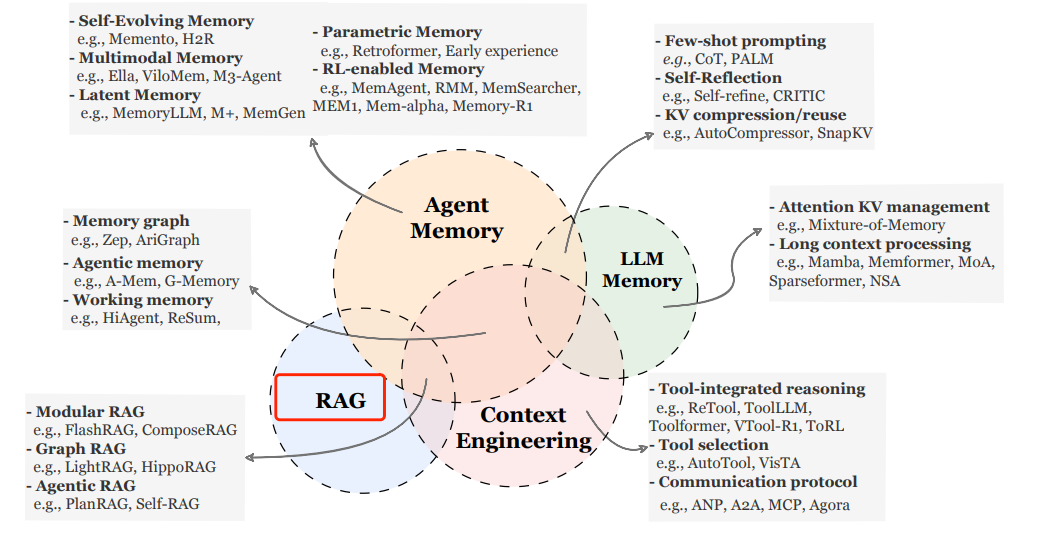

В статье также четко разграничиваются Agent Memory и несколько тесно связанных, но существенно различных концепций: LLM память, генерация, дополненная поиском (RAG) и контекстная инженерия. Хотя все они связаны с хранением и использованием информации, существуют ключевые различия в целях, механизмах и сценариях применения.

Технологии памяти агентов

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Память агентов vs. RAG

Технологии, связанные с RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG и память агентов включают извлечение информации из внешнего хранилища для расширения возможностей модели, но между ними существуют существенные различия в философии проектирования:

| Характеристика | RAG | Память агентов |

|---|---|---|

| Основная цель | Предоставление релевантной справочной информации для текущего запроса | Непрерывное обучение и адаптивное поведение во времени |

| Источник информации | Обычно статические, предварительно созданные базы знаний | Динамически генерируемая, персонализированная информация из собственного опыта взаимодействия агента |

| Триггер поиска | Пассивно запускается запросом пользователя | Активно решается агентом, когда и что искать |

| Обновление информации | База знаний обычно обновляется в автономном режиме | Обновляется онлайн, непрерывно и выборочно |

| Цикл обратной связи | Нет прямого механизма обратной связи | Формирует замкнутый цикл с взаимодействием с окружающей средой |

Ключевое различие: RAG — это инструмент расширения знаний, а память агентов — это механизм обучения. RAG отвечает на вопрос «Что я знаю?», а память агентов отвечает на вопрос «Что я узнал?».

Память агентов vs. LLM память

Технологии, связанные с LLM памятью:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

| Измерение | LLM память | Память агентов |

|---|---|---|

| Определение | Знания, интернализованные в параметрах модели, или временная информация в контекстном окне | Внешняя система, поддерживающая непрерывное взаимодействие агента с окружающей средой, обучение между задачами и долгосрочную адаптацию |

| Временной масштаб | Ограничен данными предварительного обучения или текущим контекстом диалога | Охватывает несколько задач, сеансов, поддерживает обучение на протяжении всей жизни |

| Возможность обновления | Обновление параметров дорогостоящее, контекстная информация легко теряется | Поддерживает эффективное, выборочное динамическое обновление и эволюцию |

| Активность | Пассивно отвечает на запросы | Активно решает, какую информацию хранить, обновлять и извлекать |

| Связь с окружающей средой | Нет прямого взаимодействия с окружающей средой | Глубоко интегрирована с обратной связью от окружающей среды, поддерживает интерактивное обучение |

Ключевое различие: LLM память по сути статична (параметры фиксированы) или недолговечна (контекст ограничен), а память агентов динамична, постоянна и связана с окружающей средой.

Память агентов vs. Контекстная инженерия

Технологии, связанные с контекстной инженерией:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

| Аспект | Контекстная инженерия | Память агентов |

|---|---|---|

| Внимание | Оптимизация ввода для одного раунда или текущей задачи | Постоянство и использование информации в нескольких раундах и задачах |

| Временное измерение | Текущий сеанс | Длительная история |

| Выбор информации | Искусственный дизайн или эвристические правила | Автоматизированные механизмы формирования, эволюции и извлечения |

| Управление состоянием | Нет постоянного состояния | Явно поддерживает эволюционирующее состояние памяти |

Ключевое различие: Контекстная инженерия — это техника оптимизации подсказок, а память агентов — это система управления состоянием. Первая фокусируется на «Что вводить сейчас», а вторая — на «Что запомнилось в прошлом и как это влияет на настоящее и будущее».