En 107-sidig översikt över RAG och Agent&LLM-minne

Idag delar jag en 107-sidig teknisk översikt från Renmin University of China, Fudan University, Peking University m.fl., "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics".

Projektadress: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Paper-adress: https://arxiv.org/pdf/2512.13564

Under de senaste två åren har vi bevittnat den fantastiska utvecklingen av stora språkmodeller (LLM) till AI-agenter (AI Agents). Från Deep Research till mjukvaruteknik, från vetenskapliga upptäckter till samarbete mellan flera agenter, driver dessa agenter baserade på grundläggande modeller gränserna för artificiell allmän intelligens (AGI).

Men en central fråga dyker upp: Hur kan agenter ha kontinuerlig inlärnings- och anpassningsförmåga när statiska LLM-parametrar inte kan uppdateras snabbt?

Svaret är – minne (Memory).

"Minne är den viktigaste förmågan att omvandla statiska LLM till agenter som kontinuerligt kan anpassa sig genom interaktion med miljön."

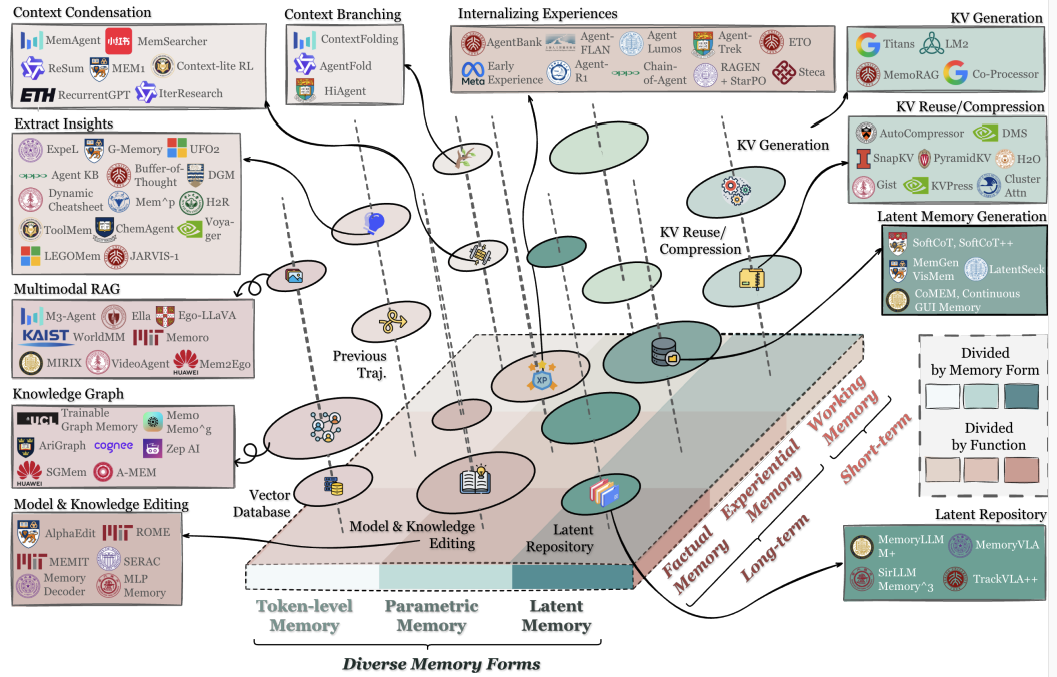

Figur 1 visar det enhetliga klassificeringsramverk som presenteras i artikeln, som organiserar agentminne efter tre dimensioner: Form (Forms), Funktioner (Functions), Dynamik (Dynamics), och kartlägger representativa system till detta klassificeringssystem.

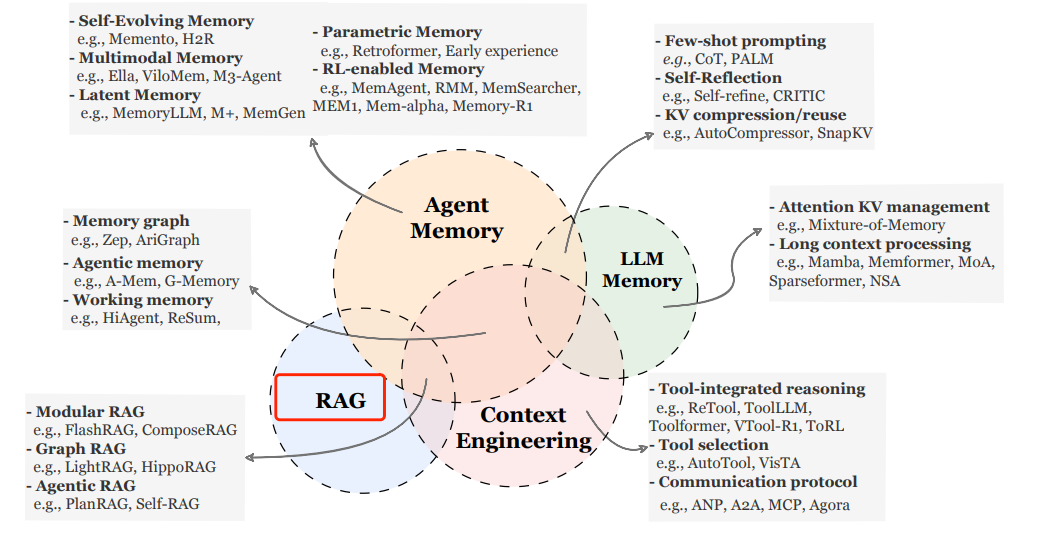

Artikeln gör också en tydlig åtskillnad mellan Agent Memory och flera nära besläktade men väsentligen olika begrepp: LLM-minne, Retrieval Augmented Generation (RAG) och Context Engineering. Även om de alla är relaterade till lagring och användning av information, finns det viktiga skillnader i mål, mekanismer och applikationsscenarier.

Agentminnesteknik

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Agentminne vs. RAG

RAG-relaterad teknik:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG och agentminne involverar båda att hämta information från extern lagring för att förbättra modellens kapacitet, men det finns en väsentlig skillnad i designfilosofi mellan de två:

FunktionRAGAgentminne KärnmålAtt ge relevant bakgrundskunskap för den aktuella fråganStödja kontinuerligt lärande och adaptivt beteende över tid InformationskällaVanligtvis statiska, förkonstruerade kunskapsbaserDynamiskt genererad, personlig information från agentens egna interaktionserfarenheter HämtningsutlösarePassivt utlöst av användarfrågorAktivt bestämt av agenten när och vad som ska hämtas InformationsuppdateringKunskapsbasen uppdateras vanligtvis offlineOnline, kontinuerligt, selektivt uppdaterad Feedback loopIngen direkt feedbackmekanismBildar en sluten slinga med miljöinteraktion

Viktig skillnad: RAG är ett kunskapsutvidgningsverktyg, medan agentminne är en inlärningsmekanism. RAG svarar på "Vad jag vet", agentminne svarar på "Vad jag har lärt mig".

Agentminne vs. LLM-minne

LLM-minnesrelaterad teknik:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensionLLM-minneAgentminne DefinitionInternaliserad kunskap i modellparametrar, eller tillfällig information i kontextfönstretExternt system som stöder agentens kontinuerliga interaktion med miljön, inlärning över uppgifter och långsiktig anpassning TidsskalaBegränsad till förträningsdata eller aktuell samtalskontextSträcker sig över flera uppgifter, sessioner och stöder livslångt lärande UppdaterbarhetParameteruppdateringar är dyra, kontextinformation är flyktigStöder effektiv, selektiv dynamisk uppdatering och utveckling AktivitetPassivt svarar på frågorAktivt bestämmer vad som ska lagras, uppdateras och hämtas Koppling till miljönIngen direkt interaktion med miljönDjupt integrerad miljöfeedback, stöder interaktivt lärande

Viktig skillnad: LLM-minne är i huvudsak statiskt (parametrar fasta) eller kortvarigt (kontext begränsad), medan agentminne är dynamiskt, ihållande och miljökopplat.

Agentminne vs. Kontextteknik

Kontextteknikrelaterad teknik:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspektKontextteknikAgentminne FokusInputoptimering för enstaka eller aktuella uppgifterPersistens och användning av information över flera omgångar och uppgifter TidsdimensionAktuell sessionLångsiktig historik InformationsvalManuellt utformade eller heuristiska reglerAutomatiserade mekanismer för bildning, utveckling och hämtning Status ManagementIngen varaktig statusExplicit underhåll av utvecklingsbar minnesstatus

Viktig skillnad: Kontextteknik är en promptoptimeringsmetod, medan agentminne är ett status management system. Den förstnämnda fokuserar på "Vad som matas in nu", den senare fokuserar på "Vad som har kommit ihåg tidigare, hur det påverkar nuet och framtiden".