บทสรุป RAG และ Agent & LLM Memory 107 หน้า

วันนี้ขอแชร์บทสรุปทางเทคนิค 107 หน้าจาก Renmin University, Fudan University, Peking University และอื่นๆ ในชื่อ "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics"

ที่อยู่โครงการ: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

ที่อยู่บทความ: https://arxiv.org/pdf/2512.13564

ในช่วงสองปีที่ผ่านมา เราได้เห็นวิวัฒนาการที่น่าทึ่งของ Large Language Models (LLM) ไปสู่ AI Agents ตั้งแต่ Deep Research ไปจนถึง Software Engineering ตั้งแต่การค้นพบทางวิทยาศาสตร์ไปจนถึงการทำงานร่วมกันของ Multi-Agent Agents เหล่านี้ที่ใช้โมเดลพื้นฐานกำลังผลักดันขอบเขตของ Artificial General Intelligence (AGI)

แต่คำถามสำคัญก็เกิดขึ้น: พารามิเตอร์ LLM แบบคงที่ไม่สามารถอัปเดตได้อย่างรวดเร็ว จะทำให้ Agent มีความสามารถในการเรียนรู้และปรับตัวอย่างต่อเนื่องได้อย่างไร

คำตอบคือ – Memory

"Memory เป็นความสามารถหลักในการเปลี่ยน LLM แบบคงที่ให้เป็น Agent ที่สามารถปรับตัวได้อย่างต่อเนื่องผ่านการโต้ตอบกับสภาพแวดล้อม"

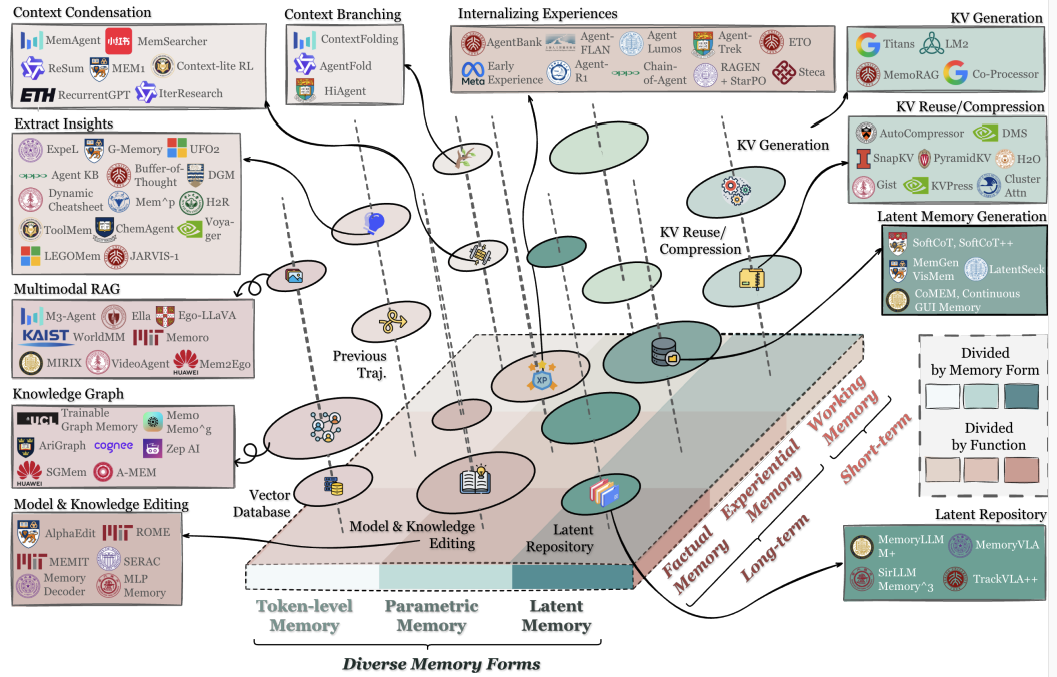

Figure 1 แสดงกรอบการจำแนกประเภทแบบรวมที่นำเสนอโดยบทความ โดยจัดระเบียบ Memory ของ Agent ตามสามมิติ ได้แก่ Forms, Functions และ Dynamics และแมประบบที่เป็นตัวแทนเข้ากับระบบการจำแนกประเภทนี้

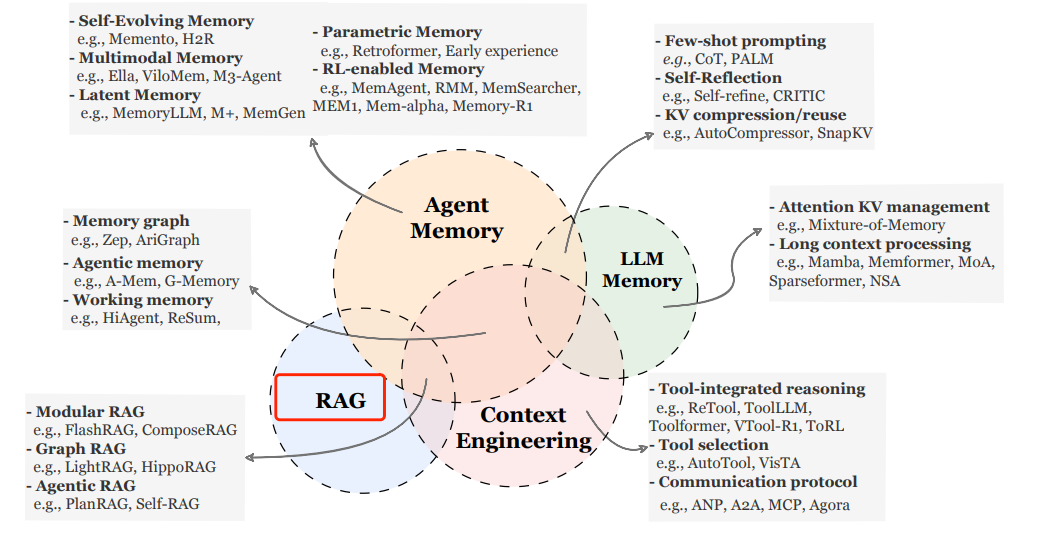

บทความนี้ยังแยกแยะ Agent Memory อย่างชัดเจนจากแนวคิดที่เกี่ยวข้องอย่างใกล้ชิดแต่แตกต่างกันโดยพื้นฐาน ได้แก่ LLM Memory, Retrieval-Augmented Generation (RAG) และ Context Engineering แม้ว่าทั้งหมดจะเกี่ยวข้องกับการจัดเก็บและการใช้ประโยชน์จากข้อมูล แต่ก็มีความแตกต่างที่สำคัญในด้านเป้าหมาย กลไก และสถานการณ์การใช้งาน

เทคโนโลยี Agent Memory

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Agent Memory vs. RAG

เทคโนโลยีที่เกี่ยวข้องกับ RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG และ Agent Memory เกี่ยวข้องกับการดึงข้อมูลจากที่เก็บข้อมูลภายนอกเพื่อเพิ่มขีดความสามารถของโมเดล แต่ทั้งสองมีความแตกต่างโดยพื้นฐานในปรัชญาการออกแบบ:

| คุณสมบัติ | RAG | Agent Memory |

|---|---|---|

| เป้าหมายหลัก | ให้การสนับสนุนความรู้พื้นฐานที่เกี่ยวข้องสำหรับการสืบค้นปัจจุบัน | การเรียนรู้อย่างต่อเนื่องและพฤติกรรมการปรับตัวข้ามเวลา |

| แหล่งข้อมูล | โดยทั่วไปคือฐานความรู้แบบคงที่ที่สร้างไว้ล่วงหน้า | ข้อมูลส่วนบุคคลที่สร้างขึ้นแบบไดนามิกจากประสบการณ์การโต้ตอบของ Agent เอง |

| การทริกเกอร์การดึงข้อมูล | ถูกทริกเกอร์โดยการสืบค้นของผู้ใช้แบบ Passive | ถูกกำหนดโดย Agent อย่างแข็งขันว่าเมื่อใดและจะดึงข้อมูลอะไร |

| การอัปเดตข้อมูล | โดยทั่วไปฐานความรู้จะได้รับการอัปเดตแบบออฟไลน์ | อัปเดตออนไลน์ ต่อเนื่อง และเลือกได้ |

| วงจรป้อนกลับ | ไม่มีกลไกป้อนกลับโดยตรง | สร้างวงจรปิดด้วยการโต้ตอบกับสภาพแวดล้อม |

ความแตกต่างที่สำคัญ: RAG เป็นเครื่องมือขยายความรู้ ในขณะที่ Agent Memory เป็นกลไกการเรียนรู้ RAG ตอบว่า "ฉันรู้อะไร" Agent Memory ตอบว่า "ฉันได้เรียนรู้อะไร"

Agent Memory vs. LLM Memory

เทคโนโลยีที่เกี่ยวข้องกับ LLM Memory:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

| มิติ | LLM Memory | Agent Memory |

|---|---|---|

| คำจำกัดความ | ความรู้ที่ฝังอยู่ในพารามิเตอร์ของโมเดล หรือข้อมูลชั่วคราวในหน้าต่างบริบท | ระบบภายนอกที่สนับสนุน Agent ในการโต้ตอบกับสภาพแวดล้อมอย่างต่อเนื่อง การเรียนรู้ข้ามงาน และการปรับตัวในระยะยาว |

| ช่วงเวลา | จำกัดอยู่เพียงข้อมูลการฝึกอบรมล่วงหน้าหรือบริบทการสนทนาปัจจุบัน | ครอบคลุมหลายงาน หลายเซสชัน สนับสนุนการเรียนรู้ตลอดชีวิต |

| ความสามารถในการอัปเดต | ค่าใช้จ่ายในการอัปเดตพารามิเตอร์สูง ข้อมูลบริบทสูญเสียง่าย | รองรับการอัปเดตและการพัฒนาแบบไดนามิกที่มีประสิทธิภาพและเลือกได้ |

| ความกระตือรือร้น | ตอบสนองต่อการสืบค้นแบบ Passive | ตัดสินใจอย่างแข็งขันว่าจะจัดเก็บ อัปเดต และดึงข้อมูลอะไร |

| การเชื่อมต่อกับสภาพแวดล้อม | ไม่มีการโต้ตอบโดยตรงกับสภาพแวดล้อม | บูรณาการความคิดเห็นจากสภาพแวดล้อมอย่างลึกซึ้ง สนับสนุนการเรียนรู้แบบโต้ตอบ |

ความแตกต่างที่สำคัญ: LLM Memory โดยพื้นฐานแล้วเป็นแบบคงที่ (พารามิเตอร์คงที่) หรือชั่วคราว (บริบทจำกัด) ในขณะที่ Agent Memory เป็นแบบไดนามิก ถาวร และเชื่อมต่อกับสภาพแวดล้อม

Agent Memory vs. Context Engineering

เทคโนโลยีที่เกี่ยวข้องกับ Context Engineering:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

| ด้าน | Context Engineering | Agent Memory |

|---|---|---|

| จุดสนใจ | การเพิ่มประสิทธิภาพอินพุตสำหรับงานเดียวหรือปัจจุบัน | การเก็บรักษาและการใช้ประโยชน์จากข้อมูลอย่างถาวรข้ามหลายรอบ หลายงาน |

| มิติเวลา | เซสชันปัจจุบัน | ประวัติระยะยาว |

| การเลือกข้อมูล | การออกแบบด้วยตนเองหรือกฎเกณฑ์เชิงฮิวริสติก | กลไกการสร้าง พัฒนา และดึงข้อมูลอัตโนมัติ |

| การจัดการสถานะ | ไม่มีสถานะถาวร | การบำรุงรักษาสถานะ Memory ที่พัฒนาได้โดยชัดเจน |

ความแตกต่างที่สำคัญ: Context Engineering เป็นเทคนิคการเพิ่มประสิทธิภาพ Prompt ในขณะที่ Agent Memory เป็นระบบการจัดการสถานะ อดีตมุ่งเน้นไปที่ "ตอนนี้ใส่อะไร" ในขณะที่อย่างหลังมุ่งเน้นไปที่ "จำอะไรได้ในอดีต จะส่งผลต่อปัจจุบันและอนาคตอย่างไร"