Isang 107-pahinang Pagsusuri sa RAG at Agent&LLM Memory

Ngayon, ibabahagi ko ang 107-pahinang teknikal na pagsusuri mula sa Renmin University, Fudan University, Peking University, at iba pa, na pinamagatang "Memory in the Age of AI Agents: A Survey Forms, Functions and Dynamics".

Address ng proyekto: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Address ng papel: https://arxiv.org/pdf/2512.13564

Sa nakalipas na dalawang taon, nasaksihan natin ang kamangha-manghang ebolusyon ng malalaking modelo ng wika (LLM) tungo sa mga AI agent. Mula sa Deep Research hanggang sa software engineering, mula sa pagtuklas ng siyensiya hanggang sa multi-agent na kolaborasyon, ang mga agent na ito na nakabatay sa mga pundasyong modelo ay nagtutulak sa mga hangganan ng artificial general intelligence (AGI).

Ngunit isang pangunahing tanong ang lumitaw: Paano magkakaroon ng patuloy na pag-aaral at kakayahang umangkop ang mga agent kung ang mga static na parameter ng LLM ay hindi maaaring i-update nang mabilis?

Ang sagot ay - Memorya.

"Ang memorya ay ang susi sa pagbabago ng mga static na LLM sa mga agent na may kakayahang patuloy na umangkop sa pamamagitan ng pakikipag-ugnayan sa kapaligiran."

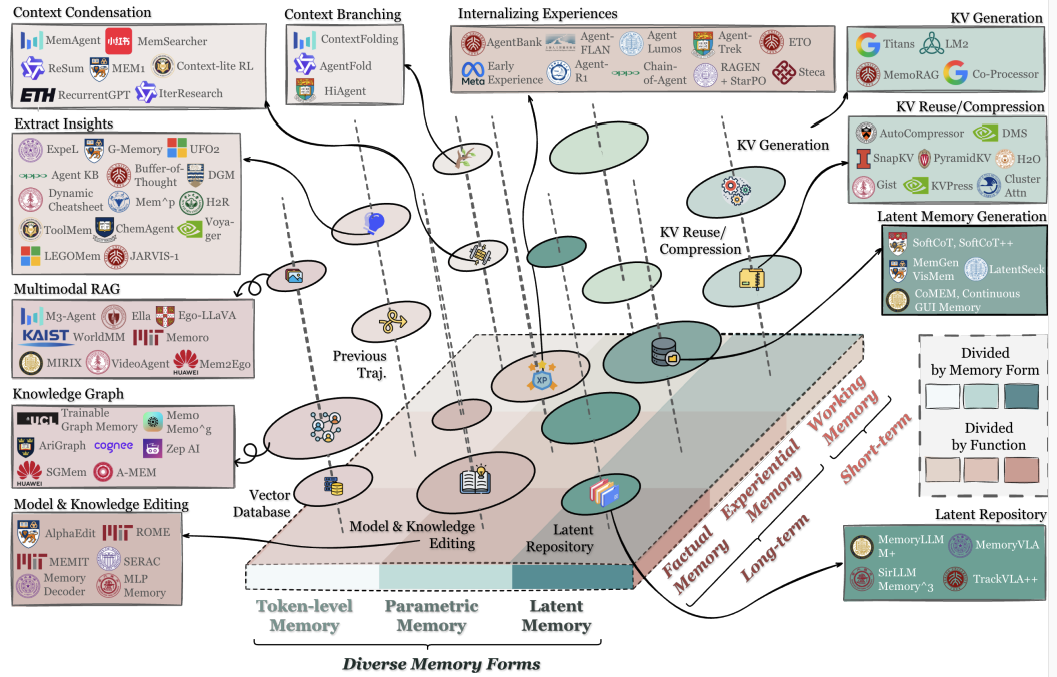

Ipinapakita ng Figure 1 ang pinag-isang balangkas ng pag-uuri na iminungkahi sa papel, na nag-oorganisa ng memorya ng agent ayon sa tatlong dimensyon ng Forms, Functions, at Dynamics, at inilalarawan ang mga kinatawan na sistema sa sistemang ito ng pag-uuri.

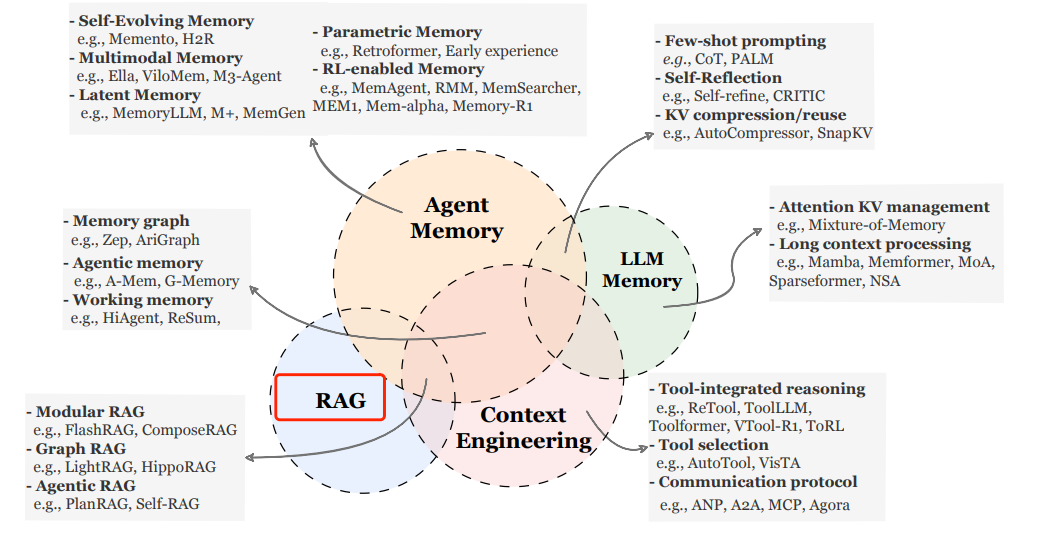

Nilinaw din ng papel ang pagkakaiba sa pagitan ng Agent Memory at ilang malapit na nauugnay ngunit mahalagang magkaibang konsepto: LLM memory, Retrieval-Augmented Generation (RAG), at Context Engineering. Bagama't lahat sila ay nauugnay sa pag-iimbak at paggamit ng impormasyon, may mga pangunahing pagkakaiba sa mga layunin, mekanismo, at mga sitwasyon ng aplikasyon.

Mga Teknolohiya ng Memorya ng Agent

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Agent Memory vs. RAG

Mga kaugnay na teknolohiya ng RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

Ang RAG at agent memory ay parehong nagsasangkot ng pagkuha ng impormasyon mula sa panlabas na imbakan upang mapahusay ang mga kakayahan ng modelo, ngunit may mga mahalagang pagkakaiba sa pilosopiya ng disenyo:

Mga TampokRAGAgent Memory Pangunahing LayuninUpang magbigay ng may-katuturang suporta sa background para sa kasalukuyang queryPatuloy na pag-aaral at adaptive na pag-uugali sa paglipas ng panahon Pinagmulan ng ImpormasyonKaraniwang static, pre-built na knowledge baseDynamic na nabuo, personalized na impormasyon mula sa sariling karanasan sa pakikipag-ugnayan ng agent Pag-trigger ng PagkuhaPasibong na-trigger ng query ng gumagamitAktibong tinutukoy ng agent kung kailan at kung ano ang kukunin Pag-update ng ImpormasyonAng knowledge base ay karaniwang ina-update offlineOnline, patuloy, at pili na ina-update Feedback LoopWalang direktang mekanismo ng feedbackBumubuo ng closed loop sa pakikipag-ugnayan sa kapaligiran

Pangunahing pagkakaiba: Ang RAG ay isang tool sa pagpapalawak ng kaalaman, habang ang agent memory ay isang mekanismo ng pag-aaral. Sinasagot ng RAG ang "Ano ang alam ko", sinasagot ng agent memory ang "Ano ang natutunan ko".

Agent Memory vs. LLM Memory

Mga kaugnay na teknolohiya ng LLM memory:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

DimensyonLLM MemoryAgent Memory KahuluganAng kaalaman na isinama sa mga parameter ng modelo, o pansamantalang impormasyon sa window ng kontekstoPanlabas na sistema na sumusuporta sa patuloy na pakikipag-ugnayan ng agent sa kapaligiran, pag-aaral sa iba't ibang gawain, at pangmatagalang pag-angkop Time ScaleLimitado sa data ng pre-training o kasalukuyang konteksto ng pag-uusapSumasaklaw sa maraming gawain, sesyon, at sumusuporta sa lifelong learning Na-a-updateMataas ang halaga ng pag-update ng parameter, madaling mawala ang impormasyon ng kontekstoSumusuporta sa mahusay at pili na dynamic na pag-update at ebolusyon AktiboPasibong tumutugon sa mga queryAktibong tinutukoy kung ano ang iimbak, i-update, at kukunin na impormasyon Pagkabit sa KapaligiranWalang direktang pakikipag-ugnayan sa kapaligiranMalalim na isinama ang feedback ng kapaligiran, sumusuporta sa interactive na pag-aaral

Pangunahing pagkakaiba: Ang LLM memory ay mahalagang static (nakapirming mga parameter) o pansingdaan (limitado ang konteksto), habang ang agent memory ay dynamic, persistent, at kapaligiran-coupled.

Agent Memory vs. Context Engineering

Mga kaugnay na teknolohiya ng context engineering:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

AspektoContext EngineeringAgent Memory PokusPag-optimize ng input para sa isang solong round o kasalukuyang gawainPagpapanatili at paggamit ng impormasyon sa maraming round at gawain Dimensyon ng OrasKasalukuyang sesyonPangmatagalang kasaysayan Pagpili ng ImpormasyonDinisenyo ng tao o heuristic na mga panuntunanAwtomatikong nabuo, ebolusyon, at mekanismo ng pagkuha Pamamahala ng EstadoWalang persistent na estadoMalinaw na pinapanatili ang ebolusyonaryong estado ng memorya

Pangunahing pagkakaiba: Ang context engineering ay isang teknolohiya sa pag-optimize ng prompt, habang ang agent memory ay isang sistema ng pamamahala ng estado. Ang una ay nakatuon sa "Ano ang ipapasok ngayon", ang huli ay nakatuon sa "Ano ang naaalala sa nakaraan, at paano ito nakakaapekto sa kasalukuyan at hinaharap".