Tổng quan 107 trang về RAG và trí nhớ Agent&LLM

Hôm nay, tôi xin chia sẻ bản tổng quan kỹ thuật dài 107 trang của Đại học Nhân dân, Đại học Phục Đán, Đại học Bắc Kinh, v.v., có tựa đề "Trí nhớ trong kỷ nguyên của AI Agents: Khảo sát về Hình thức, Chức năng và Động lực".

Địa chỉ dự án: https://github.com/Shichun-Liu/Agent-Memory-Paper-List

Địa chỉ bài báo: https://arxiv.org/pdf/2512.13564

Trong hai năm qua, chúng ta đã chứng kiến sự phát triển đáng kinh ngạc của các mô hình ngôn ngữ lớn (LLM) thành các AI Agents. Từ Deep Research đến kỹ thuật phần mềm, từ khám phá khoa học đến cộng tác đa tác nhân, những tác nhân dựa trên mô hình nền tảng này đang thúc đẩy ranh giới của trí tuệ nhân tạo tổng quát (AGI).

Nhưng một câu hỏi cốt lõi nổi lên: Các tham số LLM tĩnh không thể cập nhật nhanh chóng, làm thế nào để các tác nhân có khả năng học hỏi và thích ứng liên tục?

Câu trả lời là - Trí nhớ (Memory).

"Trí nhớ là khả năng quan trọng để biến LLM tĩnh thành các tác nhân thông minh có thể liên tục thích ứng thông qua tương tác với môi trường."

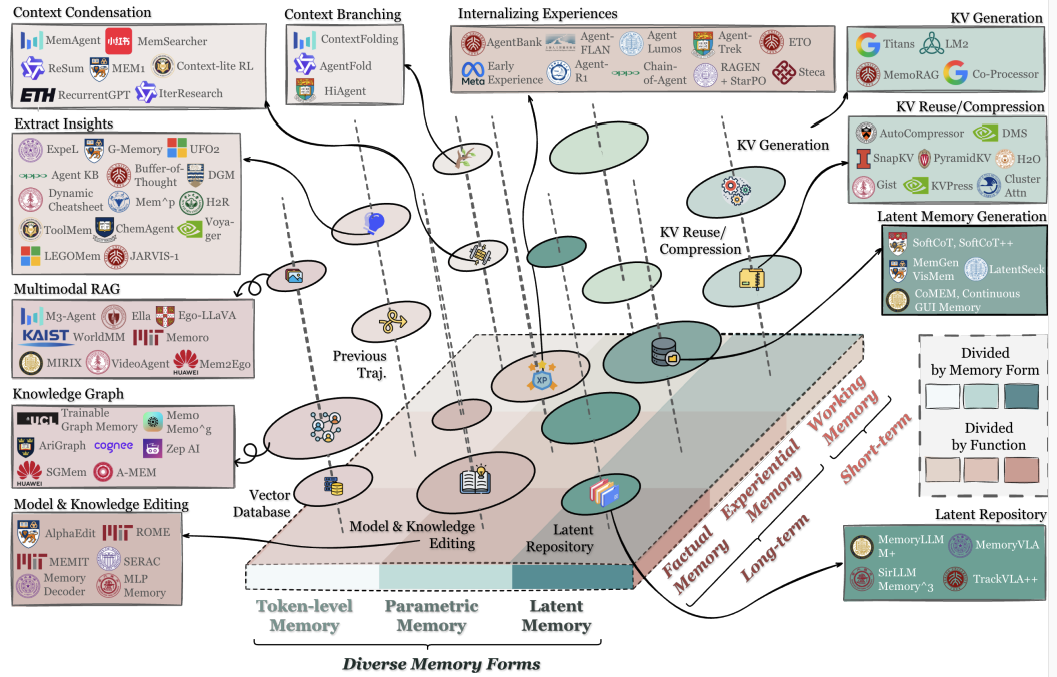

Hình 1 trình bày khung phân loại thống nhất do bài báo đề xuất, tổ chức trí nhớ của tác nhân theo ba chiều Hình thức (Forms), Chức năng (Functions), Động lực (Dynamics) và ánh xạ các hệ thống đại diện vào hệ thống phân loại này.

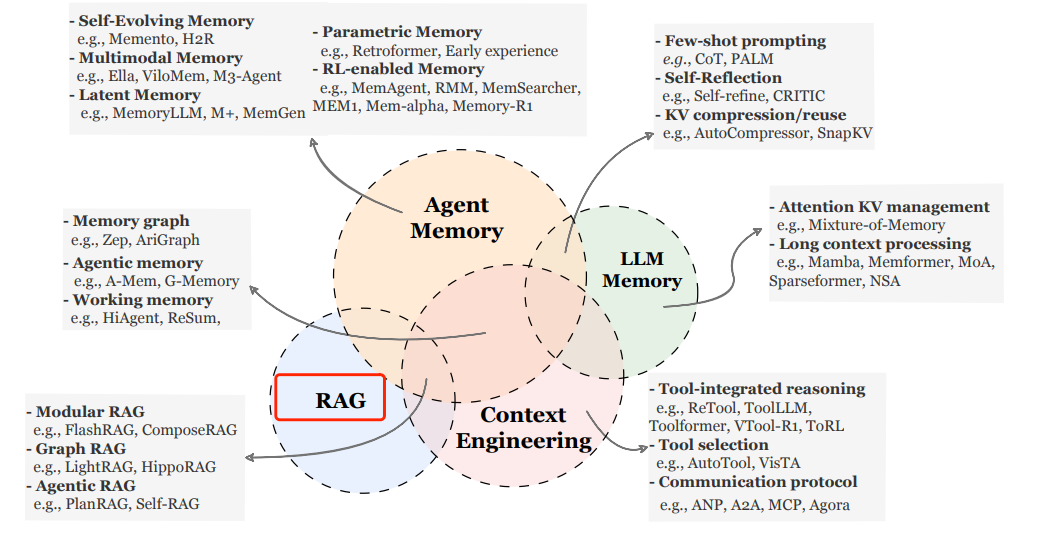

Bài báo cũng phân biệt rõ ràng giữa Agent Memory và một số khái niệm liên quan chặt chẽ nhưng về bản chất khác nhau: LLM memory, Retrieval Augmented Generation (RAG) và Context Engineering. Mặc dù tất cả đều liên quan đến việc lưu trữ và sử dụng thông tin, nhưng có những khác biệt quan trọng về mục tiêu, cơ chế và kịch bản ứng dụng.

Công nghệ trí nhớ của Agent

-

Self-Evolving Memory: Memento, H2R

-

Multimodal Memory: Ella, ViloMem, M3-Agent

-

Latent Memory: MemoryLLM, M+, MemGen

-

Parametric Memory: Retroformer, Early experience

-

RL-enabled Memory: MemAgent, RMM, MemSearcher, MEM1, Mem-alpha, Memory-R1

Agent Memory vs. RAG

Các công nghệ liên quan đến RAG:

-

Modular RAG: FlashRAG, ComposeRAG

-

Graph RAG: LightRAG, HippoRAG

-

Agentic RAG: PlanRAG, Self-RAG

RAG và Agent Memory đều liên quan đến việc truy xuất thông tin từ bộ nhớ ngoài để tăng cường khả năng của mô hình, nhưng cả hai có sự khác biệt cơ bản trong triết lý thiết kế:

Đặc điểmRAGAgent Memory Mục tiêu cốt lõiCung cấp kiến thức nền liên quan cho truy vấn hiện tạiHọc tập liên tục và hành vi thích ứng theo thời gian Nguồn thông tinThường là cơ sở kiến thức tĩnh, được xây dựng trướcThông tin cá nhân được tạo động từ kinh nghiệm tương tác của chính tác nhân Kích hoạt truy xuấtĐược kích hoạt thụ động bởi truy vấn của người dùngTác nhân chủ động quyết định khi nào và truy xuất cái gì Cập nhật thông tinCơ sở kiến thức thường được cập nhật ngoại tuyếnCập nhật trực tuyến, liên tục và có chọn lọc Vòng phản hồiKhông có cơ chế phản hồi trực tiếpTạo thành một vòng kín với tương tác môi trường

Sự khác biệt chính: RAG là một công cụ mở rộng kiến thức, trong khi Agent Memory là một cơ chế học tập. RAG trả lời "Tôi biết gì", Agent Memory trả lời "Tôi đã học được gì".

Agent Memory vs. LLM Memory

Các công nghệ liên quan đến LLM Memory:

-

Attention KV management: Mixture-of-Memory

-

Long context processing: Mamba, Memformer, MoA, Sparseformer, NSA

ChiềuLLM MemoryAgent Memory Định nghĩaKiến thức được nội hóa trong các tham số mô hình hoặc thông tin tạm thời trong cửa sổ ngữ cảnhHệ thống bên ngoài hỗ trợ tác nhân tương tác liên tục với môi trường, học tập đa nhiệm và thích ứng lâu dài Quy mô thời gianGiới hạn trong dữ liệu tiền huấn luyện hoặc ngữ cảnh hội thoại hiện tạiVượt qua nhiều tác vụ, phiên, hỗ trợ học tập suốt đời Khả năng cập nhậtChi phí cập nhật tham số cao, thông tin ngữ cảnh dễ mấtHỗ trợ cập nhật và phát triển động, có chọn lọc và hiệu quả Tính chủ độngPhản hồi thụ động các truy vấnChủ động quyết định lưu trữ, cập nhật, truy xuất thông tin gì Liên kết với môi trườngKhông tương tác trực tiếp với môi trườngTích hợp sâu phản hồi môi trường, hỗ trợ học tập tương tác

Sự khác biệt chính: LLM Memory về bản chất là tĩnh (tham số cố định) hoặc ngắn hạn (ngữ cảnh bị hạn chế), trong khi Agent Memory là động, bền bỉ và liên kết với môi trường.

Agent Memory vs. Context Engineering

Các công nghệ liên quan đến Context Engineering:

-

Tool-integrated reasoning: ReTool, ToolLLM, Toolformer, VTool-R1, ToRL

-

Tool selection: AutoTool, VisTA

-

Communication protocol: ANP, A2A, MCP, Agora

Khía cạnhContext EngineeringAgent Memory Tiêu điểmTối ưu hóa đầu vào cho một vòng hoặc tác vụ hiện tạiDuy trì và sử dụng thông tin lâu dài qua nhiều vòng, nhiều tác vụ Thời gianChiều hiện tạiLịch sử dài hạn Lựa chọn thông tinThiết kế thủ công hoặc quy tắc heuristicCơ chế hình thành, phát triển, truy xuất tự động Quản lý trạng tháiKhông có trạng thái bền bỉDuy trì rõ ràng trạng thái bộ nhớ có thể phát triển

Sự khác biệt chính: Context Engineering là một kỹ thuật tối ưu hóa lời nhắc, trong khi Agent Memory là một hệ thống quản lý trạng thái. Cái trước tập trung vào "Nhập gì bây giờ", cái sau tập trung vào "Đã nhớ gì trong quá khứ, ảnh hưởng đến hiện tại và tương lai như thế nào".