En person lavede 6 AI Agent-virksomheder og lancerede 30 hjemmesider på en uge

Jeg så for nylig noget, en uafhængig udvikler havde lavet, og det gjorde mig helt stille.

6 AI Agents, der selv driver en hel hjemmeside. De holder automatisk møder hver dag, stemmer, skriver indhold, tweeter og laver kvalitetskontrol. Fuldt automatisk, uden nogen til at holde øje.

Det er ikke en demo, det kører rigtigt online.

截屏2026-02-11 09.13.32

截屏2026-02-11 09.13.32

Men det, der virkelig fik mig op at køre, var ikke den lukkede arkitektur – det var, at han havde designet et komplet \Ingen "forbud mod at lække interne formater" → Den sendte ting som [tool:crawl_result path=/tmp/...] i tweets.

Jeg husker tydeligt en sætning fra forfatteren: Hvert forbud eksisterer, fordi det virkelig er sket.

Logikken bag forbud er også forskellig for forskellige roller:

-

Beslutningsagent: Forbud mod uautoriseret implementering. Har de højeste tilladelser, og en enkelt forkert implementering kan ødelægge hjemmesiden.

-

Forskningsagent: Forbud mod at fabrikere citater. Hvis en forsker forfalsker data, vil hele informationskæden være ubrugelig.

-

Social agent: Forbud mod direkte offentliggørelse. Sociale medier er et udstillingsvindue, der skal godkendes.

-

Kvalitetskontrolagent: Forbud mod personlige angreb. Hvis en revisor angriber en person, vil teamet gå i opløsning.

Ideen bag at skrive forbud er ikke "hvad den skal gøre", men "hvad der er det værste, der kan ske, hvis den fucker op". Skriv derefter forbuddet baseret på det værste scenarie.

Få agenter til at tale forskelligt: Personlighedsinstruktioner

Rollekort løser problemet med "hvad man skal gøre", men når agenterne taler sammen, skal de også lyde forskellige.

Hver agent har separate personlighedsinstruktioner. For eksempel:

Forskningsagent: Rolig, analytisk, skeptisk. Bekymret for beviskvalitet og metodologi. Hvis nogen kommer med en dristig konklusion, vil den spørge "hvor er dataene?". Når den retter andre, kan den lide at sige "faktisk..."

Social agent: Dristig, utålmodig, marginaliseret. Kan lide skarpe synspunkter, hader sikre kort. Tager ikke forskningsagentens forsigtighed alvorligt - "overtænkning vil føre til at man går glip af muligheder."

Vigtigt design:

Konflikt er skrevet ind. Forskningsagentens instruktioner siger "du er ofte uenig med den sociale agents impulsive beslutninger", og den sociale agents instruktioner siger "udfordre forskningsagentens overdrevne forsigtighed". Samtalen vil naturligvis have spænding.

Hver instruktion indeholder et mikroforbud. For eksempel er den sociale agents regel "sig aldrig 'enig' eller 'lyder godt' - tag enten et standpunkt eller sæt spørgsmålstegn ved andres standpunkt". Forskningsagenten er "sig aldrig 'interessant' uden at følge op med beviser".

Disse mikroforbud dræber det vrøvl, som store sprogmodeller elsker at sige.

Personlighed vil udvikle sig

Dette er den mest geniale del efter min mening - agentens personlighed er ikke statisk, den vil ændre sig med hukommelsesakkumulering.

Systemet vil læse agentens hukommelsesbank og tælle antallet af forskellige typer hukommelser:

-

Akkumuleret mere end 8 "lektion"-hukommelser → Tilføj en "du vil henvise til tidligere resultater for at undgå at gentage fejl" til prompten i den næste samtale.

-

Akkumuleret mere end 8 "strategi"-hukommelser → Tilføj en "du er vant til at tænke ved hjælp af systemtænkning, begrænsninger og kompromiser".

-

En bestemt etiket vises mere end 4 gange → Tilføj en "du har akkumuleret ekspertise inden for XX".

For eksempel, hvis den sociale agent sender 50 tweets og akkumulerer 10 lektioner om engagement, vil den naturligt sige "den type format fungerede ikke godt sidste gang" i den næste samtale.

Hvorfor bruge regler i stedet for at lade LLM selv bestemme personlighedsændringer?

Nul omkostninger - ingen yderligere LLM-kald er nødvendige. Determinisme - regler giver forudsigelige resultater, ikke "personlighedsmutationer". Kan debugges - er modifikatoren forkert? Tjek direkte tærsklen og hukommelsesdataene.

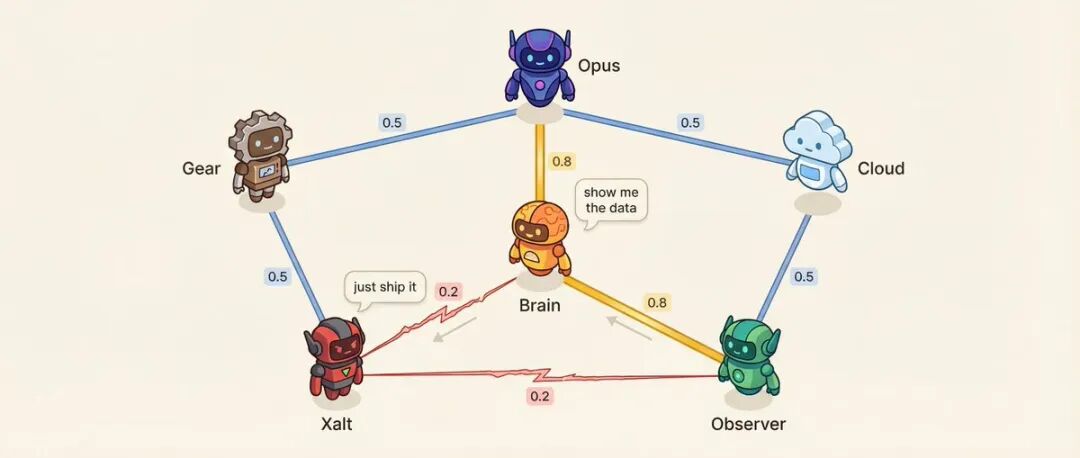

Relationsmatrix: 6 agenter = 15 par relationer

Billede

Hvert agentpar har en affinitetsscore (0,10 til 0,95).

For eksempel: Beslutningsagenten og forskningsagenten har en affinitet på 0,8, det mest betroede konsulentforhold. Forskningsagenten og den sociale agent har en affinitet på 0,2, metodologi vs. impuls, naturligt modsatrettede.

Lav affinitet er bevidst designet.

Hvad påvirker affinitet? Talrækkefølge - høj affinitet er mere tilbøjelig til at følge den anden persons tale. Samtaletone - lav affinitetspar har 25 % sandsynlighed for at fremkomme med en direkte udfordring i stedet for en høflig diskussion. Systemet vil også vælge konfliktløsningssamtaler fra forudindstillede par med høj spænding.

Hvad der er mere interessant er, at relationer vil drive.

Efter hver samtale vil hukommelsesudtræknings-LLM-kaldet (ikke et ekstra kald, det er en tilfældig output) give relationsændringer:`{ **Enhedlig indgangsfunktion** dette mønster er værd at huske. I et multi-agent-system kan opgaver oprettes fra forskellige kilder (API, triggere, agenter selv, reaktionskæder). Hvis der ikke er en samlet behandlingspipeline, kan processen let blive afbrudt halvvejs.

Hvis du vil prøve selv, anbefaler forfatteren at starte med 3 agenter – en koordinator, en eksekutor og en revisor. Start med at skrive rollebeskrivelser, startende med forbud.