En person laget 6 AI Agent-selskaper, lanserte 30 nettsteder på en uke

Jeg så nylig noe en uavhengig utvikler hadde laget, og det gjorde meg stille.

6 AI-agenter, som driver et helt nettsted selv. De holder automatisk møter hver dag, stemmer, skriver innhold, tweeter og utfører kvalitetskontroll. Helt automatisk, ingen overvåker dem.

Ikke en demo, det kjører faktisk online.

截屏2026-02-11 09.13.32

截屏2026-02-11 09.13.32

Men det som virkelig fikk meg hekta var ikke den lukkede arkitekturen – det var at han designet et komplett \Det var en setning forfatteren sa som jeg husker veldig godt: Hvert forbud eksisterer fordi det faktisk har skjedd.

Logikken bak forbud er også forskjellig for ulike roller:

-

Beslutningsagent: Forbud mot distribusjon uten godkjenning. Har de høyeste tillatelsene, og en feilaktig distribusjon kan ødelegge hele nettstedet.

-

Forskningsagent: Forbud mot å fabrikkere sitater. Hvis forskningsdata er forfalsket, vil hele informasjonskjeden være ubrukelig.

-

Sosial agent: Forbud mot direkte publisering. Sosiale medier er fasaden, og må godkjennes.

-

Kvalitetskontrollagent: Forbud mot personangrep. Hvis revisorer angriper enkeltpersoner, vil teamet oppløses.

Tankegangen bak å skrive forbud er ikke "hva den skal gjøre", men "hva er det verste som kan skje hvis den roter det til". Deretter skriver du forbud basert på verste fall-scenarioet.

Få agenter til å snakke annerledes: Personlighetsinstrukser

Rollekort løser problemet med "hva man skal gjøre", men når agenter snakker med hverandre, må de også høres forskjellige ut.

Hver agent har separate personlighetsinstrukser. For eksempel:

Forskningsagent: Rolig, analytisk, skeptisk. Opptatt av beviskvalitet og metodikk. Hvis noen kommer med en dristig konklusjon, vil den spørre "Hvor er dataene?". Når den korrigerer andre, liker den å si "Faktisk..."

Sosial agent: Dristig, utålmodig, marginalisert. Liker skarpe synspunkter, hater trygge kort. Bryr seg ikke om forskningsagentens forsiktighet – "Å tenke for mye vil føre til at du går glipp av muligheten."

Viktig design:

Konflikt er skrevet inn. Forskningsagentens instruksjoner sier "Du er ofte uenig i den sosiale agentens impulsive beslutninger", og den sosiale agentens instruksjoner sier "Utfordre forskningsagentens overdrevne forsiktighet". Samtalen vil naturlig ha spenning.

Hver instruksjon inneholder et mini-forbud. For eksempel er den sosiale agentens regel "Si aldri 'enig' eller 'høres bra ut' – enten ta et standpunkt eller still spørsmål ved andres standpunkt". Forskningsagenten er "Si aldri 'interessant' uten å følge opp med bevis."

Disse mini-forbudene dreper det store språkmodellens favoritt-fyllord.

Personlighet vil utvikle seg

Dette er den mest geniale delen etter min mening – agentens personlighet er ikke statisk, den vil endre seg med akkumulering av minner.

Systemet vil lese agentens minnebank og telle antall forskjellige typer minner:

-

Akkumulert mer enn 8 "lærdom"-minner → Neste gang du snakker, legg til en linje i prompten "Du vil referere til tidligere resultater for å unngå å gjenta feil"

-

Akkumulert mer enn 8 "strategi"-minner → Legg til en linje "Du er vant til å tenke ved hjelp av systemtenkning, begrensninger og avveininger"

-

En bestemt tag vises mer enn 4 ganger → Legg til en linje "Du har akkumulert ekspertise innen XX"

For eksempel, hvis den sosiale agenten publiserer 50 tweets og akkumulerer 10 lærdommer om engasjementsrate, vil den naturlig si "Det formatet fungerte ikke bra sist gang" neste gang den snakker.

Hvorfor bruke regler i stedet for å la LLM bestemme personlighetsendringer selv?

Null kostnad – ingen ekstra LLM-anrop er nødvendig. Deterministisk – regler gir forutsigbare resultater, ingen "personlighetsmutasjoner". Feilsøkbar – er modifikatoren feil? Sjekk terskelen og minnedataene direkte.

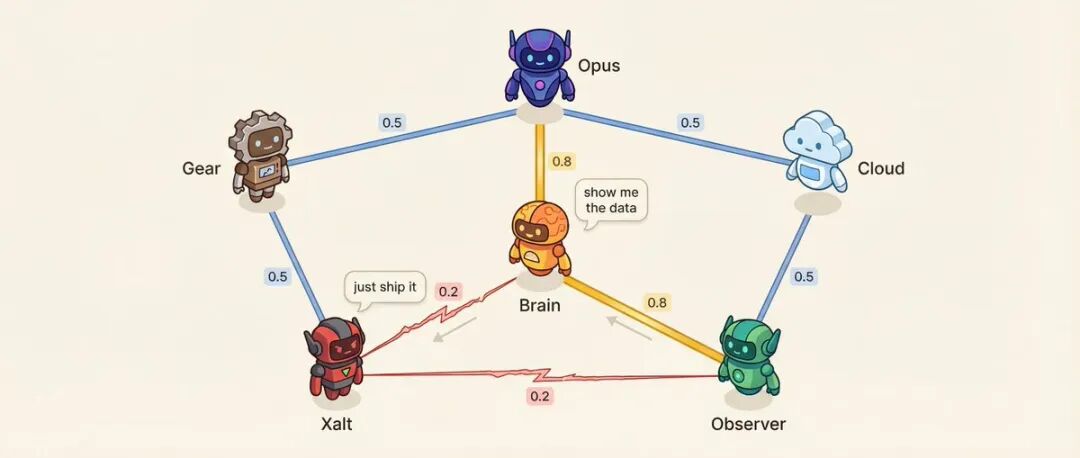

Relasjonsmatrise: 6 agenter = 15 par relasjoner

Hvert agentpar har en affinitetsscore (0,10 til 0,95).

For eksempel: Beslutningsagenten og forskningsagenten har en affinitet på 0,8, det mest pålitelige konsulentforholdet. Forskningsagenten og den sosiale agenten har en affinitet på 0,2, metodikk vs. impuls, naturlig motsetning.

Lav affinitet er bevisst designet.

Hva påvirker affinitet? Talerekkefølge – de med høy affinitet er mer sannsynlig å følge opp hverandre. Samtale tone – for par med lav affinitet er det 25 % sjanse for en direkte utfordring i stedet for en høflig diskusjon. Systemet vil også velge høyspenningspar for konfliktløsningssamtaler.

Det som er enda mer interessant er at relasjoner vil drive.

Hver gang en samtale er over, vil LLM-anropet for minneutvinning (ikke et ekstra anrop, det er en biproduktutgang) gi en relasjonsendring:`{ **Enhetlig inngangsfunksjon** er et mønster verdt å huske. I et multi-agent system kan oppgaver opprettes fra forskjellige kilder (API, triggere, agenter som foreslår dem selv, reaksjonskjeder). Uten en enhetlig behandlingspipeline kan prosessen lett stoppe halvveis.

Hvis du vil prøve selv, anbefaler forfatteren å starte med 3 agenter – en koordinator, en utfører og en revisor. Skriv først rollebeskrivelser, begynn med forbud.