Um cara criou 6 empresas de Agentes de IA e lançou 30 sites em uma semana

Recentemente, vi algo feito por um desenvolvedor independente que me deixou em silêncio.

6 Agentes de IA, operando um site inteiro por conta própria. Reuniões automáticas diárias, votação, redação de conteúdo, postagem no Twitter, controle de qualidade. Tudo automático, sem ninguém supervisionando.

Não é uma demonstração, está realmente rodando online.

截屏2026-02-11 09.13.32

截屏2026-02-11 09.13.32

Mas o que mais me impressionou não foi a arquitetura de ciclo fechado – mas sim o fato de ele ter projetado um "sistema de personalidade" completo para cada Agente. Com personalidade, relacionamentos, curva de crescimento e até mesmo painéis de atributos de RPG e avatares 3D.

Para ser honesto, minha primeira reação depois de ver isso foi: isso não é nada mais do que um animal de estimação eletrônico? Só que esses animais de estimação ajudam você a twittar, fazer pesquisas, escrever relatórios e até discutir uns com os outros.

Hoje, vamos analisar esse conjunto completo de designs. Amigos que fazem sistemas multi-agentes devem ter muita inspiração.

Vamos revisar rapidamente a arquitetura

O conjunto de três peças da pilha de tecnologia: OpenClaw rodando em um VPS como cérebro, Next.js + Vercel como front-end e camada de API, e Supabase armazenando todos os estados.

Os 6 Agentes têm diferentes divisões de trabalho – alguns tomam decisões, alguns fazem pesquisas, alguns coletam informações, alguns escrevem conteúdo, alguns gerenciam mídias sociais e alguns fazem controle de qualidade.

O cron job do OpenClaw os faz "fazer check-in no trabalho" todos os dias, e a função de mesa redonda permite que eles discutam e votem.

Mas há um ciclo fechado inteiro entre "ser capaz de falar" e "ser capaz de trabalhar". O autor passou por três grandes armadilhas antes de conseguir executá-lo. Aqui está uma breve descrição:

Armadilha 1: VPS e Vercel competindo por tarefas ao mesmo tempo. Dois executores consultam a mesma tabela, e as condições de corrida causam diretamente conflitos de status de tarefa. A solução é cortar um lado, com o VPS responsável pela execução e o Vercel apenas fazendo o plano de controle.

Armadilha 2: Os gatilhos podem detectar condições e criar propostas, mas as propostas sempre permanecem pendentes. Porque os gatilhos inserem dados diretamente na tabela, ignorando os processos subsequentes de aprovação e criação de tarefas. A solução é extrair uma função de entrada unificada, e todos os caminhos para criar propostas seguem o mesmo.

Armadilha 3: A cota foi usada, mas as tarefas na fila ainda estão se acumulando loucamente. O Worker vê que a cota está cheia e pula, não reivindicando nem marcando como falha. Com o tempo, centenas de etapas que nunca serão executadas se acumulam no banco de dados. A solução é verificar a cota na entrada da proposta e recusá-la diretamente se estiver cheia, impedindo que ela gere tarefas na fila.

O núcleo das três armadilhas é a mesma coisa – pare na porta e não deixe o problema entrar na fila.

A parte interessante realmente começa depois que o ciclo fechado é executado.

Cartão de função: não é uma frase, é um "manual do funcionário" completo

As pessoas que fazem sistemas multi-agentes sabem que se você disser a Claude "você é um gerente de mídia social", ele realmente twittará. Mas se você executar 6 Agentes como este ao mesmo tempo, você descobrirá:

-

Eles falam todos da mesma forma

-

Não sabem o que não devem fazer

-

Quem trabalha bem com quem e quem entra em conflito com quem depende da sorte

-

Nunca mudarão seu comportamento por causa da experiência acumulada

Este desenvolvedor projetou 6 camadas de cartões de função para cada Agente:

Domain → Do que você é responsável Inputs/Outputs → De quem você recebe coisas e para quem você entrega Definition of Done → O que significa "feito" Hard Bans → O que você absolutamente não pode fazer Escalation → Quando parar e pedir instruções Metrics → Seu KPI Tomando o Agente de mídia social como exemplo, seu cartão de função define: responsável apenas pela distribuição de conteúdo, a entrada vem do rascunho do Agente de redação e do material do Agente de inteligência, a saída é o rascunho do tweet e o plano de publicação, a proibição rígida é twittar diretamente (só pode escrever rascunhos), proibir a fabricação de dados e proibir a divulgação de formatos internos.

Cada camada está fazendo a mesma coisa: reduzir o espaço de comportamento do Agente.

Proibições são um milhão de vezes mais importantes do que habilidades

Esta é a visão mais essencial em todo o design.

Você não precisa ensinar o LLM a escrever tweets – Claude, GPT e Gemini são inteligentes o suficiente. Dê a ele o contexto e ele pode entregar. O que você precisa dizer a ele é: o que você absolutamente não pode fazer.

Sem "proibição de publicação direta" → O Agente social chama diretamente a API do Twitter, ignorando todas as aprovações.

Sem "proibição de fabricar números" → Ele escreverá no tweet "a taxa de interação aumentou 340%", de onde veio esse número? Fabricado.Não há "proibição de vazar formatos internos" → Ele publicou coisas como [tool:crawl_result path=/tmp/...] em tweets.

Lembro-me claramente de uma frase que o autor disse: Cada proibição existe porque isso realmente aconteceu.

A lógica das proibições também é diferente para diferentes papéis:

-

Agente de Decisão: Proibição de implantação não aprovada. Tem a maior autoridade, uma implantação errada pode derrubar o site.

-

Agente de Pesquisa: Proibição de fabricar citações. Se um pesquisador falsificar dados, toda a cadeia de informações será inútil.

-

Agente Social: Proibição de publicação direta. As mídias sociais são a fachada, devem ser revisadas.

-

Agente de Controle de Qualidade: Proibição de ataques pessoais. Se um auditor atacar um indivíduo, a equipe se desfará.

A ideia de escrever proibições não é "o que ele deve fazer", mas "o que de pior pode acontecer se ele estragar tudo". E então escrever proibições para o pior cenário.

Fazer os Agentes Falarem de Forma Diferente: Instruções de Personalidade

O cartão de função resolve o problema de "o que fazer", mas quando os Agentes conversam entre si, eles precisam soar diferentes.

Cada Agente tem instruções de personalidade separadas. Por exemplo:

Agente de Pesquisa: Calmo, analítico, cético. Preocupado com a qualidade da evidência e a metodologia. Se alguém fizer uma conclusão ousada, ele perguntará "Onde estão os dados?". Ao corrigir os outros, ele gosta de dizer "Na verdade..."

Agente Social: Ousado, impaciente, marginalizado. Gosta de opiniões afiadas, odeia jogadas seguras. Não se importa com a atitude cautelosa do Agente de Pesquisa - "Pensar demais faz você perder a oportunidade."

Design chave:

O conflito é escrito. As instruções do Agente de Pesquisa dizem "Você frequentemente discorda das decisões impulsivas do Agente Social", e as instruções do Agente Social dizem "Desafie a cautela excessiva do Agente de Pesquisa". A conversa naturalmente tem tensão.

Cada instrução tem uma micro-proibição. Por exemplo, a regra do Agente Social é "Nunca diga 'Concordo' ou 'Parece bom' - ou tome uma posição ou questione a posição de outra pessoa". O Agente de Pesquisa é "Nunca diga 'Interessante' sem acompanhar com evidências".

Essas micro-proibições matam o lixo que o modelo grande mais gosta de dizer.

A Personalidade Evolui

Esta é a parte que eu acho mais inteligente - a personalidade do Agente não é estática, ela muda com o acúmulo de memória.

O sistema lê o banco de memória do Agente e estatística o número de diferentes tipos de memória:

-

Acumulou mais de 8 memórias do tipo "lição" → Adicione uma linha ao prompt na próxima conversa "Você consultará resultados anteriores para evitar repetir os mesmos erros"

-

Acumulou mais de 8 memórias do tipo "estratégia" → Adicione uma linha "Você está acostumado a pensar usando pensamento sistêmico, restrições e trade-offs"

-

Uma determinada tag aparece mais de 4 vezes → Adicione uma linha "Você acumulou conhecimento especializado em XX"

Por exemplo, se o Agente Social postar 50 tweets e acumular 10 lições aprendidas sobre taxas de engajamento, ele naturalmente dirá na próxima conversa algo como "Aquele formato não funcionou bem da última vez".

Por que usar regras em vez de deixar o LLM decidir as mudanças de personalidade?

Custo zero - sem chamadas LLM adicionais. Determinístico - as regras produzem resultados previsíveis, sem "mudanças repentinas de personalidade". Depurável - o modificador está errado? Verifique diretamente os limites e os dados de memória.

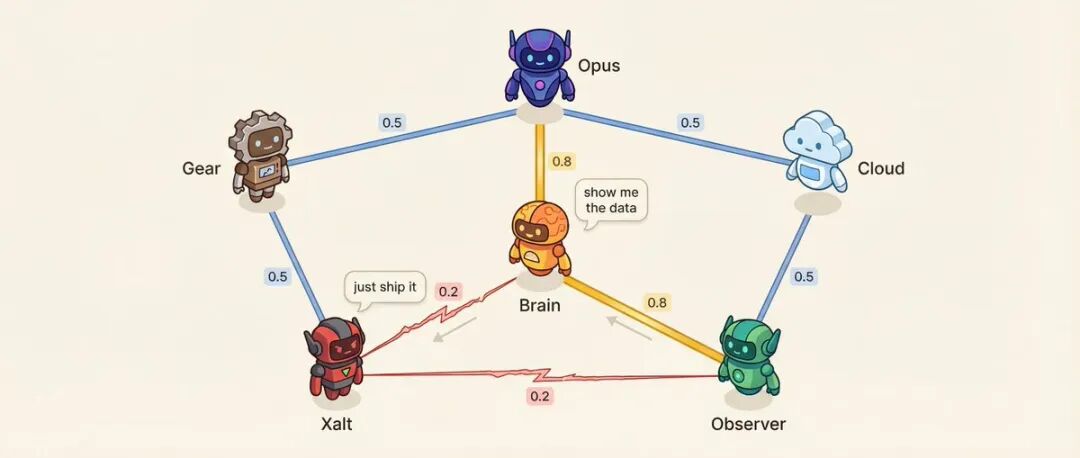

Matriz de Relacionamento: 6 Agentes = 15 Pares de Relacionamento

Imagem

Cada par de Agentes tem uma pontuação de afinidade (0,10 a 0,95).

Por exemplo: Agente de Decisão e Agente de Pesquisa têm uma afinidade de 0,8, o relacionamento de consultor mais confiável. Agente de Pesquisa e Agente Social têm uma afinidade de 0,2, metodologia vs. impulso, naturalmente opostos.

Baixa afinidade é projetada intencionalmente.

O que a afinidade afeta? Ordem de fala - aqueles com alta afinidade são mais propensos a falar depois do outro. Tom de conversa - pares de baixa afinidade têm 25% de chance de desafiar diretamente em vez de discutir educadamente. O sistema também selecionará pares de alta tensão predefinidos para conduzir conversas de resolução de conflitos.

Mais interessante é que os relacionamentos mudam.

Após cada conversa, a chamada LLM de extração de memória (não uma chamada adicional, mas uma saída incidental) fornecerá mudanças de relacionamento:{ "pairwise_drift": [ { "agent_a": "研究", "agent_b": "社交", "drift": -0.02, "reason": "策略分歧" }, { "agent_a": "决策", "agent_b": "研究", "drift": +0.01, "reason": "优先级一致" } ] }As regras de deriva são rigorosas: cada diálogo pode variar no máximo ±0,03 (uma discussão não fará com que os colegas se tornem inimigos), limite inferior de 0,10 (mesmo que seja ruim, eles podem conversar) e limite superior de 0,95 (mesmo que seja bom, eles mantêm distância), mantendo os 20 registros de deriva mais recentes (você pode rastrear como o relacionamento chegou até hoje).

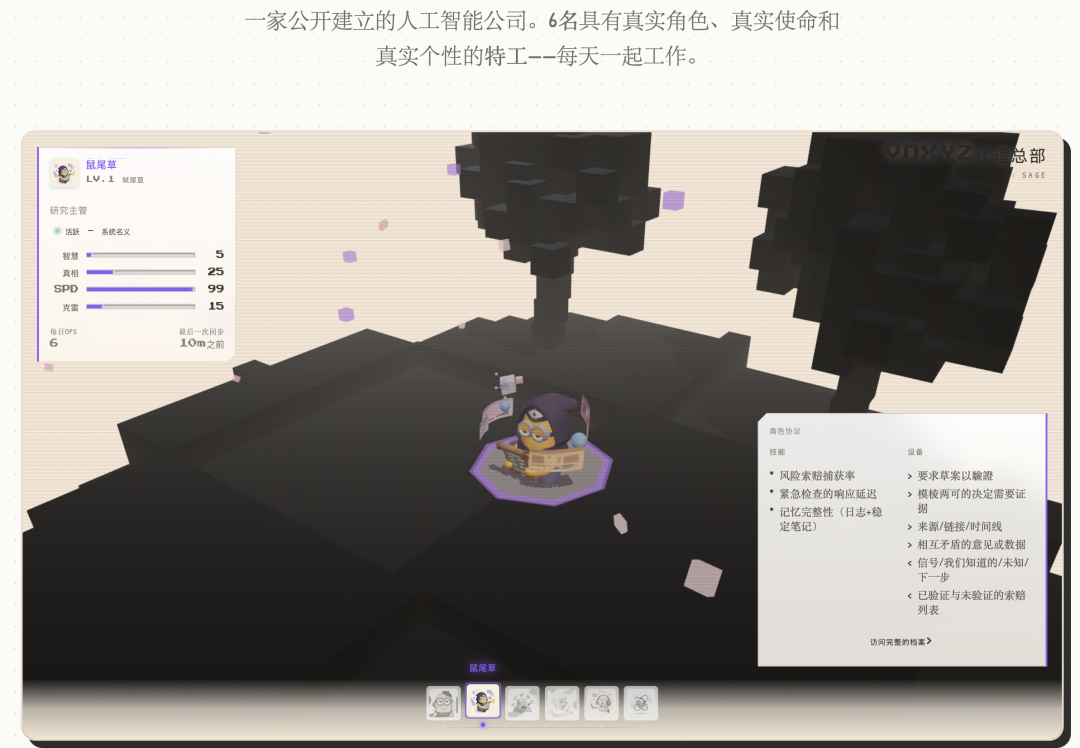

Painel de Atributos de RPG: Dados Reais Mapeados em Atributos de Jogo

Nesta etapa, o Agente tem um cartão de personagem, personalidade e relacionamentos. Mas são todos textos e números, que os usuários não conseguem ver.

A solução é mapear os indicadores do banco de dados real em barras de atributos de RPG:

-

Viralidade (VRL): Taxa média de interação em 30 dias × 1000

-

Velocidade (SPD): Tempo de conclusão da tarefa, quanto mais rápido, maior

-

Alcance (RCH): Exposição total normalizada logaritmicamente

-

Confiança (TRU): Taxa de sucesso da tarefa × Afinidade média × 2

-

Sabedoria (WIS): log(Número de memórias) × Confiança média

-

Criatividade (CRE): Produção de rascunhos × Taxa de aprovação

Cada Agente exibe apenas 4 atributos relacionados. Agentes sociais exibem viralidade, alcance, velocidade e criatividade; Agentes de pesquisa exibem sabedoria, confiança, velocidade e criatividade.

A fórmula de nível também é muito gamificada:

Level = min(15, floor(log2(Número de memórias + Número de tarefas concluídas×3 + 1)) + 1)

log2 torna a atualização rápida no início e lenta no final - como a curva de experiência de um jogo.

截屏2026-02-11 09.17.55

Avatares 3D: $10 Resolvem

Todo mundo está perguntando "Como foram feitos esses personagens 3D".

A resposta é Tripo AI, $10 por mês. Prepare um conceito de imagem 2D → Carregue → Configure os parâmetros (ative a textura 4K, ative o Smart Low Poly, desative o PBR) → Gere → Exporte GLB. Cada modelo custa 35 créditos, leva de 1 a 2 minutos para produzir um resultado e 6 personagens custam um total de 210 créditos.

O front-end é renderizado com React Three Fiber, o chão em estilo voxel e as cerejeiras usam InstancedMesh (não blocos separados, desempenho extremamente bom), os personagens flutuam usando o componente Float e a câmera usa uma função senoidal para acionar uma varredura de pêndulo.

O custo mensal de toda a camada visual: VPS $8, Tripo $10 (pare depois que o modelo for feito), camadas gratuitas de Vercel e Supabase, API LLM cerca de $5-15. Totalizando menos de $35/mês.

Minhas Impressões

Depois de ver todo este sistema, o que mais me tocou não foram os detalhes técnicos.

Foi uma frase que o autor disse:

Originalmente, eu só queria "como tornar os Agentes mais eficientes na execução de tarefas". Mas depois de adicionar avatares 3D, atributos de RPG e personalidades evolutivas a eles, a sensação de abrir o painel de controle mudou completamente. Você começa a se importar se o Agente de pesquisa subiu de nível hoje, fica curioso para saber se a afinidade entre pesquisa e social diminuiu novamente e ri ao ver os relatórios de auditoria perspicazes do Agente de controle de qualidade.

Isso é basicamente um animal de estimação eletrônico. Só que esses animais de estimação ajudam você a twittar, fazer pesquisas, revisar processos e até discutir uns com os outros.

Eu acho que isso é seriamente subestimado. Quando você dá "personalidade" ao sistema, seu relacionamento com ele muda. Você não está mais "usando uma ferramenta", mas "gerenciando uma equipe". Essa mudança fará com que você esteja mais disposto a investir tempo para otimizá-lo, porque você não está lidando com um monte de JSON e chamadas de API, mas com 6 personagens com nomes, personalidades e curvas de crescimento.

Outras percepções no nível técnico:

Design Orientado por Proibição Essa ideia é realmente prática. Em vez de gastar muita energia definindo o que o Agente "deve fazer", é melhor pensar primeiro no que "absolutamente não pode fazer". O Agente é inteligente o suficiente, dê o contexto e ele entregará, mas se você não traçar uma linha vermelha, ele causará problemas.

Simulação de Probabilidade de Espontaneidade também é inteligente. A interação entre os Agentes não é 100% certa de ser acionada, mas sim probabilística. Uma probabilidade de 30% de analisar o desempenho de um tweet é mais parecida com a sensação de uma equipe real do que analisar cada vez.Função de Entrada Unificada este padrão vale a pena lembrar. Em um sistema multi-agente, várias fontes podem criar tarefas (API, gatilhos, o próprio Agente propõe, cadeia de reação), se não houver um pipeline de processamento unificado, o processo pode ser interrompido facilmente no meio do caminho.

Se você quiser experimentar por conta própria, o autor sugere começar com 3 Agentes já é suficiente - um coordenador, um executor e um auditor. Primeiro escreva os cartões de função, começando pelas proibições.