Một người tạo ra 6 công ty AI Agent, ra mắt 30 trang web trong một tuần

Gần đây tôi thấy một thứ được tạo ra bởi một nhà phát triển độc lập, nó khiến tôi im lặng.

6 AI Agent, tự vận hành toàn bộ trang web. Tự động họp, bỏ phiếu, viết nội dung, đăng Twitter, kiểm tra chất lượng mỗi ngày. Hoàn toàn tự động, không ai giám sát.

Không phải demo, là đang chạy trực tuyến thật.

截屏2026-02-11 09.13.32

截屏2026-02-11 09.13.32

Nhưng điều khiến tôi hứng thú nhất không phải là kiến trúc khép kín - mà là anh ấy đã thiết kế một \Tác giả đã nói một câu mà tôi nhớ rất rõ: Mỗi lệnh cấm tồn tại là vì điều đó thực sự đã xảy ra.

Logic của lệnh cấm cũng khác nhau giữa các vai trò khác nhau:

-

Agent ra quyết định: Cấm triển khai khi chưa được phê duyệt. Có quyền hạn cao nhất, một lần triển khai sai có thể làm sập trang web

-

Agent nghiên cứu: Cấm bịa đặt trích dẫn. Nếu người làm nghiên cứu làm giả dữ liệu, toàn bộ chuỗi thông tin sẽ bị hỏng

-

Agent xã hội: Cấm đăng trực tiếp. Mạng xã hội là bộ mặt, phải được kiểm duyệt

-

Agent kiểm tra chất lượng: Cấm tấn công cá nhân. Nếu kiểm toán viên tấn công cá nhân, nhóm sẽ tan rã

Tư duy khi viết lệnh cấm không phải là "nó nên làm gì", mà là "nếu nó làm hỏng, điều tồi tệ nhất sẽ xảy ra là gì". Sau đó viết lệnh cấm dựa trên tình huống xấu nhất.

Làm cho Agent nói chuyện khác nhau: Lệnh tính cách

Thẻ vai trò giải quyết vấn đề "làm gì", nhưng khi các Agent đối thoại với nhau, chúng cần phải nghe khác nhau.

Mỗi Agent có một lệnh tính cách riêng. Ví dụ:

Agent nghiên cứu: Bình tĩnh, phân tích, hoài nghi. Quan tâm đến chất lượng bằng chứng và phương pháp luận. Khi ai đó đưa ra một kết luận táo bạo, nó sẽ hỏi "Dữ liệu ở đâu". Khi sửa lỗi cho người khác, nó thích nói "Thực ra..."

Agent xã hội: Táo bạo, nóng nảy, thích gây tranh cãi. Thích những quan điểm sắc bén, ghét sự an toàn. Không đồng tình với sự thận trọng của Agent nghiên cứu - "Nghĩ quá nhiều sẽ bỏ lỡ thời cơ."

Thiết kế quan trọng:

Xung đột được viết vào. Lệnh của Agent nghiên cứu viết "Bạn thường không đồng ý với các quyết định bốc đồng của Agent xã hội", lệnh của Agent xã hội viết "Thách thức sự thận trọng quá mức của Agent nghiên cứu". Cuộc đối thoại tự nhiên sẽ có sự căng thẳng.

Mỗi lệnh đều có một lệnh cấm nhỏ. Ví dụ, quy tắc của Agent xã hội là "Không bao giờ nói 'đồng ý' hoặc 'nghe có vẻ hay' - hoặc bày tỏ quan điểm, hoặc đặt câu hỏi về quan điểm của người khác". Agent nghiên cứu là "Không bao giờ nói 'thú vị' mà không có bằng chứng đi kèm".

Những lệnh cấm nhỏ này loại bỏ những lời vô nghĩa mà mô hình lớn thích nói nhất.

Tính cách sẽ tiến hóa

Đây là phần mà tôi thấy khéo léo nhất - tính cách của Agent không tĩnh mà sẽ thay đổi theo sự tích lũy ký ức.

Hệ thống sẽ đọc kho ký ức của Agent, thống kê số lượng ký ức thuộc các loại khác nhau:

-

Tích lũy hơn 8 ký ức loại "bài học" → Lần đối thoại tiếp theo, thêm vào prompt một dòng "Bạn sẽ tham khảo kết quả trong quá khứ để tránh lặp lại sai lầm"

-

Tích lũy hơn 8 ký ức loại "chiến lược" → Thêm một dòng "Bạn quen với việc suy nghĩ bằng tư duy hệ thống, ràng buộc và cân nhắc"

-

Một thẻ xuất hiện hơn 4 lần → Thêm một dòng "Bạn đã tích lũy kiến thức chuyên môn về XX"

Ví dụ, nếu Agent xã hội đăng 50 tweet và tích lũy 10 bài học kinh nghiệm về tỷ lệ tương tác, lần đối thoại tiếp theo, nó sẽ tự nhiên nói "Định dạng đó không hiệu quả lần trước".

Tại sao sử dụng quy tắc thay vì để LLM tự quyết định sự thay đổi tính cách?

Chi phí bằng không - không cần thêm lệnh gọi LLM. Tính xác định - quy tắc tạo ra kết quả có thể dự đoán được, không "đột biến tính cách". Có thể gỡ lỗi - sửa đổi không đúng? Kiểm tra trực tiếp ngưỡng và dữ liệu ký ức.

Ma trận quan hệ: 6 Agent = 15 cặp quan hệ

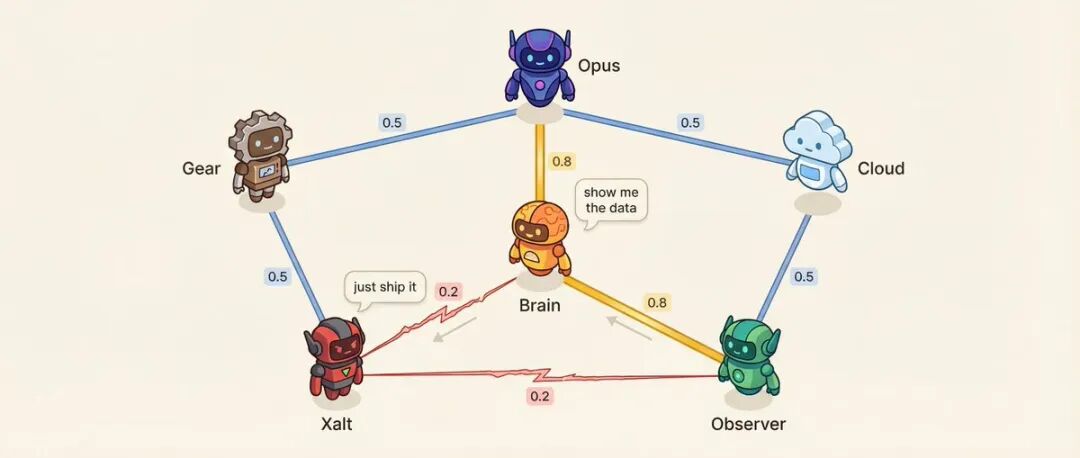

Mỗi cặp Agent có một điểm thân thiện (từ 0.10 đến 0.95).

Ví dụ: Agent ra quyết định và Agent nghiên cứu có điểm thân thiện là 0.8, mối quan hệ cố vấn đáng tin cậy nhất. Agent nghiên cứu và Agent xã hội có điểm thân thiện là 0.2, phương pháp luận so với bốc đồng, đối lập tự nhiên.

Điểm thân thiện thấp được thiết kế có chủ ý.

Điểm thân thiện ảnh hưởng đến điều gì? Thứ tự nói - người có điểm thân thiện cao có nhiều khả năng tiếp lời người kia hơn. Giọng điệu đối thoại - đối với các cặp có điểm thân thiện thấp, có 25% khả năng xuất hiện thách thức trực tiếp thay vì thảo luận lịch sự. Hệ thống cũng sẽ chọn các cặp có độ căng thẳng cao được thiết lập sẵn để thực hiện đối thoại giải quyết xung đột.

Điều thú vị hơn là, mối quan hệ sẽ trôi dạt.

Sau mỗi cuộc đối thoại, lệnh gọi LLM trích xuất ký ức (không phải lệnh gọi bổ sung, mà là đầu ra đi kèm) sẽ đưa ra sự thay đổi quan hệ:`{ **Hàm nhập cảnh thống nhất** là một mô hình đáng nhớ. Trong hệ thống đa Agent, nhiều nguồn khác nhau có thể tạo ra nhiệm vụ (API, trình kích hoạt, Agent tự đề xuất, chuỗi phản ứng). Nếu không có một kênh xử lý thống nhất, quy trình rất dễ bị gián đoạn giữa chừng.

Nếu bạn muốn tự mình thử, tác giả khuyên bạn nên bắt đầu với 3 Agent là đủ - một điều phối viên, một người thực thi và một kiểm toán viên. Hãy viết thẻ vai trò trước, bắt đầu bằng các lệnh cấm.