Anthropic's 350 Milliarden Dollar Bewertung und das OpenClaw Paradoxon

Mitte Februar schloss Anthropic eine Finanzierungsrunde von 30 Milliarden Dollar ab und erreichte eine Bewertung von 350 Milliarden Dollar. Diese Zahl übersteigt die Gesamtmarktkapitalisierung der Top-10-IT-Unternehmen Indiens (ca. 350 Milliarden Dollar, 1,6 Millionen Mitarbeiter), während Anthropic nur 3000 Mitarbeiter hat.

Aber in derselben Woche enthüllte die Geschichte eines Open-Source-Projekts namens OpenClaw, dass dieses Unternehmen möglicherweise auf strategischer Ebene Fehler begeht.

Die Logik der 30 Milliarden Dollar

Der Kapitalfluss zeigt die Erwartungen des Marktes. Im Rahmen der Konkursliquidation von FTX wurden die von FTX gehaltenen Anthropic-Anteile für etwa 1,3 Milliarden Dollar verkauft. Wenn diese Investition bis heute gehalten worden wäre, wäre sie möglicherweise 20 bis 30 Milliarden Dollar wert.

Die Logik der Investoren ist einfach:

- Technologische Führung: Opus 4.6 erzielt im FrontierMath-Benchmark 40 %, was im Wesentlichen mit GPT-5.2 übereinstimmt.

- Produktdynamik: Die Zahl der wöchentlich aktiven Benutzer von Claude Code hat sich seit Januar verdoppelt, und 4 % der GitHub-Commits stammen bereits von Claude Code.

- Kommerzialisierungspfad: Es wird erwartet, dass das Unternehmen im Jahr 2028 profitabel sein wird und an seiner Produktstrategie ohne Werbung festhält.

Aber die Bewertung ist eine Wette auf die Zukunft, und die Zukunft ist voller strategischer Risiken.

OpenClaw-Ereignis: Eine Analyse einer PR-Katastrophe

Peter Steinberger entwickelte OpenClaw, ein Open-Source-KI-Programmiertool, das auf der Claude API basiert. Die Anwälte von Anthropic schickten eine Unterlassungserklärung mit der Begründung, der Name sei dem Namen "Claude" zu ähnlich.

Was war das Ergebnis? Steinberger benannte das Projekt in Moltbot um und wurde dann von OpenAI übernommen, wobei er das gesamte Projekt und die Community mitbrachte.

Einheitliche Kommentare auf X:

"Anthropic really fumbled the bag on the OpenClaw arc" "anthropic lost the opportunity - openclaw + Claude code would be a game changer" "Generational fumble from Anthropic"

Dies ist kein rechtliches Problem, sondern ein strategisches Problem. Die Anzahl der GitHub-Sterne von OpenClaw übersteigt bereits die von VS Code und ist dreimal so hoch wie die von Claude Code. Es ist eine Open-Source-Plattform, was bedeutet, dass sie das Vertrauen und die Aufmerksamkeit der unabhängigen Entwickler-Community repräsentiert.

Durch die Übernahme von OpenClaw hätte Anthropic drei Dinge erhalten können:

- Das Vertrauen der Open-Source-Community

- Plattformübergreifende Fähigkeiten (OpenClaw unterstützt Windows, während Claude Code hauptsächlich unter macOS läuft)

- Einen Einstieg in das Entwickler-Ökosystem

Aber Anthropic hat sich für rechtliche Schritte entschieden. OpenAI hat alles mühelos bekommen.

Zwei Dimensionen der Plattformstrategie

Aus Sicht der Plattformstrategie gibt es hier zwei wichtige Beobachtungen:

Erstens wiederholt Anthropic die Fehler von Microsoft.

In den 2010er Jahren stand Microsoft der Open-Source-Community feindlich gegenüber, was dazu führte, dass das Unternehmen die Aufmerksamkeit einer ganzen Generation von Entwicklern verlor. Später reparierte Satya Nadella die Beziehung allmählich durch die Übernahme von GitHub, die Unterstützung von Linux und die Unterstützung von Open Source.

Die Art und Weise, wie Anthropic mit OpenClaw umgegangen ist, erinnert an Microsoft aus dieser Zeit – ein Rechtsteam löst Probleme, die eigentlich von einem Strategieteam gelöst werden sollten.

Zweitens kann man den Benutzereingang nur kontrollieren, wenn man die Werkzeugschicht kontrolliert.

OpenAI hat OpenClaw nicht wegen der Technologie übernommen, sondern wegen der Entwickler-Aggregationsplattform. Wenn das Modell selbst zu einer standardisierten Ware wird, kontrolliert derjenige den Benutzereingang, der die Werkzeugschicht kontrolliert.

Die Strategie von Claude Code ist tiefes Verständnis – zuerst den Code lesen, dann handeln. Die Strategie von Codex ist Anwendung zuerst, Modelliteration, Akquisition und Integration. Es gibt kein Richtig oder Falsch bei den beiden Pfaden, aber nur einer erweitert aktiv die ökologischen Grenzen.## Das Pentagon-Paradoxon

In derselben Woche tauchte eine weitere Geschichte auf: Das Pentagon erwägt, die Beziehungen zu Anthropic abzubrechen, weil Anthropic darauf besteht, militärische Nutzungen seiner KI-Modelle einzuschränken.

Oberflächlich betrachtet ist dies eine Frage der Werte – Anthropic wurde vom ehemaligen OpenAI-Sicherheitsteam gegründet, und KI-Sicherheit ist sein Kerngen. Aber aus strategischer Sicht ist dies ein Problem der Grenzenziehung.

Wenn Anthropic auf der Beschränkung militärischer Nutzungen besteht:

- Verliert es Einnahmen aus Regierungsaufträgen

- Verliert es möglicherweise Forschungskooperationen mit dem Pentagon

- Behält aber seine Markenpositionierung im Bereich KI-Sicherheit

Wenn Anthropic sich vollständig öffnet:

- Erhält es Regierungseinnahmen

- Weicht aber möglicherweise von seiner Sicherheitsmission ab

- Löst es ethische Dilemmata innerhalb des internen Teams aus

Es gibt keine perfekte Antwort. Es ist jedoch erwähnenswert, dass dasselbe Anthropic rechtliche Mittel gegen Open-Source-Entwickler einsetzt, aber auf Prinzipien bei militärischen Nutzungen besteht. Diese Inkonsistenz könnte in Zukunft größere Markenrisiken verursachen.

Die Prophezeiung des CEO und das Einstellungs-Paradoxon

Dario Amodei hat in mehreren öffentlichen Auftritten erklärt, dass Software Engineering innerhalb von 6-12 Monaten von KI "vollständig ersetzt" werden wird.

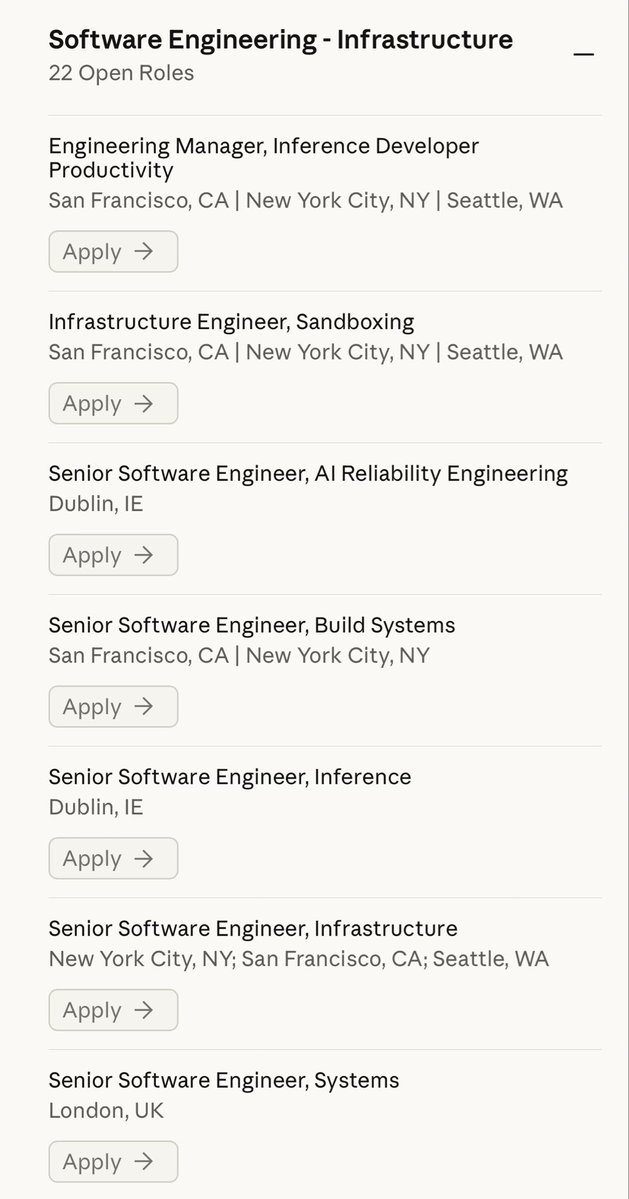

Ironischerweise stellt Anthropic zur gleichen Zeit weiterhin massiv Softwareentwickler ein.

Kommentar auf X:

"At this point, I'm sure the Anthropic CEO is deliberately pushing the 'developers are becoming obsolete' narrative just to grab attention on X."

Dies ist kein einfacher Widerspruch. Amodeis Vorhersage mag aufrichtig sein – aber eine aufrichtige Vorhersage ist nicht gleichbedeutend mit einer richtigen Vorhersage. Noch wichtiger ist, dass diese Art von Aussage die Kernzielgruppe von Anthropic entfremdet: Entwickler.

Wenn Ihr CEO sagt, dass ein Beruf innerhalb eines Jahres verschwinden wird, und dieser Beruf zufällig der Hauptnutzer Ihres Produkts ist, können die Kosten dieser PR-Strategie höher sein als erwartet.

Technische Fähigkeiten vs. strategische Blindheit

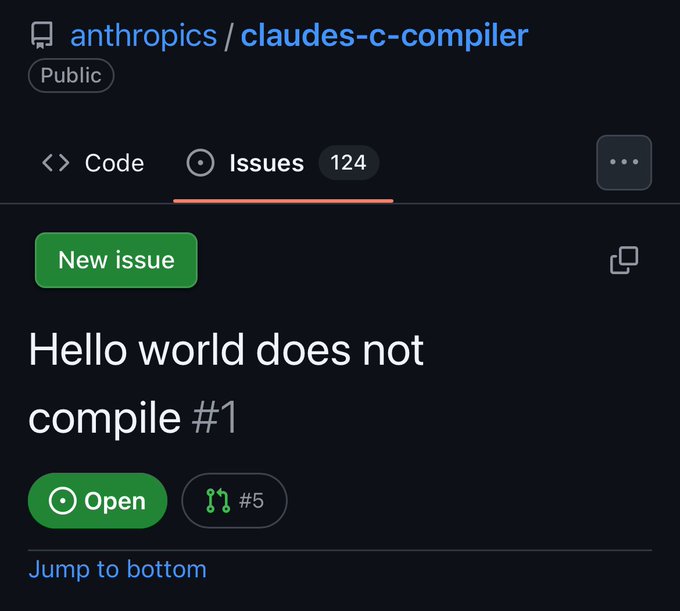

Die technischen Fähigkeiten von Anthropic sind real. 16 Claude Agents schrieben von Grund auf einen 100.000 Zeilen langen Rust-Compiler, der den Linux-Kernel kompilieren kann. Dies ist das Ergebnis von 2000 Sitzungen und 20.000 US-Dollar an API-Gebühren.

Aber technische Führung bedeutet nicht gleich strategische Richtigkeit. Die Geschichte ist voll von Fällen, in denen Unternehmen technisch führend waren, aber strategische Fehler begangen haben:

- Netscape hatte den besten Browser, verlor aber gegen Microsofts Bündelungsstrategie

- BlackBerry hatte das beste Business-Handy, verlor aber gegen das Ökosystem von iPhone

- Yahoo hatte das beste Verzeichnis, verlor aber gegen Googles Suchalgorithmus

Anthropic befindet sich jetzt in einer ähnlichen Position wie Netscape im Jahr 1996 – technisch führend, aber die Konkurrenz nähert sich aus mehreren Richtungen.

The Bottom Line

Die 350 Milliarden Dollar Bewertung von Anthropic basiert auf einer Annahme: Technologieführerschaft kann in einen nachhaltigen Wettbewerbsvorteil umgewandelt werden.

Aber der OpenClaw-Vorfall hat die Fragilität dieser Annahme aufgedeckt. Wenn die Modellfähigkeiten homogen werden, wird das Entwickler-Ökosystem zum einzigen Burggraben. Und beim Aufbau des Ökosystems begeht Anthropic strategische Fehler:

- Behandlung der Open-Source-Community mit rechtlichen Mitteln anstelle strategischer Zusammenarbeit

- Entfremdung der Kernzielgruppe durch reißerische Aussagen

- Ermöglichung des Sieges der Konkurrenz ohne Kampf im Plattformkrieg

30 Milliarden Dollar kaufen die Zukunft. Aber wenn die strategische Ausrichtung falsch ist, kann auch das meiste Geld den Verlust von Marktanteilen nicht ausgleichen.Für Entwickler und Investoren ist dies eine Frage, die es wert ist, darüber nachzudenken: Setzen Sie im Plattformkrieg der KI auf technische Fähigkeiten oder auf eine Ökosystemstrategie?