L'évaluation de 350 milliards de dollars d'Anthropic et le paradoxe OpenClaw

À la mi-février, Anthropic a conclu un cycle de financement de 30 milliards de dollars, atteignant une évaluation de 350 milliards de dollars. Ce chiffre dépasse la capitalisation boursière totale des dix plus grandes entreprises informatiques indiennes (environ 350 milliards de dollars, avec 1,6 million d'employés), alors qu'Anthropic ne compte que 3 300 employés.

Mais la même semaine, l'histoire d'un projet open source appelé OpenClaw a révélé les erreurs stratégiques potentielles que cette entreprise pourrait commettre.

La logique derrière 30 milliards de dollars

Les flux de capitaux indiquent les attentes du marché. Lors de la liquidation de la faillite de FTX, ses actions d'Anthropic ont été vendues pour environ 1,3 milliard de dollars. Si elles avaient été conservées jusqu'à présent, cet investissement pourrait valoir entre 20 et 30 milliards de dollars.

La logique des investisseurs est simple :

- Leadership technologique : Opus 4.6 obtient un score de 40 % au test de référence FrontierMath, ce qui est pratiquement équivalent à GPT-5.2.

- Dynamique du produit : Les utilisateurs actifs hebdomadaires de Claude Code ont doublé depuis janvier, et 4 % des soumissions GitHub proviennent déjà de Claude Code.

- Voie de commercialisation : Rentabilité prévue en 2028, avec une stratégie de produit sans publicité.

Mais l'évaluation est un pari sur l'avenir, et l'avenir est rempli de risques stratégiques.

L'incident OpenClaw : une analyse d'une catastrophe de relations publiques

Peter Steinberger a développé OpenClaw, un outil de programmation d'IA open source basé sur l'API Claude. Les avocats d'Anthropic ont envoyé une lettre de cessation et d'abstention, au motif que le nom était similaire à "Claude".

Quel a été le résultat ? Steinberger a renommé le projet Moltbot, puis a été acquis par OpenAI, emmenant avec lui l'ensemble du projet et de la communauté.

Commentaires unanimes sur X :

"Anthropic really fumbled the bag on the OpenClaw arc" "anthropic lost the opportunity - openclaw + Claude code would be a game changer" "Generational fumble from Anthropic"

Ce n'est pas un problème juridique, c'est un problème stratégique. Le nombre d'étoiles GitHub d'OpenClaw a déjà dépassé celui de VS Code, et est trois fois supérieur à celui de Claude Code. Il s'agit d'une plateforme open source, ce qui signifie qu'elle représente la confiance et l'attention de la communauté des développeurs indépendants.

En acquérant OpenClaw, Anthropic aurait pu obtenir trois choses :

- La confiance de la communauté open source

- Des capacités multiplateformes (OpenClaw prend en charge Windows, tandis que Claude Code est principalement sur macOS)

- Un point d'entrée dans l'écosystème des développeurs

Mais Anthropic a choisi la voie juridique. OpenAI a tout obtenu sans effort.

Les deux dimensions d'une stratégie de plateforme

D'un point de vue stratégique de plateforme, voici deux observations clés :

Premièrement, Anthropic répète les erreurs de Microsoft.

Dans les années 2010, Microsoft avait une attitude hostile envers la communauté open source, ce qui a entraîné la perte de la part d'esprit de toute une génération de développeurs. Plus tard, Satya Nadella a progressivement réparé les relations en acquérant GitHub, en adoptant Linux et en soutenant l'open source.

La façon dont Anthropic a géré OpenClaw rappelle l'époque de Microsoft - utiliser l'équipe juridique pour résoudre un problème qui aurait dû être résolu par l'équipe stratégique.

Deuxièmement, contrôler la couche d'outils permet de contrôler le point d'entrée de l'utilisateur.

OpenAI n'a pas acquis OpenClaw pour la technologie, mais pour une plateforme d'agrégation de développeurs. Lorsque le modèle lui-même devient une commodité banalisée (commoditized commodity), celui qui contrôle la couche d'outils contrôle le point d'entrée de l'utilisateur.

La stratégie de Claude Code est une compréhension approfondie - lire le code avant d'agir. La stratégie de Codex est l'application d'abord, l'itération du modèle, l'acquisition et l'intégration. Il n'y a pas de bien ou de mal dans les deux voies, mais une seule élargit activement les frontières de l'écosystème.## Le paradoxe du Pentagone

La même semaine, une autre histoire a fait surface : le Pentagone envisage de rompre ses liens avec Anthropic en raison de l'insistance d'Anthropic à imposer des restrictions sur l'utilisation militaire de ses modèles d'IA.

En apparence, il s'agit d'une question de valeurs - Anthropic a été créé par l'ancienne équipe de sécurité d'OpenAI, et la sécurité de l'IA est son gène central. Mais d'un point de vue stratégique, il s'agit d'une question de définition des limites.

Si Anthropic insiste pour limiter les utilisations militaires :

- Perte de revenus provenant des contrats gouvernementaux

- Perte potentielle d'opportunités de collaboration de recherche avec le Pentagone

- Mais maintien d'un positionnement de marque axé sur la sécurité de l'IA

Si Anthropic est complètement ouvert :

- Obtention de revenus gouvernementaux

- Mais risque de s'éloigner de sa mission de sécurité

- Provoque des dilemmes éthiques au sein de l'équipe interne

Il n'y a pas de réponse parfaite. Mais il est important de noter que ce même Anthropic utilise des moyens légaux contre les développeurs open source, tout en adhérant à des principes pour les utilisations militaires. Cette incohérence pourrait créer des risques de marque encore plus importants à l'avenir.

La prophétie du PDG et le paradoxe du recrutement

Dario Amodei a déclaré à plusieurs reprises en public que le génie logiciel serait "complètement remplacé" par l'IA dans les 6 à 12 mois.

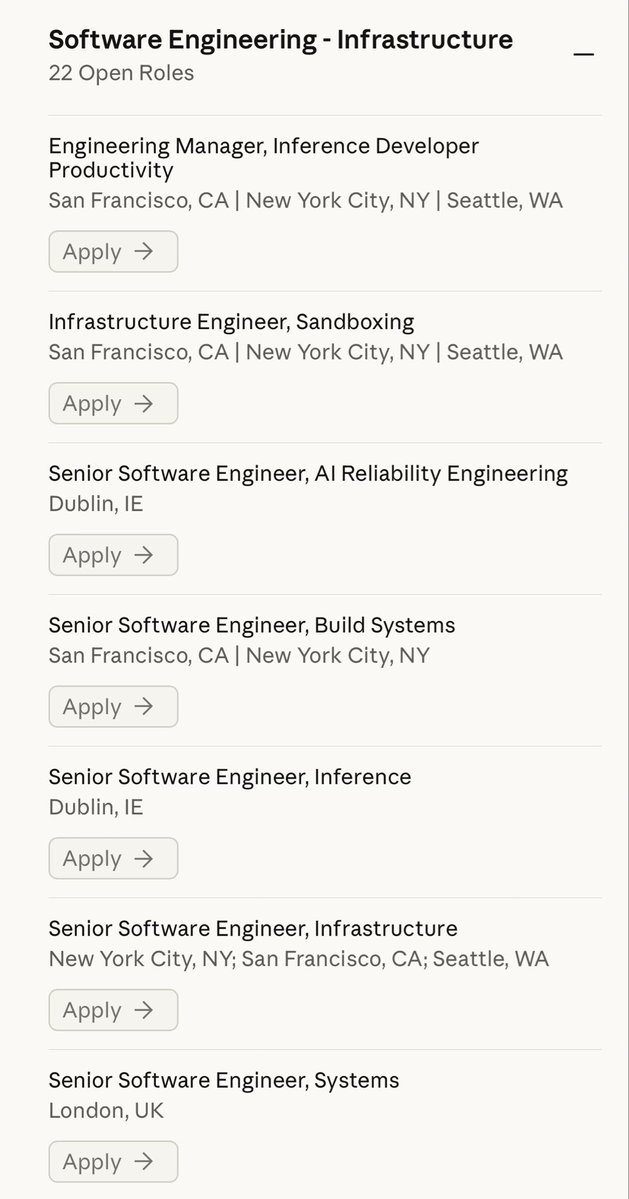

Ironiquement, Anthropic continue de recruter massivement des ingénieurs logiciels en même temps.

Commentaire sur X :

"At this point, I'm sure the Anthropic CEO is deliberately pushing the 'developers are becoming obsolete' narrative just to grab attention on X."

Ce n'est pas une simple contradiction. La prédiction d'Amodei est peut-être sincère - mais une prédiction sincère n'est pas synonyme de prédiction correcte. Plus important encore, ce genre de discours est en train d'aliéner le groupe d'utilisateurs le plus important d'Anthropic : les développeurs.

Lorsque votre PDG dit qu'une profession va disparaître dans un an, et que cette profession est précisément le principal utilisateur de votre produit, le coût de cette stratégie de relations publiques pourrait être plus élevé qu'on ne l'imagine.

Capacité technique et angle mort stratégique

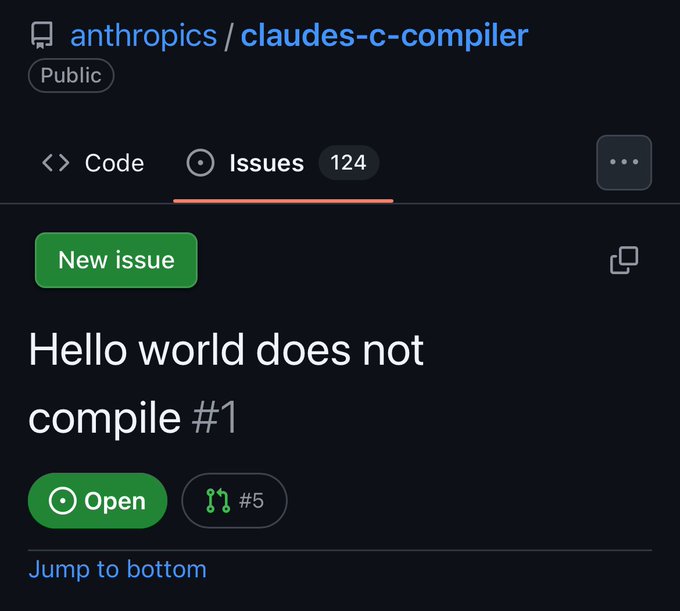

Les capacités techniques d'Anthropic sont réelles. 16 Claude Agent ont écrit à partir de zéro un compilateur Rust de 100 000 lignes, capable de compiler le noyau Linux. C'est le résultat de 2000 sessions et de 20 000 $ de frais d'API.

Mais le leadership technologique n'est pas synonyme de stratégie correcte. L'histoire est remplie d'exemples de leadership technologique mais d'erreurs stratégiques :

- Netscape avait le meilleur navigateur, mais a perdu face à la stratégie de regroupement de Microsoft

- BlackBerry avait le meilleur téléphone d'entreprise, mais a perdu face à l'écosystème de l'iPhone

- Yahoo avait le meilleur annuaire, mais a perdu face à l'algorithme de recherche de Google

La position d'Anthropic est maintenant similaire à celle de Netscape en 1996 - un leadership technologique, mais des concurrents l'encerclent de toutes parts.

The Bottom Line

La valorisation de 350 milliards de dollars d'Anthropic repose sur une hypothèse : le leadership technologique peut se traduire par un avantage concurrentiel durable.

Mais l'incident OpenClaw a révélé la fragilité de cette hypothèse. Lorsque les capacités des modèles tendent à s'homogénéiser, l'écosystème des développeurs deviendra le seul rempart. Et dans la construction de l'écosystème, Anthropic commet des erreurs stratégiques :

- Traiter la communauté open source avec des moyens légaux plutôt qu'avec une collaboration stratégique

- Aliénation du groupe d'utilisateurs principaux avec des remarques sensationnalistes

- Laisser les concurrents gagner la guerre des plateformes sans combattre

30 milliards de dollars achètent l'avenir. Mais si la direction stratégique est mauvaise, même plus de fonds ne peuvent compenser la perte de part d'esprit.Pour les développeurs et les investisseurs, c'est une question qui mérite réflexion : dans la guerre des plateformes de l'IA, vous pariez sur les capacités techniques, ou une stratégie d'écosystème?