La valutazione di 350 miliardi di dollari di Anthropic e il paradosso di OpenClaw

A metà febbraio, Anthropic ha completato un round di finanziamento da 30 miliardi di dollari, raggiungendo una valutazione di 350 miliardi di dollari. Questa cifra supera la capitalizzazione di mercato totale delle prime dieci società IT indiane (circa 350 miliardi di dollari, con 1,6 milioni di dipendenti), mentre Anthropic ha solo 3.000 dipendenti.

Ma nella stessa settimana, la storia di un progetto open source chiamato OpenClaw ha rivelato un possibile errore strategico che l'azienda potrebbe star commettendo.

La logica dietro i 30 miliardi di dollari

Il flusso di capitali indica le aspettative del mercato. Nella liquidazione fallimentare di FTX, le sue azioni di Anthropic sono state vendute per circa 1,3 miliardi di dollari. Se mantenuto fino ad oggi, questo investimento potrebbe valere 20-30 miliardi di dollari.

La logica degli investitori è semplice:

- Leadership tecnologica: Opus 4.6 ha ottenuto un punteggio del 40% nel benchmark FrontierMath, sostanzialmente alla pari con GPT-5.2

- Slancio del prodotto: gli utenti attivi settimanali di Claude Code sono raddoppiati da gennaio, il 4% dei commit di GitHub proviene già da Claude Code

- Percorso di commercializzazione: si prevede di raggiungere la redditività nel 2028, mantenendo una strategia di prodotto senza pubblicità

Ma la valutazione è una scommessa sul futuro, e il futuro è pieno di rischi strategici.

L'incidente di OpenClaw: un'analisi di un disastro PR

Peter Steinberger ha sviluppato OpenClaw, uno strumento di programmazione AI open source basato sull'API Claude. Gli avvocati di Anthropic hanno inviato una lettera di diffida, adducendo come motivo la somiglianza del nome con "Claude".

Il risultato? Steinberger ha rinominato il progetto Moltbot, che è stato poi acquisito da OpenAI, portando con sé l'intero progetto e la comunità.

Commenti unanimi su X:

"Anthropic really fumbled the bag on the OpenClaw arc" "anthropic lost the opportunity - openclaw + Claude code would be a game changer" "Generational fumble from Anthropic"

Questo non è un problema legale, è un problema strategico. Le stelle di OpenClaw su GitHub hanno già superato VS Code, e sono tre volte quelle di Claude Code. È una piattaforma open source, il che significa che rappresenta la fiducia e l'attenzione della comunità di sviluppatori indipendenti.

Acquisendo OpenClaw, Anthropic avrebbe potuto ottenere tre cose:

- La fiducia della comunità open source

- Capacità multipiattaforma (OpenClaw supporta Windows, mentre Claude Code è principalmente su macOS)

- Un punto di ingresso nell'ecosistema degli sviluppatori

Ma Anthropic ha scelto la via legale. OpenAI ha ottenuto tutto senza sforzo.

Le due dimensioni della strategia di piattaforma

Da un punto di vista strategico della piattaforma, ci sono due osservazioni chiave:

Primo, Anthropic sta ripetendo gli errori di Microsoft.

Negli anni 2010, Microsoft aveva un atteggiamento ostile nei confronti della comunità open source, con il risultato di perdere la quota di mercato nella mente di un'intera generazione di sviluppatori. Successivamente, Satya Nadella ha gradualmente riparato i rapporti acquisendo GitHub, abbracciando Linux e supportando l'open source.

Il modo in cui Anthropic ha gestito OpenClaw ricorda la Microsoft di quell'epoca: usare il team legale per risolvere problemi che avrebbero dovuto essere risolti dal team strategico.

Secondo, controllare il livello degli strumenti significa controllare il punto di ingresso degli utenti.

OpenAI ha acquisito OpenClaw non per la tecnologia, ma per una piattaforma di aggregazione di sviluppatori. Quando il modello stesso diventa una commodity standardizzata, chi controlla il livello degli strumenti controlla il punto di ingresso degli utenti.

La strategia di Claude Code è la comprensione profonda: prima leggere il codice, poi agire. La strategia di Codex è l'applicazione prima di tutto, l'iterazione del modello e l'integrazione tramite acquisizioni. Non c'è giusto o sbagliato tra le due strade, ma solo una sta attivamente espandendo i confini dell'ecosistema.## Il paradosso del Pentagono

Nella stessa settimana, è emersa un'altra storia: il Pentagono sta valutando di interrompere i rapporti con Anthropic a causa dell'insistenza di Anthropic nell'imporre restrizioni sull'uso militare dei suoi modelli di IA.

In superficie, si tratta di una questione di valori: Anthropic è stata creata dall'ex team di sicurezza di OpenAI e la sicurezza dell'IA è il suo DNA principale. Ma da un punto di vista strategico, si tratta di una questione di definizione dei confini.

Se Anthropic insiste nel limitare l'uso militare:

- Perde entrate da contratti governativi

- Potrebbe perdere opportunità di collaborazione nella ricerca con il Pentagono

- Ma mantiene il posizionamento del marchio sulla sicurezza dell'IA

Se Anthropic è completamente aperta:

- Ottiene entrate governative

- Ma potrebbe allontanarsi dalla sua missione di sicurezza

- Innesca dilemmi etici all'interno del team

Non esiste una risposta perfetta. Ma vale la pena notare che la stessa Anthropic, che usa mezzi legali contro gli sviluppatori open source, insiste sui principi per quanto riguarda l'uso militare. Questa incoerenza potrebbe causare maggiori rischi per il marchio in futuro.

La profezia del CEO e il paradosso dell'assunzione

Dario Amodei ha dichiarato in diverse occasioni pubbliche che l'ingegneria del software sarà "completamente sostituita" dall'IA entro 6-12 mesi.

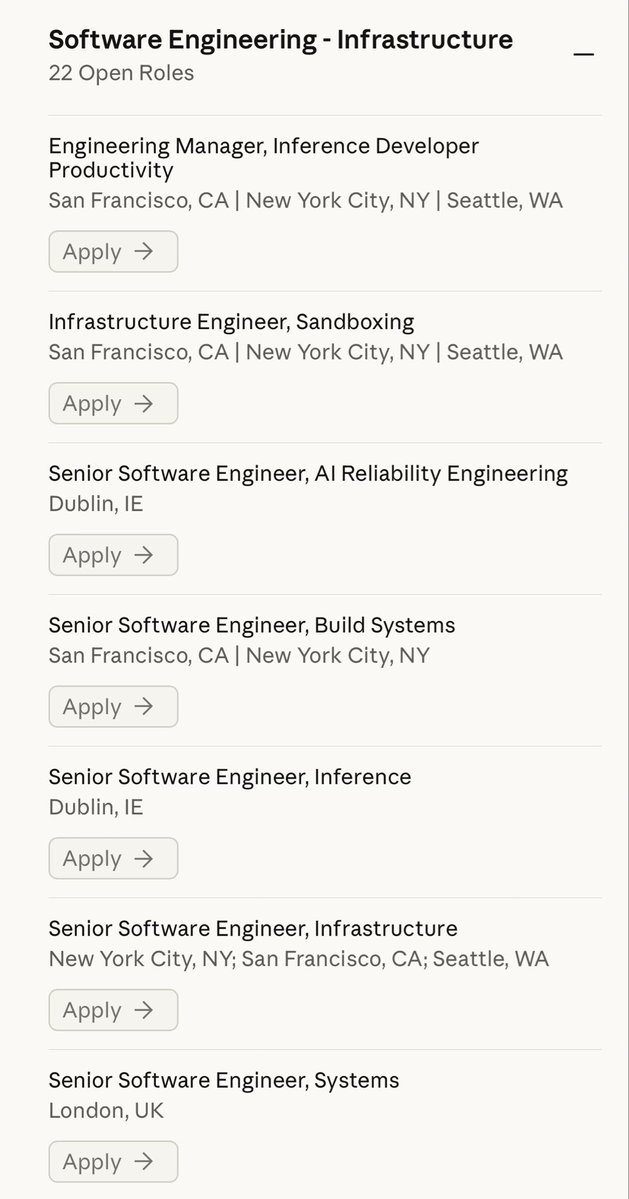

Ironicamente, nello stesso periodo Anthropic sta ancora assumendo un gran numero di ingegneri del software.

Commento su X:

"A questo punto, sono sicuro che il CEO di Anthropic stia deliberatamente spingendo la narrativa 'gli sviluppatori stanno diventando obsoleti' solo per attirare l'attenzione su X."

Non si tratta di una semplice contraddizione. La previsione di Amodei potrebbe essere sincera, ma una previsione sincera non equivale a una previsione corretta. Ancora più importante, questo tipo di affermazioni sta alienando il gruppo di utenti più importante di Anthropic: gli sviluppatori.

Quando il tuo CEO dice che una professione scomparirà entro un anno, e questa professione è proprio quella degli utenti principali del tuo prodotto, il costo di questa strategia di pubbliche relazioni potrebbe essere più alto del previsto.

Capacità tecnica e punti ciechi strategici

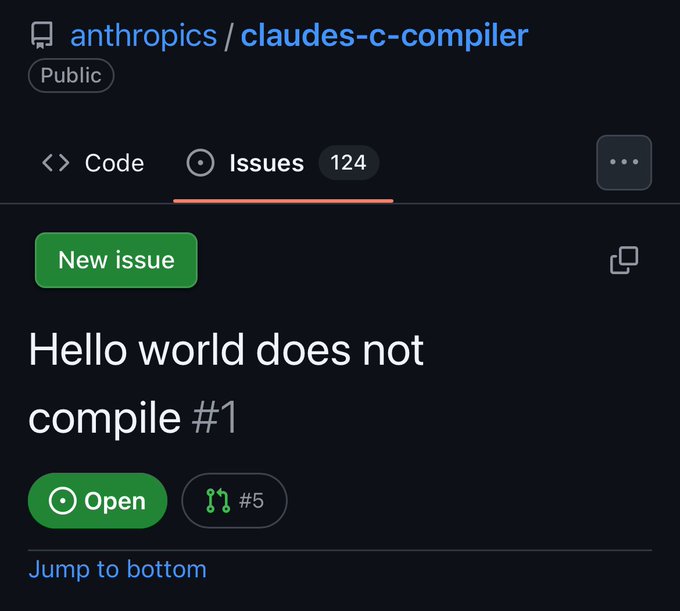

Le capacità tecniche di Anthropic sono reali. 16 Claude Agent hanno scritto da zero un compilatore Rust di 100.000 righe, in grado di compilare il kernel di Linux. Questo è il risultato di 2000 sessioni e 20.000 dollari di costi API.

Ma la leadership tecnologica non equivale a una strategia corretta. La storia è piena di casi di leadership tecnologica ma errori strategici:

- Netscape aveva il miglior browser, ma ha perso contro la strategia di bundling di Microsoft

- BlackBerry aveva il miglior telefono aziendale, ma ha perso contro l'ecosistema di iPhone

- Yahoo aveva la migliore directory, ma ha perso contro l'algoritmo di ricerca di Google

La posizione di Anthropic è simile a quella di Netscape nel 1996: leader tecnologico, ma i concorrenti stanno circondando da più direzioni.

The Bottom Line

La valutazione di 350 miliardi di dollari di Anthropic si basa su un presupposto: la leadership tecnologica può tradursi in un vantaggio competitivo sostenibile.

Ma l'incidente di OpenClaw ha esposto la fragilità di questo presupposto. Quando le capacità del modello tendono all'omogeneizzazione, l'ecosistema degli sviluppatori diventerà l'unico fossato. E nella costruzione dell'ecosistema, Anthropic sta commettendo errori strategici:

- Trattare la comunità open source con mezzi legali anziché con partnership strategiche

- Alienare il gruppo di utenti principali con affermazioni sensazionalistiche

- Lasciare che i concorrenti vincano senza combattere nella guerra delle piattaforme

30 miliardi di dollari comprano il futuro. Ma se la direzione strategica è sbagliata, nessun capitale può compensare la perdita di quota di mercato nella mente dei consumatori.Per sviluppatori e investitori, questa è una domanda che merita una riflessione: nella guerra delle piattaforme AI, scommetti sulle capacità tecnologiche o sulla strategia dell'ecosistema?