Anthropic's waardering van $350 miljard en de OpenClaw-paradox

Midden februari voltooide Anthropic een financieringsronde van $30 miljard, waardoor de waardering op $350 miljard kwam. Dit cijfer overtreft de totale marktwaarde van de top 10 IT-bedrijven in India (ongeveer $350 miljard, met 1,6 miljoen werknemers), terwijl Anthropic slechts 3000 werknemers heeft.

Maar in dezelfde week onthulde het verhaal van een open-source project genaamd OpenClaw een mogelijke strategische fout die dit bedrijf maakt.

De logica achter $30 miljard

De geldstroom geeft de verwachtingen van de markt aan. In de faillissementsliquidatie van FTX werden de aandelen van Anthropic verkocht voor ongeveer $1,3 miljard. Als deze tot nu toe waren behouden, zou deze investering mogelijk $20-30 miljard waard zijn.

De logica van de investeerders is eenvoudig:

- Technologisch leiderschap: Opus 4.6 scoort 40% in de FrontierMath benchmark, wat in wezen gelijk is aan GPT-5.2

- Productmomentum: Het aantal wekelijkse actieve gebruikers van Claude Code is sinds januari verdubbeld, 4% van de GitHub-inzendingen komt al van Claude Code

- Commercialisatietraject: Verwacht wordt dat het in 2028 winstgevend zal zijn, met een vasthoudendheid aan een productstrategie zonder advertenties

Maar waardering is een gok op de toekomst, en de toekomst zit vol strategische risico's.

OpenClaw-incident: een analyse van een PR-ramp

Peter Steinberger ontwikkelde OpenClaw, een open-source AI-programmeertool gebaseerd op de Claude API. De advocaten van Anthropic stuurden een cease-and-desist brief, met als reden dat de naam te veel op "Claude" leek.

Het resultaat? Steinberger hernoemde het project naar Moltbot en werd vervolgens overgenomen door OpenAI, waarbij hij het hele project en de community meenam.

Unanieme commentaren op X:

"Anthropic really fumbled the bag on the OpenClaw arc" "anthropic lost the opportunity - openclaw + Claude code would be a game changer" "Generational fumble from Anthropic"

Dit is geen juridisch probleem, maar een strategisch probleem. Het aantal GitHub-sterren van OpenClaw overtreft al VS Code en is drie keer zo hoog als Claude Code. Het is een open-source platform, wat betekent dat het het vertrouwen en de aandacht van de onafhankelijke ontwikkelaarsgemeenschap vertegenwoordigt.

Door OpenClaw over te nemen, zou Anthropic drie dingen kunnen krijgen:

- Het vertrouwen van de open-source community

- Cross-platform mogelijkheden (OpenClaw ondersteunt Windows, terwijl Claude Code voornamelijk op macOS draait)

- Toegang tot het ontwikkelaarsecosysteem

Maar Anthropic koos voor juridische middelen. OpenAI kreeg alles zonder enige moeite.

Twee dimensies van platformstrategie

Vanuit het oogpunt van platformstrategie zijn er twee belangrijke observaties:

Ten eerste herhaalt Anthropic de fouten van Microsoft.

In de jaren 2010 stond Microsoft vijandig tegenover de open-source community, met als gevolg dat het het marktaandeel van een hele generatie ontwikkelaars verloor. Later herstelde Satya Nadella de relatie geleidelijk door GitHub over te nemen, Linux te omarmen en open-source te ondersteunen.

De manier waarop Anthropic met OpenClaw omgaat, doet denken aan Microsoft uit die tijd - het juridische team inzetten om problemen op te lossen die door het strategische team hadden moeten worden opgelost.

Ten tweede, het beheersen van de toollaag is essentieel om de toegang van gebruikers te beheersen.

OpenAI's overname van OpenClaw is niet voor de technologie, maar voor een ontwikkelaarsaggregatieplatform. Wanneer het model zelf een gecommoditiseerd product wordt, beheerst degene die de toollaag beheert de toegang van gebruikers.

De strategie van Claude Code is diepgaand begrip - eerst code lezen en dan handelen. De strategie van Codex is applicatie-eerst, modeliteratie en overname-integratie. Er is geen goed of fout aan beide paden, maar slechts één breidt actief de ecologische grenzen uit.## De Paradox van het Pentagon

In dezelfde week dook een ander verhaal op: het Pentagon overweegt de banden met Anthropic te verbreken omdat Anthropic vasthoudt aan het opleggen van beperkingen op het militaire gebruik van zijn AI-modellen.

Dit is in wezen een kwestie van waarden - Anthropic is opgericht door het voormalige OpenAI-veiligheidsteam, en AI-veiligheid is de kern van hun DNA. Maar vanuit strategisch oogpunt is dit een kwestie van grenzen stellen.

Als Anthropic vasthoudt aan het beperken van militair gebruik:

- Verlies van overheidscontractinkomsten

- Mogelijk verlies van onderzoekssamenwerking met het Pentagon

- Maar behoud van de merkpositionering van AI-veiligheid

Als Anthropic volledig open is:

- Verkrijg overheidsinkomsten

- Maar kan afwijken van zijn veiligheidsmissie

- Veroorzaak morele dilemma's binnen het interne team

Er is geen perfect antwoord. Maar het is opmerkelijk dat hetzelfde Anthropic juridische middelen gebruikt tegen open-source ontwikkelaars, maar vasthoudt aan principes voor militair gebruik. Deze inconsistentie kan in de toekomst grotere merkreisico's veroorzaken.

De Voorspelling van de CEO en de Paradox van Werving

Dario Amodei heeft bij verschillende gelegenheden in het openbaar verklaard dat software engineering binnen 6-12 maanden "volledig zal worden vervangen" door AI.

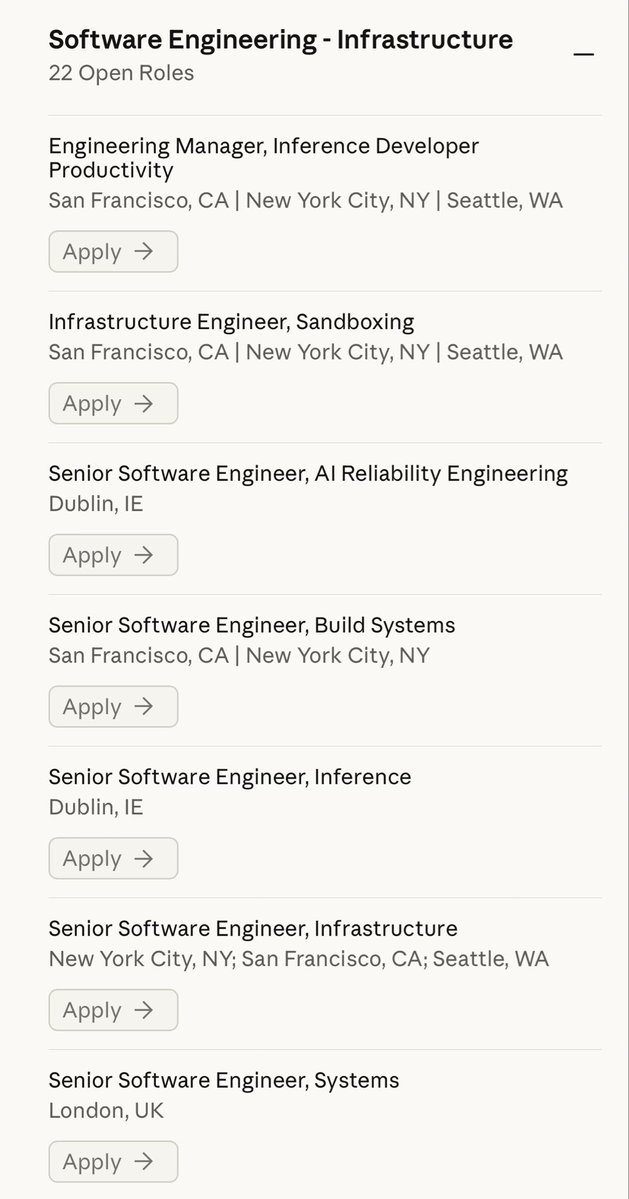

Ironisch genoeg is Anthropic tegelijkertijd nog steeds massaal software engineers aan het werven.

Reacties op X:

"At this point, I'm sure the Anthropic CEO is deliberately pushing the 'developers are becoming obsolete' narrative just to grab attention on X."

Dit is geen simpele tegenstrijdigheid. De voorspelling van Amodei is misschien oprecht - maar een oprechte voorspelling is niet hetzelfde als een juiste voorspelling. Belangrijker is dat deze retoriek de meest centrale gebruikersgroep van Anthropic vervreemdt: ontwikkelaars.

Wanneer je CEO zegt dat een bepaald beroep binnen een jaar zal verdwijnen, en dat beroep toevallig de belangrijkste gebruiker van je product is, kunnen de kosten van deze PR-strategie hoger zijn dan je denkt.

Technische Capaciteit en Strategische Blinde Vlekken

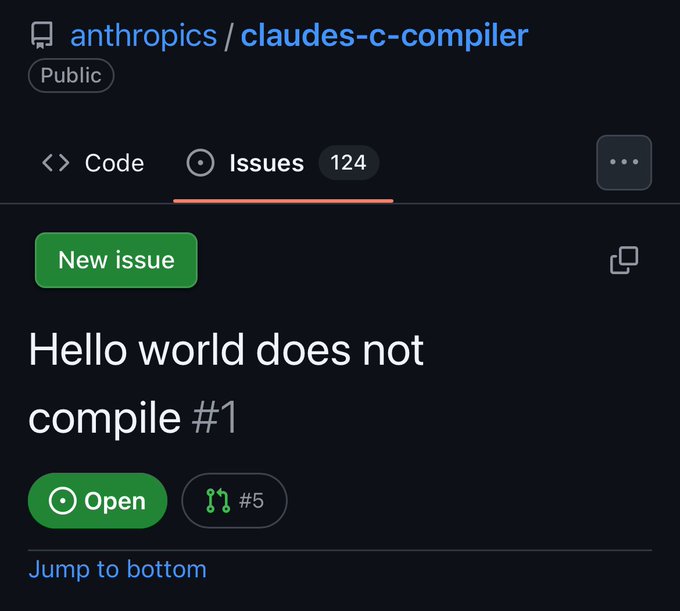

De technische capaciteit van Anthropic is reëel. 16 Claude Agents schreven vanuit het niets een 100.000 regels tellende Rust-compiler die de Linux-kernel kan compileren. Dit is het resultaat van 2000 sessies en $20.000 aan API-kosten.

Maar technisch leiderschap is niet hetzelfde als strategische correctheid. De geschiedenis staat vol met voorbeelden van technisch leiderschap maar strategische fouten:

- Netscape had de beste browser, maar verloor van de bundelstrategie van Microsoft

- BlackBerry had de beste zakelijke telefoon, maar verloor van het ecosysteem van de iPhone

- Yahoo had de beste directory, maar verloor van het zoekalgoritme van Google

De positie van Anthropic is nu vergelijkbaar met die van Netscape in 1996 - technisch toonaangevend, maar concurrenten omsingelen vanuit meerdere richtingen.

The Bottom Line

De waardering van Anthropic van $350 miljard is gebaseerd op een aanname: technisch leiderschap kan worden omgezet in een duurzaam concurrentievoordeel.

Maar de OpenClaw-incidenten hebben de kwetsbaarheid van deze aanname blootgelegd. Wanneer de modelcapaciteiten homogener worden, wordt het ontwikkelaarsecosysteem de enige gracht. En in de opbouw van het ecosysteem maakt Anthropic strategische fouten:

- De open-source community behandelen met juridische middelen in plaats van strategische samenwerking

- Kerngebruikers vervreemden met sensationele uitspraken

- Concurrenten laten winnen in de platformoorlog zonder te vechten

$30 miljard koopt de toekomst. Maar als de strategische richting verkeerd is, kan geen hoeveelheid geld het verlies van mindshare compenseren.Voor ontwikkelaars en investeerders is dit een vraag om over na te denken: gok je op technische capaciteiten, of een ecologische strategie in de platformoorlog van AI?