Wycena Anthropic na 350 miliardów dolarów a paradoks OpenClaw

W połowie lutego Anthropic zakończyło rundę finansowania o wartości 30 miliardów dolarów, osiągając wycenę 350 miliardów dolarów. Ta liczba przekracza łączną kapitalizację dziesięciu największych indyjskich firm IT (około 350 miliardów dolarów, zatrudniających 1,6 miliona osób), podczas gdy Anthropic zatrudnia tylko 3000 pracowników.

Jednak w tym samym tygodniu historia projektu open source o nazwie OpenClaw ujawniła błędy, które ta firma może popełniać na poziomie strategicznym.

Logika 30 miliardów dolarów

Przepływ kapitału odzwierciedla oczekiwania rynku. W likwidacji FTX, udziały w Anthropic zostały sprzedane za około 1,3 miliarda dolarów. Gdyby zostały zachowane do dziś, ta inwestycja mogłaby być warta 20-30 miliardów dolarów.

Logika inwestorów jest prosta:

- Wiodąca technologia: Opus 4.6 uzyskał wynik 40% w benchmarku FrontierMath, zasadniczo na równi z GPT-5.2

- Momentum produktu: Liczba aktywnych użytkowników Claude Code podwoiła się od stycznia, a 4% zgłoszeń na GitHub pochodzi już od Claude Code

- Ścieżka komercjalizacji: Oczekuje się, że rentowność zostanie osiągnięta w 2028 roku, przy zachowaniu strategii produktowej bez reklam

Ale wycena jest zakładem na przyszłość, a przyszłość jest pełna strategicznych ryzyk.

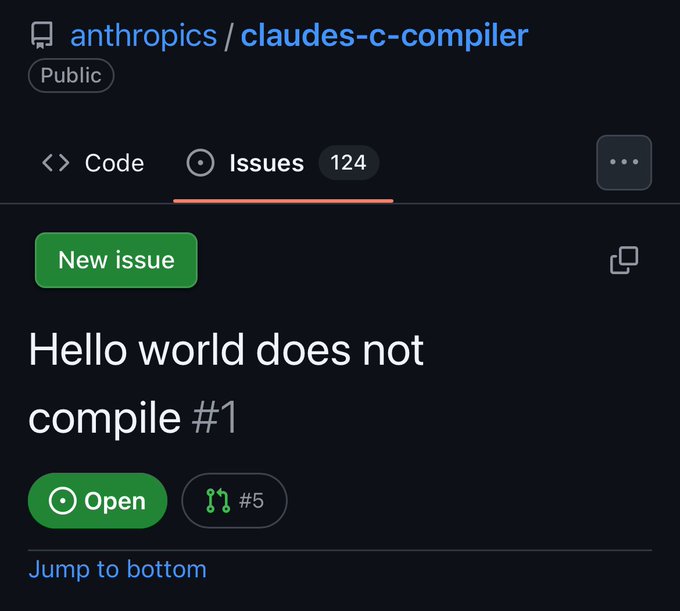

Incydent OpenClaw: Analiza katastrofy PR

Peter Steinberger opracował OpenClaw, narzędzie do programowania AI o otwartym kodzie źródłowym oparte na Claude API. Prawnicy Anthropic wysłali pismo z żądaniem zaprzestania działalności (cease-and-desist), argumentując, że nazwa jest podobna do "Claude".

Jaki był wynik? Steinberger zmienił nazwę projektu na Moltbot, a następnie został przejęty przez OpenAI, zabierając ze sobą cały projekt i społeczność.

Jednomyślne komentarze na X:

"Anthropic naprawdę spartaczył sprawę z OpenClaw" "Anthropic stracił szansę - openclaw + Claude code byłoby przełomem" "Pokoleniowa wpadka ze strony Anthropic"

To nie jest problem prawny, to problem strategiczny. Liczba gwiazdek OpenClaw na GitHubie przekroczyła już VS Code i jest trzykrotnie wyższa niż Claude Code. Jest to platforma open source, co oznacza, że reprezentuje zaufanie i uwagę niezależnej społeczności programistów.

Przejmując OpenClaw, Anthropic mógłby zyskać trzy rzeczy:

- Zaufanie społeczności open source

- Możliwość działania na wielu platformach (OpenClaw obsługuje Windows, podczas gdy Claude Code działa głównie na macOS)

- Wejście do ekosystemu programistów

Ale Anthropic wybrał środki prawne. OpenAI bez wysiłku dostał wszystko.

Dwa wymiary strategii platformy

Z punktu widzenia strategii platformy, istnieją tutaj dwie kluczowe obserwacje:

Po pierwsze, Anthropic powtarza błędy Microsoftu.

W latach 2010 Microsoft był wrogo nastawiony do społeczności open source, w wyniku czego stracił udział w umysłach całego pokolenia programistów. Później Satya Nadella stopniowo naprawiał relacje poprzez przejęcie GitHub, przyjęcie Linuksa i wspieranie open source.

Sposób, w jaki Anthropic potraktował OpenClaw, przypomina Microsoft z tamtej epoki - używanie zespołu prawnego do rozwiązywania problemów, które powinien rozwiązać zespół strategiczny.

Po drugie, kontrola warstwy narzędzi jest niezbędna do kontrolowania wejścia użytkowników.

OpenAI przejął OpenClaw nie ze względu na technologię, ale ze względu na platformę agregacji programistów. Kiedy sam model staje się skomercjalizowanym towarem, ten, kto kontroluje warstwę narzędzi, kontroluje wejście użytkowników.

Strategia Claude Code polega na głębokim zrozumieniu - najpierw przeczytaj kod, a potem działaj. Strategia Codex polega na priorytetowym traktowaniu aplikacji, iteracji modelu i integracji poprzez przejęcia. Nie ma dobrych ani złych ścieżek, ale tylko jedna aktywnie rozszerza granice ekosystemu.## Paradoks Pentagonu

W tym samym tygodniu pojawiła się kolejna historia: Pentagon rozważa zerwanie relacji z Anthropic z powodu nalegania Anthropic na nałożenie ograniczeń na militarne zastosowanie ich modeli AI.

Na pierwszy rzut oka jest to kwestia wartości – Anthropic został stworzony przez były zespół ds. bezpieczeństwa OpenAI, a bezpieczeństwo AI jest jego podstawowym genem. Ale z punktu widzenia strategicznego jest to problem wyznaczania granic.

Jeśli Anthropic upiera się przy ograniczeniach dotyczących zastosowań wojskowych:

- Utrata dochodów z kontraktów rządowych

- Możliwa utrata możliwości współpracy badawczej z Pentagonem

- Ale utrzymanie pozycjonowania marki w zakresie bezpieczeństwa AI

Jeśli Anthropic jest całkowicie otwarty:

- Uzyskanie dochodów rządowych

- Ale możliwe odejście od misji bezpieczeństwa

- Wywołanie dylematów etycznych w wewnętrznym zespole

Nie ma idealnej odpowiedzi. Warto jednak zauważyć, że ten sam Anthropic, który używa środków prawnych wobec twórców oprogramowania open source, upiera się przy zasadach dotyczących zastosowań wojskowych. Ta niespójność może w przyszłości spowodować większe ryzyko dla marki.

Proroctwo CEO i paradoks rekrutacji

Dario Amodei wielokrotnie publicznie stwierdzał, że inżynieria oprogramowania zostanie "całkowicie zastąpiona" przez AI w ciągu 6-12 miesięcy.

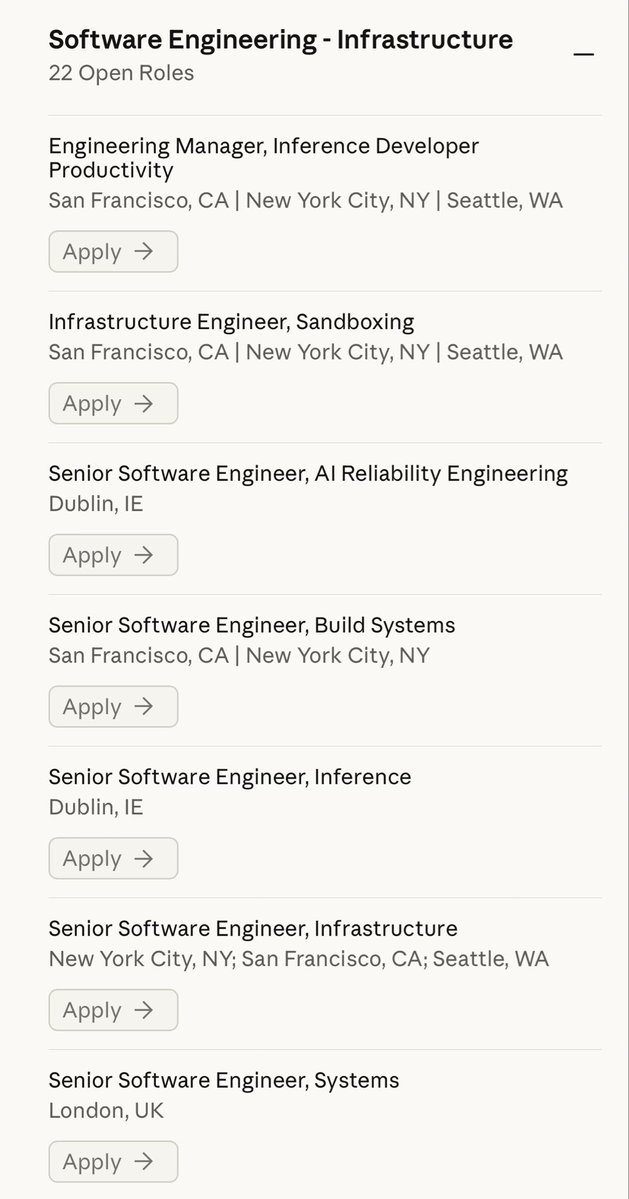

Ironią losu jest to, że w tym samym czasie Anthropic wciąż masowo rekrutuje inżynierów oprogramowania.

Komentarz na X:

"At this point, I'm sure the Anthropic CEO is deliberately pushing the 'developers are becoming obsolete' narrative just to grab attention on X."

To nie jest zwykła sprzeczność. Prognoza Amodei może być szczera – ale szczera prognoza nie jest równoznaczna z poprawną prognozą. Co ważniejsze, takie wypowiedzi odstraszają najbardziej podstawową grupę użytkowników Anthropic: programistów.

Kiedy twój CEO mówi, że zawód zniknie w ciągu roku, a ten zawód jest głównym użytkownikiem twojego produktu, koszt takiej strategii PR może być wyższy niż się wydaje.

Zdolności techniczne a strategiczna ślepota

Zdolności techniczne Anthropic są realne. 16 agentów Claude'a napisało od zera kompilator Rust o długości 100 000 linii, który jest w stanie skompilować jądro Linuxa. To wynik 2000 sesji i 20 000 dolarów opłat za API.

Ale przewaga technologiczna nie jest równoznaczna z poprawną strategią. Historia jest pełna przypadków przewagi technologicznej, ale błędów strategicznych:

- Netscape miał najlepszą przeglądarkę, ale przegrał z strategią bundlingu Microsoftu

- BlackBerry miał najlepszy telefon korporacyjny, ale przegrał z ekosystemem iPhone'a

- Yahoo miał najlepszy katalog, ale przegrał z algorytmem wyszukiwania Google

Anthropic znajduje się teraz w pozycji podobnej do Netscape w 1996 roku – przewaga technologiczna, ale konkurenci otaczają go z wielu stron.

Podsumowanie

Wycena Anthropic na 350 miliardów dolarów opiera się na założeniu, że przewaga technologiczna może przełożyć się na trwałą przewagę konkurencyjną.

Ale incydent OpenClaw ujawnił kruchość tego założenia. Kiedy możliwości modeli stają się homogeniczne, ekosystem programistów stanie się jedynym murem obronnym. A w budowaniu ekosystemu Anthropic popełnia błędy strategiczne:

- Traktowanie społeczności open source za pomocą środków prawnych, a nie współpracy strategicznej

- Odstraszanie podstawowej grupy użytkowników sensacyjnymi wypowiedziami

- Pozwalanie konkurentom na wygraną bez walki w wojnie platform

30 miliardów dolarów kupuje przyszłość. Ale jeśli kierunek strategiczny jest błędny, żadne pieniądze nie zrekompensują utraty udziału w umysłach.Dla开发者和投资者来说,这是一个值得思考的问题:在 AI 的平台战争中,你押注的是技术能力,还是生态战略?