A Avaliação de US$ 350 bilhões da Anthropic e o Paradoxo OpenClaw

Em meados de fevereiro, a Anthropic concluiu uma rodada de financiamento de US$ 30 bilhões, atingindo uma avaliação de US$ 350 bilhões. Esse número excede o valor de mercado total das dez maiores empresas de TI da Índia (cerca de US$ 350 bilhões, com 1,6 milhão de funcionários), enquanto a Anthropic tem apenas 3.000 funcionários.

Mas, na mesma semana, a história de um projeto de código aberto chamado OpenClaw expôs os possíveis erros estratégicos que essa empresa pode estar cometendo.

A Lógica dos US$ 30 bilhões

O fluxo de capital ilustra as expectativas do mercado. Na liquidação da falência da FTX, suas ações da Anthropic foram vendidas por cerca de US$ 1,3 bilhão. Se mantido até hoje, esse investimento poderia valer de US$ 20 a 30 bilhões.

A lógica dos investidores é simples:

- Liderança tecnológica: Opus 4.6 pontua 40% no benchmark FrontierMath, praticamente empatado com o GPT-5.2

- Impulso do produto: Usuários ativos semanais do Claude Code dobraram desde janeiro, 4% dos envios do GitHub já são do Claude Code

- Caminho para a comercialização: Lucratividade esperada em 2028, aderindo a uma estratégia de produto sem anúncios

Mas a avaliação é uma aposta no futuro, e o futuro está cheio de riscos estratégicos.

O Incidente OpenClaw: Uma Análise de Desastre de RP

Peter Steinberger desenvolveu o OpenClaw, uma ferramenta de programação de IA de código aberto baseada na API Claude. Os advogados da Anthropic enviaram uma carta de "cease-and-desist", alegando que o nome era semelhante a "Claude".

O resultado? Steinberger renomeou o projeto para Moltbot e foi adquirido pela OpenAI, levando todo o projeto e a comunidade com ele.

Comentários unânimes no X:

"Anthropic really fumbled the bag on the OpenClaw arc" (Anthropic realmente perdeu a oportunidade no arco OpenClaw) "anthropic lost the opportunity - openclaw + Claude code would be a game changer" (anthropic perdeu a oportunidade - openclaw + Claude code seria um divisor de águas) "Generational fumble from Anthropic" (Erro geracional da Anthropic)

Este não é um problema legal, é um problema estratégico. As estrelas do OpenClaw no GitHub já ultrapassaram o VS Code, sendo três vezes maiores que o Claude Code. É uma plataforma de código aberto, o que significa que representa a confiança e a atenção da comunidade de desenvolvedores independentes.

Ao adquirir o OpenClaw, a Anthropic poderia obter três coisas:

- Confiança da comunidade de código aberto

- Capacidade multiplataforma (OpenClaw suporta Windows, enquanto Claude Code é principalmente no macOS)

- Ponto de entrada para o ecossistema de desenvolvedores

Mas a Anthropic escolheu meios legais. A OpenAI conseguiu tudo sem esforço.

As Duas Dimensões da Estratégia de Plataforma

De uma perspectiva de estratégia de plataforma, aqui estão duas observações importantes:

Primeiro, a Anthropic está repetindo os erros da Microsoft.

Na década de 2010, a Microsoft adotou uma postura hostil em relação à comunidade de código aberto, resultando na perda da participação mental de toda uma geração de desenvolvedores. Mais tarde, Satya Nadella gradualmente reparou o relacionamento ao adquirir o GitHub, abraçar o Linux e apoiar o código aberto.

A forma como a Anthropic lidou com o OpenClaw lembra a Microsoft daquela época - usando a equipe jurídica para resolver problemas que deveriam ser resolvidos pela equipe estratégica.

Segundo, controlar a camada de ferramentas é controlar o ponto de entrada do usuário.

A OpenAI adquiriu o OpenClaw não por causa da tecnologia, mas por causa da plataforma de agregação de desenvolvedores. Quando o modelo em si se torna uma commodity, quem controla a camada de ferramentas controla o ponto de entrada do usuário.

A estratégia do Claude Code é o entendimento profundo - ler o código antes de agir. A estratégia do Codex é a aplicação primeiro, iteração do modelo, aquisição e integração. Não há certo ou errado nos dois caminhos, mas apenas um está expandindo ativamente as fronteiras do ecossistema.## O Paradoxo do Pentágono

Na mesma semana, outra história veio à tona: o Pentágono está considerando romper laços com a Anthropic devido à insistência da Anthropic em impor restrições ao uso militar de seus modelos de IA.

Isso é, superficialmente, uma questão de valores – a Anthropic foi criada pela antiga equipe de segurança da OpenAI, e a segurança da IA está em seu DNA central. Mas, de uma perspectiva estratégica, é uma questão de definição de limites.

Se a Anthropic insistir em restringir o uso militar:

- Perde receita de contratos governamentais

- Pode perder oportunidades de colaboração em pesquisa com o Pentágono

- Mas mantém o posicionamento de marca de segurança de IA

Se a Anthropic for totalmente aberta:

- Ganha receita governamental

- Mas pode se desviar de sua missão de segurança

- Desencadeia dilemas éticos dentro da equipe

Não há resposta perfeita. Mas vale a pena notar que a mesma Anthropic, que usa meios legais contra desenvolvedores de código aberto, insiste em princípios para uso militar. Essa inconsistência pode criar maiores riscos de marca no futuro.

A Profecia do CEO e o Paradoxo da Contratação

Dario Amodei declarou em várias ocasiões públicas que a engenharia de software será "completamente substituída" pela IA em 6 a 12 meses.

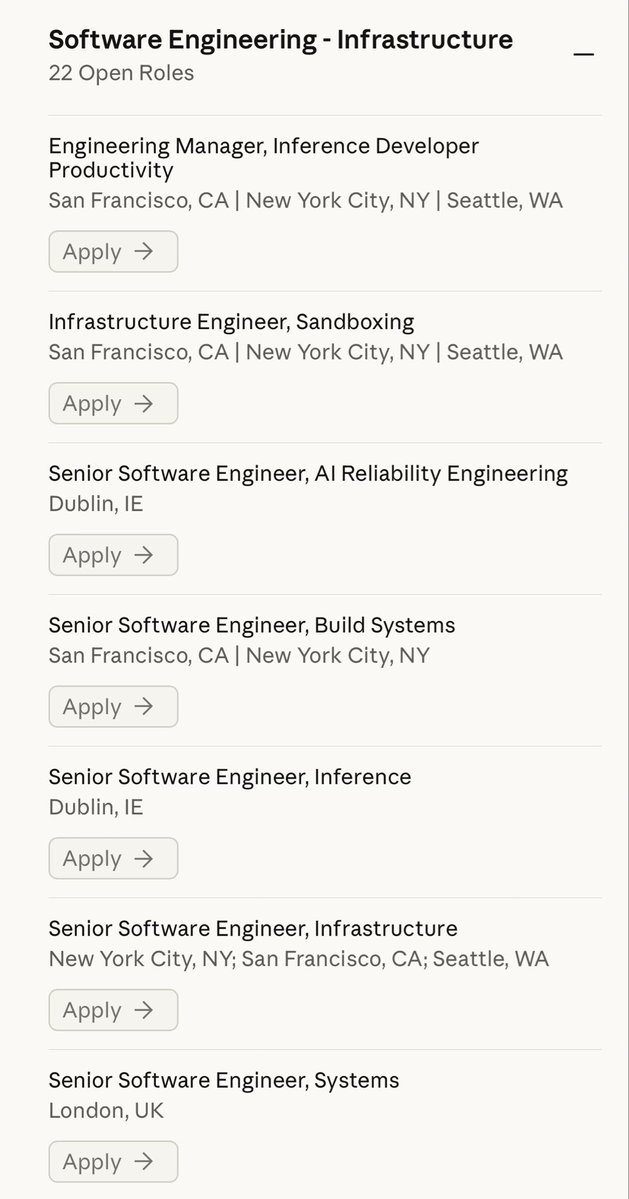

Ironicamente, a Anthropic ainda está contratando um grande número de engenheiros de software ao mesmo tempo.

Comentários no X:

"Neste ponto, tenho certeza de que o CEO da Anthropic está deliberadamente promovendo a narrativa de 'desenvolvedores estão se tornando obsoletos' apenas para chamar a atenção no X."

Esta não é uma simples contradição. A previsão de Amodei pode ser sincera – mas uma previsão sincera não é igual a uma previsão correta. Mais importante, essa retórica está alienando o grupo de usuários mais importante da Anthropic: os desenvolvedores.

Quando seu CEO diz que uma profissão desaparecerá em um ano, e essa profissão é justamente o principal usuário do seu produto, o custo dessa estratégia de RP pode ser maior do que o imaginado.

Capacidade Técnica vs. Ponto Cego Estratégico

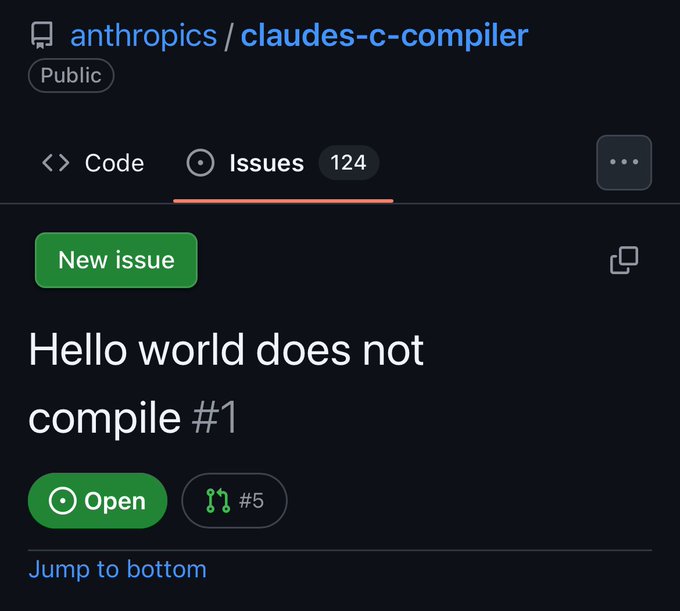

A capacidade técnica da Anthropic é real. 16 Claude Agents escreveram um compilador Rust de 100.000 linhas do zero, capaz de compilar o kernel do Linux. Este é o resultado de 2.000 sessões, um custo de API de US$ 20.000.

Mas liderança técnica não é igual a estratégia correta. A história está cheia de casos de liderança técnica, mas erros estratégicos:

- A Netscape tinha o melhor navegador, mas perdeu para a estratégia de bundling da Microsoft

- A BlackBerry tinha o melhor telefone corporativo, mas perdeu para o ecossistema do iPhone

- O Yahoo tinha o melhor diretório, mas perdeu para o algoritmo de busca do Google

A Anthropic está agora em uma posição semelhante à da Netscape em 1996 – tecnicamente à frente, mas os concorrentes estão cercando de várias direções.

The Bottom Line

A avaliação de US$ 350 bilhões da Anthropic é construída sobre uma suposição: a liderança técnica pode se traduzir em uma vantagem competitiva sustentável.

Mas o incidente OpenClaw expôs a fragilidade dessa suposição. Quando as capacidades do modelo se tornam homogêneas, o ecossistema de desenvolvedores se tornará o único fosso. E na construção do ecossistema, a Anthropic está cometendo erros estratégicos:

- Tratar a comunidade de código aberto com meios legais em vez de colaboração estratégica

- Alienar o principal grupo de usuários com declarações sensacionalistas

- Permitir que os concorrentes vençam a guerra de plataformas sem lutar

US$ 30 bilhões compram o futuro. Mas se a direção estratégica estiver errada, nenhum valor de financiamento pode compensar a perda de mindshare.Para desenvolvedores e investidores, esta é uma questão que vale a pena considerar: na guerra de plataformas de IA, você aposta na capacidade técnica ou na estratégia de ecossistema?