Бомба идва! Ръководство за Claude Code с неограничени токени локално

Claude Code е мощен, но консумацията на токени боли!

Най-накрая Claude Code може да работи с локални модели, конфигурацията е много проста.

Следната среда е за Mac Mini4. Възможна е и Windows среда.

В днешно време, ако искате да си играете с настолен AI, препоръчвам да си набавите Mac M серия малък хост, като mini4\mini4 pro\m3 ultra\m4 max, лично настолно AI чудо.

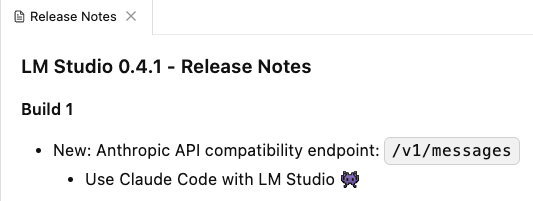

Първо, трябва да надстроите LM Studio до най-новата версия, тоест 0.4.1, защото най-новата версия добавя поддръжка за Claude Code. (Ollama също е възможна)

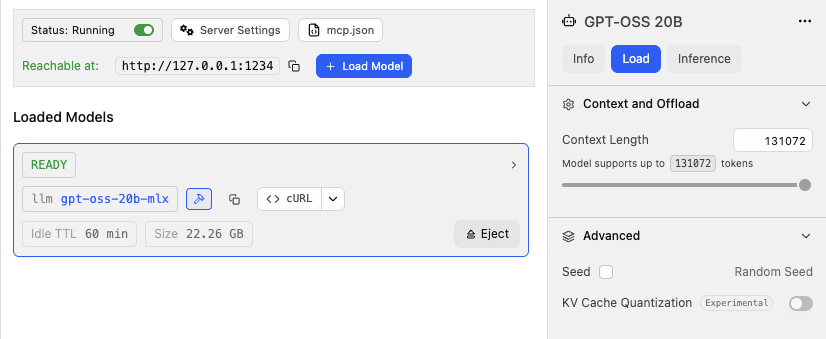

Можете да използвате произволен отворен модел локално, стига паметта на вашия Mac да е достатъчна. Взимаме за пример gpt-oss-20b-mlx, това е отворен модел на OpenAI.

Обърнете внимание на едно: Context length на максимум, тоест дължината на контекста до максимума, поддържан от модела, защото представянето на агента за многократни задачи зависи силно от дължината на контекста, ако е малко не става. Този параметър също трябва да се балансира според паметта на вашия Mac и скоростта на извод на модела. Още една забележка: За Mac среда, предпочитайте да изтегляте модели във формат MLX, скоростта на извод е по-бърза от моделите във формат GGUF.

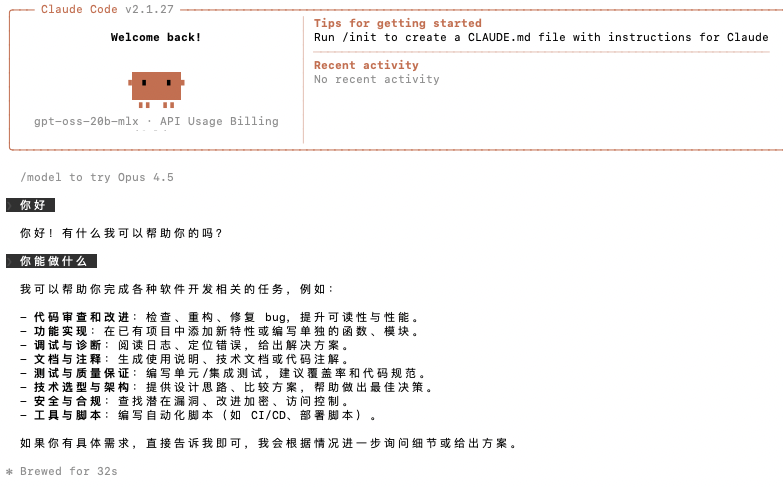

След това, инсталираме claude code в командния терминал.

Конфигуриране на променливи на средата:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Инсталиране на claude code:

npm install -g @anthropic-ai/claude-codeСлед това, стартирайте claude code:

claude --model gpt-oss-20b-mlxСега, claude code ще извика вашия локален модел за извеждане.

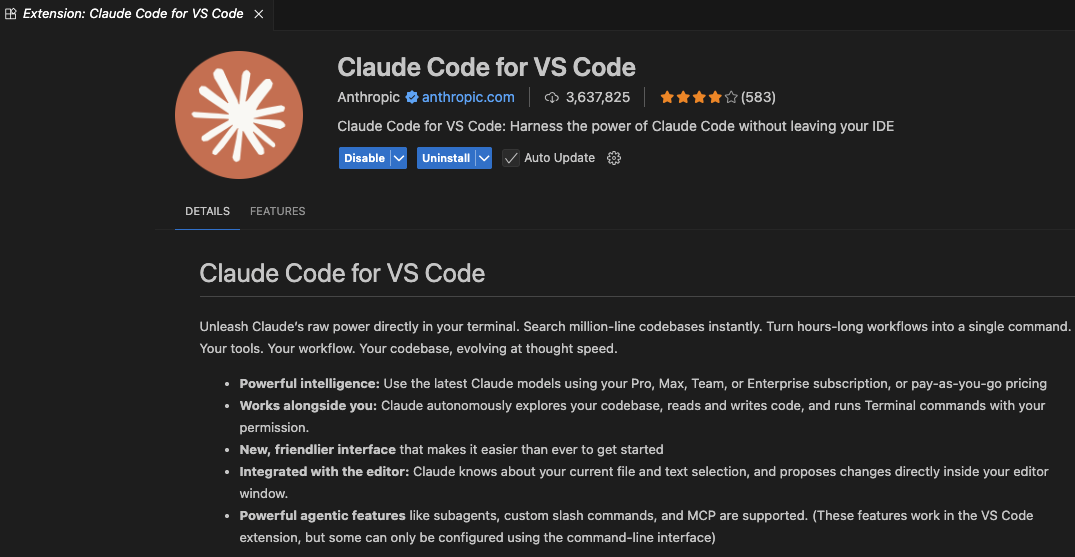

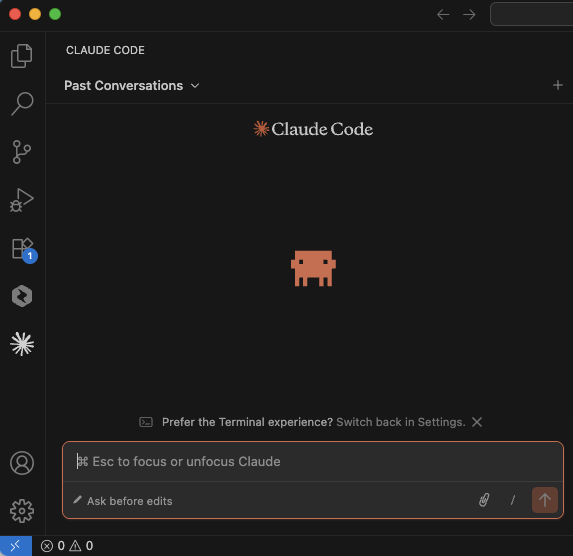

Освен в терминала, може да се използва и в VS Code, конфигурацията е следната:

Освен в терминала, може да се използва и в VS Code, конфигурацията е следната:

Първо инсталираме добавката Claude Code for VS Code.

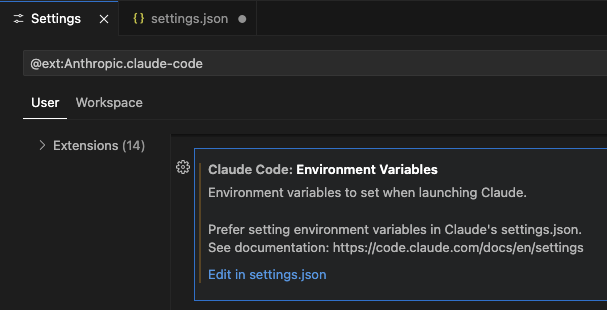

След това задаваме променливите на средата:

След това задаваме променливите на средата:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}И след това може да започва работа.

Въпрос за размисъл: Claude Code, който не използва модели на Anthropic, все още ли е същият Claude Code?

Въпрос за размисъл: Claude Code, който не използва модели на Anthropic, все още ли е същият Claude Code?

Моделът gpt-oss-20b-mlx, който използваме, разбира се не може да се сравни с Opus 4.5, но ако сте разположили Kimi K2.5 в локална среда, способностите му изглежда не отстъпват на Opus 4.5.