Explosió de poder! Guia per a Claude Code amb Tokens il·limitats locals

Claude Code és potent, però el consum de Tokens fa mal al fetge!

Finalment, Claude Code pot funcionar amb models locals, la configuració és molt senzilla.

El següent entorn és Mac Mini4. També és possible en entorn Windows.

En l'actualitat, si jugues amb IA d'escriptori, recomano adquirir un miniordinador Mac de la sèrie M, com mini4\mini4 pro\m3 ultra\m4 max, una eina d'IA personal per a l'escriptori.

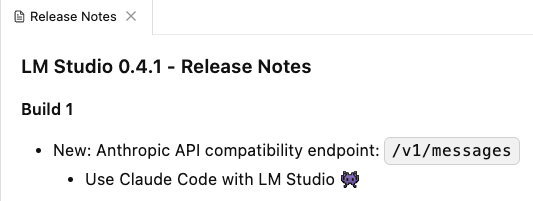

Primer, cal actualitzar LM Studio a la versió més recent, és a dir, 0.4.1, perquè l'última versió afegeix suport per a Claude Code. (Ollama també és possible)

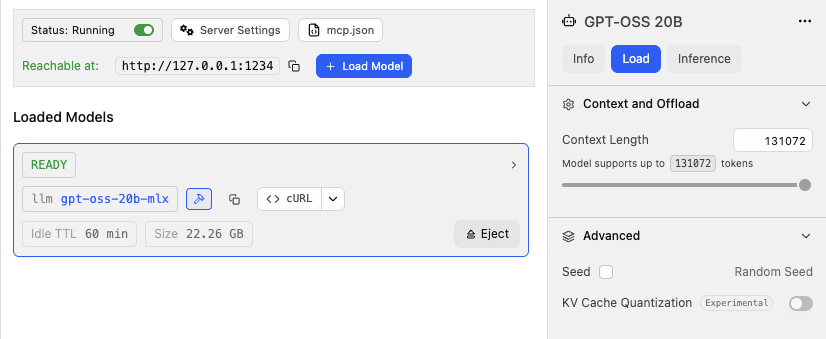

Pots utilitzar qualsevol model de codi obert local, sempre que la memòria del teu Mac sigui suficient. Prenem com a exemple gpt-oss-20b-mlx, que és un model de codi obert d'OpenAI.

Cal tenir en compte un punt: Context length al màxim, és a dir, la longitud del context fins al màxim que suporta el model, perquè el rendiment de tasques de múltiples rondes de l'agent depèn molt de la longitud del context, si és massa curt no funciona. Aquest paràmetre també s'ha d'ajustar equilibradament segons la memòria del teu Mac i la velocitat d'inferència del model. Un altre punt important: en entorn Mac, descarrega preferentment models en format MLX, la velocitat d'inferència és més ràpida que la dels models en format GGUF.

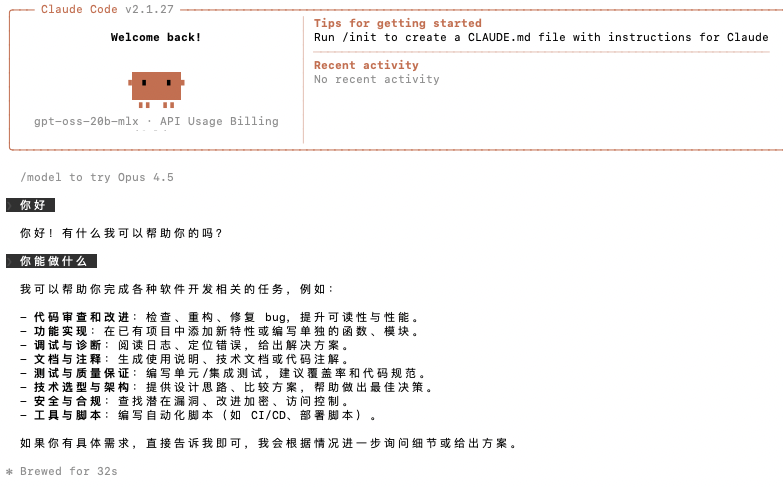

A continuació, instal·lem claude code a la terminal de línia d'ordres.

Configuració de variables d'entorn:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Instal·lació del cos de claude code:

npm install -g @anthropic-ai/claude-codeDesprés, inicia claude code:

claude --model gpt-oss-20b-mlxAra, claude code cridarà al teu model local per generar la sortida.

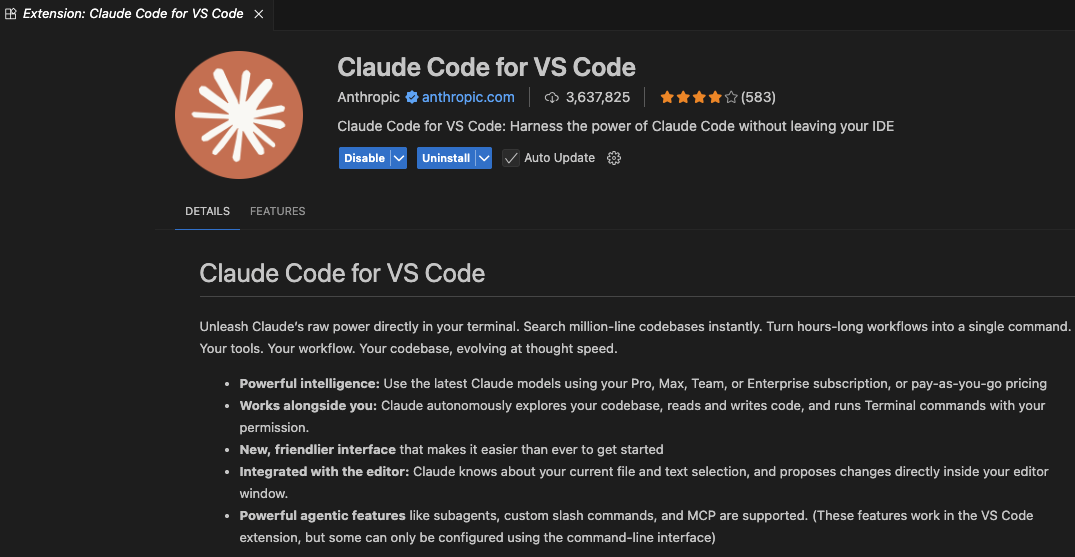

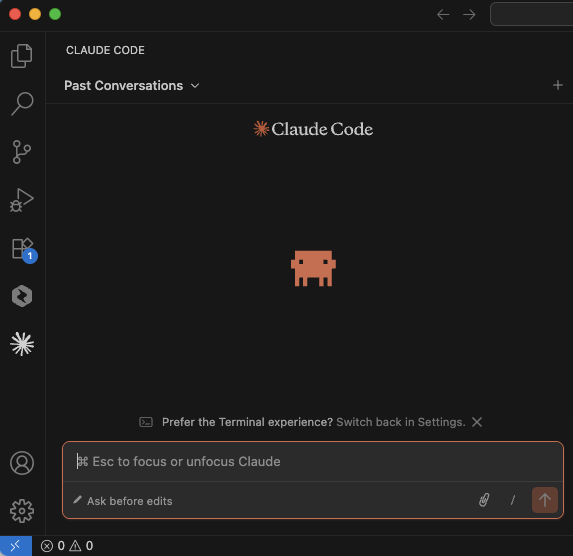

A més d'utilitzar-lo a la terminal, també es pot utilitzar a VS Code, la configuració és la següent:

A més d'utilitzar-lo a la terminal, també es pot utilitzar a VS Code, la configuració és la següent:

Primer instal·lem el connector Claude Code for VS Code.

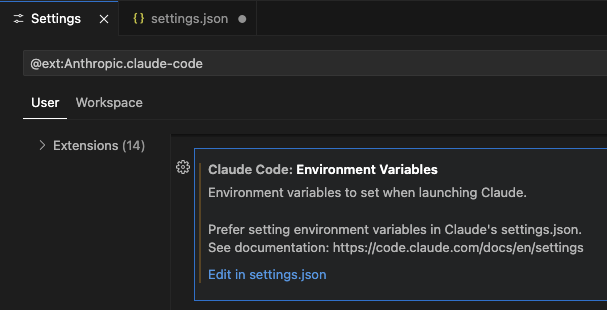

Després configurem les variables d'entorn:

Després configurem les variables d'entorn:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}I llavors ja pots començar a treballar.

Pregunta per reflexionar: Claude Code sense utilitzar models d'Anthropic, segueix sent el mateix Claude Code?

Pregunta per reflexionar: Claude Code sense utilitzar models d'Anthropic, segueix sent el mateix Claude Code?

El model gpt-oss-20b-mlx que utilitzem, per descomptat, no es pot comparar amb Opus 4.5, però, si tens Kimi K2.5 desplegat en entorn local, actualment sembla que la capacitat no és inferior a Opus 4.5.