Přichází trumf! Průvodce neomezenými tokeny pro Claude Code lokálně

Claude Code je výkonný, ale spotřeba tokenů může být bolestivá!

Konečně může Claude Code pracovat s lokálními modely a konfigurace je velmi jednoduchá.

Následující prostředí je Mac Mini4. Prostředí Windows je také možné.

V dnešní době, pokud hrajete s desktopovou AI, doporučujeme pořídit si malý počítač Mac M řady, jako je mini4\mini4 pro\m3 ultra\m4 max, osobní zázrak pro desktopovou AI.

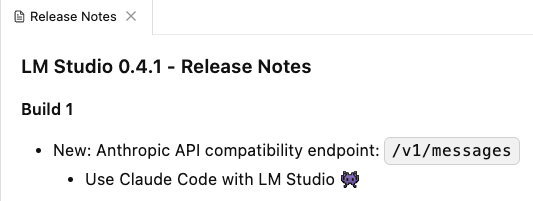

Nejprve je potřeba aktualizovat LM Studio na nejnovější verzi, tedy 0.4.1, protože nejnovější verze přidává podporu pro Claude Code. (Ollama je také možná.)

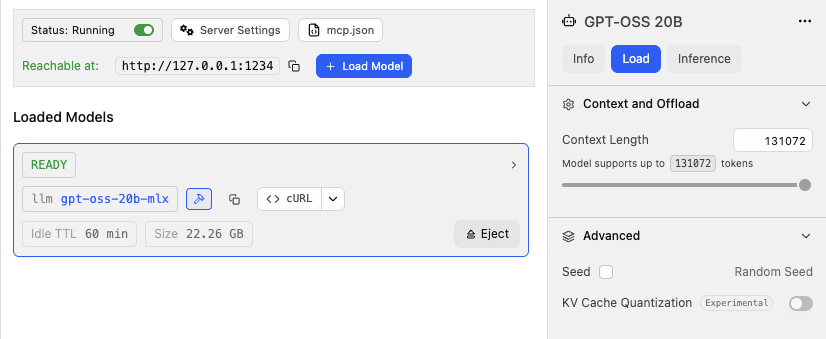

Můžete použít libovolný open-source model lokálně, pokud má váš Mac dostatek paměti. Jako příklad vezmeme gpt-oss-20b-mlx, což je open-source model od OpenAI.

Pozor na jednu věc: Délku kontextu nastavte na maximum, tedy na maximální délku podporovanou modelem, protože výkon agenta v úlohách s více koly velmi závisí na délce kontextu, krátký nestačí. Tento parametr je také třeba vyvážit podle paměti vašeho Macu a rychlosti inference modelu. Další důležitá poznámka: V prostředí Mac upřednostňujte stahování modelů ve formátu MLX, protože inference je rychlejší než u modelů ve formátu GGUF.

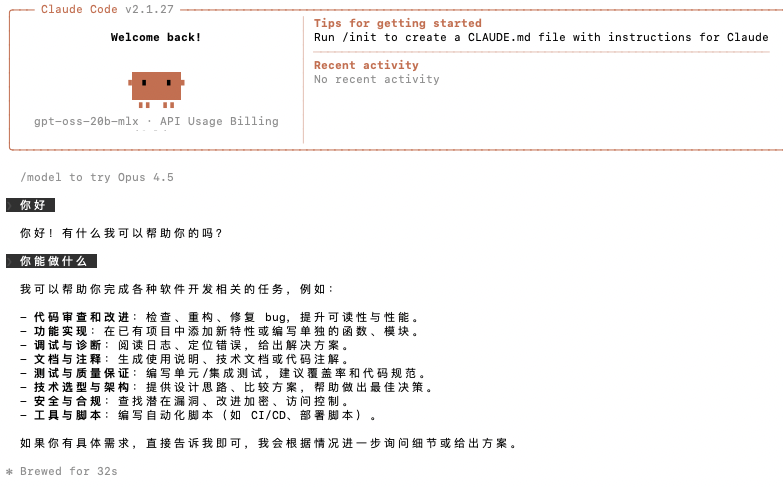

Dále nainstalujeme claude code v terminálu příkazového řádku.

Konfigurace proměnných prostředí:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Instalace samotného claude code:

npm install -g @anthropic-ai/claude-codePoté spusťte claude code:

claude --model gpt-oss-20b-mlxV tomto okamžiku bude claude code volat váš lokální model pro výstup.

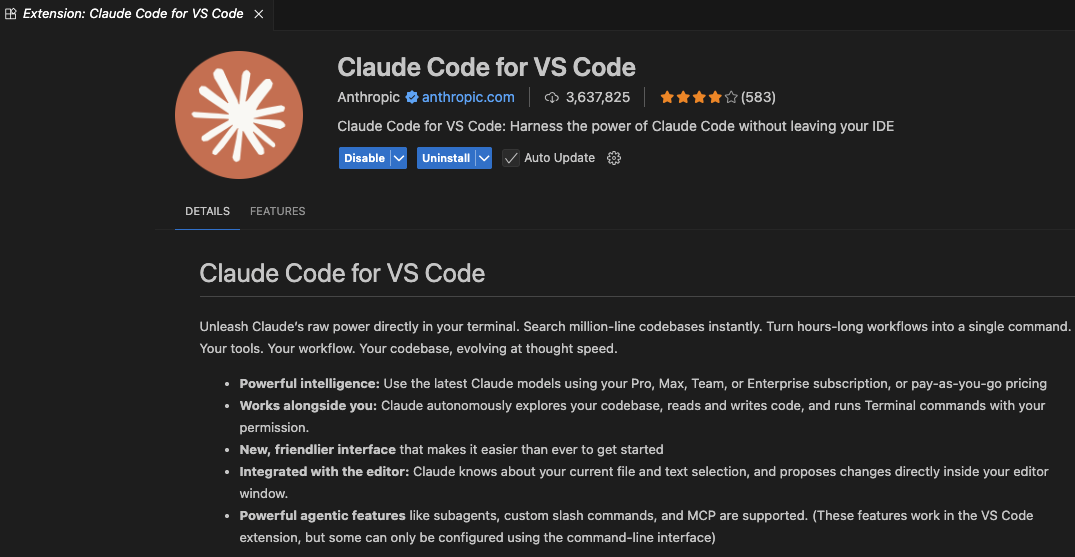

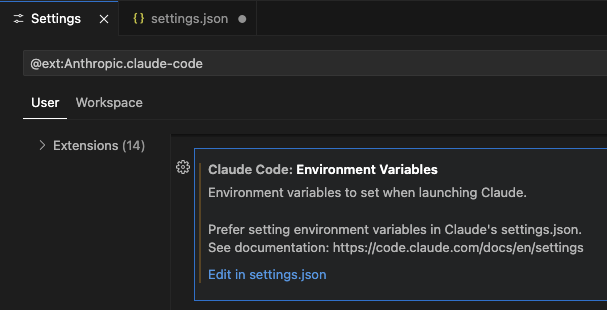

Kromě použití v terminálu lze také použít v VS Code, konfigurace je následující:

Kromě použití v terminálu lze také použít v VS Code, konfigurace je následující:

Nejprve nainstalujeme zásuvný modul Claude Code for VS Code.

Poté nastavíme proměnné prostředí:

Poté nastavíme proměnné prostředí:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Poté můžete začít pracovat.

Zamyšlení: Je Claude Code bez použití modelů Anthropic stále tím samým Claude Code?

Zamyšlení: Je Claude Code bez použití modelů Anthropic stále tím samým Claude Code?

Schopnosti modelu gpt-oss-20b-mlx, který používáme, samozřejmě nelze srovnávat s Opus 4.5, ale pokud máte v lokálním prostředí nasazený Kimi K2.5, zdá se, že jeho schopnosti se Opus 4.5 vůbec nevyrovnají.