Bombe kommer! Guide til ubegrænset Token med Claude Code lokalt

Claude Code er stærk, men Token-forbruget gør ondt i leveren!

Endelig kan Claude Code arbejde med lokale modeller, og konfigurationen er meget enkel.

Følgende miljø er Mac Mini4. Windows-miljø er også muligt.

I nutidens verden, hvis du vil lege med desktop AI, anbefales det at investere i en Mac M-serie mini-PC, såsom mini4\mini4 pro\m3 ultra\m4 max, et personligt desktop AI-værktøj.

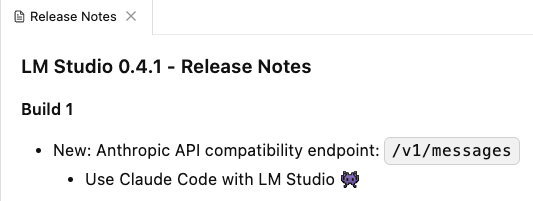

Først skal LM Studio opgraderes til den nyeste version, nemlig 0.4.1, fordi den nyeste version tilføjer understøttelse af Claude Code. (Ollama er også muligt)

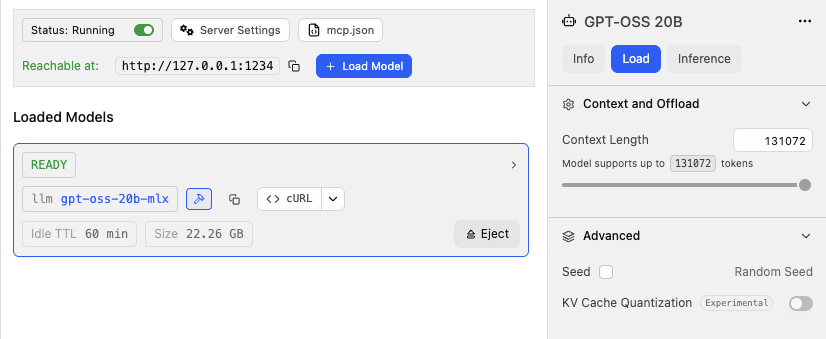

Du kan bruge enhver lokal open source-model, så længe din Mac har nok hukommelse. Vi tager gpt-oss-20b-mlx som eksempel, dette er en open source-model fra OpenAI.

Bemærk et punkt: Træk Context length op til maksimum, det vil sige træk kontekstlængden op til den maksimale længde, som modellen understøtter, fordi agenters præstation i flere opgaver er meget afhængig af kontekstlængden, for kort virker ikke. Denne parameter skal også justeres i balance med din Macs hukommelse og modellens inferenshastighed. Bemærk også et punkt: I Mac-miljø, download først modeller i MLX-format, inferenshastigheden er hurtigere end modeller i GGUF-format.

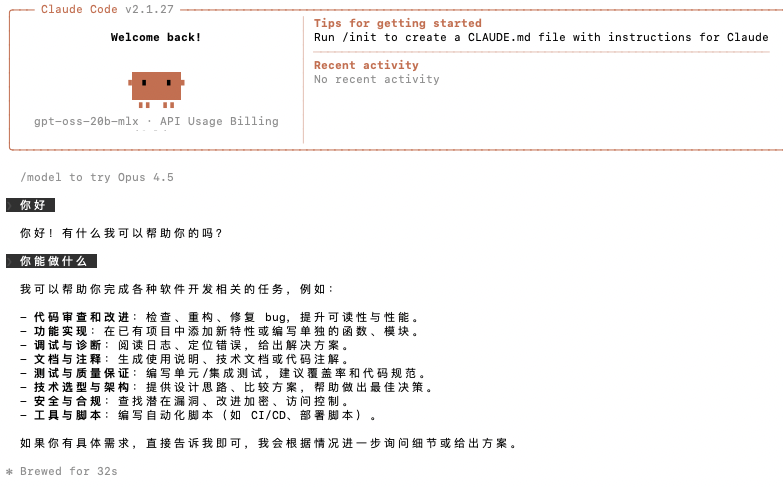

Dernæst installerer vi claude code i kommandolinjeterminalen.

Konfigurer miljøvariabler:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Installer claude code selv:

npm install -g @anthropic-ai/claude-codeStart derefter claude code:

claude --model gpt-oss-20b-mlxPå dette tidspunkt vil claude code kalde din lokale model for output.

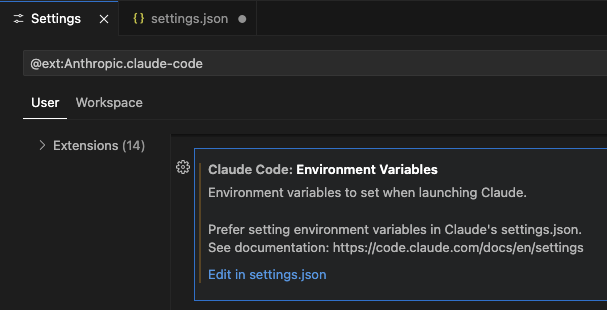

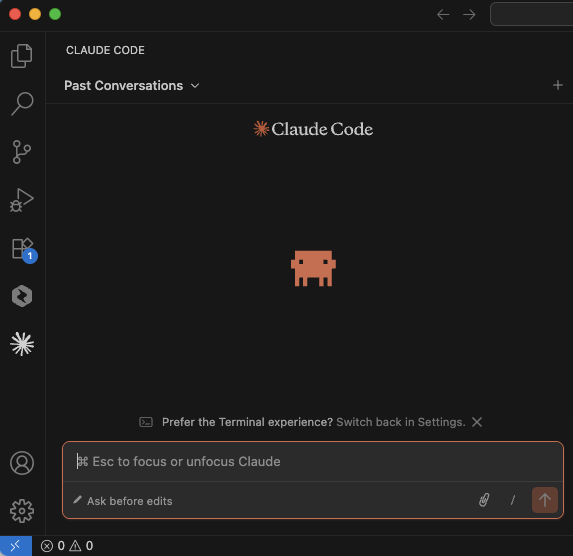

Udover at bruge det i terminalen, kan det også bruges i VS Code, konfiguration som følger:

Udover at bruge det i terminalen, kan det også bruges i VS Code, konfiguration som følger:

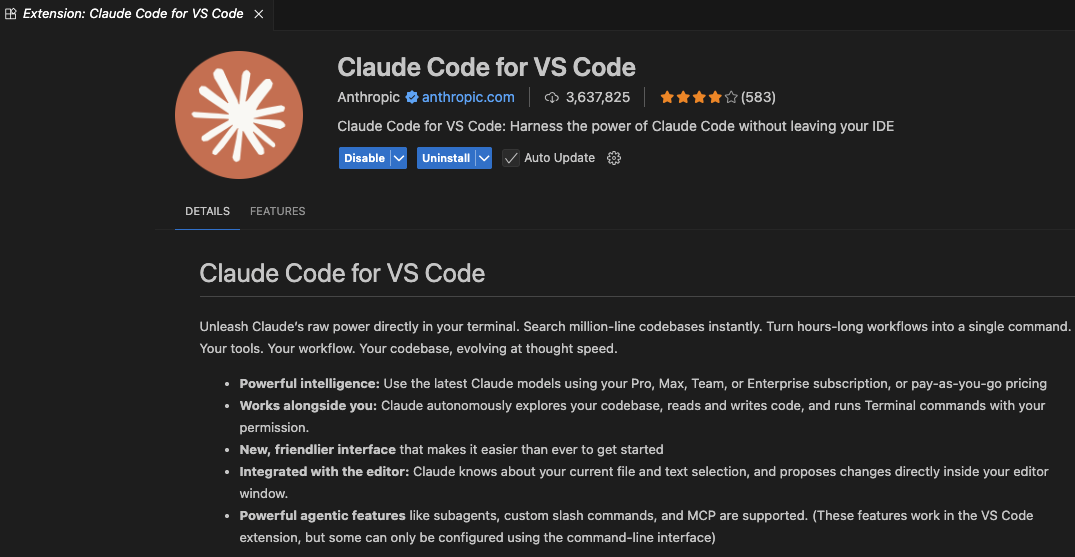

Vi installerer først Claude Code for VS Code-pluginet.

Indstil derefter miljøvariabler:

Indstil derefter miljøvariabler:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Så kan du komme i gang.

Tænkeopgave: Er Claude Code uden Anthropic-modeller stadig den samme Claude Code?

Tænkeopgave: Er Claude Code uden Anthropic-modeller stadig den samme Claude Code?

Den gpt-oss-20b-mlx-model, vi bruger, kan selvfølgelig ikke sammenlignes med Opus 4.5, men hvis du har Kimi K2.5 installeret lokalt, ser det ud til, at evnerne slet ikke er ringere end Opus 4.5.