Bombe trifft ein! Anleitung für unbegrenzte Tokens mit Claude Code lokal

Claude Code ist stark, aber der Token-Verbrauch kann einem echt wehtun!

Endlich kann Claude Code mit lokalen Modellen arbeiten, die Einrichtung ist sehr einfach.

Die folgende Umgebung ist ein Mac Mini4. Eine Windows-Umgebung ist ebenfalls möglich.

In der heutigen Zeit, wenn man mit Desktop-KI spielen möchte, empfiehlt es sich, einen Mac M-Series Mini-PC wie den mini4\mini4 pro\m3 ultra\m4 max anzuschaffen – ein persönliches Desktop-KI-Wunderwerkzeug.

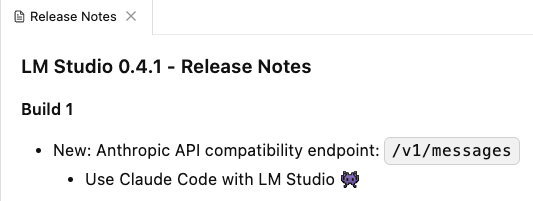

Zunächst muss LM Studio auf die neueste Version, also 0.4.1, aktualisiert werden, da die neueste Version Unterstützung für Claude Code hinzugefügt hat. (Ollama ist auch möglich.)

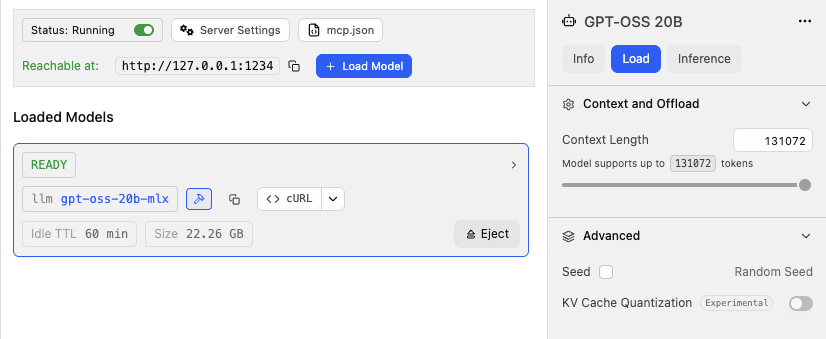

Du kannst jedes Open-Source-Modell lokal verwenden, solange der Arbeitsspeicher deines Macs ausreicht. Wir nehmen als Beispiel gpt-oss-20b-mlx, ein Open-Source-Modell von OpenAI.

Ein wichtiger Hinweis: Die Kontextlänge voll ausreizen, also die Kontextlänge auf das vom Modell unterstützte Maximum ziehen, da die Leistung von Agenten bei mehrfachen Aufgaben stark von der Kontextlänge abhängt – zu kurz geht nicht. Dieser Parameter muss auch basierend auf dem Arbeitsspeicher deines Macs und der Inferenzgeschwindigkeit des Modells ausbalanciert werden. Noch ein Hinweis: In der Mac-Umgebung priorisiert MLX-formatierte Modelle herunterladen, die Inferenzgeschwindigkeit ist schneller als bei GGUF-formatierten Modellen.

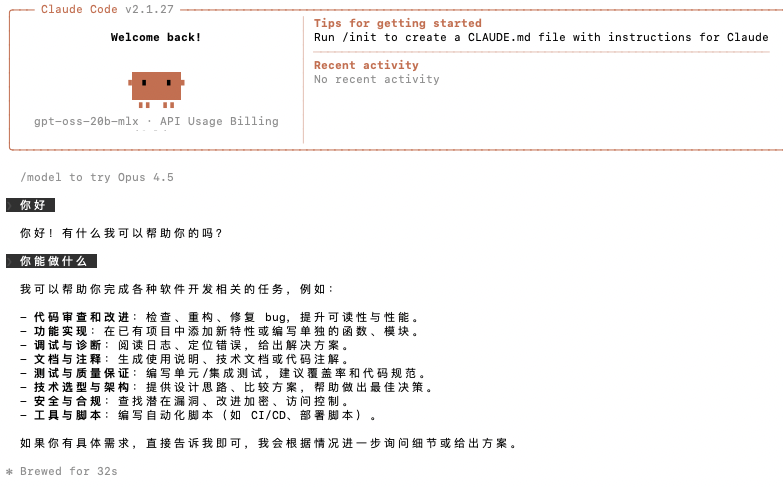

Als nächstes installieren wir claude code im Terminal der Kommandozeile.

Umgebungsvariablen konfigurieren:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Claude Code selbst installieren:

npm install -g @anthropic-ai/claude-codeDann Claude Code starten:

claude --model gpt-oss-20b-mlxJetzt wird Claude Code dein lokales Modell für die Ausgabe aufrufen.

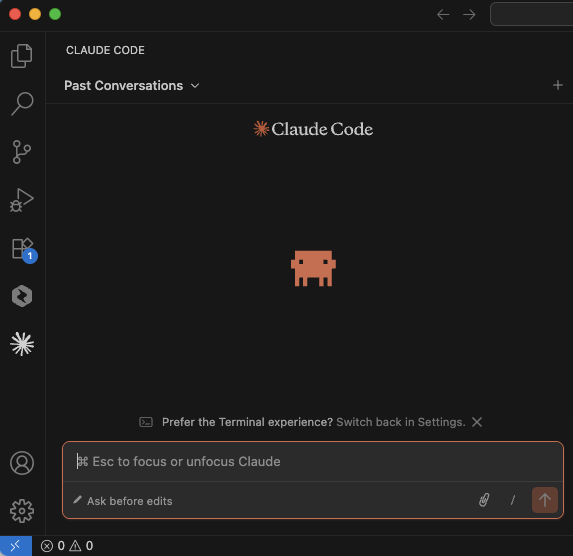

Neben der Verwendung im Terminal kann es auch in VS Code genutzt werden, die Konfiguration ist wie folgt:

Neben der Verwendung im Terminal kann es auch in VS Code genutzt werden, die Konfiguration ist wie folgt:

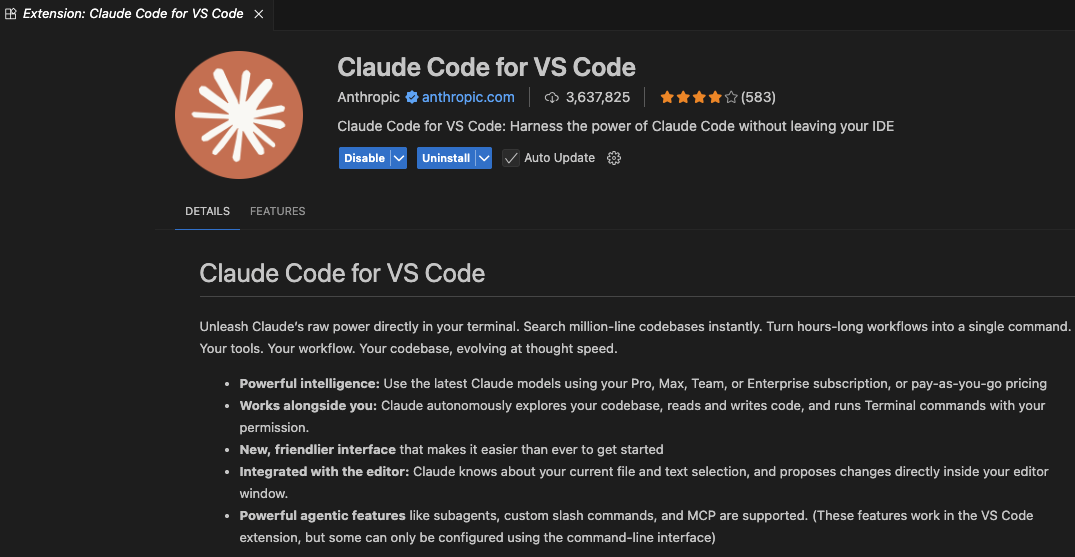

Zuerst installieren wir das Claude Code for VS Code Plugin.

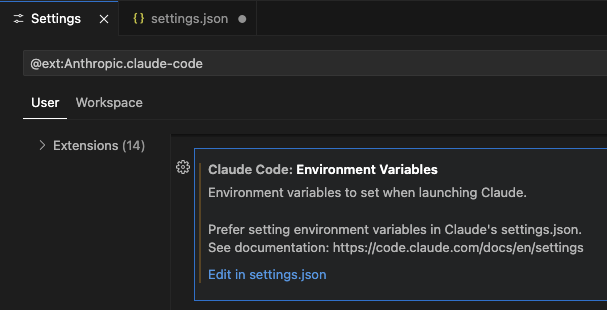

Dann die Umgebungsvariablen einstellen:

Dann die Umgebungsvariablen einstellen:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Dann kann es losgehen.

Denkaufgabe: Ist Claude Code ohne Anthropic-Modelle noch dasselbe Claude Code?

Denkaufgabe: Ist Claude Code ohne Anthropic-Modelle noch dasselbe Claude Code?

Das von uns verwendete Modell gpt-oss-20b-mlx kann natürlich nicht mit Opus 4.5 mithalten, aber wenn du lokal Kimi K2.5 eingesetzt hast, scheint es derzeit, dass die Fähigkeiten Opus 4.5 in nichts nachstehen.