¡Llega el As! Guía para Tokens Ilimitados Locales con Claude Code

Claude Code es potente, ¡pero el consumo de tokens duele en el hígado!

Finalmente, Claude Code puede trabajar con modelos locales, y la configuración es muy sencilla.

El siguiente entorno es Mac Mini4. El entorno Windows también es posible.

En la era actual, si juegas con IA de escritorio, se recomienda adquirir un mini PC Mac de la serie M, como mini4\mini4 pro\m3 ultra\m4 max, un dispositivo de IA personal imprescindible para el escritorio.

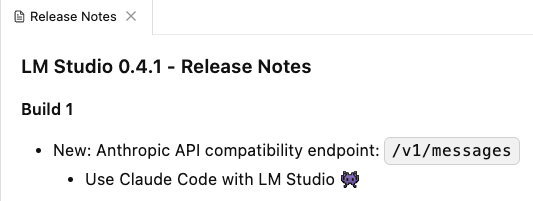

Primero, es necesario actualizar LM Studio a la última versión, es decir, 0.4.1, porque la versión más reciente añade soporte para Claude Code. (Ollama también es posible)

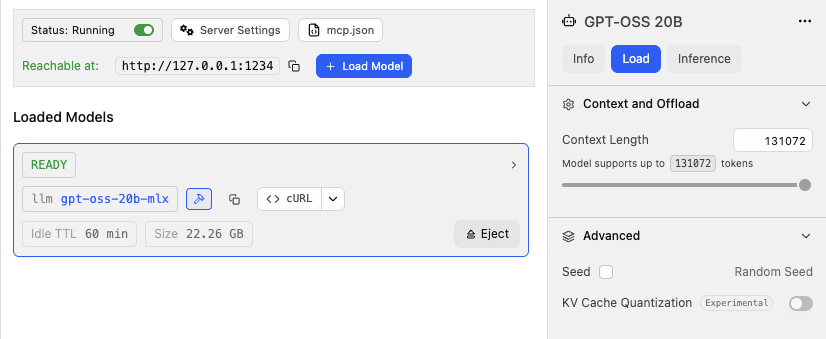

Puedes cargar cualquier modelo de código abierto en tu máquina local, siempre que la memoria de tu Mac sea suficiente. Tomemos como ejemplo gpt-oss-20b-mlx, que es un modelo de código abierto de OpenAI.

Nota importante: Lleva al máximo la longitud del contexto, es decir, ajusta la longitud del contexto al máximo que soporte el modelo, porque el rendimiento de las tareas de múltiples turnos del agente depende mucho de la longitud del contexto; si es pequeña, no funcionará bien. Este parámetro también debe ajustarse en equilibrio según la memoria de tu Mac y la velocidad de inferencia del modelo. Otra nota: En entorno Mac, prioriza la descarga de modelos en formato MLX, ya que la velocidad de inferencia es más rápida que la de los modelos en formato GGUF.

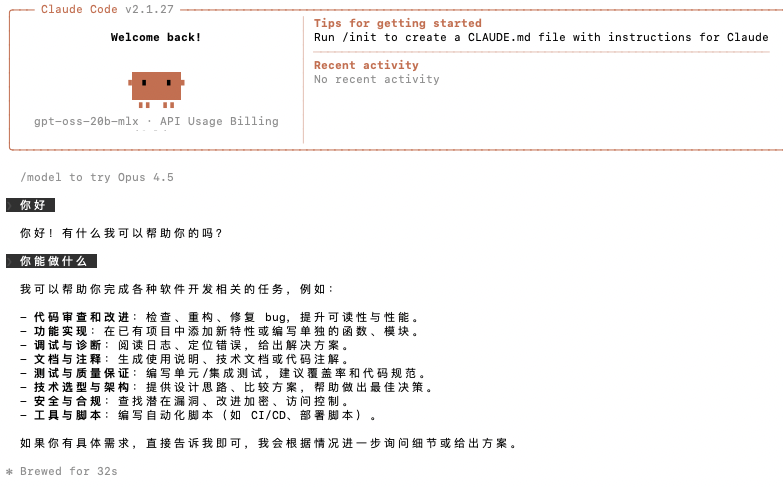

A continuación, instalamos claude code en la terminal de línea de comandos.

Configura las variables de entorno:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Instala el núcleo de claude code:

npm install -g @anthropic-ai/claude-codeLuego, inicia claude code:

claude --model gpt-oss-20b-mlxEn este punto, claude code utilizará tu modelo local para generar la salida.

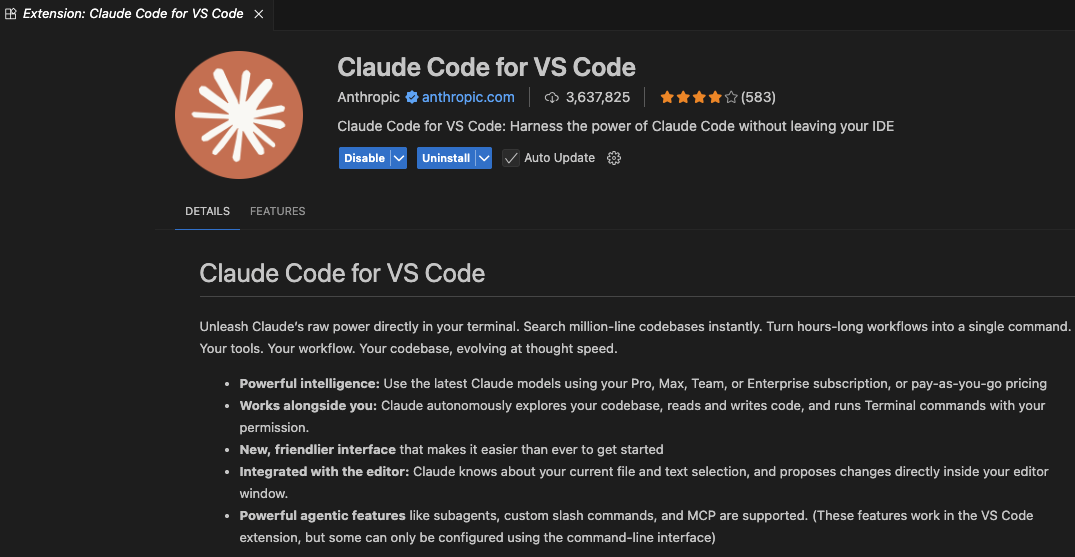

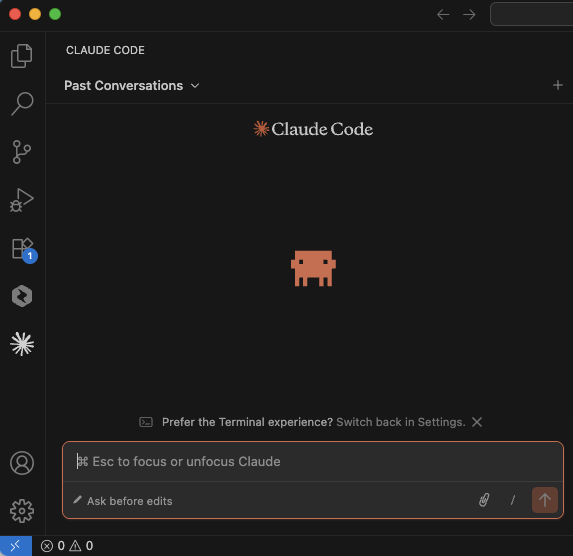

Además de usarlo en la terminal, también se puede utilizar en VS Code, con la siguiente configuración:

Además de usarlo en la terminal, también se puede utilizar en VS Code, con la siguiente configuración:

Primero instalamos el complemento Claude Code for VS Code.

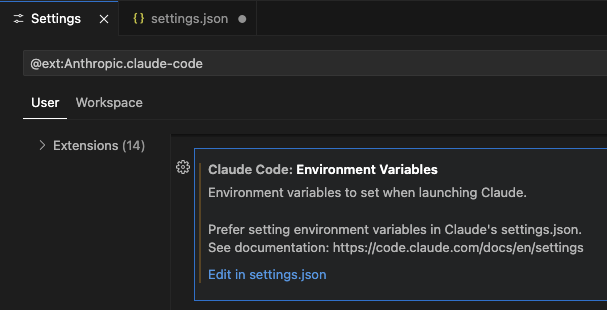

Luego configuramos las variables de entorno:

Luego configuramos las variables de entorno:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Y luego ya podemos ponernos manos a la obra.

Pregunta para reflexionar: ¿Sigue siendo el mismo Claude Code si no utilizas modelos de Anthropic?

Pregunta para reflexionar: ¿Sigue siendo el mismo Claude Code si no utilizas modelos de Anthropic?

La capacidad del modelo gpt-oss-20b-mlx que utilizamos, por supuesto, no se puede comparar con Opus 4.5, pero si tienes desplegado Kimi K2.5 en tu entorno local, actualmente parece que su capacidad no es en absoluto inferior a la de Opus 4.5.