Bombe atomique ! Guide pour des Tokens illimités en local avec Claude Code

Claude Code est puissant, mais la consommation de Tokens fait mal au foie !

Enfin, Claude Code peut fonctionner avec des modèles locaux, la configuration est très simple.

L'environnement suivant est un Mac Mini4. L'environnement Windows est également possible.

À notre époque, si vous jouez avec l'IA de bureau, il est recommandé d'opter pour un petit ordinateur Mac de la série M, comme le mini4\mini4 pro\m3 ultra\m4 max, un outil magique pour l'IA personnelle sur bureau.

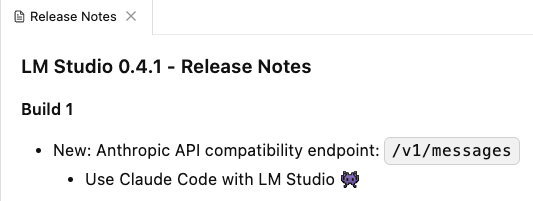

Tout d'abord, il faut mettre à jour LM Studio vers la dernière version, c'est-à-dire la 0.4.1, car la dernière version ajoute la prise en charge de Claude Code. (Ollama est également possible)

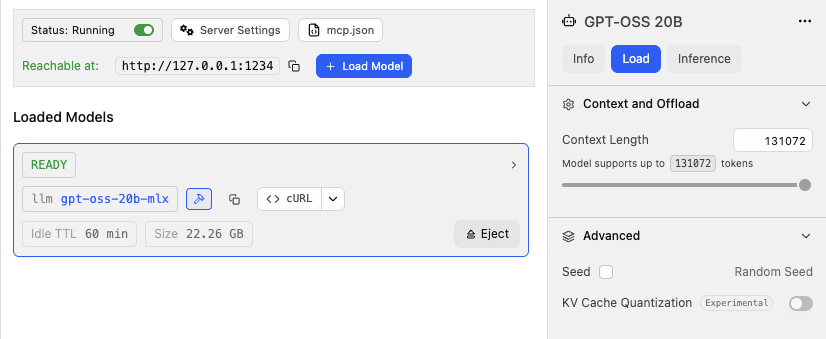

Vous pouvez exécuter n'importe quel modèle open source localement, tant que la mémoire de votre Mac est suffisante. Prenons l'exemple de gpt-oss-20b-mlx, c'est un modèle open source d'OpenAI.

Notez un point : la longueur du contexte doit être maximisée, c'est-à-dire tirée au maximum supporté par le modèle, car les performances des agents sur des tâches multi-tours dépendent beaucoup de la longueur du contexte, trop petite ne convient pas. Ce paramètre doit également être ajusté en équilibre avec la mémoire de votre Mac et la vitesse d'inférence du modèle. Autre point à noter : sous environnement Mac, téléchargez prioritairement les modèles au format MLX, la vitesse d'inférence est plus rapide que celle des modèles au format GGUF.

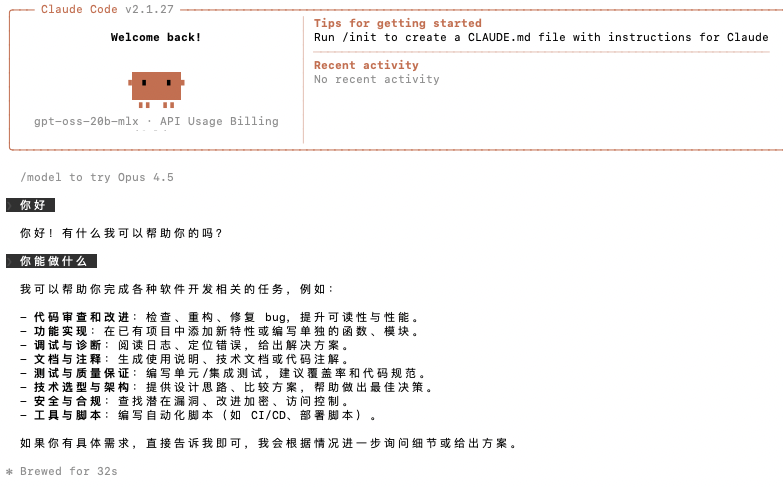

Ensuite, nous installons claude code dans le terminal en ligne de commande.

Configuration des variables d'environnement :

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Installation du corps de claude code :

npm install -g @anthropic-ai/claude-codePuis, lancez claude code :

claude --model gpt-oss-20b-mlxÀ ce moment, claude code utilisera votre modèle local pour produire les sorties.

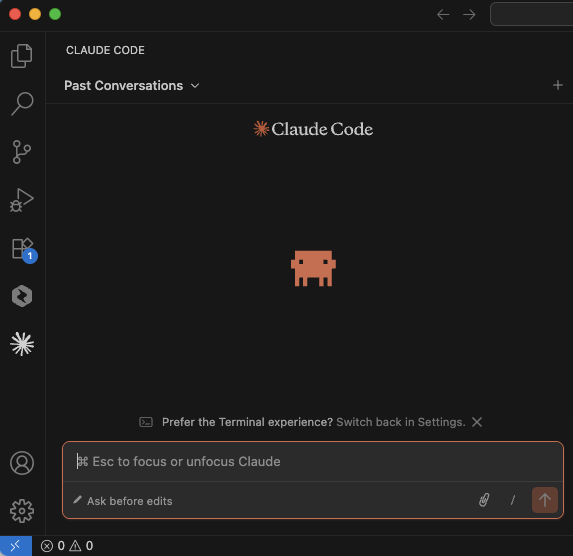

En plus de l'utilisation dans le terminal, il est également possible de l'utiliser dans VS Code, configuration comme suit :

En plus de l'utilisation dans le terminal, il est également possible de l'utiliser dans VS Code, configuration comme suit :

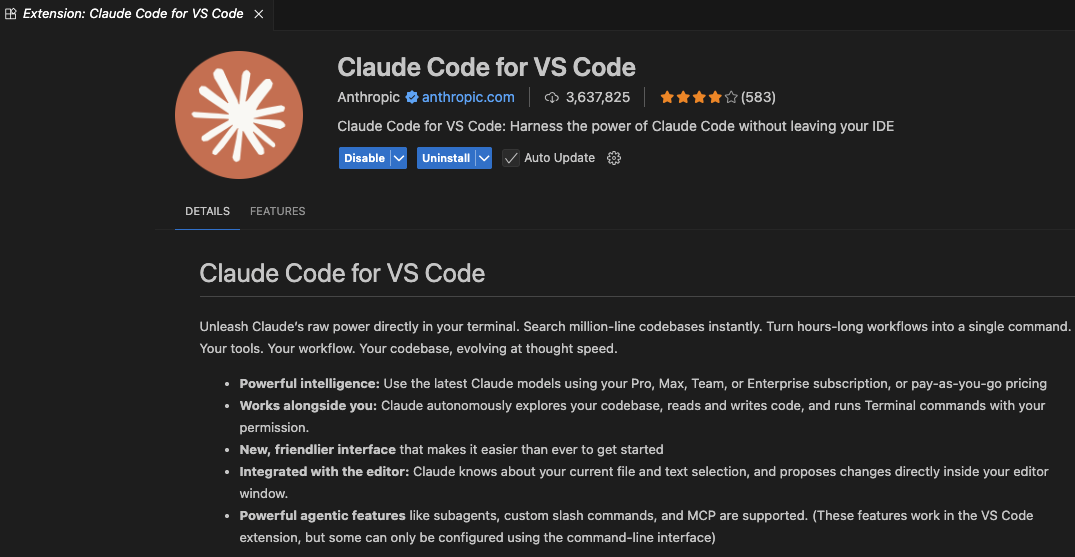

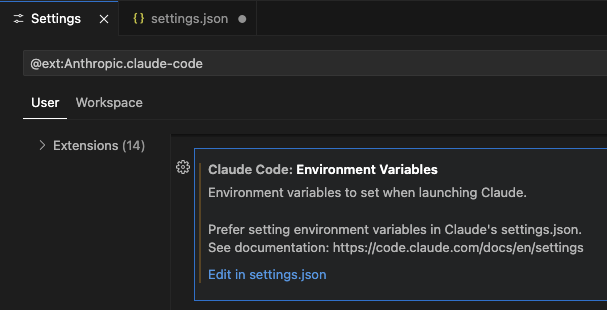

Nous installons d'abord l'extension Claude Code for VS Code.

Puis nous définissons les variables d'environnement :

Puis nous définissons les variables d'environnement :

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Ensuite, vous pouvez vous mettre au travail.

Question de réflexion : Claude Code sans utiliser les modèles d'Anthropic, est-ce toujours le même Claude Code ?

Question de réflexion : Claude Code sans utiliser les modèles d'Anthropic, est-ce toujours le même Claude Code ?

Le modèle gpt-oss-20b-mlx que nous utilisons n'est bien sûr pas comparable à Opus 4.5, mais si vous déployez Kimi K2.5 localement, il semble actuellement que ses capacités ne soient en rien inférieures à Opus 4.5.