Bom Telah Tiba! Panduan Token Tak Terbatas Lokal Claude Code

Claude Code sangat kuat, tetapi konsumsi Tokennya bikin sakit hati!

Akhirnya, Claude Code bisa bekerja dengan model lokal, konfigurasinya sangat sederhana.

Lingkungan berikut adalah Mac Mini4. Lingkungan Windows juga bisa.

Di era sekarang, jika bermain AI desktop, disarankan untuk membeli host kecil Mac seri M, seperti mini4\mini4 pro\m3 ultra\m4 max, alat AI desktop pribadi yang hebat.

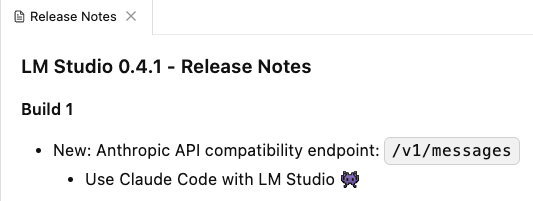

Pertama, perlu mengupgrade LM Studio ke versi terbaru, yaitu 0.4.1, karena versi terbaru menambahkan dukungan untuk Claude Code. (Ollama juga bisa)

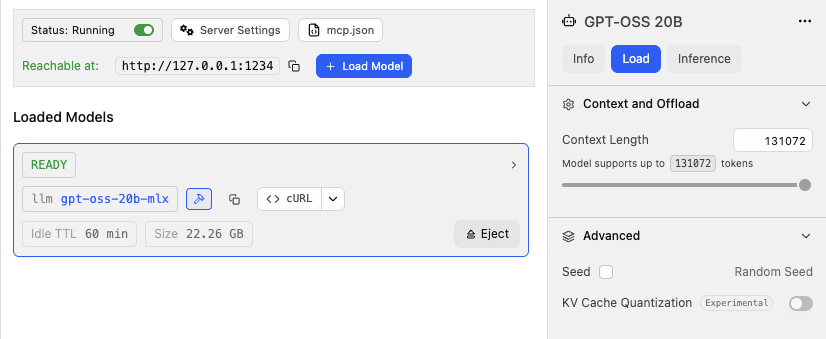

Anda bisa menggunakan model open source apa pun di lokal Anda, asalkan memori Mac Anda cukup. Kami ambil contoh gpt-oss-20b-mlx, ini adalah model open source dari OpenAI.

Perhatikan satu hal: Context length diisi penuh, yaitu panjang konteks ditarik ke maksimum yang didukung model, karena performa tugas multi-putaran agen sangat bergantung pada panjang konteks, terlalu kecil tidak bisa. Parameter ini juga perlu disesuaikan secara seimbang berdasarkan memori Mac Anda dan kecepatan inferensi model. Perhatikan lagi: Lingkungan Mac, unduh model format MLX terlebih dahulu, kecepatan inferensinya lebih cepat daripada model format GGUF.

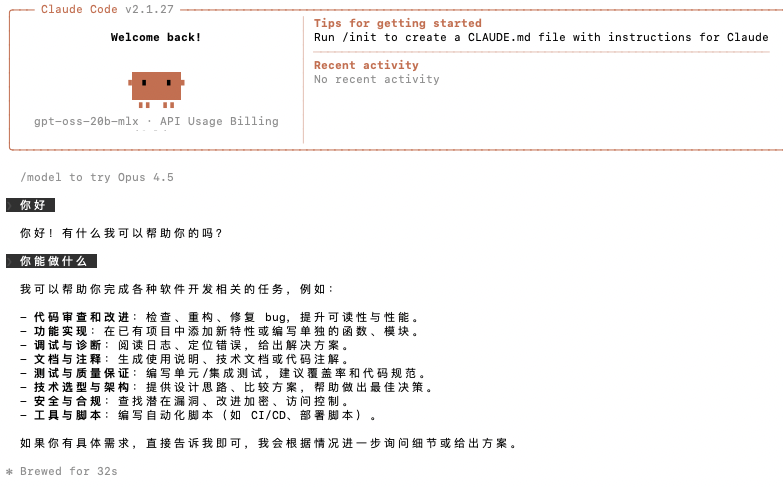

Selanjutnya, kita instal claude code di terminal command line.

Konfigurasi variabel lingkungan:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Instal claude code itu sendiri:

npm install -g @anthropic-ai/claude-codeKemudian, jalankan claude code:

claude --model gpt-oss-20b-mlxSaat ini, claude code akan memanggil model lokal Anda untuk menghasilkan output.

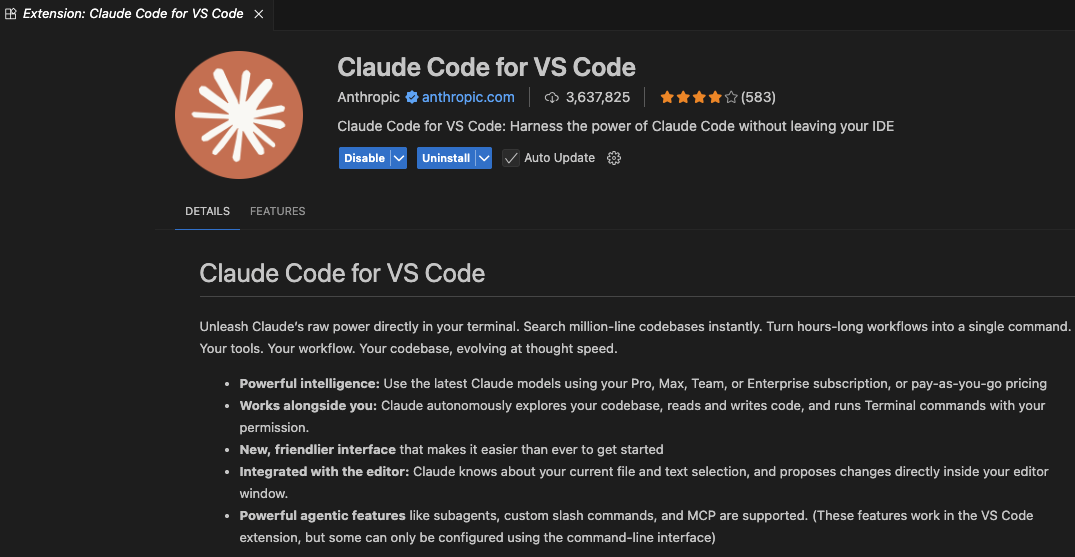

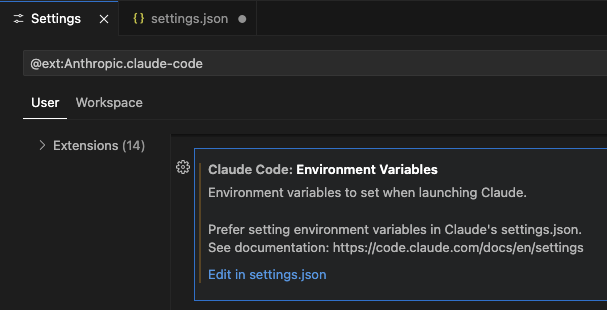

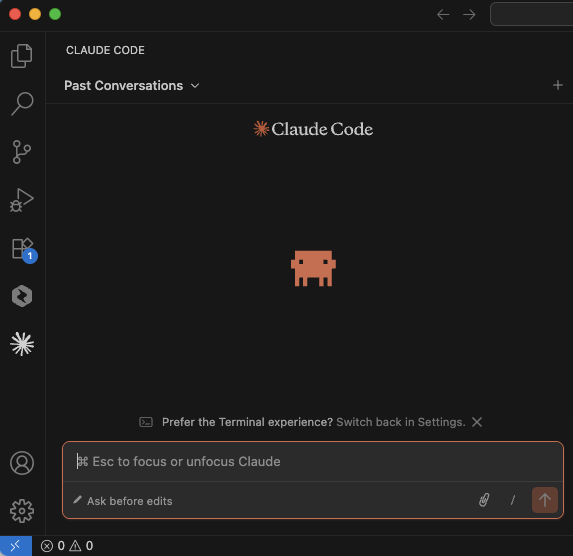

Selain digunakan di terminal, juga bisa digunakan di VS Code, konfigurasinya sebagai berikut:

Selain digunakan di terminal, juga bisa digunakan di VS Code, konfigurasinya sebagai berikut:

Pertama kita instal plugin Claude Code for VS Code.

Kemudian atur variabel lingkungan:

Kemudian atur variabel lingkungan:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Kemudian bisa mulai bekerja.

Pertanyaan renungan: Apakah Claude Code yang tidak menggunakan model Anthropic masih Claude Code itu?

Pertanyaan renungan: Apakah Claude Code yang tidak menggunakan model Anthropic masih Claude Code itu?

Kemampuan model gpt-oss-20b-mlx yang kita gunakan tentu tidak bisa dibandingkan dengan Opus 4.5, tetapi, jika Anda telah menerapkan Kimi K2.5 di lingkungan lokal, sejauh ini, kemampuannya tidak kalah dengan Opus 4.5.