Bomba In Arrivo! Guida a Token Illimitati Locali con Claude Code

Claude Code è potente, ma il consumo di Token fa male al fegato!

Finalmente, Claude Code può lavorare con modelli locali, la configurazione è molto semplice.

L'ambiente seguente è Mac Mini4. Anche l'ambiente Windows è possibile.

Nell'era attuale, se giochi con l'AI desktop, si consiglia di acquistare un piccolo host Mac della serie M, come mini4\mini4 pro\m3 ultra\m4 max, un vero e proprio strumento magico per l'AI desktop personale.

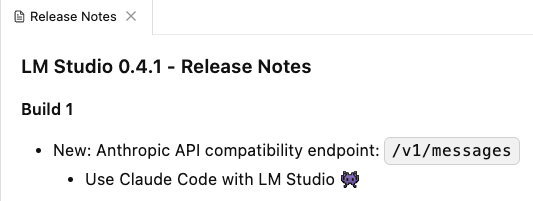

Innanzitutto, è necessario aggiornare LM Studio all'ultima versione, cioè la 0.4.1, perché l'ultima versione aggiunge il supporto per Claude Code. (Anche Ollama va bene)

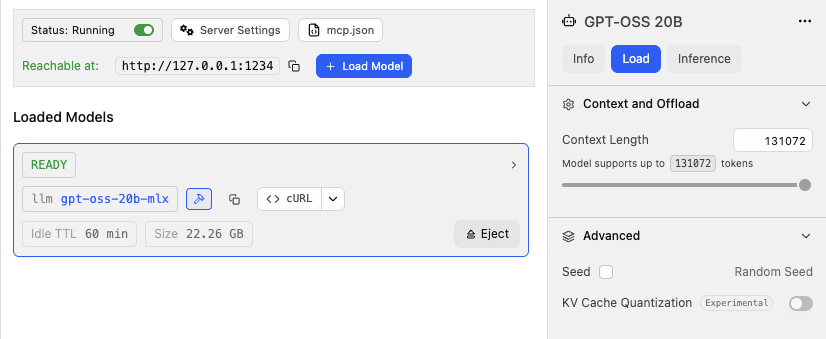

Puoi caricare qualsiasi modello open source locale, purché la memoria del tuo Mac sia sufficiente. Prendiamo come esempio gpt-oss-20b-mlx, che è un modello open source di OpenAI.

Nota un punto: imposta la lunghezza del contesto al massimo, cioè porta la lunghezza del contesto al massimo supportato dal modello, perché le prestazioni dell'agente in compiti multi-turn dipendono molto dalla lunghezza del contesto, se è troppo piccola non va bene. Questo parametro deve essere bilanciato e regolato anche in base alla memoria del tuo Mac e alla velocità di inferenza del modello. Un altro punto da notare: in ambiente Mac, scarica prioritariamente modelli in formato MLX, la velocità di inferenza è più veloce rispetto ai modelli in formato GGUF.

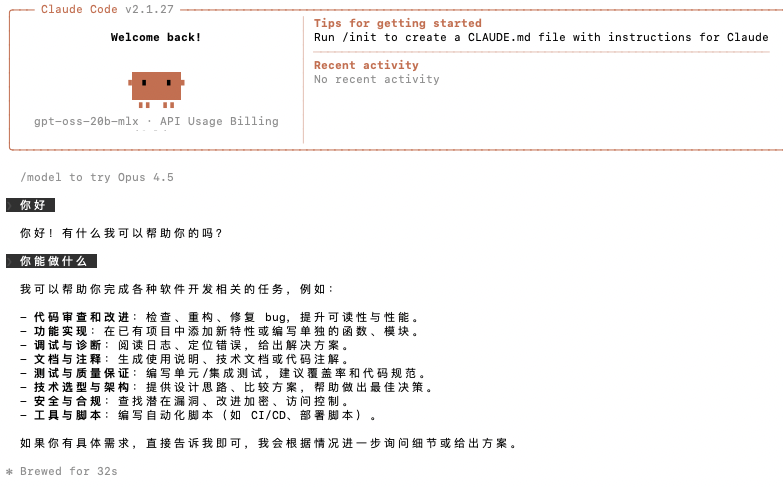

Successivamente, installiamo claude code nel terminale della riga di comando.

Configura le variabili d'ambiente:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Installa il corpo di claude code:

npm install -g @anthropic-ai/claude-codeQuindi, avvia claude code:

claude --model gpt-oss-20b-mlxA questo punto, claude code chiamerà il tuo modello locale per l'output.

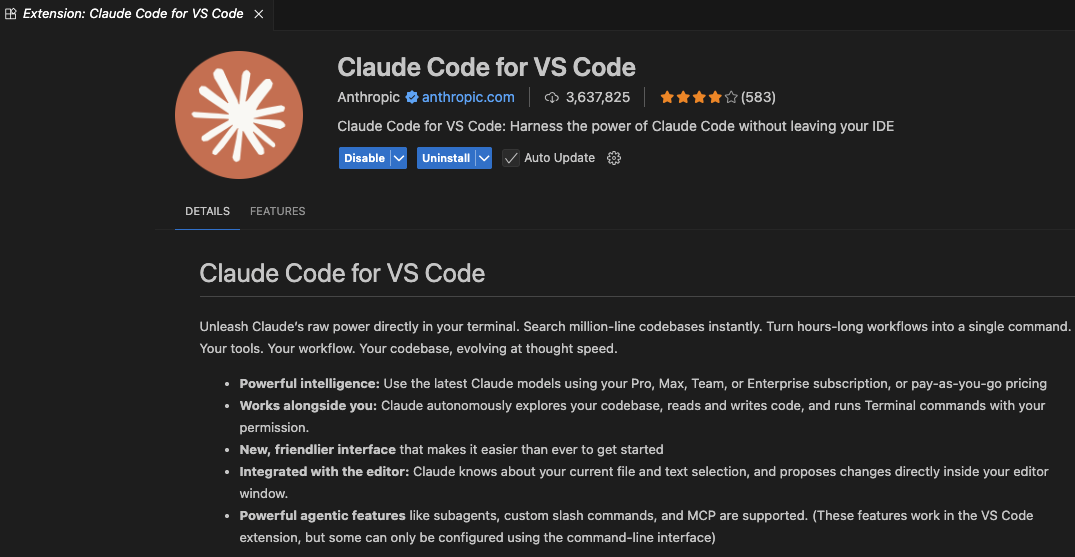

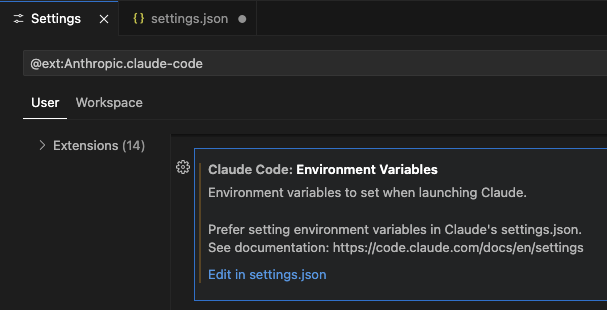

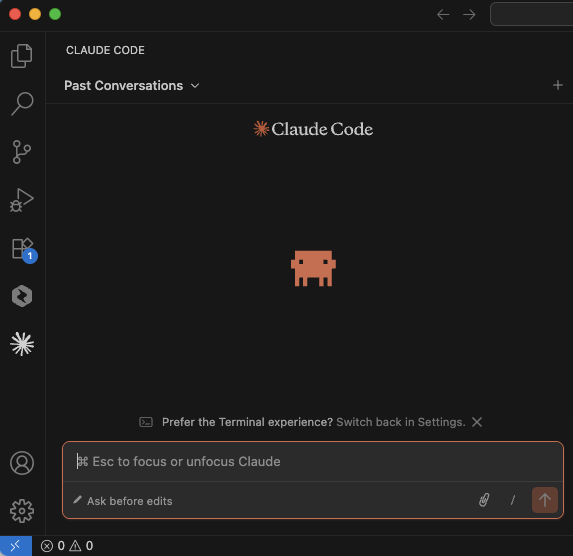

Oltre all'uso nel terminale, puoi anche usarlo in VS Code, la configurazione è la seguente:

Oltre all'uso nel terminale, puoi anche usarlo in VS Code, la configurazione è la seguente:

Innanzitutto installiamo il plugin Claude Code for VS Code.

Quindi impostiamo le variabili d'ambiente:

Quindi impostiamo le variabili d'ambiente:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}E poi si può iniziare a lavorare.

Domanda di riflessione: Claude Code che non utilizza modelli Anthropic è ancora quel Claude Code?

Domanda di riflessione: Claude Code che non utilizza modelli Anthropic è ancora quel Claude Code?

Le capacità del modello gpt-oss-20b-mlx che usiamo ovviamente non sono paragonabili a Opus 4.5, ma se nel tuo ambiente locale hai distribuito Kimi K2.5, attualmente sembra che le capacità non siano affatto inferiori a Opus 4.5.