王炸が来た!Claude Codeでローカル無限トークン攻略法

Claude Codeは強力ですが、トークンの消費が心臓に悪いです!

ついに、Claude Codeがローカルモデルで動作可能になり、設定は非常に簡単です。

以下の環境はMac Mini4です。Windows環境でも可能です。

現在の時代、デスクトップAIを楽しむなら、Mac Mシリーズの小型ホスト、例えばmini4\mini4 pro\m3 ultra\m4 maxを入手することをお勧めします。個人用デスクトップAIの神器です。

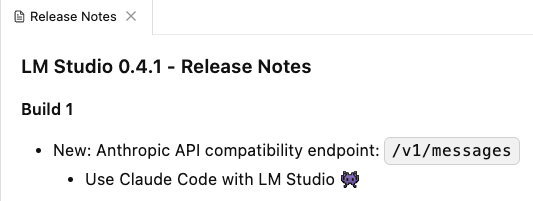

まず、LM Studioを最新版、つまり0.4.1にアップグレードする必要があります。最新版はClaude Codeのサポートを追加しているからです。(Ollamaも可能です)

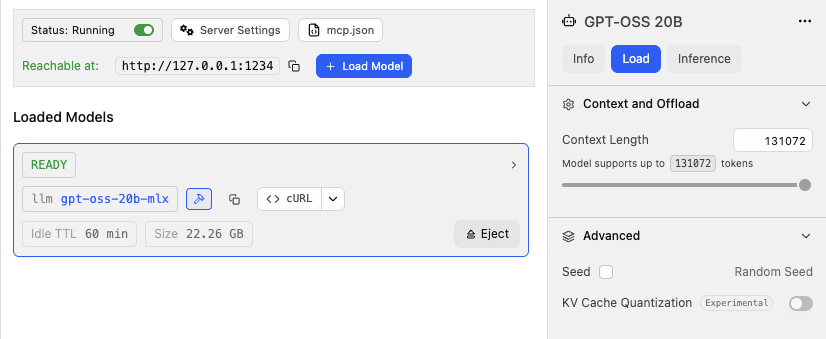

Macのメモリが十分であれば、任意のオープンソースモデルをローカルで使用できます。例としてgpt-oss-20b-mlxを取り上げます。これはOpenAIのオープンソースモデルです。

注意点:Context lengthを最大に、つまりモデルがサポートする最大のコンテキスト長に設定してください。エージェントのマルチタスク性能はコンテキストの長さに大きく依存し、短すぎるとダメです。このパラメータはMacのメモリとモデルの推論速度のバランスを考慮して調整する必要があります。もう一つの注意点:Mac環境では、MLX形式のモデルを優先的にダウンロードしてください。GGUF形式のモデルよりも推論速度が速いです。

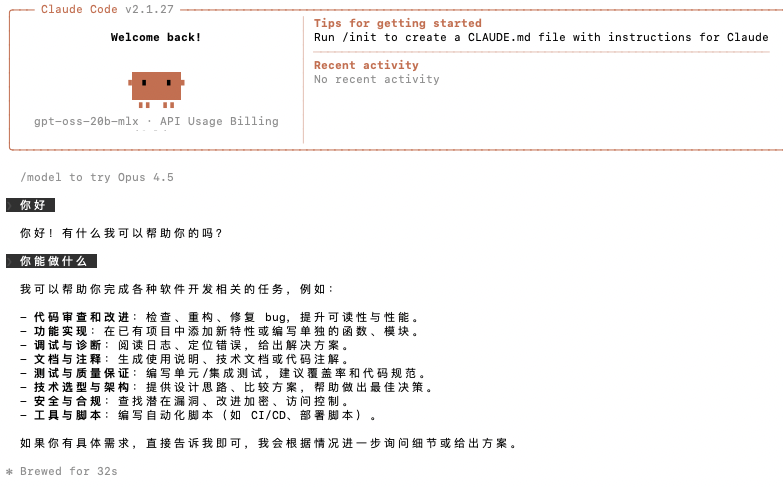

次に、コマンドライン端末でclaude codeをインストールします。

環境変数を設定:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234claude code本体をインストール:

npm install -g @anthropic-ai/claude-codeそして、claude codeを起動:

claude --model gpt-oss-20b-mlxこれで、claude codeはローカルモデルを呼び出して出力します。

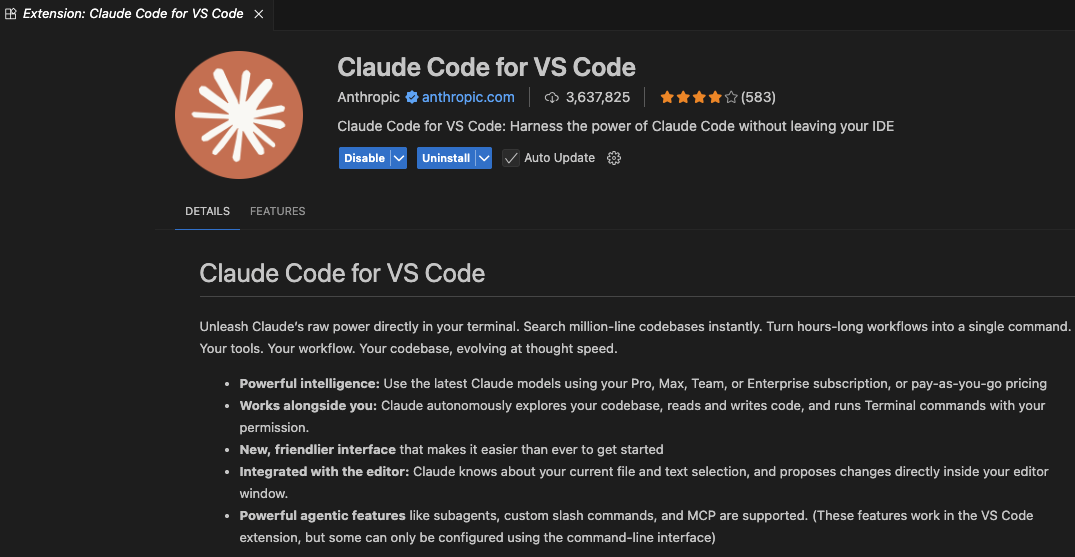

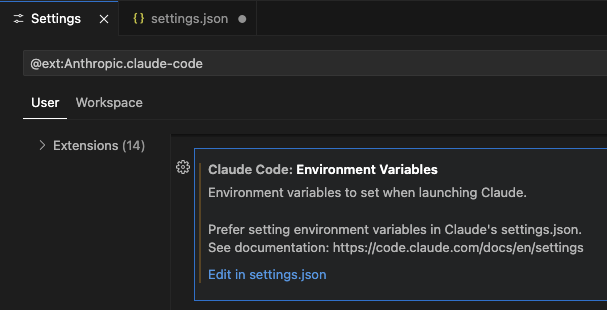

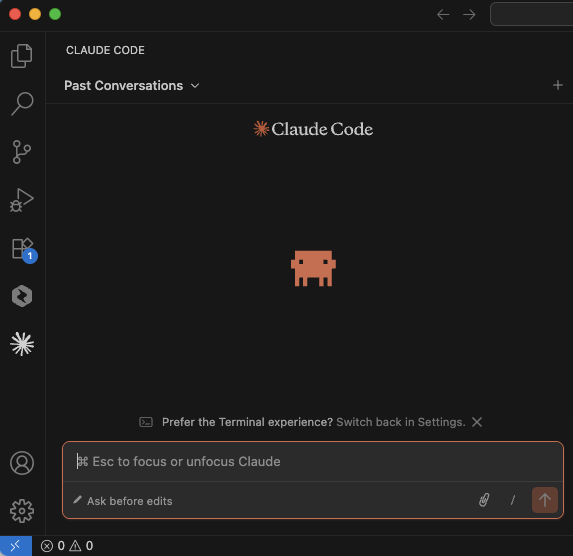

端末で使用する他に、VS Codeでも使用可能です。設定は以下の通り:

端末で使用する他に、VS Codeでも使用可能です。設定は以下の通り:

まず、Claude Code for VS Codeプラグインをインストールします。

次に環境変数を設定:

次に環境変数を設定:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}これで作業を開始できます。

思考問題:Anthropicモデルを使用しないClaude Codeは、あのClaude Codeのままですか?

思考問題:Anthropicモデルを使用しないClaude Codeは、あのClaude Codeのままですか?

使用したgpt-oss-20b-mlxモデルの能力は、Opus 4.5とは比較になりませんが、ローカル環境にKimi K2.5をデプロイした場合、現時点では能力はOpus 4.5に全く引けを取りません。