왕폭탄 등장! Claude Code 로컬 무제한 Token 공략

Claude Code는 강력하지만, Token 소모가 정말 아깝습니다!

드디어 Claude Code가 로컬 모델과 연동하여 작동할 수 있게 되었으며, 설정은 매우 간단합니다.

다음 환경은 Mac Mini4 기준입니다. Windows 환경에서도 가능합니다.

현재 시대에 데스크탑 AI를 활용하려면 Mac M 시리즈 미니 PC, 예를 들어 mini4\mini4 pro\m3 ultra\m4 max 등을 구입하는 것을 추천합니다. 개인용 데스크탑 AI의 명기입니다.

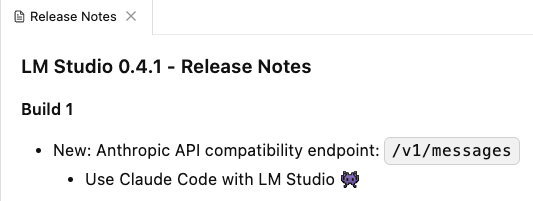

먼저, LM Studio를 최신 버전인 0.4.1로 업그레이드해야 합니다. 최신 버전에 Claude Code 지원이 추가되었기 때문입니다. (Ollama도 가능합니다)

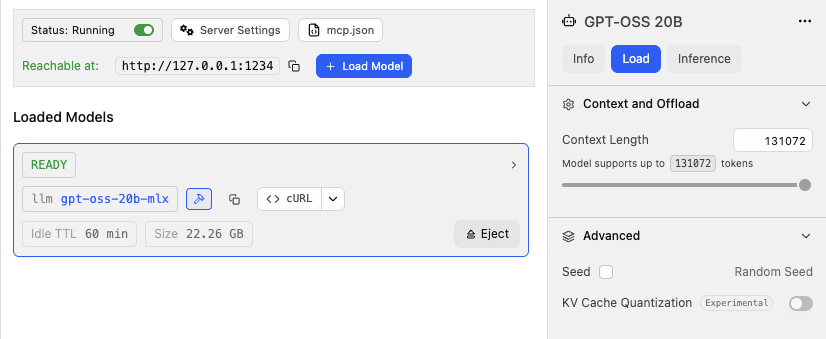

Mac 메모리가 충분하다면 로컬에 어떤 오픈소스 모델이든 사용할 수 있습니다. 여기서는 gpt-oss-20b-mlx를 예로 들겠습니다. 이는 OpenAI의 오픈소스 모델입니다.

주의할 점: Context length를 최대로 설정하세요. 즉, 모델이 지원하는 최대 컨텍스트 길이까지 늘려야 합니다. 에이전트의 다중 작업 성능은 컨텍스트 길이에 크게 의존하기 때문에 짧으면 안 됩니다. 이 매개변수는 Mac의 메모리와 모델의 추론 속도를 고려하여 균형 있게 조정해야 합니다. 또 다른 주의점: Mac 환경에서는 우선 MLX 형식의 모델을 다운로드하세요. GGUF 형식 모델보다 추론 속도가 빠릅니다.

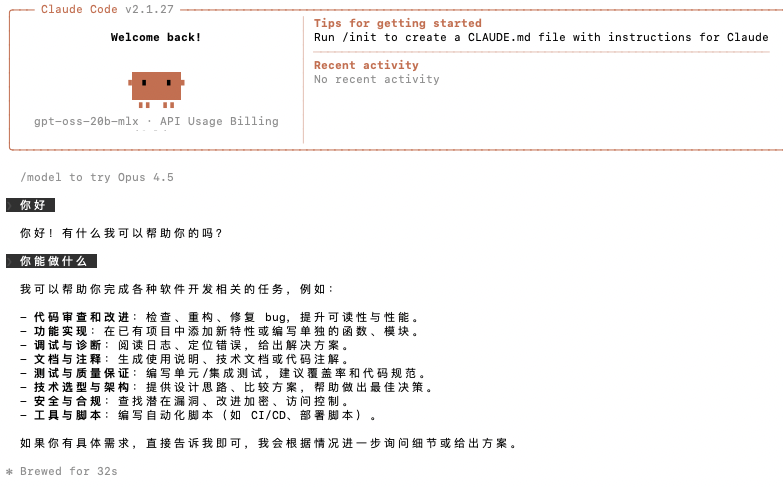

다음으로, 명령줄 터미널에서 claude code를 설치합니다.

환경 변수 설정:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234claude code 본체 설치:

npm install -g @anthropic-ai/claude-code그런 다음, claude code를 시작합니다:

claude --model gpt-oss-20b-mlx이제 claude code가 로컬 모델을 호출하여 출력합니다.

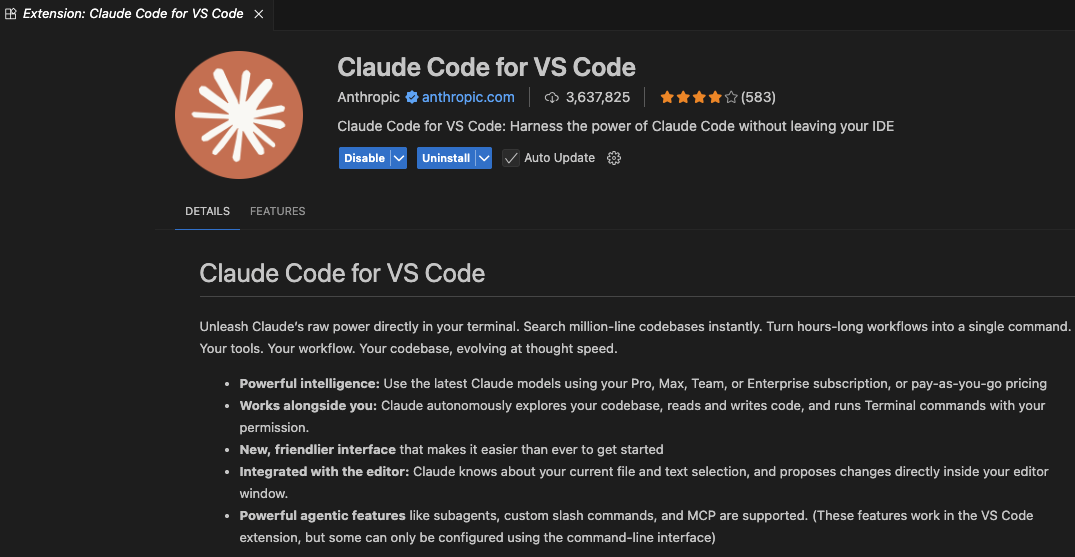

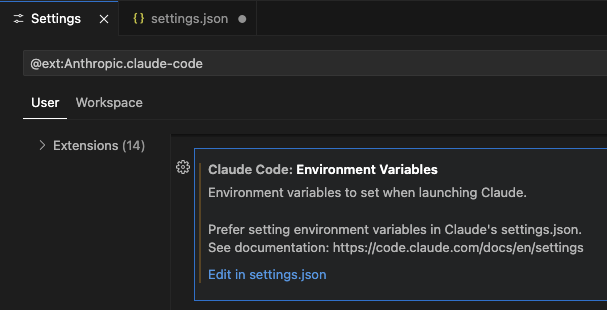

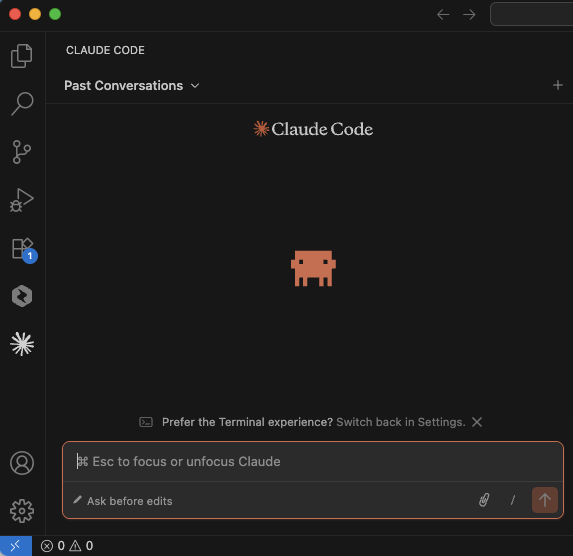

터미널에서 사용하는 것 외에도 VS Code에서도 사용할 수 있으며, 설정은 다음과 같습니다:

터미널에서 사용하는 것 외에도 VS Code에서도 사용할 수 있으며, 설정은 다음과 같습니다:

먼저 Claude Code for VS Code 확장 프로그램을 설치합니다.

그런 다음 환경 변수를 설정합니다:

그런 다음 환경 변수를 설정합니다:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}그러면 작업을 시작할 수 있습니다.

생각해 볼 문제: Anthropic 모델을 사용하지 않는 Claude Code는 여전히 그 Claude Code일까요?

생각해 볼 문제: Anthropic 모델을 사용하지 않는 Claude Code는 여전히 그 Claude Code일까요?

우리가 사용하는 gpt-oss-20b-mlx 모델의 능력은 물론 Opus 4.5와 비교할 수 없지만, 로컬 환경에 Kimi K2.5를 배포했다면 현재로서는 능력이 Opus 4.5에 전혀 뒤지지 않습니다.