Bombe kommer! Guide til ubegrenset Token med Claude Code lokalt

Claude Code er kraftig, men Token-forbruket gjør det smertefullt!

Endelig kan Claude Code kobles til lokale modeller, og oppsettet er veldig enkelt.

Følgende miljø er Mac Mini4. Windows-miljø er også mulig.

I dagens tidsalder, hvis du skal drive med desktop-AI, anbefales det å anskaffe en Mac M-serie minidatamaskin, som mini4\mini4 pro\m3 ultra\m4 max, et personlig desktop-AI-våpen.

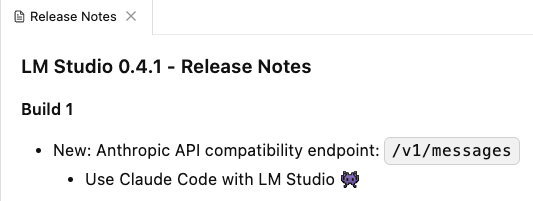

Først må du oppgradere LM Studio til nyeste versjon, altså 0.4.1, fordi den nyeste versjonen har lagt til støtte for Claude Code. (Ollama fungerer også)

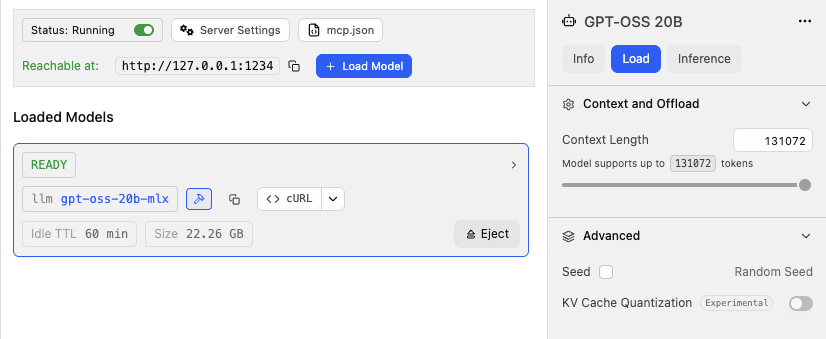

Du kan laste ned hvilken som helst åpen kildekode-modell lokalt, så lenge Mac-minnet ditt er stort nok. Vi tar gpt-oss-20b-mlx som eksempel, dette er en OpenAI-modell med åpen kildekode.

Vær oppmerksom på ett punkt: Dra Context length til maks, det vil si dra kontekstlengden til modellens støttede maksimum, fordi intelligente agenters ytelse på fleroppgaver er svært avhengig av kontekstlengden, for kort fungerer ikke. Denne parameteren må også justeres i balanse med Mac-minnet ditt og modellens slutningshastighet. Vær også oppmerksom på ett punkt til: I Mac-miljø, last ned MLX-formatmodeller først, slutningshastigheten er raskere enn GGUF-formatmodeller.

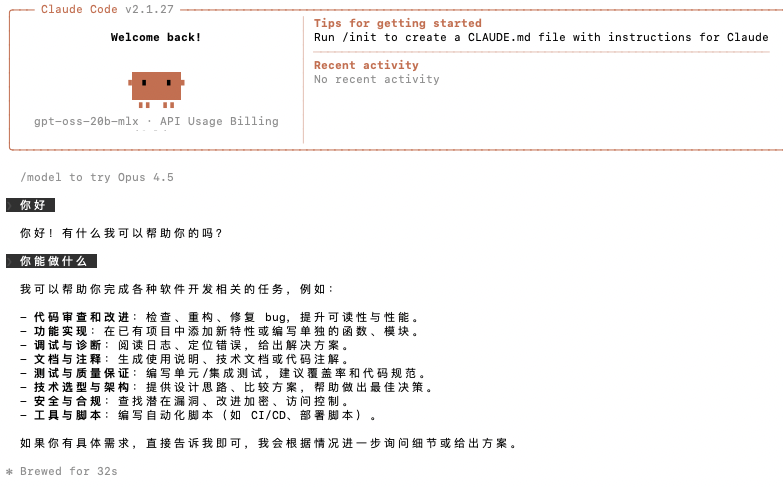

Deretter installerer vi claude code i kommandolinjeterminalen.

Konfigurer miljøvariabler:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Installer claude code-kjernen:

npm install -g @anthropic-ai/claude-codeStart deretter claude code:

claude --model gpt-oss-20b-mlxPå dette tidspunktet vil claude code bruke din lokale modell for å produsere output.

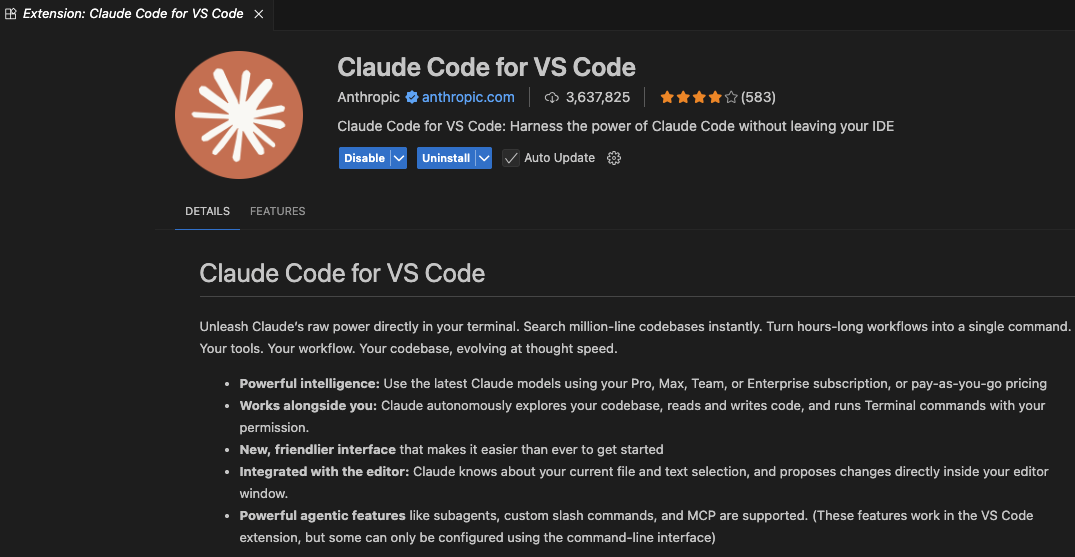

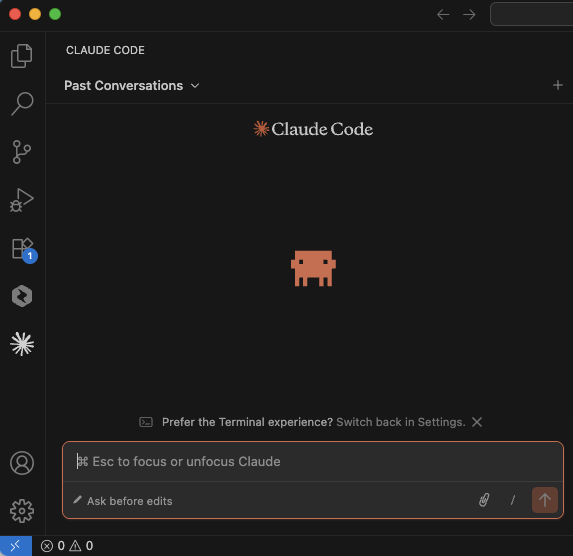

I tillegg til å bruke den i terminalen, kan den også brukes i VS Code, konfigurasjon som følger:

I tillegg til å bruke den i terminalen, kan den også brukes i VS Code, konfigurasjon som følger:

Vi installerer først Claude Code for VS Code-tillegget.

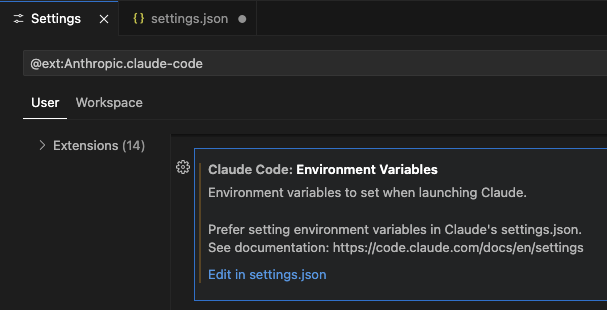

Deretter setter vi miljøvariablene:

Deretter setter vi miljøvariablene:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Så kan du komme i gang.

Tenkeoppgave: Er Claude Code som ikke bruker Anthropic-modeller fortsatt den samme Claude Code?

Tenkeoppgave: Er Claude Code som ikke bruker Anthropic-modeller fortsatt den samme Claude Code?

Modellen gpt-oss-20b-mlx vi bruker kan selvfølgelig ikke sammenlignes med Opus 4.5, men hvis du har deployet Kimi K2.5 lokalt, ser det for øyeblikket ut til at evnene ikke er det ringeste tilbakestående i forhold til Opus 4.5.