De Bom Barst Los! Gids voor Onbeperkte Tokens met Claude Code Lokaal

Claude Code is krachtig, maar het tokenverbruik doet pijn!

Eindelijk kan Claude Code met lokale modellen werken, en de configuratie is heel eenvoudig.

De volgende omgeving is een Mac Mini4. Een Windows-omgeving is ook mogelijk.

In het huidige tijdperk, als je met desktop-AI wilt spelen, is het aan te raden een Mac M-serie minicomputer aan te schaffen, zoals de mini4\mini4 pro\m3 ultra\m4 max, een persoonlijk desktop-AI-wonder.

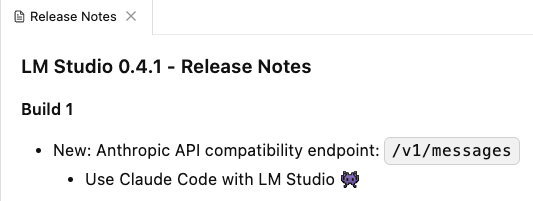

Ten eerste moet LM Studio worden geüpgraded naar de nieuwste versie, namelijk 0.4.1, omdat de nieuwste versie ondersteuning voor Claude Code toevoegt. (Ollama kan ook)

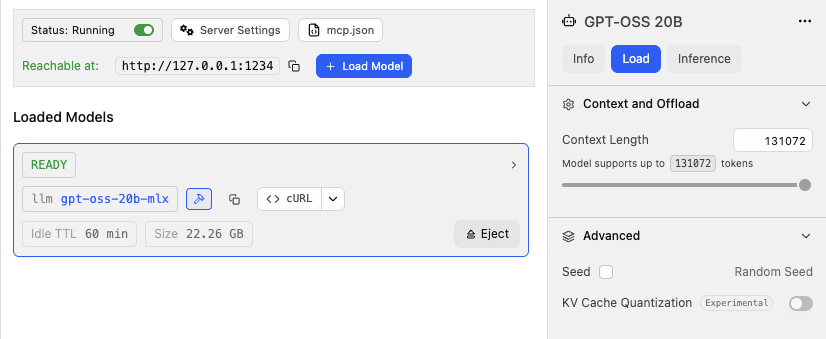

Je kunt elk open-source model lokaal draaien, zolang het geheugen van je Mac maar groot genoeg is. We nemen gpt-oss-20b-mlx als voorbeeld, dit is een open-source model van OpenAI.

Let op één punt: trek de Context length voluit, dat wil zeggen, trek de contextlengte tot het maximum dat het model ondersteunt, omdat de prestaties van de agent bij meerdere taken sterk afhankelijk zijn van de contextlengte, te kort werkt niet. Deze parameter moet ook in evenwicht worden gebracht op basis van het geheugen van je Mac en de inferentiesnelheid van het model. Let ook op: voor de Mac-omgeving, download bij voorkeur modellen in MLX-formaat, de inferentiesnelheid is sneller dan modellen in GGUF-formaat.

Vervolgens installeren we claude code in de commandoregelterminal.

Configureer omgevingsvariabelen:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Installeer de claude code-kern:

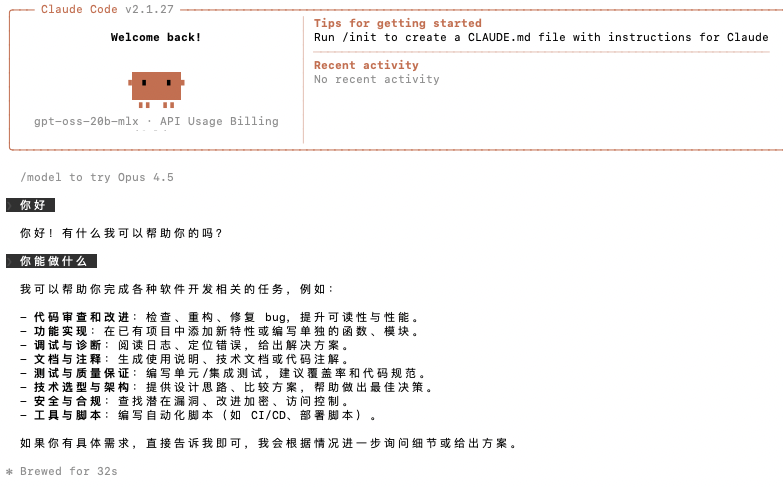

npm install -g @anthropic-ai/claude-codeStart vervolgens claude code:

claude --model gpt-oss-20b-mlxOp dit moment zal claude code je lokale model aanroepen voor output.

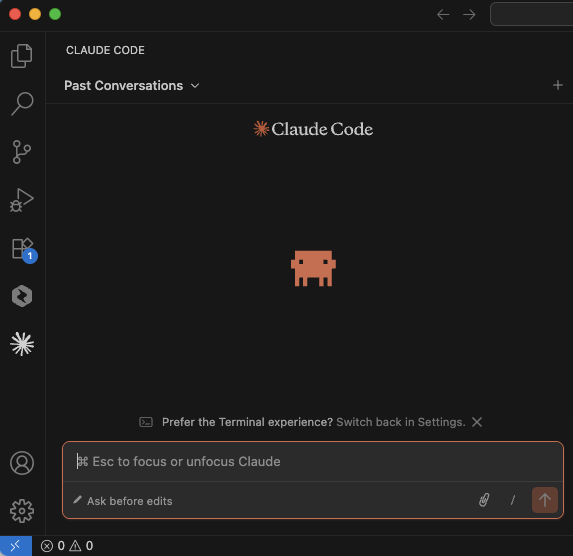

Naast gebruik in de terminal, kan het ook in VS Code worden gebruikt, configuratie als volgt:

Naast gebruik in de terminal, kan het ook in VS Code worden gebruikt, configuratie als volgt:

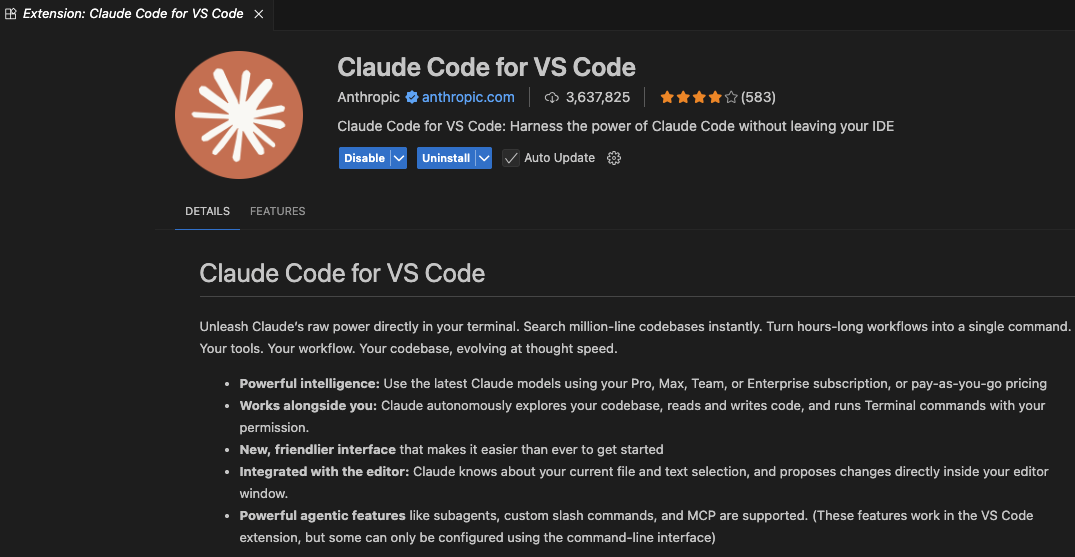

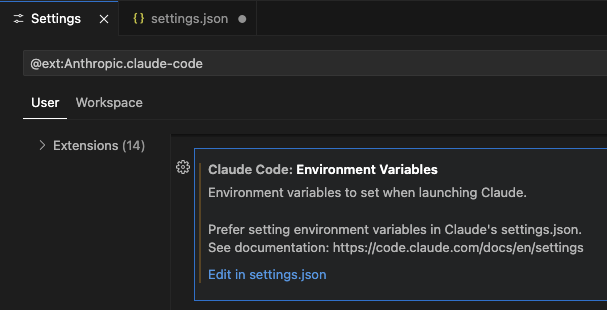

We installeren eerst de Claude Code for VS Code-extensie.

Stel vervolgens de omgevingsvariabelen in:

Stel vervolgens de omgevingsvariabelen in:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Dan kun je aan de slag.

Denkvraag: Is Claude Code zonder het gebruik van Anthropic-modellen nog steeds dezelfde Claude Code?

Denkvraag: Is Claude Code zonder het gebruik van Anthropic-modellen nog steeds dezelfde Claude Code?

Het gpt-oss-20b-mlx-model dat we gebruiken kan natuurlijk niet tippen aan Opus 4.5, maar als je Kimi K2.5 lokaal hebt geïmplementeerd, lijkt het erop dat de prestaties niet onderdoen voor Opus 4.5.