Piorunujące uderzenie! Przewodnik po nieograniczonych tokenach Claude Code w lokalnym środowisku

Claude Code jest potężny, ale zużycie tokenów przyprawia o ból głowy!

Wreszcie Claude Code może współpracować z lokalnymi modelami, a konfiguracja jest bardzo prosta.

Poniższe środowisko to Mac Mini4. Środowisko Windows również jest możliwe.

W obecnych czasach, jeśli chcesz korzystać z AI na komputerze stacjonarnym, zaleca się zakup małego komputera Mac z serii M, takiego jak mini4\mini4 pro\m3 ultra\m4 max – to osobiste narzędzie do AI na biurku.

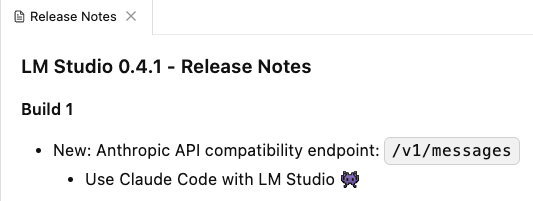

Po pierwsze, należy zaktualizować LM Studio do najnowszej wersji, czyli 0.4.1, ponieważ najnowsza wersja dodaje obsługę Claude Code. (Ollama również jest możliwy.)

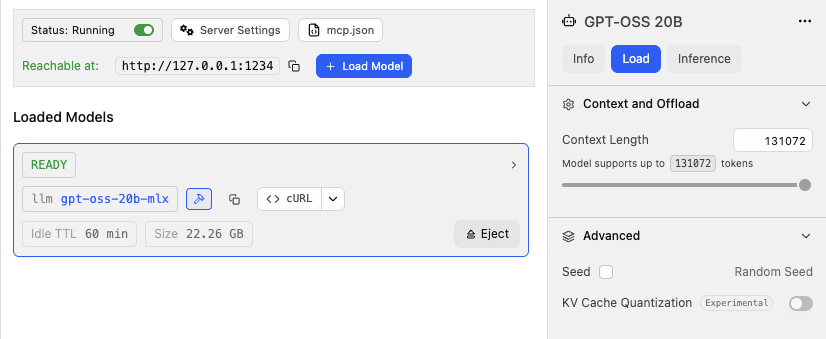

Możesz używać dowolnego modelu open source lokalnie, o ile pamięć Twojego Maca wystarczy. Jako przykład weźmy gpt-oss-20b-mlx, który jest modelem open source od OpenAI.

Uwaga: Długość kontekstu należy ustawić na maksimum, czyli na maksymalną długość obsługiwaną przez model, ponieważ wydajność agenta w zadaniach wieloetapowych bardzo zależy od długości kontekstu – zbyt krótki nie zadziała. Ten parametr należy również dostosować, równoważąc pamięć Twojego Maca i szybkość wnioskowania modelu. Kolejna uwaga: W środowisku Mac priorytetowo pobieraj modele w formacie MLX, ponieważ są szybsze w wnioskowaniu niż modele w formacie GGUF.

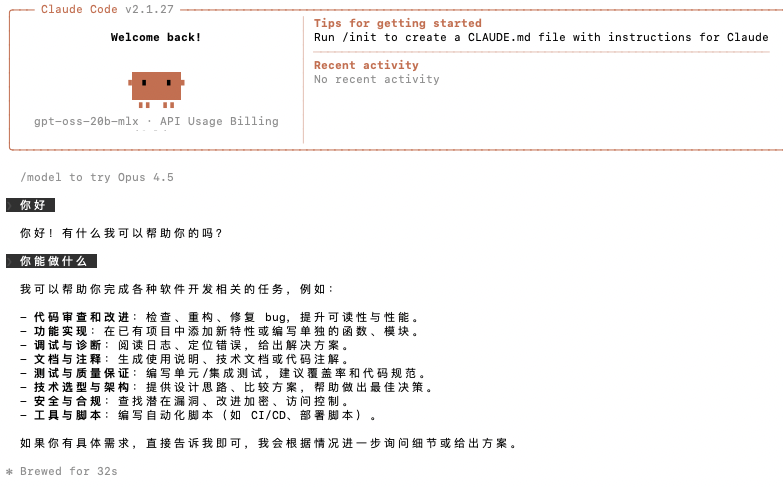

Następnie instalujemy claude code w terminalu wiersza poleceń.

Konfiguracja zmiennych środowiskowych:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Instalacja głównego pakietu claude code:

npm install -g @anthropic-ai/claude-codeNastępnie uruchamiamy claude code:

claude --model gpt-oss-20b-mlxW tym momencie claude code będzie korzystać z Twojego lokalnego modelu do generowania wyników.

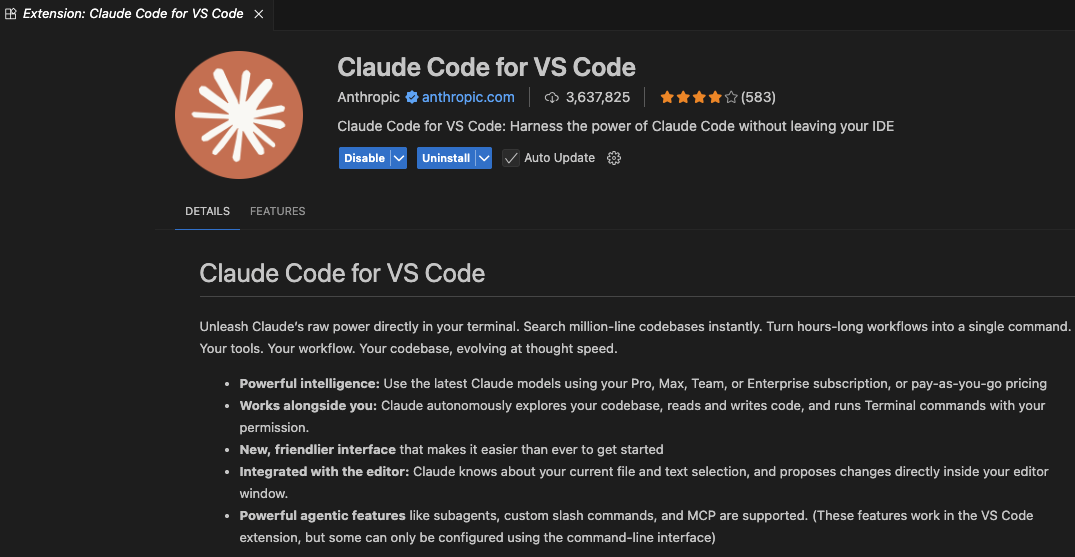

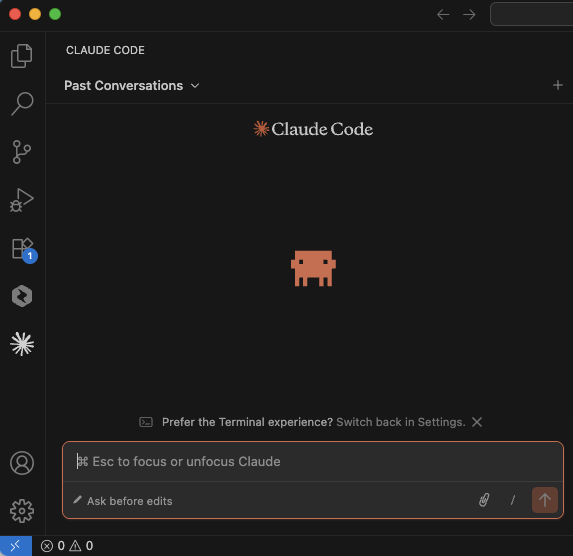

Oprócz używania w terminalu, można również korzystać w VS Code, konfiguracja jest następująca:

Oprócz używania w terminalu, można również korzystać w VS Code, konfiguracja jest następująca:

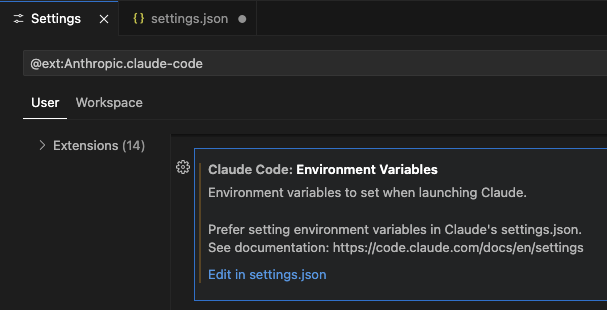

Najpierw instalujemy wtyczkę Claude Code for VS Code.

Następnie ustawiamy zmienne środowiskowe:

Następnie ustawiamy zmienne środowiskowe:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Następnie można przystąpić do pracy.

Pytanie do przemyślenia: Czy Claude Code, który nie używa modeli Anthropic, nadal jest tym samym Claude Code?

Pytanie do przemyślenia: Czy Claude Code, który nie używa modeli Anthropic, nadal jest tym samym Claude Code?

Używany przez nas model gpt-oss-20b-mlx oczywiście nie może równać się z Opus 4.5, ale jeśli w lokalnym środowisku wdrożysz Kimi K2.5, obecnie wydaje się, że jego możliwości wcale nie ustępują Opus 4.5.