Ataque Explosivo! Guia para Tokens Ilimitados Locais do Claude Code

O Claude Code é muito poderoso, mas o consumo de Tokens dói no fígado!

Finalmente, o Claude Code pode trabalhar com modelos locais, e a configuração é muito simples.

O ambiente a seguir é o Mac Mini4. O ambiente Windows também é possível.

Na era atual, se você quer brincar com IA de desktop, recomendo adquirir um pequeno host Mac da série M, como mini4\mini4 pro\m3 ultra\m4 max, um verdadeiro artefato de IA para desktop pessoal.

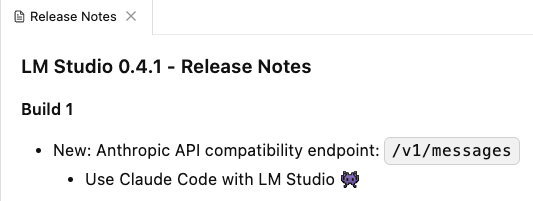

Primeiro, é necessário atualizar o LM Studio para a versão mais recente, ou seja, a 0.4.1, porque a versão mais nova adicionou suporte ao Claude Code. (Ollama também é possível)

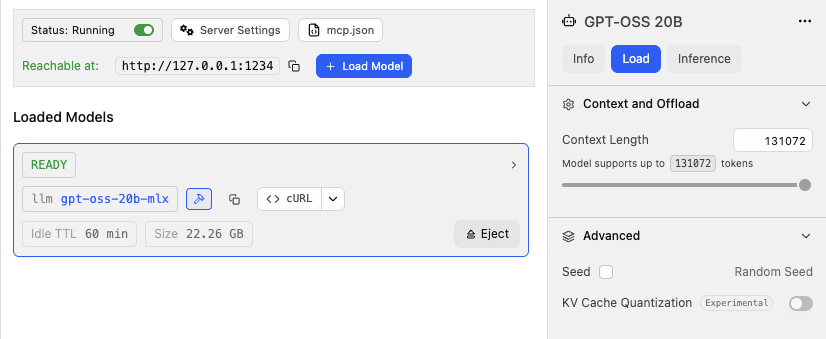

Você pode usar qualquer modelo de código aberto localmente, desde que a memória do seu Mac seja suficiente. Vamos usar o gpt-oss-20b-mlx como exemplo, que é um modelo de código aberto da OpenAI.

Atenção a um ponto: ajuste o Context length ao máximo, ou seja, o comprimento do contexto até o máximo suportado pelo modelo, porque o desempenho de tarefas multi-turn do agente depende muito do comprimento do contexto, se for pequeno não funciona. Este parâmetro também deve ser ajustado de forma equilibrada de acordo com a memória do seu Mac e a velocidade de inferência do modelo. Outro ponto de atenção: no ambiente Mac, priorize o download de modelos no formato MLX, a velocidade de inferência é mais rápida do que a dos modelos no formato GGUF.

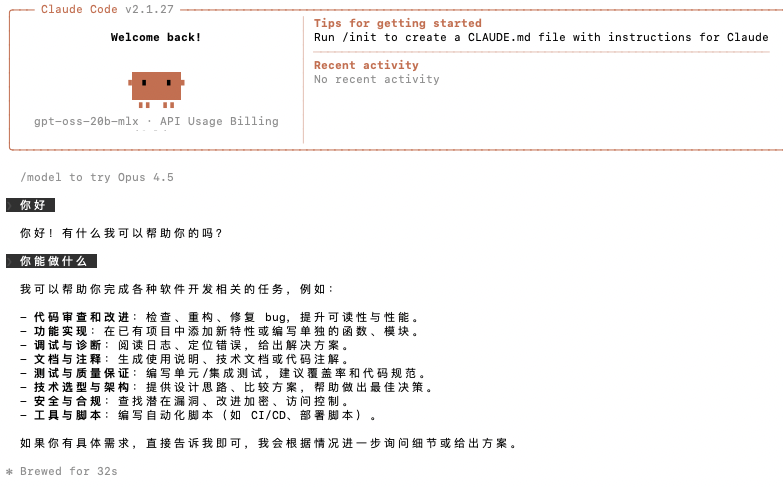

A seguir, instalamos o claude code no terminal de linha de comando.

Configure as variáveis de ambiente:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Instale o claude code em si:

npm install -g @anthropic-ai/claude-codeEm seguida, inicie o claude code:

claude --model gpt-oss-20b-mlxNeste momento, o claude code irá chamar seu modelo local para gerar a saída.

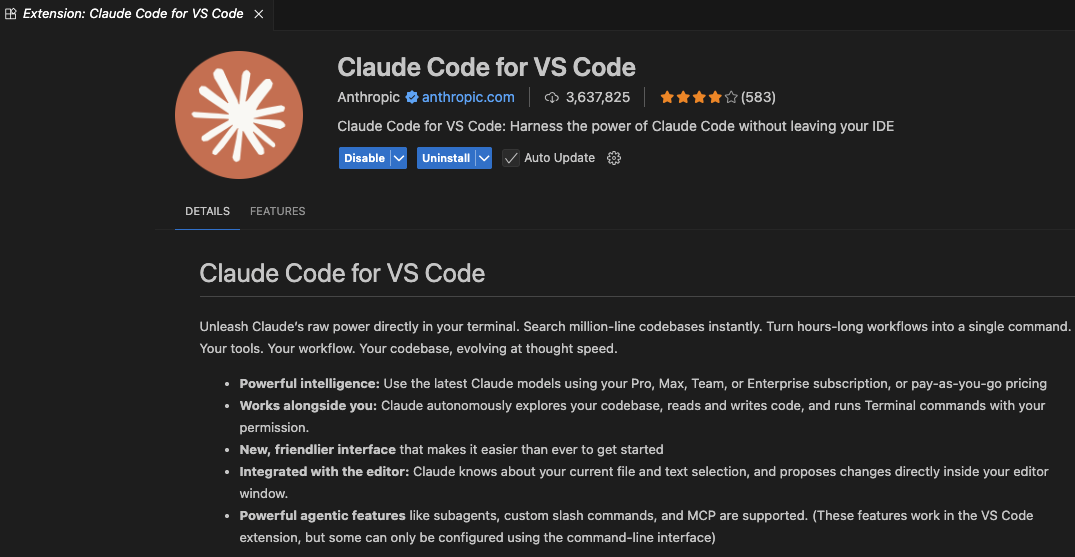

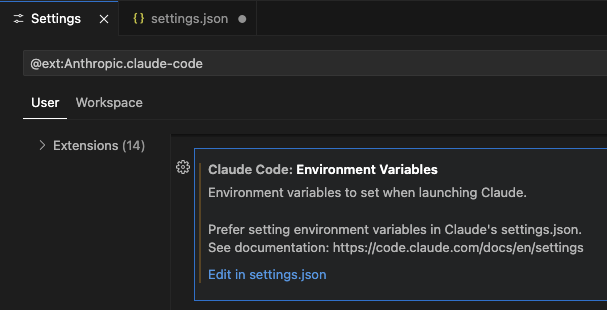

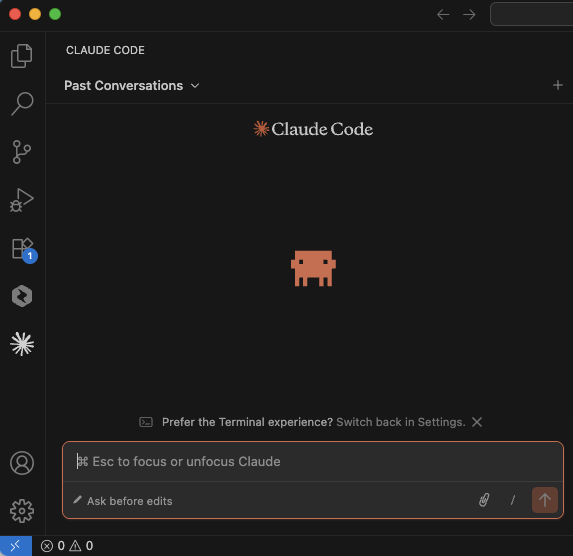

Além de usar no terminal, também pode ser usado no VS Code, a configuração é a seguinte:

Além de usar no terminal, também pode ser usado no VS Code, a configuração é a seguinte:

Primeiro, instalamos o plugin Claude Code for VS Code.

Em seguida, configuramos as variáveis de ambiente:

Em seguida, configuramos as variáveis de ambiente:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}E então podemos começar a trabalhar.

Pergunta para reflexão: O Claude Code que não usa modelos da Anthropic ainda é aquele Claude Code?

Pergunta para reflexão: O Claude Code que não usa modelos da Anthropic ainda é aquele Claude Code?

A capacidade do modelo gpt-oss-20b-mlx que usamos certamente não pode ser comparada ao Opus 4.5, mas, se você implantou o Kimi K2.5 no seu ambiente local, atualmente parece que a capacidade não é inferior ao Opus 4.5.