Bomba a sosit! Ghid pentru Claude Code cu Token nelimitat local

Claude Code este foarte puternic, dar consumul de Token te face să te doară ficatul!

În sfârșit, Claude Code poate funcționa cu modele locale, configurarea este foarte simplă.

Următorul mediu este Mac Mini4. Mediu Windows este de asemenea posibil.

În epoca actuală, dacă te joci cu AI desktop, este recomandat să achiziționezi un mini calculator Mac din seria M, cum ar fi mini4\mini4 pro\m3 ultra\m4 max, o unealtă magică pentru AI desktop personal.

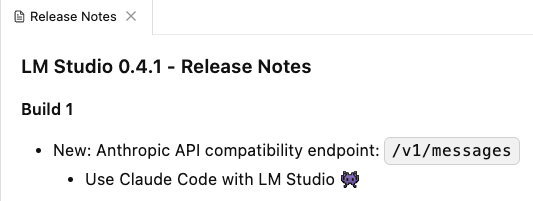

În primul rând, trebuie să actualizați LM Studio la cea mai recentă versiune, adică 0.4.1, deoarece cea mai nouă versiune a adăugat suport pentru Claude Code. (Ollama este de asemenea posibil)

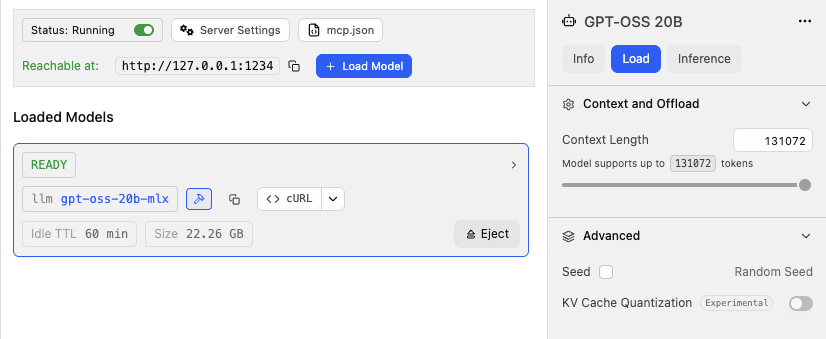

Puteți încărca orice model open-source local, atâta timp cât memoria Mac-ului dvs. este suficientă. Vom lua ca exemplu gpt-oss-20b-mlx, acesta este un model open-source de la OpenAI.

Atenție la un lucru: Context length setat la maxim, adică lungimea contextului trasă la maximul suportat de model, deoarece performanța agentului în sarcini cu mai multe runde depinde foarte mult de lungimea contextului, dacă este prea mică nu funcționează. Acest parametru trebuie de asemenea ajustat în funcție de memoria Mac-ului dvs. și de viteza de inferență a modelului. Mai rețineți un lucru: În mediu Mac, descărcați în prioritate modele în format MLX, viteza de inferență este mai rapidă decât modelele în format GGUF.

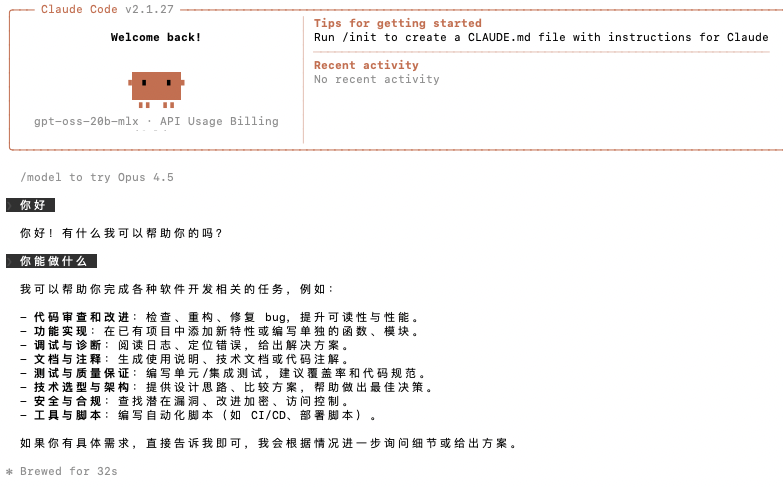

În continuare, instalăm claude code în terminalul de linie de comandă.

Configurați variabilele de mediu:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Instalați claude code în sine:

npm install -g @anthropic-ai/claude-codeApoi, porniți claude code:

claude --model gpt-oss-20b-mlxÎn acest moment, claude code va apela modelul dvs. local pentru a produce rezultate.

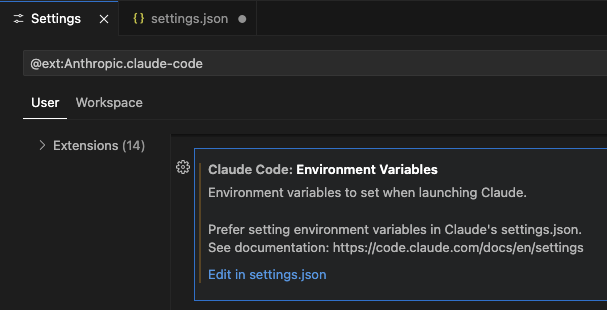

Pe lângă utilizarea în terminal, poate fi folosit și în VS Code, configurația este următoarea:

Pe lângă utilizarea în terminal, poate fi folosit și în VS Code, configurația este următoarea:

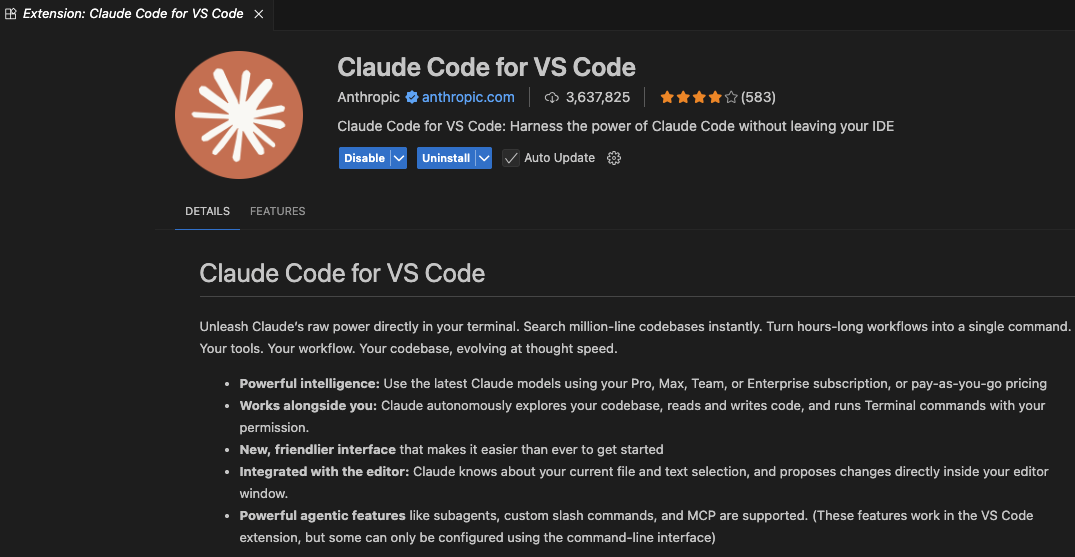

Mai întâi instalăm plugin-ul Claude Code for VS Code.

Apoi setăm variabilele de mediu:

Apoi setăm variabilele de mediu:

{ "claudeCode.environmentVariables": [ {"name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234"}, {"name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio"} ]}Apoi puteți începe să lucrați.

Întrebare de reflecție: Claude Code care nu folosește modele Anthropic mai este același Claude Code?

Întrebare de reflecție: Claude Code care nu folosește modele Anthropic mai este același Claude Code?

Modelul gpt-oss-20b-mlx pe care îl folosim nu poate fi comparat, desigur, cu Opus 4.5, dar dacă ați implementat local Kimi K2.5, în prezent, capacitatea nu este inferioară deloc lui Opus 4.5.