Бомба! Гайд по неограниченным токенам для Claude Code на локальной машине

Claude Code мощный, но расход токенов просто убивает!

Наконец-то Claude Code может работать с локальными моделями, настройка очень простая.

Следующая среда — Mac Mini4. Среда Windows тоже подходит.

В наше время, если занимаетесь настольным ИИ, рекомендую приобрести Mac M-серии мини-ПК, например mini4\mini4 pro\m3 ultra\m4 max — личный настольный инструмент для ИИ.

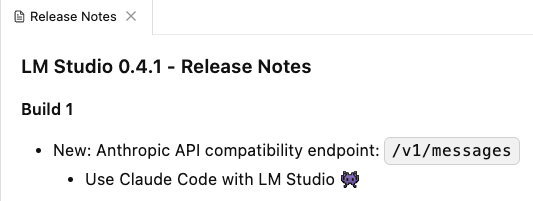

Во-первых, нужно обновить LM Studio до последней версии, то есть 0.4.1, потому что в ней добавлена поддержка Claude Code. (Ollama тоже подходит)

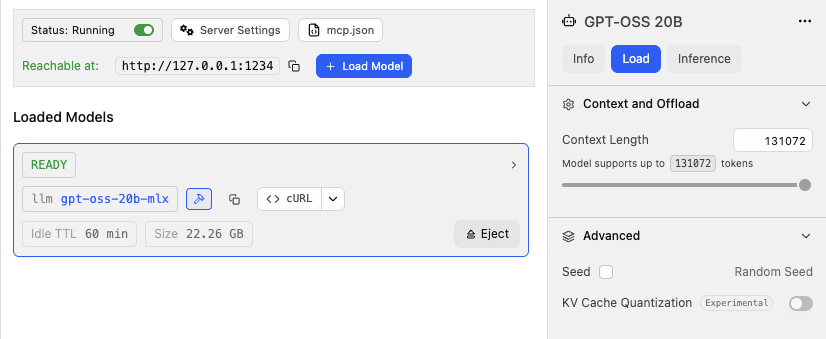

Вы можете использовать любую локальную open-source модель, если на вашем Mac достаточно памяти. Возьмём для примера gpt-oss-20b-mlx — это open-source модель от OpenAI.

Важный момент: Context length выставляем на максимум, то есть длина контекста до максимально поддерживаемой моделью, потому что производительность агента в многошаговых задачах сильно зависит от длины контекста, малая не подходит. Этот параметр также нужно балансировать и корректировать в зависимости от памяти вашего Mac и скорости вывода модели. Ещё один важный момент: для среды Mac предпочтительно скачивать модели в формате MLX, скорость вывода у них выше, чем у моделей в формате GGUF.

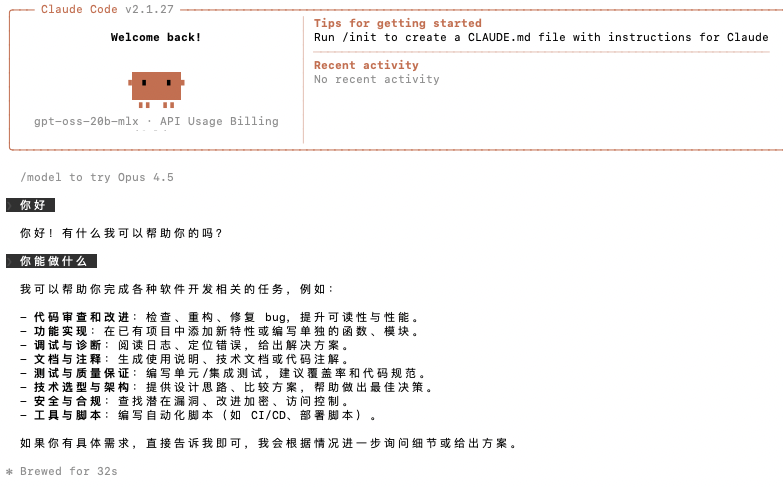

Далее устанавливаем claude code в командной строке терминала.

Настраиваем переменные окружения:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Устанавливаем сам claude code:

npm install -g @anthropic-ai/claude-codeЗатем запускаем claude code:

claude --model gpt-oss-20b-mlxТеперь claude code будет использовать вашу локальную модель для вывода.

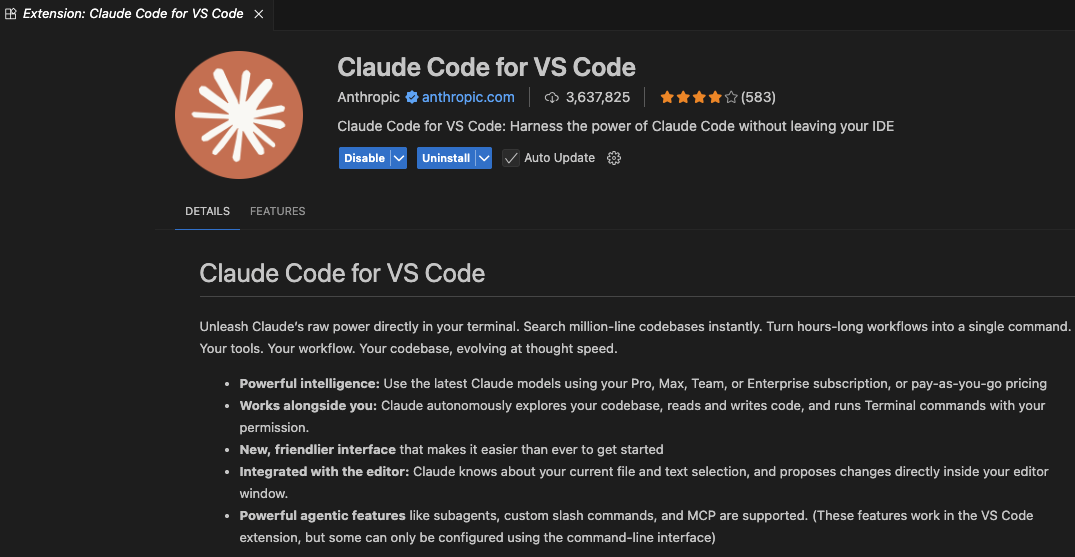

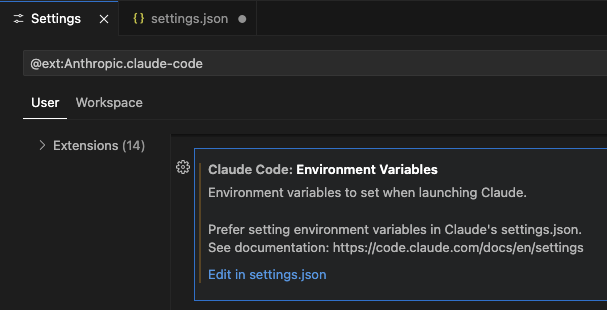

Помимо использования в терминале, можно также использовать в VS Code, настройка следующая:

Помимо использования в терминале, можно также использовать в VS Code, настройка следующая:

Сначала устанавливаем плагин Claude Code for VS Code.

Затем настраиваем переменные окружения:

Затем настраиваем переменные окружения:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}После этого можно приступать к работе.

Вопрос для размышления: остаётся ли Claude Code тем же Claude Code, если не использовать модели Anthropic?

Вопрос для размышления: остаётся ли Claude Code тем же Claude Code, если не использовать модели Anthropic?

Конечно, возможности используемой нами модели gpt-oss-20b-mlx несравнимы с Opus 4.5, однако, если вы развернули локально Kimi K2.5, то, судя по всему, её возможности ничуть не уступают Opus 4.5.