Bomben kommer! Guide till oändliga tokens med Claude Code lokalt

Claude Code är starkt, men token-förbrukningen gör ont i levern!

Äntligen kan Claude Code arbeta med lokala modeller, konfigurationen är väldigt enkel.

Följande miljö är Mac Mini4. Windows-miljö är också möjlig.

I dagens läge, om du vill använda skrivbords-AI, rekommenderas att skaffa en Mac M-serie liten dator, som mini4\mini4 pro\m3 ultra\m4 max, ett personligt skrivbords-AI-underverk.

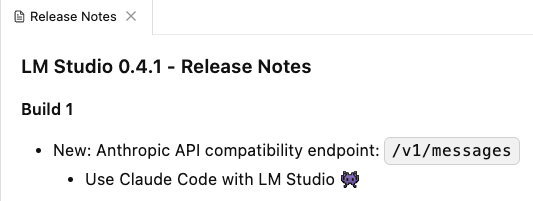

Först måste du uppgradera LM Studio till den senaste versionen, alltså 0.4.1, eftersom den senaste versionen har lagt till stöd för Claude Code. (Ollama fungerar också)

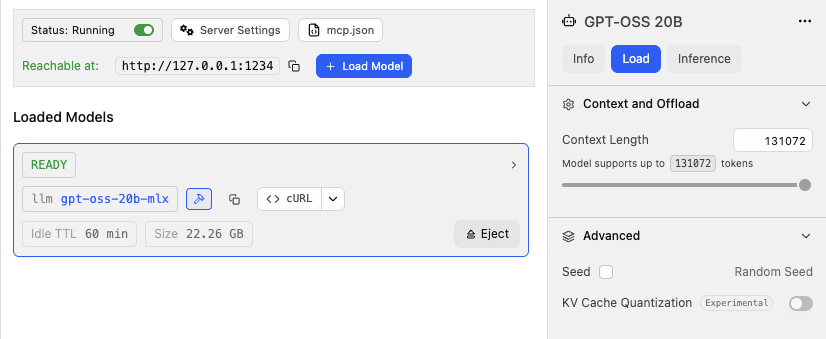

Du kan köra vilken öppen källkod-modell som helst lokalt, så länge din Mac har tillräckligt med minne. Vi tar gpt-oss-20b-mlx som exempel, det här är en OpenAI-modell med öppen källkod.

Observera en sak: Dra Context length till max, alltså dra kontextlängden till modellens maximala stöd, eftersom agenters prestanda för flerrundorsuppgifter är mycket beroende av kontextens längd, för kort fungerar inte. Denna parameter måste också justeras baserat på din Macs minne och modellens inferenshastighet. Ytterligare en sak att notera: I Mac-miljö, ladda ner MLX-formatmodeller först, inferenshastigheten är snabbare än GGUF-formatmodeller.

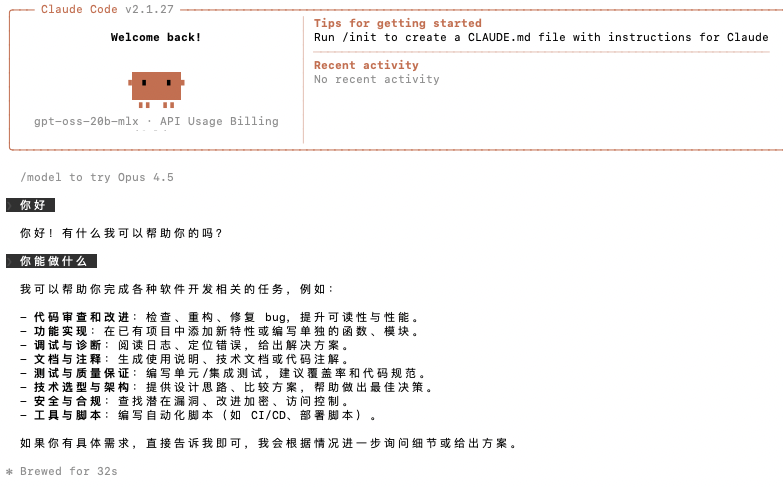

Därefter installerar vi claude code i kommandoradsterminalen.

Konfigurera miljövariabler:

export ANTHROPIC_AUTH_TOKEN=lmstudioexport ANTHROPIC_BASE_URL=http://localhost:1234Installera claude code självt:

npm install -g @anthropic-ai/claude-codeStarta sedan claude code:

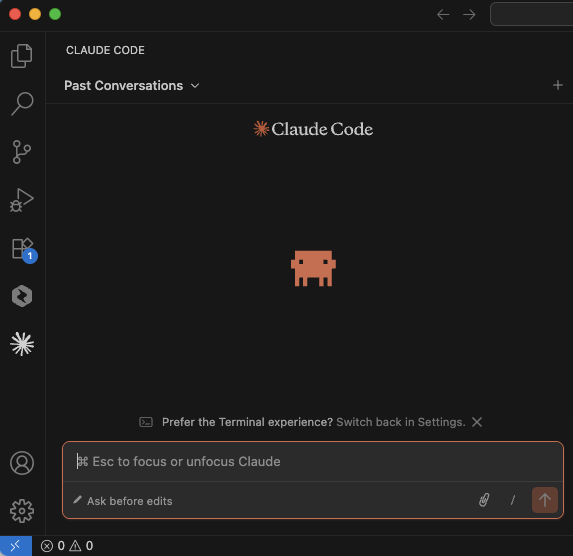

claude --model gpt-oss-20b-mlxNu kommer claude code att anropa din lokala modell för utdata.

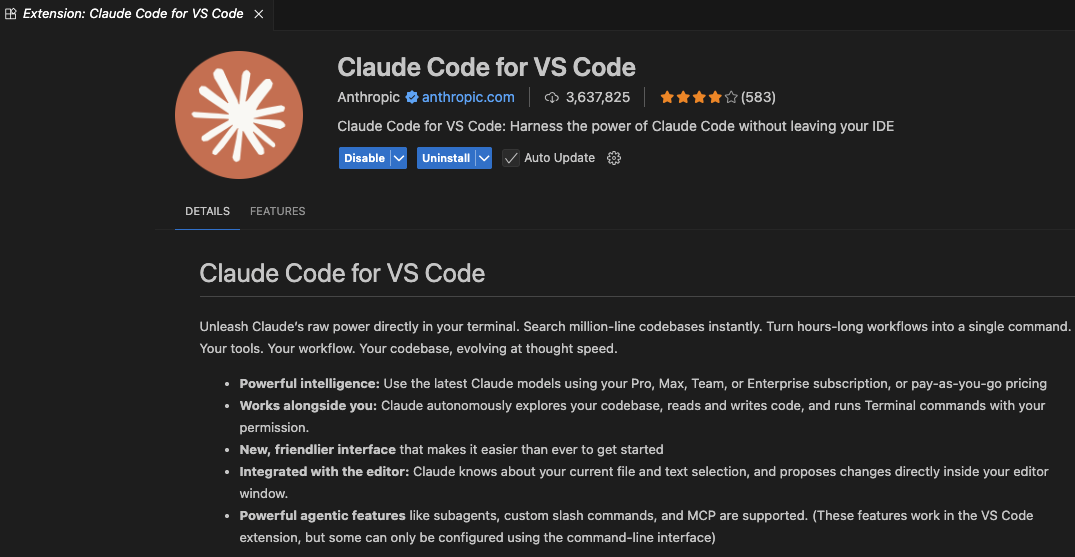

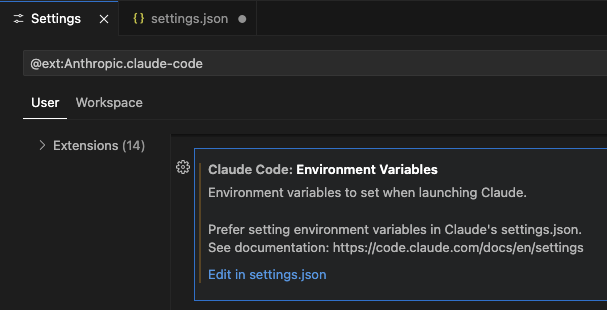

Förutom att användas i terminalen kan det också användas i VS Code, konfigurationen är som följer:

Förutom att användas i terminalen kan det också användas i VS Code, konfigurationen är som följer:

Vi installerar först tillägget Claude Code for VS Code.

Ställ sedan in miljövariabler:

Ställ sedan in miljövariabler:

{ "claudeCode.environmentVariables": [ { "name": "ANTHROPIC_BASE_URL", "value": "http://localhost:1234" }, { "name": "ANTHROPIC_AUTH_TOKEN", "value": "lmstudio" } ]}Sedan kan du börja jobba.

Fundera på: Är Claude Code som inte använder Anthropics modeller fortfarande samma Claude Code?

Fundera på: Är Claude Code som inte använder Anthropics modeller fortfarande samma Claude Code?

Modellen gpt-oss-20b-mlx som vi använder kan naturligtvis inte jämföras med Opus 4.5, men om du har distribuerat Kimi K2.5 i din lokala miljö, verkar förmågan för närvarande inte vara det minsta underlägsen Opus 4.5.