Ud af Nvidia-økosystemet: OpenAI udgiver ny programmeringsmodel GPT-5.3-Codex-Spark, hastighed op til 1000 tokens pr. sekund

Ud af Nvidia-økosystemet: OpenAI udgiver ny programmeringsmodel GPT-5.3-Codex-Spark, hastighed op til 1000 tokens pr. sekund

OpenAI har netop udgivet en ny programmeringsmodel, der kører på en chip på størrelse med en tallerken og kan spytte mere end 1000 tokens ud pr. sekund.

Dens navn er GPT-5.3-Codex-Spark, og det er første gang, at OpenAI fuldstændig forlader Nvidia-økosystemet og implementerer en programmeringsmodel på sin egenudviklede hardware.

Kerne Parametre

- Inferenshastighed: 1000+ tokens/sekund

- Latency: Første token latency kun 50ms

- Strømforbrug: Ca. 100W (svarende til en pære)

- Programmeringsevner: Fokuseret på kodegenerering og -forståelse

Hardwarearkitektur

Denne chip anvender et helt nyt arkitekturdesign, der er specielt optimeret til Transformer-modelinferens. Sammenlignet med traditionelle GPU'er er effektiviteten markant forbedret ved håndtering af autoregressive genereringsopgaver.

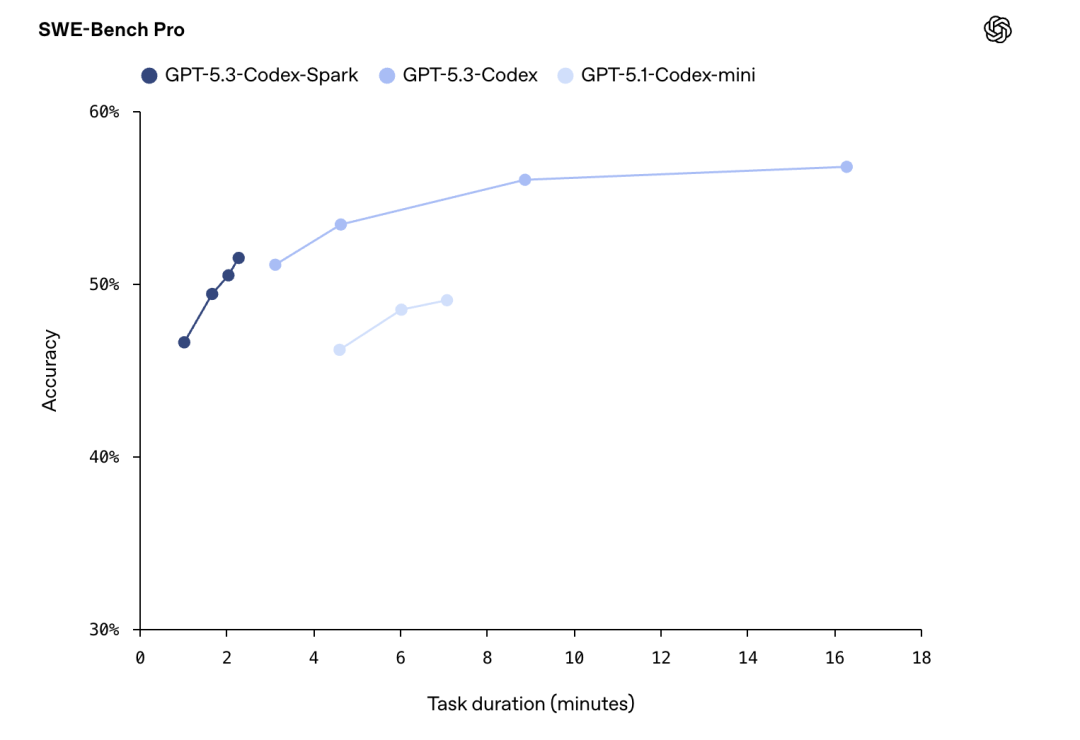

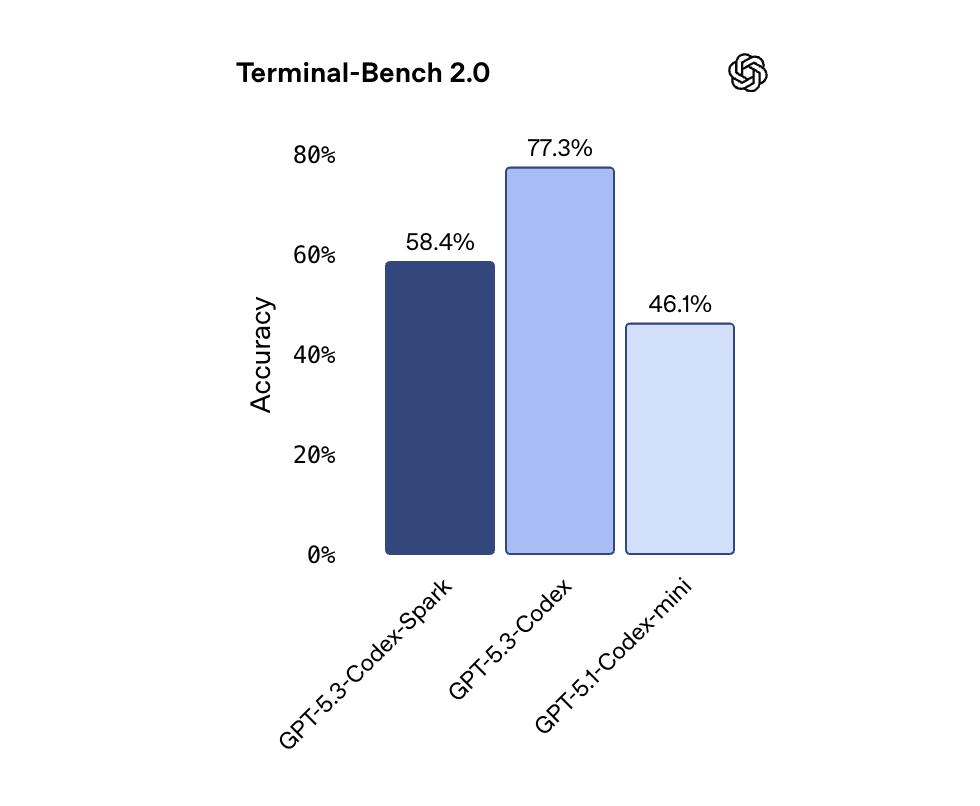

Ydelsessammenligning

Sammenlignet med lignende modeller udviser GPT-5.3-Codex-Spark en forbløffende hastighedsfordel i kodegenereringsopgaver, samtidig med at den opretholder en høj kodekvalitet.

Anvendelsesscenarier

- Kodefuldførelse i realtid

- Intelligent kode gennemgang

- Automatiseret testgenerering

- Kode refactoring forslag

Betydning

Dette markerer, at OpenAI officielt er gået ind i en konkurrencefase med integration af software og hardware. Ikke længere afhængig af Nvidias GPU'er betyder lavere omkostninger, højere effektivitet og fuld kontrol over forsyningskæden.

For udviklere betyder det, at AI-programmeringsassistenter bliver hurtigere, billigere og mere udbredte.