Ausbruch aus dem Nvidia-Ökosystem: OpenAI veröffentlicht neues Programmiermodell GPT-5.3-Codex-Spark mit einer Geschwindigkeit von 1000 Token pro Sekunde

Ausbruch aus dem Nvidia-Ökosystem: OpenAI veröffentlicht neues Programmiermodell GPT-5.3-Codex-Spark mit einer Geschwindigkeit von 1000 Token pro Sekunde

Gerade hat OpenAI ein neues Programmiermodell veröffentlicht, das auf einem Chip von der Größe eines Tellers läuft und mehr als 1000 Token pro Sekunde ausgibt.

Es heißt GPT-5.3-Codex-Spark, und dies ist das erste Mal, dass OpenAI vollständig aus dem Nvidia-Ökosystem ausbricht und ein Programmiermodell auf selbst entwickelter Hardware bereitstellt.

Kernparameter

- Inferenzgeschwindigkeit: 1000+ tokens/Sekunde

- Latenz: Nur 50ms Latenz für das erste Token

- Leistungsaufnahme: ca. 100W (entspricht einer Glühbirne)

- Programmierfähigkeiten: Fokus auf Codegenerierung und -verständnis

Hardware-Architektur

Dieser Chip verwendet ein völlig neues Architekturdesign, das speziell für die Inferenz von Transformer-Modellen optimiert ist. Im Vergleich zu herkömmlichen GPUs ist die Effizienz bei der Verarbeitung autoregressiver Generierungsaufgaben deutlich verbessert.

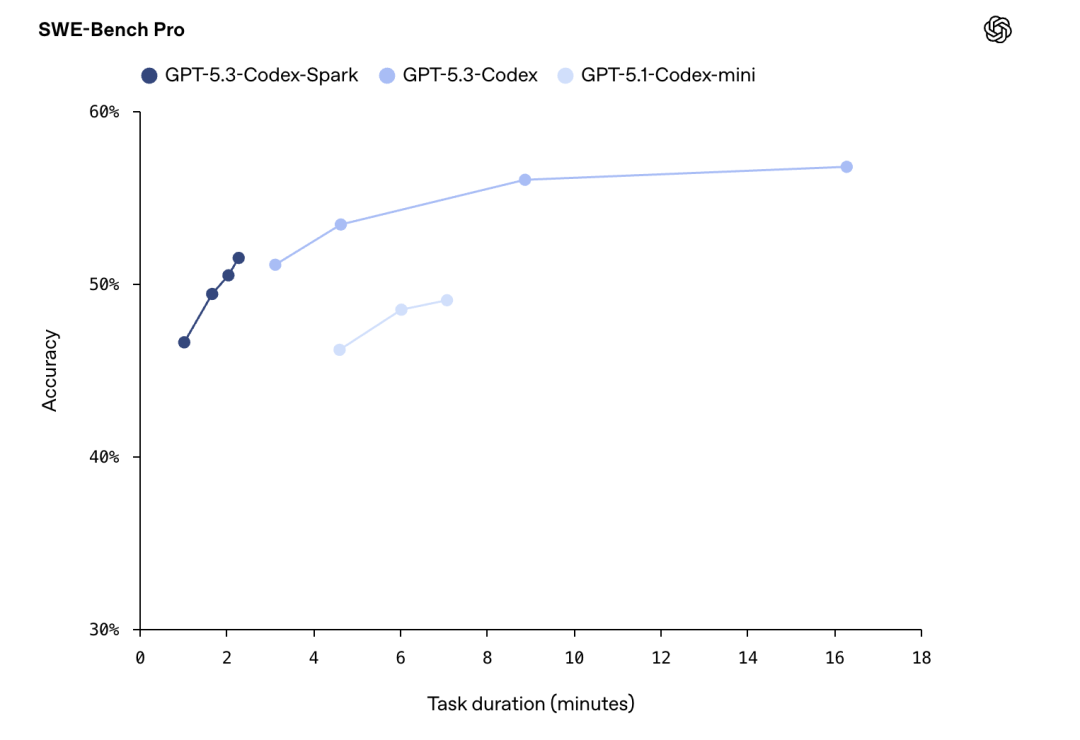

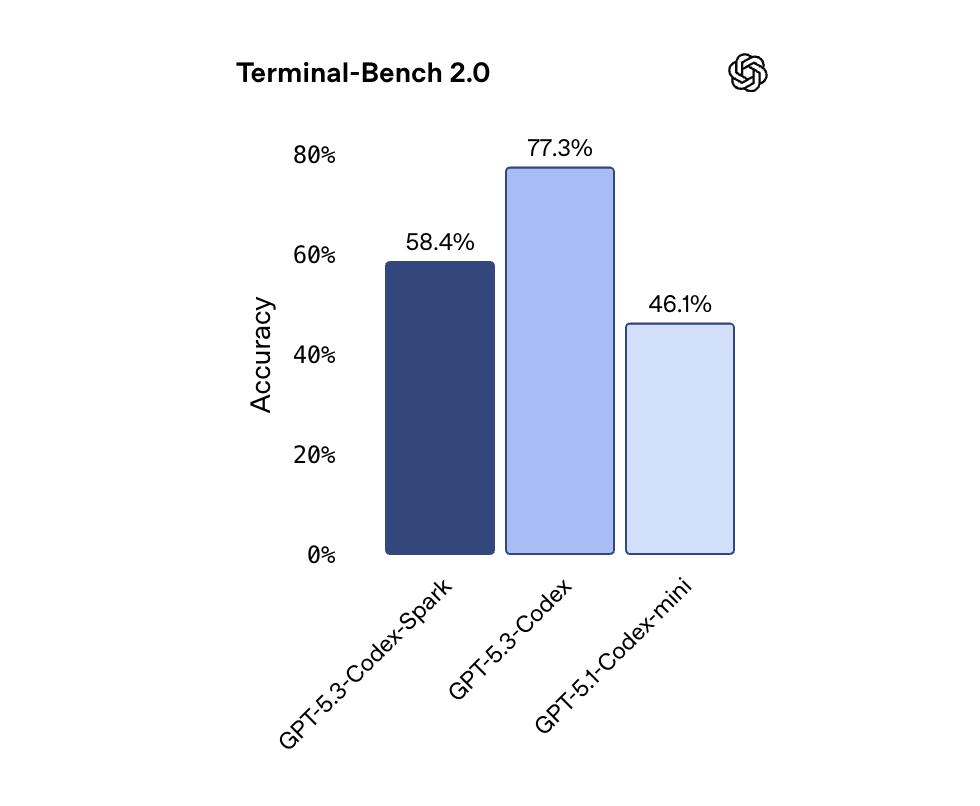

Leistungsvergleich

Im Vergleich zu ähnlichen Modellen zeigt GPT-5.3-Codex-Spark eine erstaunliche Geschwindigkeitsvorteile bei Codegenerierungsaufgaben und behält gleichzeitig eine hohe Codequalität bei.

Anwendungsbereiche

- Echtzeit-Codevervollständigung

- Intelligente Codeüberprüfung

- Automatisierte Testgenerierung

- Code-Refactoring-Vorschläge

Bedeutung

Dies markiert den offiziellen Eintritt von OpenAI in die Phase des Wettbewerbs um Software- und Hardwareintegration. Die Unabhängigkeit von Nvidias GPUs bedeutet niedrigere Kosten, höhere Effizienz und vollständige Kontrolle über die Lieferkette.

Für Entwickler bedeutet dies, dass KI-Programmierassistenten schneller, billiger und weiter verbreitet werden.