Rompiendo con el ecosistema de Nvidia: OpenAI lanza el nuevo modelo de programación GPT-5.3-Codex-Spark, con una velocidad de 1000 tokens por segundo

Rompiendo con el ecosistema de Nvidia: OpenAI lanza el nuevo modelo de programación GPT-5.3-Codex-Spark, con una velocidad de 1000 tokens por segundo

Recientemente, OpenAI lanzó un nuevo modelo de programación que se ejecuta en un chip del tamaño de un plato y puede generar más de 1000 tokens por segundo.

Se llama GPT-5.3-Codex-Spark, y esta es la primera vez que OpenAI se sale por completo del ecosistema de Nvidia y despliega un modelo de programación en hardware de desarrollo propio.

Parámetros clave

- Velocidad de inferencia: 1000+ tokens/segundo

- Latencia: Solo 50ms de latencia para el primer token

- Consumo de energía: Aproximadamente 100W (equivalente a una bombilla)

- Capacidad de programación: Centrado en la generación y comprensión de código

Arquitectura de hardware

Este chip adopta un diseño de arquitectura completamente nuevo, optimizado para la inferencia de modelos Transformer. En comparación con las GPU tradicionales, mejora significativamente la eficiencia en el procesamiento de tareas de generación autorregresiva.

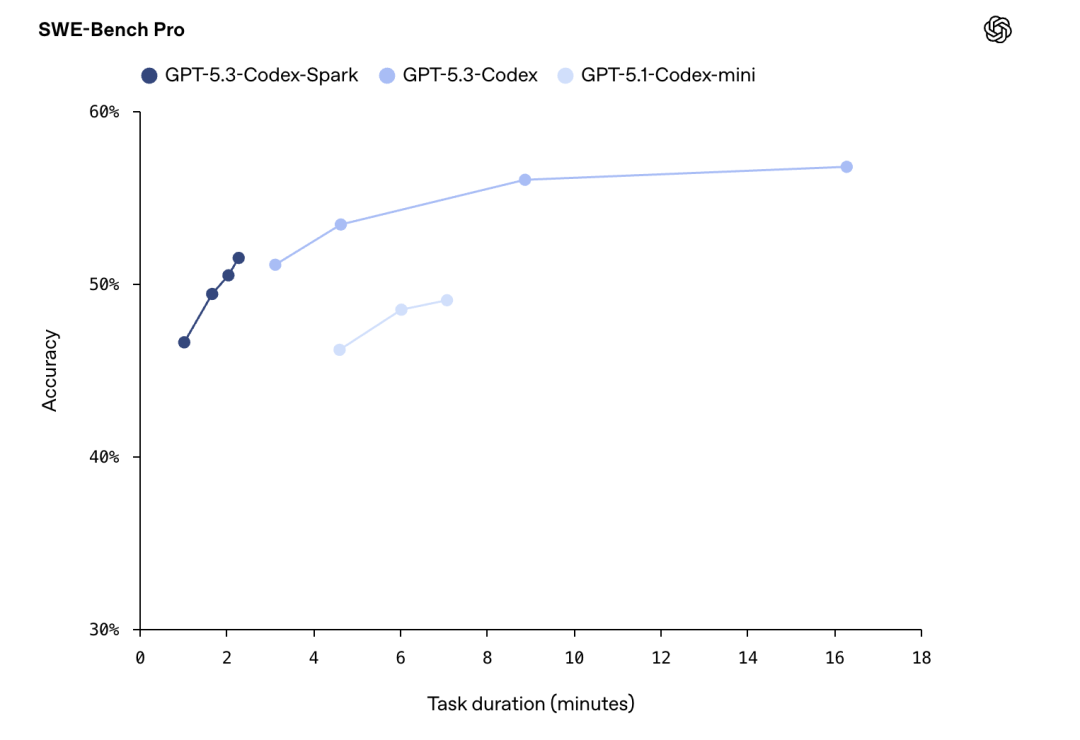

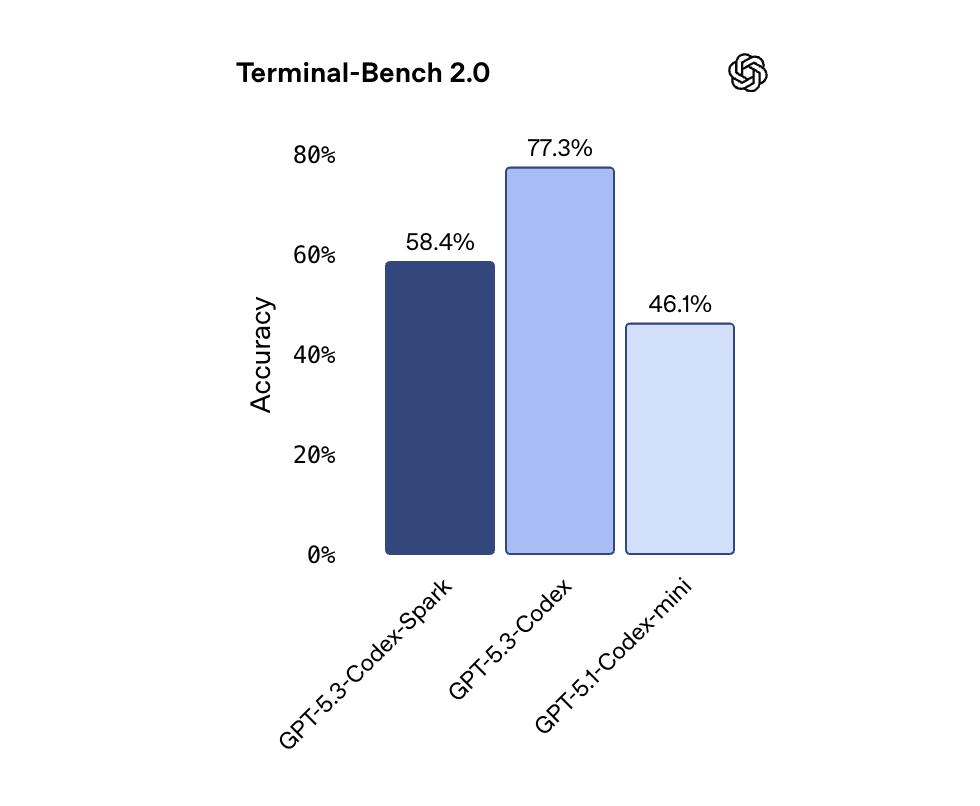

Comparación de rendimiento

En comparación con modelos similares, GPT-5.3-Codex-Spark muestra una sorprendente ventaja de velocidad en las tareas de generación de código, manteniendo al mismo tiempo una alta calidad de código.

Escenarios de aplicación

- Autocompletado de código en tiempo real

- Revisión inteligente de código

- Generación automatizada de pruebas

- Sugerencias de refactorización de código

Significado

Esto marca la entrada formal de OpenAI en la fase de competencia de integración de software y hardware. Ya no depender de las GPU de Nvidia significa menores costos, mayor eficiencia y control total sobre la cadena de suministro.

Para los desarrolladores, esto significa que los asistentes de programación de IA serán más rápidos, más baratos y más accesibles.