Sortir de l'écosystème Nvidia : OpenAI lance un nouveau modèle de programmation GPT-5.3-Codex-Spark, avec une vitesse de 1000 tokens par seconde

Sortir de l'écosystème Nvidia : OpenAI lance un nouveau modèle de programmation GPT-5.3-Codex-Spark, avec une vitesse de 1000 tokens par seconde

OpenAI vient d'annoncer un nouveau modèle de programmation, fonctionnant sur une puce de la taille d'une assiette, capable de produire plus de 1000 tokens par seconde.

Son nom est GPT-5.3-Codex-Spark. C'est la première fois qu'OpenAI sort complètement de l'écosystème Nvidia et déploie un modèle de programmation sur du matériel développé en interne.

Paramètres clés

- Vitesse d'inférence : 1000+ tokens/seconde

- Latence : Seulement 50ms pour le premier token

- Consommation électrique : Environ 100W (l'équivalent d'une ampoule)

- Capacité de programmation : Axé sur la génération et la compréhension de code

Architecture matérielle

Cette puce adopte une toute nouvelle conception d'architecture, optimisée spécifiquement pour l'inférence de modèles Transformer. Par rapport aux GPU traditionnels, elle améliore considérablement l'efficacité lors du traitement des tâches de génération autorégressive.

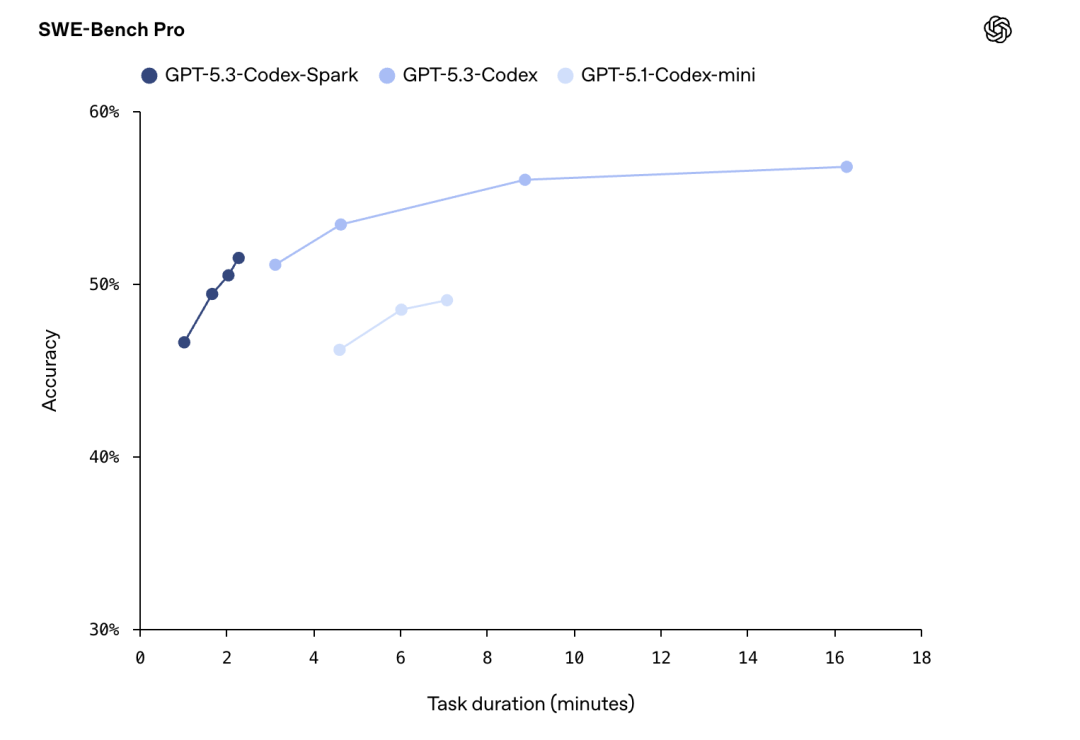

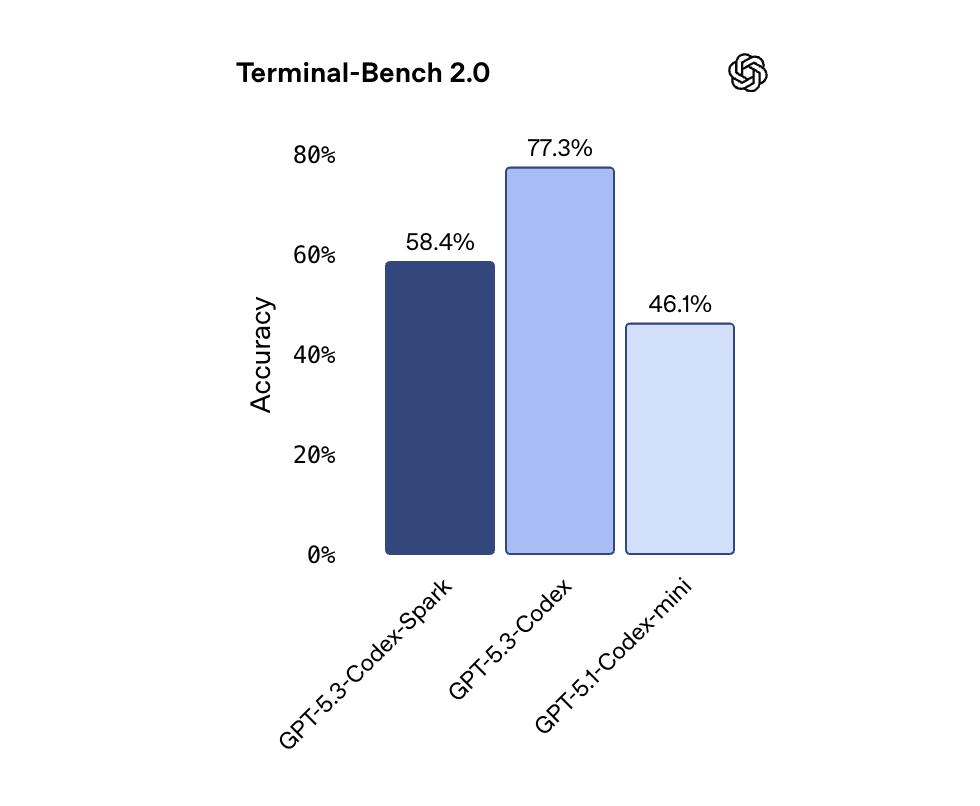

Comparaison des performances

Comparé aux modèles similaires, GPT-5.3-Codex-Spark présente un avantage de vitesse étonnant dans les tâches de génération de code, tout en conservant une qualité de code élevée.

Scénarios d'application

- Complétion de code en temps réel

- Examen intelligent du code

- Génération automatisée de tests

- Suggestions de refactoring de code

Signification

Cela marque l'entrée officielle d'OpenAI dans la phase de concurrence d'intégration matérielle et logicielle. Ne plus dépendre des GPU de Nvidia signifie des coûts plus bas, une efficacité accrue et un contrôle total de la chaîne d'approvisionnement.

Pour les développeurs, cela signifie que les assistants de programmation IA deviendront plus rapides, moins chers et plus répandus.